China dominiert die Open-KI-Charts

Mit Qwen, Deepseek und Kimi-K2 führt China das Feld der Open-Modelle an. Was macht OSS von OpenAI?

gpt-image-1 | All-AI.de

EINLEITUNG

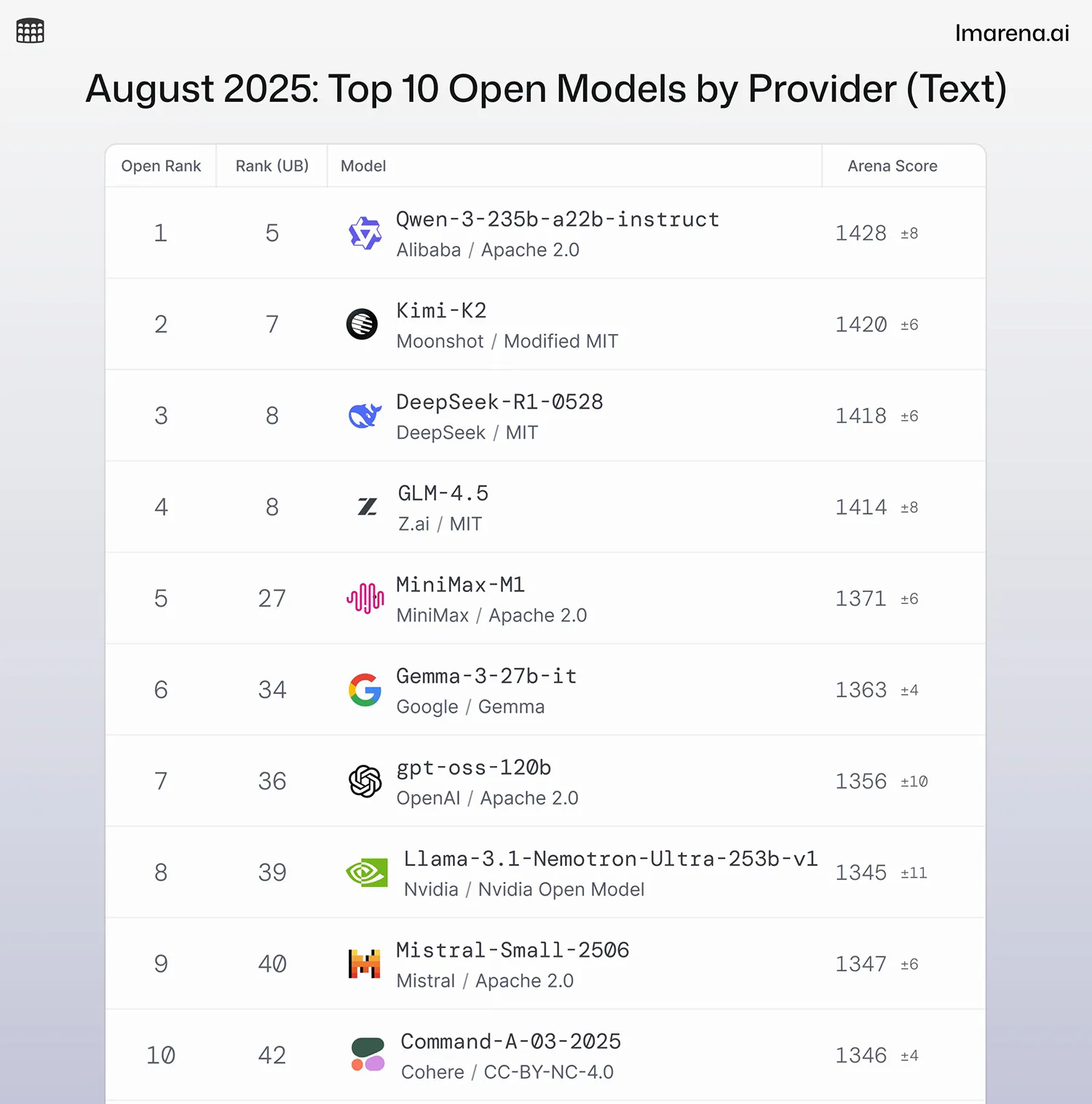

Im August hat die Text-Arena ihr Ranking der offenen Sprachmodelle neu sortiert – mit überraschendem Ergebnis: Modelle wie Qwen-3-235B-A22B-Instruct, GLM-4.5 und das neue gpt-oss-120b von OpenAI landen direkt im Spitzenfeld. Zum ersten Mal schaffen es alle Open-Top-10 gleichzeitig auch ins Gesamtranking der besten LLMs. Was steckt hinter diesem Leistungsschub, und welche offenen Modelle taugen wirklich etwas für den praktischen Einsatz?

NEWS

Qwen zieht das Tempo an

Qwen-3-235B-A22B-Instruct dominiert aktuell das Open-Feld – und das liegt nicht nur an der schieren Größe. Hinter dem Modell steckt ein flexibler Mixture-of-Experts-Ansatz: 235 Milliarden Parameter insgesamt, aber nur 22 Milliarden aktiv pro Token. Dadurch lassen sich Rechenkosten einsparen, ohne auf Tiefgang beim Reasoning zu verzichten. Besonders clever: Das Modell bietet zwei Modi – „Thinking“ für komplexes Nachdenken und „Non-Thinking“ für schnelle Antworten.

Spannend ist auch, wie schnell das Modell ins Ökosystem diffundiert. Anbieter wie Cerebras integrieren die aktuelle Version direkt in ihre Plattformen – inklusive Hosting. Für KI-Builder bedeutet das: Man muss kein eigenes GPU-Cluster hochziehen, um mit einem der derzeit leistungsstärksten Open-Modelle zu experimentieren. Die Hürde zwischen Benchmark und produktivem Einsatz sinkt merklich.

Quelle: lmarena

Neue Namen, starkes Debüt: GLM-4.5 und gpt-oss

ZhipuAI bringt mit GLM-4.5 ein Hybridmodell in Stellung, das zwischen Reasoning und Direktantworten hin- und herwechseln kann. Der Wechsel zwischen „Thinking“ und Schnelligkeit erinnert an Qwen – allerdings mit anderen Lizenzbedingungen. GLM-4.5 steht unter MIT-Lizenz und bietet auch FP8-Varianten an, was die Nutzung für eigene Produkte besonders attraktiv macht. In der Arena ist das Modell erstmals in der offenen Top-10 zu finden – und das mit bemerkenswert starker Performance.

Noch überraschender ist OpenAIs gpt-oss-120b. Nach Jahren proprietärer Modelle öffnet der Marktführer wieder Gewichte – unter Apache-2.0 und mit 128k-Kontext. Die Leistung liegt nahe bei OpenAIs eigenem o4-mini, lässt sich aber auf nur einer 80-GB-GPU betreiben. Für Entwickler mit begrenzten Ressourcen ist das ein echtes Argument. Dass gpt-oss-120b sofort in die Top-10 der offenen Modelle einsteigt, zeigt: OpenAI meint es ernst mit der Wiederbelebung des Open-Gedankens.

China bleibt Taktgeber bei offenen Modellen

Wer aktuell in die oberen Ränge der Open-Modelle blickt, sieht einen klaren Trend: chinesische Labs geben den Takt an. Neben Qwen und GLM-4.5 überzeugt auch Moonshots Kimi-K2, ein Modell mit Agentic-Fokus und Milliarden von Parametern im MoE-Setup. Dazu kommen DeepSeek-R1 und MiniMax-M1 – Modelle, die in Benchmarks wie bei der Codegenerierung oder beim Reasoning sichtbar aufschließen.

China zeigt dabei nicht nur Masse, sondern auch strategisches Gespür. Offene Lizenzen, skalierbare Hardware-Anforderungen und aggressive Releases – das alles wirkt wie ein Gegenentwurf zur bisher westlich dominierten Modelllandschaft. Für Entwickler, die nicht auf Blackbox-Systeme setzen wollen, entsteht damit eine echte Alternative.

Was die Text-Arena wirklich misst – und warum das zählt

Die Text-Arena verzichtet auf klassische Metriken wie MMLU oder HellaSwag. Stattdessen setzt sie auf menschliche Duelle: Zwei Antworten, ein Prompt, ein Urteil. Dieses Pairwise-Voting misst, was Modelle im Alltag leisten – also dort, wo Formulierung, Klarheit und Nutzwert zählen. Der Haken: Es ersetzt keine spezifischen Tests für einzelne Anwendungsfälle. Aber es zeigt Trends.

Und der Trend ist klar: Open-Modelle sind 2025 nicht mehr nur eine Sparlösung – sie sind konkurrenzfähig. Zehn offene Systeme unter den besten fünfzig insgesamt, viele davon mit produktionsfähigen Lizenzen. Für KI-Builder bedeutet das: Wer 2025 ein Modell auswählt, sollte Open-Alternativen nicht nur mitdenken, sondern aktiv ausprobieren. Manche von uns werden überrascht sein, wie wenig Proprietary heute noch zwingend ist.

DEIN VORTEIL - DEINE HILFE

KURZFASSUNG

- Die Text-Arena zeigt im August eine klare Dominanz offener KI-Modelle mit Qwen, GLM-4.5 und gpt-oss an der Spitze.

- Besonders OpenAI sorgt mit gpt-oss für Aufsehen, da es erstmals wieder freie Gewichte veröffentlicht.

- China positioniert sich mit Qwen, Kimi-K2 und DeepSeek als führende Kraft im Bereich offener Sprachmodelle.

- Offene Modelle sind 2025 nicht nur konkurrenzfähig, sondern auch produktionsreif – ideal für Entwicklerteams.