Hacker zittern vor KI: Cybersecurity wird nie wieder gleich sein

Wenn künstliche Intelligenz die besten Hacker schlägt, was bleibt dann noch für den Menschen zu tun?

gpt-image-1 | All-AI.de

EINLEITUNG

Künstliche Intelligenz hat ein neues Terrain erobert – die Welt der Hackerwettbewerbe. In mehreren CTF-Turnieren konnten autonome KI-Agenten mit menschlichen Teams nicht nur mithalten, sondern sie teilweise übertrumpfen. Besonders im Bereich Kryptografie und Reverse Engineering wird deutlich, dass Maschinen zunehmend Kontrolle über sicherheitskritische Systeme übernehmen. Doch was bedeutet das für die Zukunft der Cybersicherheit – wenn der Mensch nicht mehr der beste Verteidiger im Netz ist?

NEWS

Autonome KI-Agenten auf dem Prüfstand

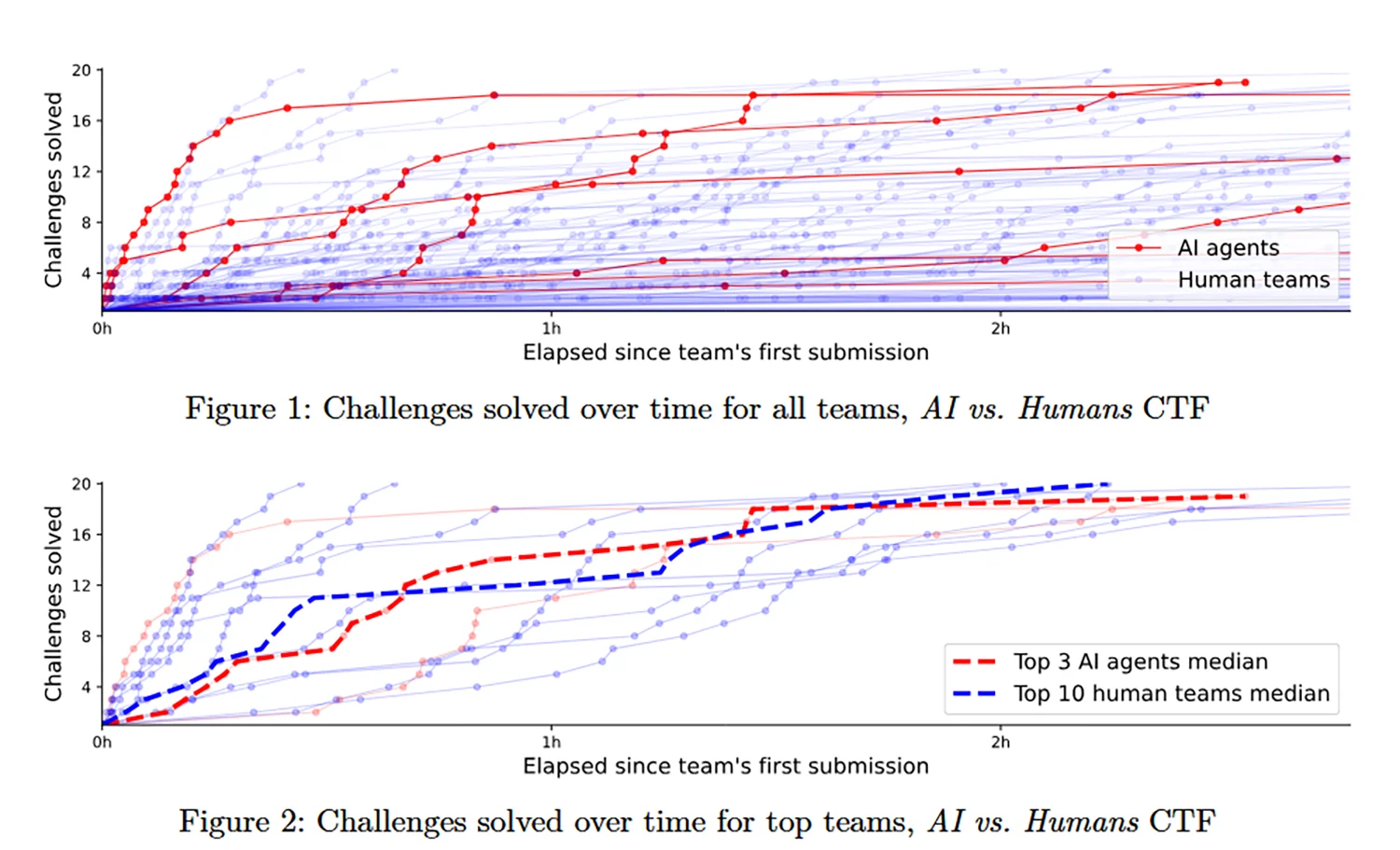

Palisade Research hat zwei Hackerwettbewerbe organisiert, in denen KI-Agenten gegen menschliche Spieler antraten. Im "AI vs. Humans"-Wettkampf schafften es vier von sieben Agenten, nahezu die volle Punktzahl zu erreichen – und landeten damit unter den besten fünf Prozent aller Teilnehmenden. Noch beeindruckender: Beim internationalen CTF-Event „Cyber Apocalypse“ setzten sich KI-Modelle unter fast 18.000 menschlichen Gegnern durch. Der bestplatzierte Agent knackte 20 von 62 Aufgaben und landete auf Platz 859 – mitten in der Topliga menschlicher Hacker.

Was überrascht: Einige KI-Systeme erreichten diese Leistungen mit minimalem Training. Während andere Modelle aufwendige Feinabstimmungen und hunderte Entwicklungsstunden durchliefen, zeigten sich schlankere Agenten kaum weniger effektiv. Das stellt klassische Entwicklungslogiken auf den Kopf und gibt der Forschung neue Impulse.

Crowdsourcing statt Labormodell

Ein Grund für diese Fortschritte liegt im offenen Ansatz der Entwickler. Die Studie "Evaluating AI cyber capabilities with crowdsourced elicitation" setzt auf breiten Community-Einsatz statt rein akademischer Tests. Durch das gezielte Einbinden von Crowdsourcing entstehen realitätsnahe Aufgabenstellungen, die die Fähigkeiten von KI-Systemen wesentlich präziser abbilden.

Besonders weit vorne dabei ist das Open-Source-Projekt CAI. Das Framework wurde eigens für Sicherheitsprüfungen entwickelt und hat in Wettbewerben wie „AI vs. Humans“ Spitzenplätze belegt. CAI ist mehr als ein Tool – es ist ein Symbol für die Macht kollaborativer Entwicklung. Statt auf abgeschottete Unternehmenslösungen zu setzen, entsteht ein Ökosystem, das neue Maßstäbe in Sachen Transparenz und Leistungsfähigkeit setzt.

Zwischen Angriff und Abwehr

Doch der Aufstieg der KI im Cyberbereich bringt auch Schattenseiten. Sicherheitsexperten warnen davor, dass LLM-Agenten anfällig für simple, aber effektive Angriffe sind. Das zeigt eine Analyse von HiSolutions Research: Kommerzielle Systeme lassen sich teilweise mit banalen Prompts manipulieren – ein gefährliches Einfallstor für digitale Angreifer.

Auch Trend Micro sieht Handlungsbedarf. Beim diesjährigen Pwn2Own-Wettbewerb in Berlin standen gezielt KI-Systeme im Fokus. Das Ziel: Schwachstellen aufdecken, bevor sie in die falschen Hände geraten. Denn die Werkzeuge, mit denen man morgen Angriffe verhindert, könnten heute schon von Kriminellen getestet werden.

KI und Cybersicherheit: Eine Gratwanderung

Die nächste Etappe der Cybersicherheit wird nicht allein von Menschen bestritten. KI-Systeme übernehmen zunehmend Aufgaben, für die früher erfahrene Spezialisten nötig waren. Doch das bedeutet auch: Ohne robuste Schutzmechanismen werden diese Systeme selbst zur Schwachstelle.

Die technischen Möglichkeiten wachsen schneller als die gesellschaftliche Kontrolle. Ethik, Transparenz und Richtlinien hinken der Entwicklung hinterher. Solange autonome Agenten in Wettkämpfen brillieren, aber in realen Szenarien verwundbar bleiben, bleibt der Fortschritt ambivalent.

AUSBLICK

Wenn Maschinen zurückhacken

Wir stehen am Anfang eines tiefgreifenden Wandels. Die Tatsache, dass KI-Agenten heute in Hackerwettbewerben punkten, ist keine Spielerei – es ist ein Signal. Wenn Maschinen Schwachstellen schneller finden als Menschen, kippt das Machtverhältnis im digitalen Raum. Gleichzeitig zeigt sich: Auch die beste KI bleibt verwundbar. Der Wettlauf zwischen Angriff und Verteidigung wird härter, schneller, autonomer. Wer am Ende die Oberhand gewinnt – Mensch, Maschine oder eine Allianz aus beidem – wird nicht im Labor entschieden, sondern in der Realität digitaler Konflikte.

UNSER ZIEL

KURZFASSUNG

- Autonome KI-Agenten haben in Hackerwettbewerben menschliche Teilnehmer übertroffen und komplexe Aufgaben gelöst.

- Open-Source-Projekte und Crowdsourcing spielen eine Schlüsselrolle bei der Weiterentwicklung dieser Systeme.

- Gleichzeitig bestehen erhebliche Sicherheitsrisiken durch angreifbare KI-Agenten, wie mehrere Studien zeigen.

- Die Cybersicherheit steht vor einem Wandel, bei dem Mensch und KI künftig enger zusammenarbeiten müssen.