Mistral Medium 3.5 kann länger

Das neue Flaggschiff-Modell vereint Reasoning und Coding bei geringen Hardware-Anforderungen für den Enterprise-Einsatz.

Mit Mistral Medium 3.5 veröffentlicht das Entwicklerstudio ein neues Flaggschiff-Modell für komplexe KI-Workflows. Gleichzeitig wandern Coding-Agenten durch die Integration in Mistral Vibe direkt in die Cloud, während Le Chat einen agentischen Arbeitsmodus für mehrstufige Aufgaben erhält.

Dichte Architektur trifft auf hohe Effizienz

Mistral Medium 3.5 vereint Instruction Following, Reasoning und Coding in einem einzigen Modell mit 128 Milliarden Parametern. Entwickler greifen dabei auf ein Kontextfenster von 256.000 Token zu. Trotz dieser enormen Größe lässt sich das System auf lediglich vier GPUs selbst hosten. Gerade für On-Premise-Szenarien in Unternehmen senkt das die Hardware-Anforderungen erheblich. Flexibilität bietet zudem der anpassbare Reasoning-Aufwand. Nutzer steuern pro Anfrage, ob das KI-Modell eine schnelle Chat-Antwort liefert oder komplexe analytische Überlegungen anstellt.

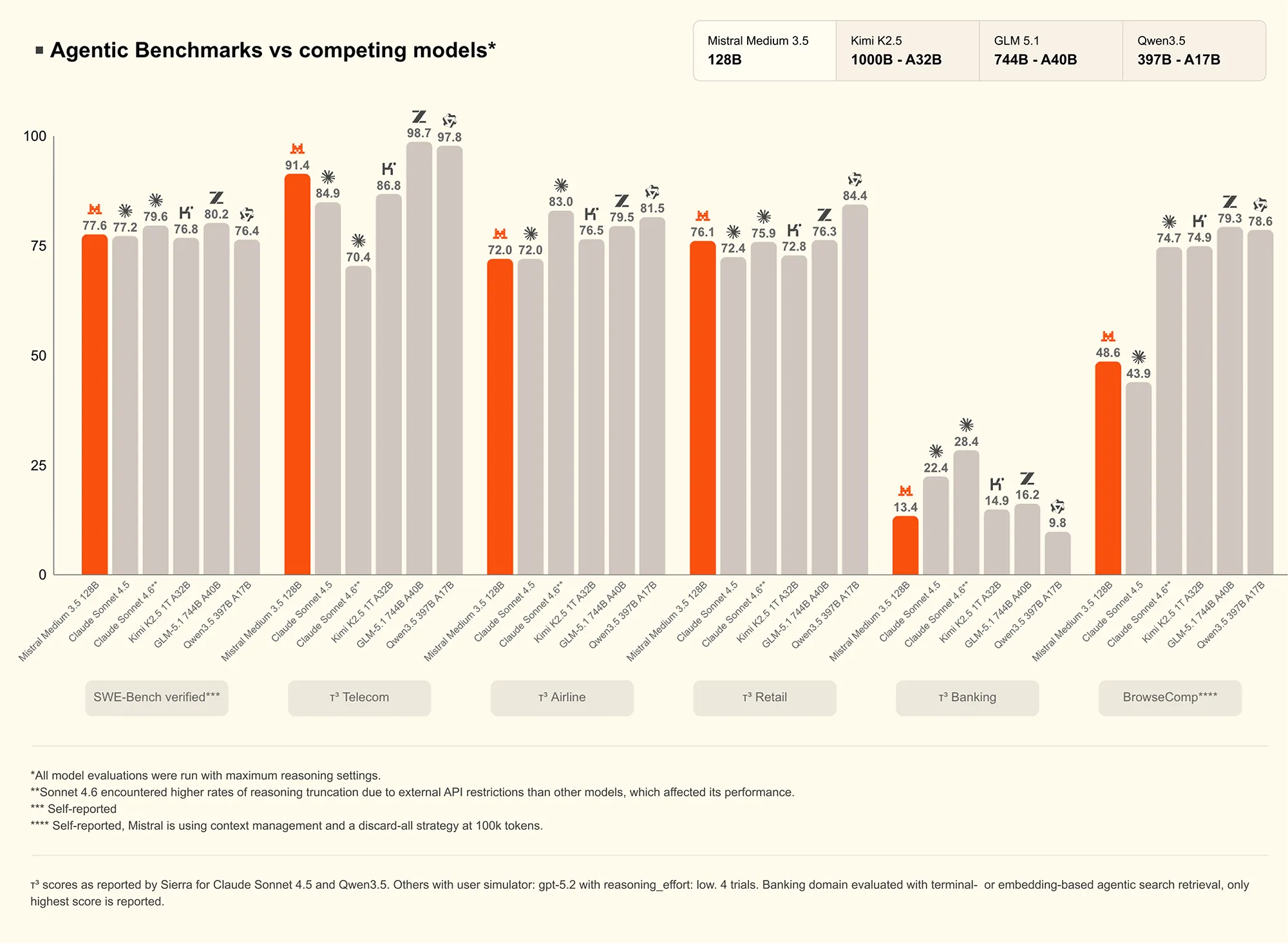

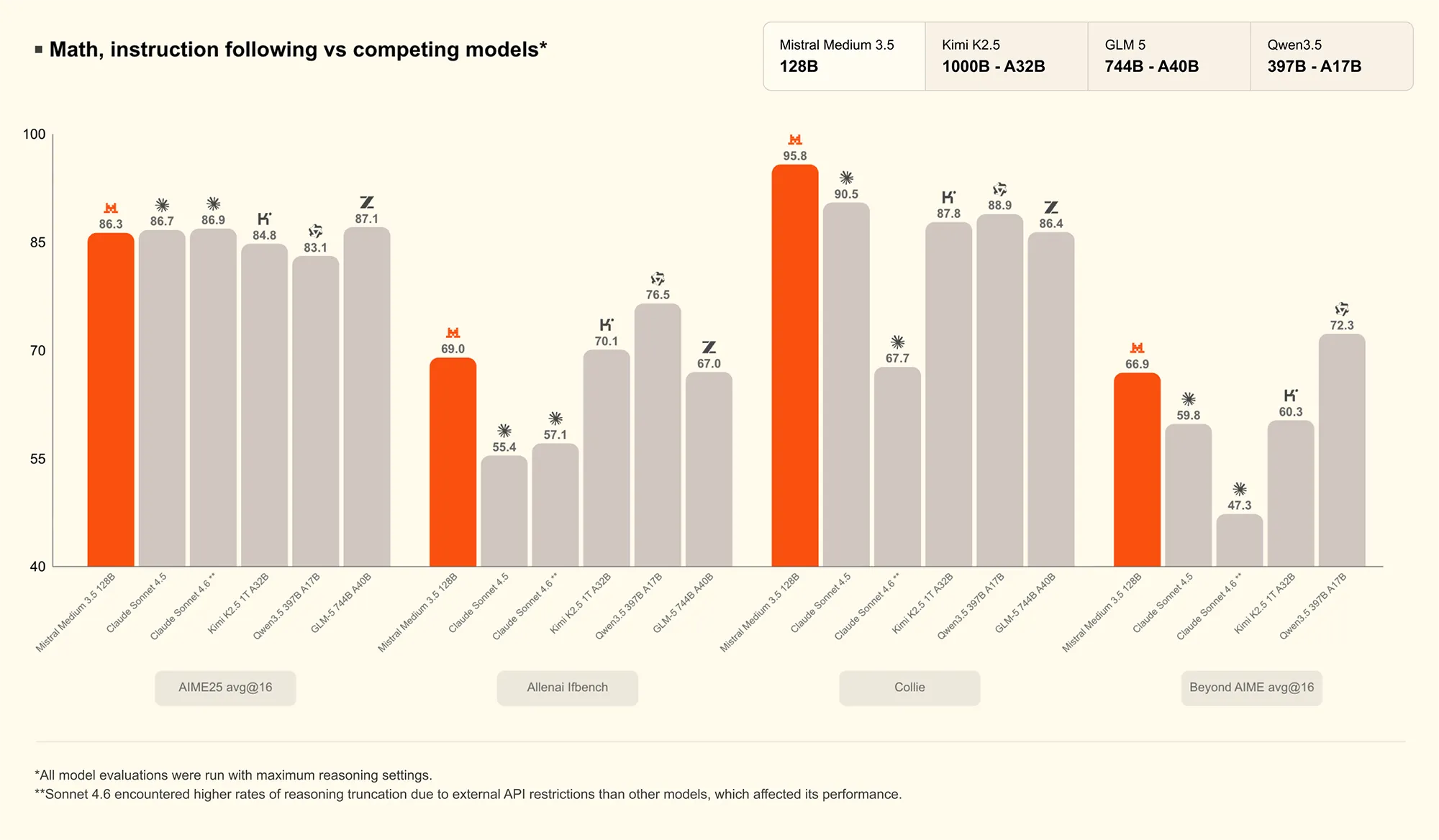

Besonders in direkten Vergleichen zeigt die neue Architektur starke Ergebnisse. Bei den Agentic Benchmarks erreicht Mistral Medium 3.5 im SWE-Bench Verified 77,6 Prozent. Damit übertrifft es nicht nur den internen Vorgänger Devstral 2 mit seinen 72,2 Prozent, sondern setzt sich auch knapp vor konkurrierende KI-Modelle wie Claude Sonnet 4.5, das 77,2 Prozent erzielt. Im branchenspezifischen τ³-Telecom-Test liefert das System 91,4 Punkte. Auch komplexe mathematische Aufgaben löst das Modell äußerst verlässlich. Beim AIME25 avg@16 Benchmark verzeichnet die Neuentwicklung 86,3 Punkte und schlägt damit Architekturen wie Kimi K2.5 sowie Qwen3.5.

Coding-Sessions verlagern sich in die Cloud

Eine fundamentale Neuerung betrifft die Arbeitsweise von Programmierern. Bisher liefen Code-Generierungen oft lokal auf den Endgeräten. Jetzt ermöglicht die Software über Vibe sogenannte Remote Agents. Startet ein Anwender eine Aufgabe über das Command-Line-Interface oder direkt in Le Chat, übernimmt die Cloud die asynchrone Ausführung. Die KI arbeitet im Hintergrund komplett isoliert in einer Sandbox weiter, führt eigenständig umfangreiche Code-Änderungen durch und installiert bei Bedarf nötige Abhängigkeiten.

Laufende lokale Sessions lassen sich auf Knopfdruck nahtlos in die Cloud teleportieren. Der gesamte bisherige Verlauf und erteilte Freigaben bleiben dabei vollständig erhalten. Für eine tiefe Verankerung im Entwickleralltag kommunizieren die Agenten direkt mit etablierten Diensten. Nach Abschluss eines Refactorings oder eines Bugfixes erstellt das System selbstständig einen Pull Request auf GitHub und informiert das Team parallel via Slack oder Teams. Transparenz bleibt jederzeit gewahrt, da Dateidiffs und Tool-Aufrufe fortlaufend einsehbar sind.

Anzeige

Agentisches Handeln im Chat-Interface

Abseits der reinen Programmierung erweitert das Unternehmen den hauseigenen Assistenten Le Chat um einen speziellen Work Mode. Diese Preview-Funktion nutzt Medium 3.5 als primäres Backend, um völlig eigenständig über mehrere Schritte hinweg zu agieren. Das KI-Modell greift parallel auf verschiedene Dienste zu, liest ungelesene E-Mails, durchsucht anstehende Kalendertermine und wertet interne Dokumente aus.

Anwender lagern so äußerst zeitintensive Recherchearbeiten aus. Der Assistent bereitet beispielsweise komplexe Meetings vor, fasst lange Diskussionen zusammen oder erstellt basierend auf Fehlermeldungen direkt entsprechende Jira-Tickets. Sensible Vorgänge führt das System jedoch niemals ungefragt aus. Bevor der Agent eine finale Nachricht versendet oder kritische Daten modifiziert, fordert er stets eine explizite Bestätigung des Nutzers an.

Verfügbarkeit und offene Gewichte

Unternehmen nutzen die neuen Funktionen ab sofort in den Pro-, Team- und Enterprise-Tarifen der Plattform. Entwickler binden Mistral Medium 3.5 über die offizielle API ein, wobei 1,50 US-Dollar pro Million Input-Token und 7,50 US-Dollar für Output-Token anfallen. Alternativ stehen die Open Weights unter einer modifizierten MIT-Lizenz auf Plattformen wie Hugging Face bereit.