Nucleus-Image: Neues KI-Modell schlägt teure Konkurrenz

Der quelloffene Bildgenerator nutzt eine effiziente MoE-Architektur. Mit nur zwei Milliarden aktiven Parametern erreicht es Spitzenwerte.

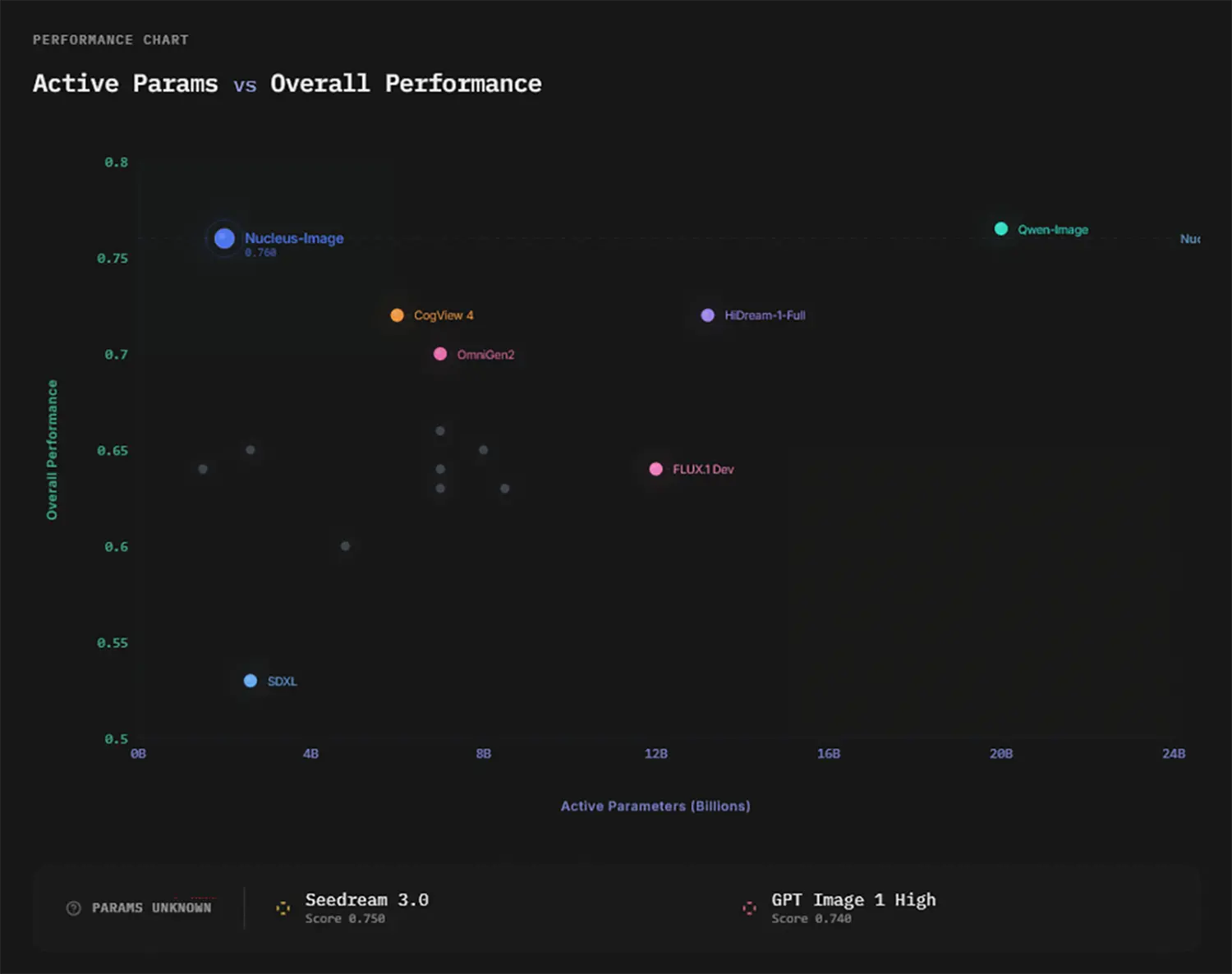

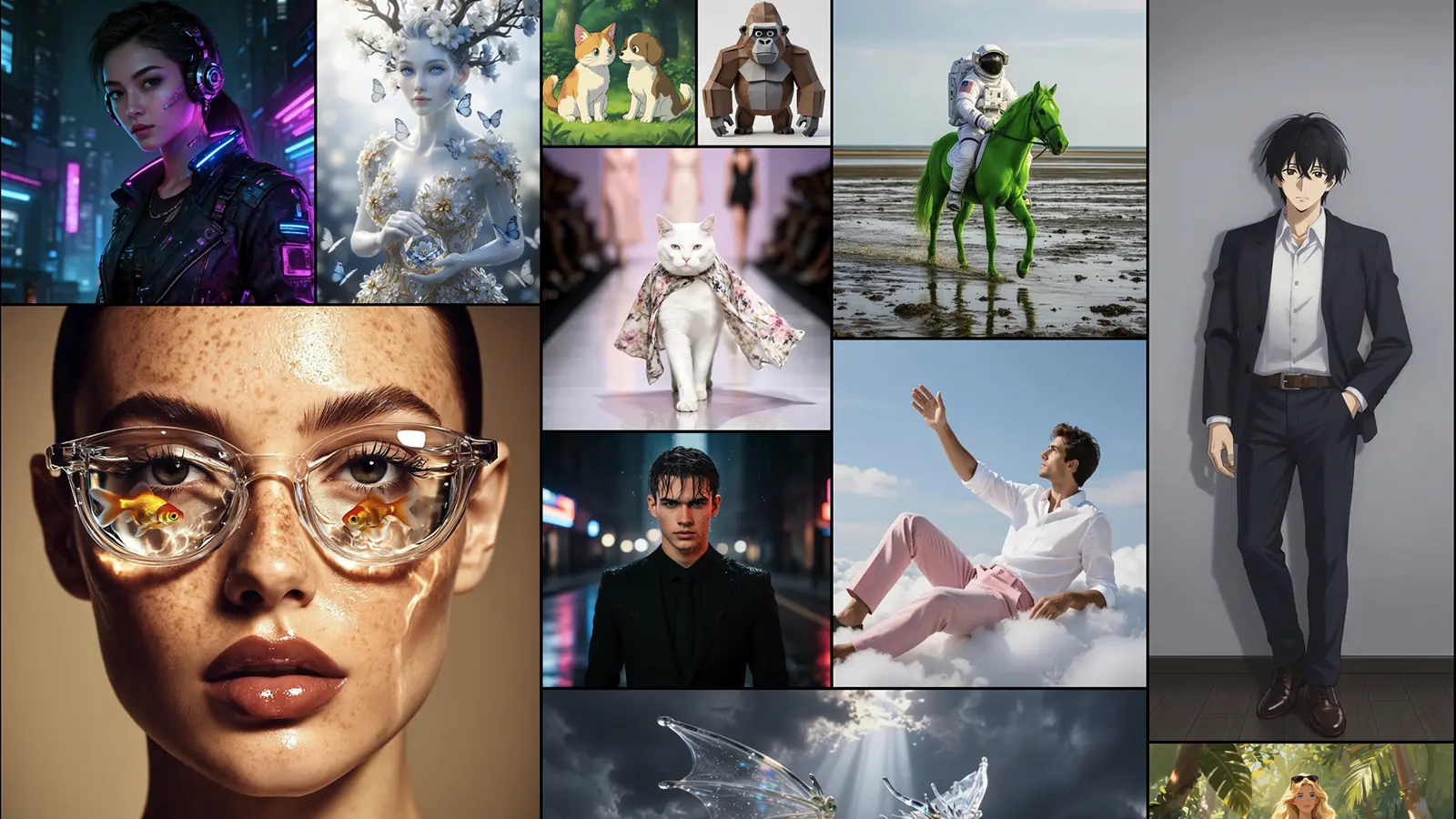

Nucleus AI veröffentlicht mit Nucleus-Image ein neues Bildgenerierungsmodell, das auf maximale Effizienz setzt. Die Architektur greift auf 17 Milliarden Parameter zurück, aktiviert für die Bilderstellung aber nur knapp zwei Milliarden. Das Open-Source-Modell erreicht in Benchmarks das Niveau kommerzieller Alternativen wie GPT Image 1.

Effizienz trifft auf Spitzenleistung

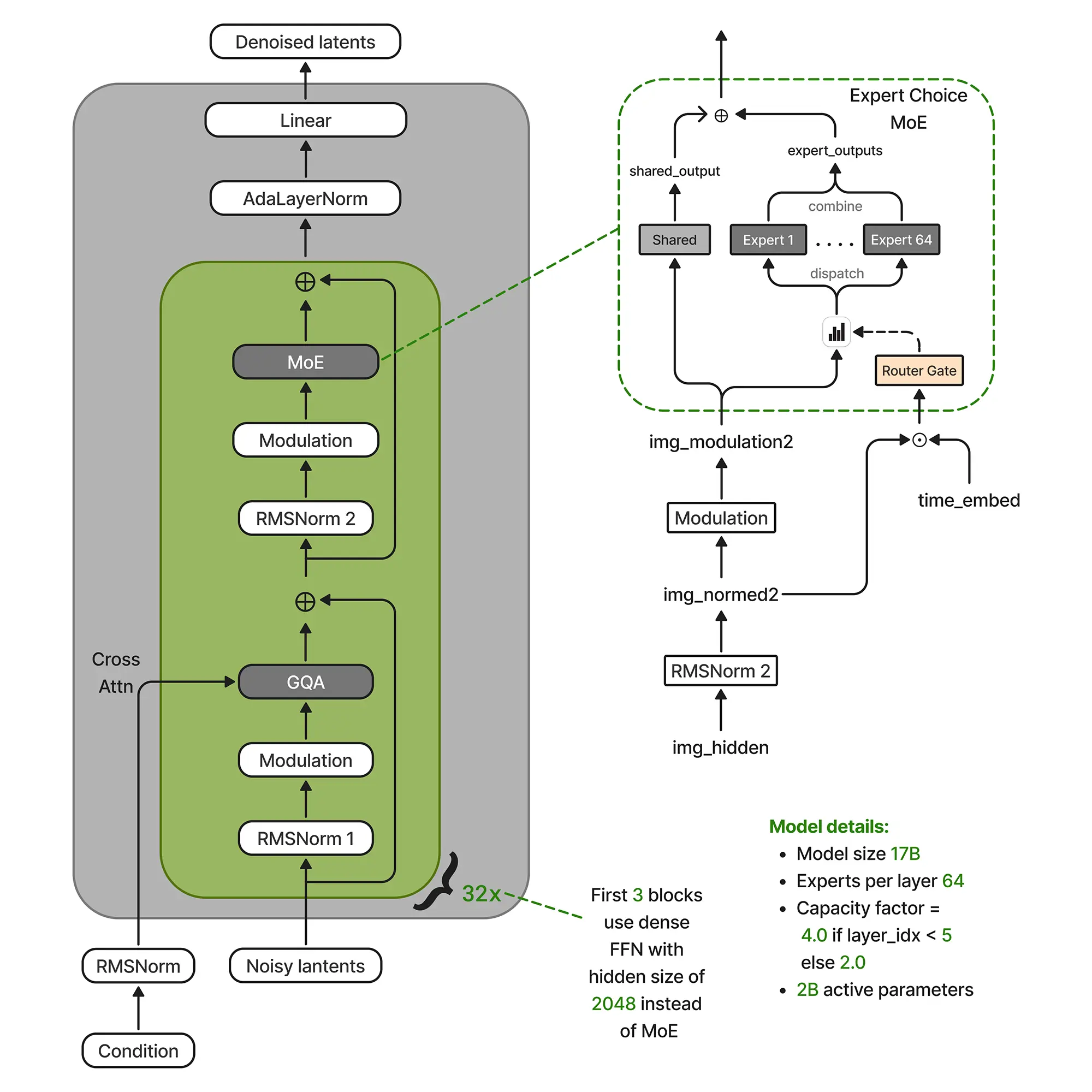

Der Kern des KI-Modells basiert auf einem Sparse-Mixture-of-Experts-Ansatz. Bisher lautete das Motto der Branche bei Bildgeneratoren oft schlicht »make the dense DiT bigger«. Diese MoE-Architektur koppelt die Modellkapazität nun vom reinen Rechenaufwand ab. Nucleus-Image verteilt seine 17 Milliarden Parameter auf 64 Experten pro Schicht, nutzt für ein Bild-Token aber nur etwa zwei davon.

Quelle: Nucleus

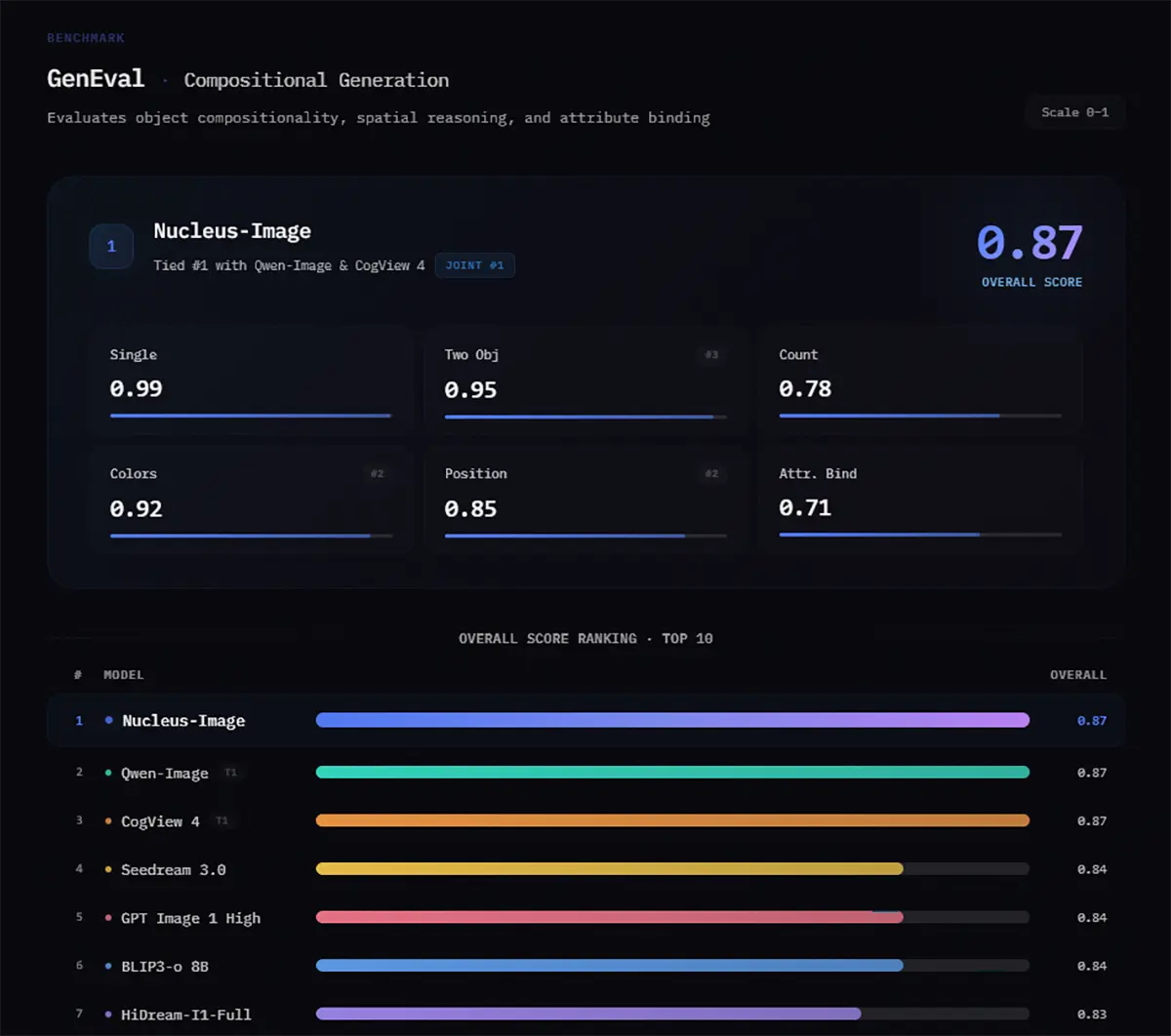

Dieser Aufbau macht das Modell äußerst ressourcenschonend. In Leistungstests positioniert sich die Entwicklung von Nucleus AI klar im Bereich der niedrigen Kosten bei gleichzeitig hoher Qualität. Auf dem GenEval-Benchmark erreicht das Modell einen Wert von 0,87. Damit zieht es mit Spitzenreitern gleich und schlägt namhafte Konkurrenten wie Imagen 4.

Quelle: Nucleus

Auch beim OneIG-Bench zeigt sich die Überlegenheit mit einem Score von 0,522. Besonders bei der korrekten räumlichen Anordnung von Objekten spielt die Architektur ihre Stärken aus. Dichte Basismodelle wie Imagen4 haben auch hier das Nachsehen.

Architektonische Anpassungen für mehr Stabilität

Eine zentrale Neuerung ist das entkoppelte Routing. Herkömmliche Diffusionsmodelle leiten Daten oft fehlerhaft weiter, was zu einer einseitigen Belastung bestimmter Experten führt. Nucleus AI trennt inhaltliche Informationen von zeitlichen Variablen. Dadurch spezialisieren sich die Experten-Netzwerke sauber auf visuelle Merkmale, anstatt zu kollabieren.

Eine weitere Optimierung betrifft die Verarbeitung der Text-Token. Diese dringen nicht in das eigentliche MoE-Backbone ein, sondern agieren lediglich als externe Referenzpunkte in den Attention-Schichten. Das erspart dem System komplexe Zuweisungsprozesse.

Dieser Schritt ermöglicht zudem ein durchgehendes Caching. Die Textinformationen berechnet das System zu Beginn nur ein einziges Mal. Sie bleiben über alle 50 Denosing-Schritte hinweg im Zwischenspeicher erhalten, was die Generierungsgeschwindigkeit spürbar erhöht.

Quelle: Nucleus

Quelloffener Zugang und weiteres Potenzial

Das Entwicklerteam trainierte das Modell mit 700 Millionen Bildern sowie 1,5 Milliarden dazugehörigen Textbeschreibungen. Für den Optimierungsprozess kam der Muon-Optimizer zum Einsatz. Auf sonst übliche, rechenintensive Methoden wie den Exponential Moving Average verzichteten die Ingenieure komplett.

Nucleus AI stellt das fertige Konstrukt unter der offenen Apache-2.0-Lizenz bereit. Interessierte finden die Gewichte und den Trainingscode frei zugänglich vor. Das KI-Modell lässt sich zudem ab sofort direkt in der Diffusers-Bibliothek von Hugging Face nutzen.

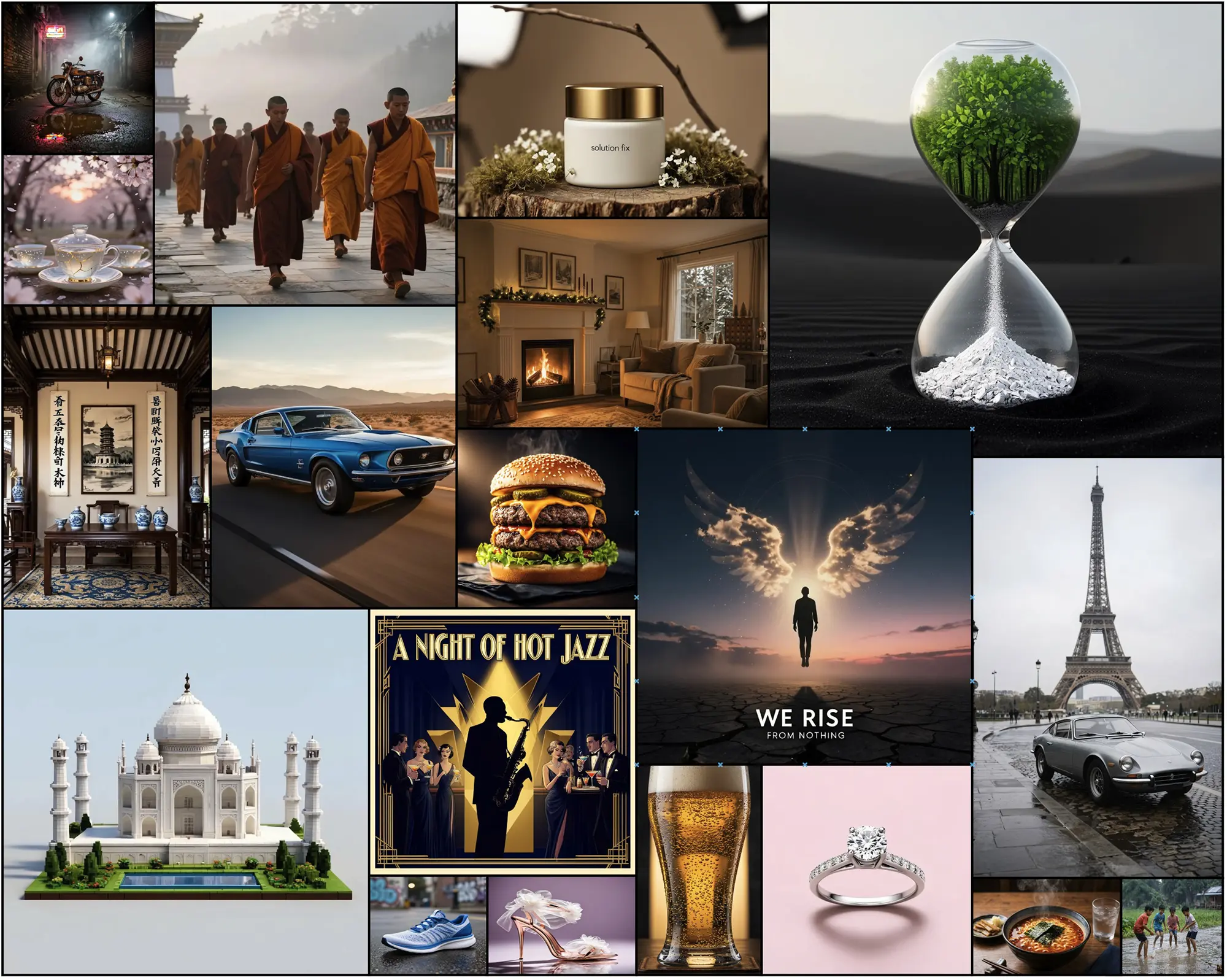

Bei dem veröffentlichten Stand handelt es sich um ein reines Basismodell. Es fand bisher kein Feintuning durch menschliches Feedback statt. Sobald die Open-Source-Community weitere Optimierungsschritte wie Preference Tuning anwendet, dürfte die Ausgabequalität nochmals messbar steigen.