Seedance 2.0 Test 2026: Verfügbarkeit, Benchmarks, Tipps

Der neue KI-Videogenerator von ByteDance deklassiert die Konkurrenz. Wir zeigen alle Funktionen und die aktuelle Verfügbarkeit.

Der Mutterkonzern von TikTok, ByteDance, bringt mit Seedance 2.0 ein neues multimodales KI-Videomodell auf den Markt, das Text, Bilder und Audio in einem einzigen Durchlauf verarbeitet. Es erzeugt cineastische Videoclips mit nativer Tonspur und übertrifft in aktuellen Benchmarks die gesamte Konkurrenz deutlich.

Aufgrund aktueller Restriktionen und der geringen internationalen Verfügbarkeit handelt es sich hierbei weniger um einen vollumfänglichen Langzeittest, sondern vielmehr um eine detaillierte Übersicht. Gleichzeitig zeigen wir, wo man Seedance 2.0 aktuell verwenden kann.

Ein ausführliches Tutorial mit vielen Beispielen und Prompts wird in Kürze separat folgen.

Update 1: Inzwischen haben die meisten Anbieter Seedance 2.0 in allen Abonnements integriert und werben zum Start mit bis zu 60 % Rabatt.

Seedance 2.0

Video-GeneratorenLeistung & Benchmarks

Klarer Sieg auf ganzer Linie

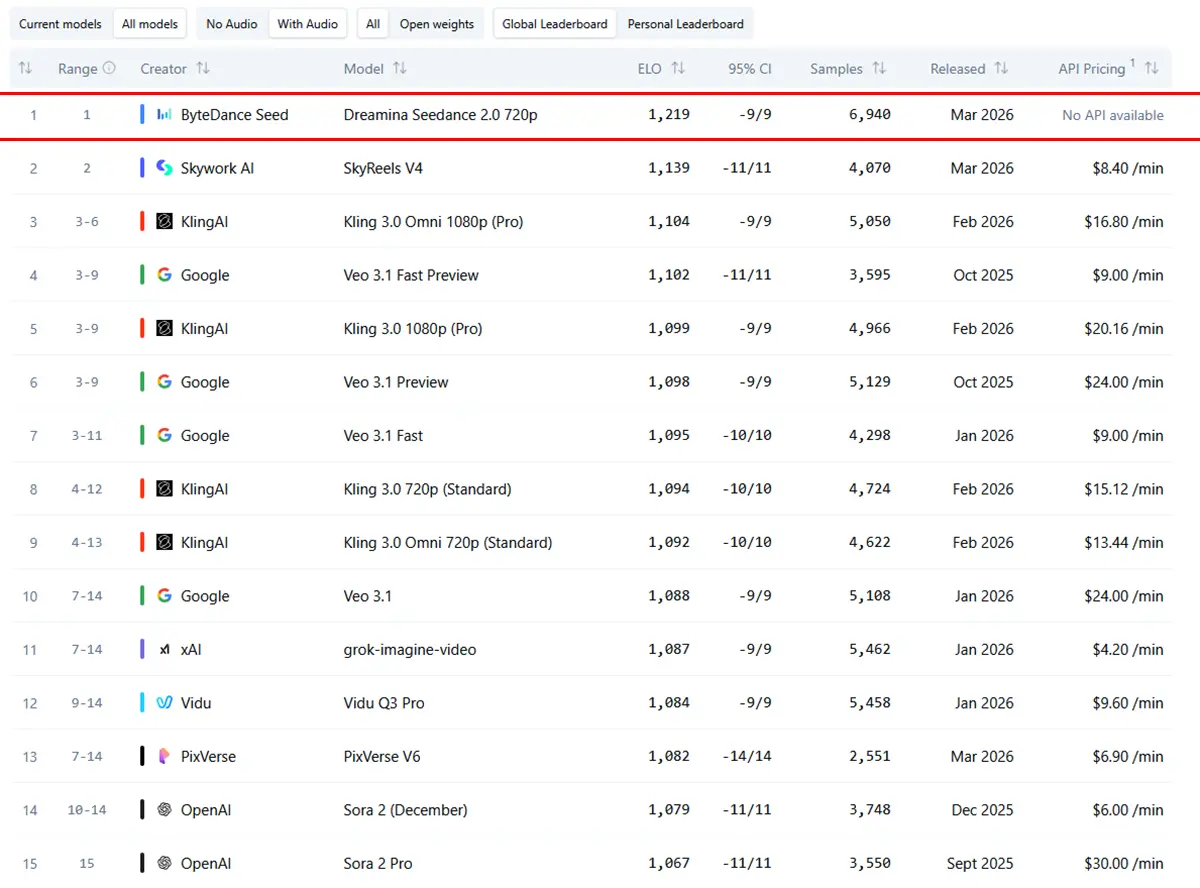

Die aktuellen Leaderboards zeichnen ein eindeutiges Bild und untermauern die Dominanz des neuen KI-Modells. In der Kategorie »Text-to-Video« (mit Audio) belegt die Variante Seedance 2.0 (720p) mit einem ELO-Wert von 1219 souverän den ersten Platz. Der Abstand zum Zweitplatzierten SkyReels V4 (1139 ELO) fällt für diese Leistungsklasse ungewöhnlich hoch aus. Selbst hochpreisige Modelle wie Kling 3.0 Omni 1080p (1104 ELO) oder Googles Veo 3.1 (1088 ELO) lässt ByteDance weit hinter sich.

Quelle: Artificialanalysis - Text to Video Benchmark

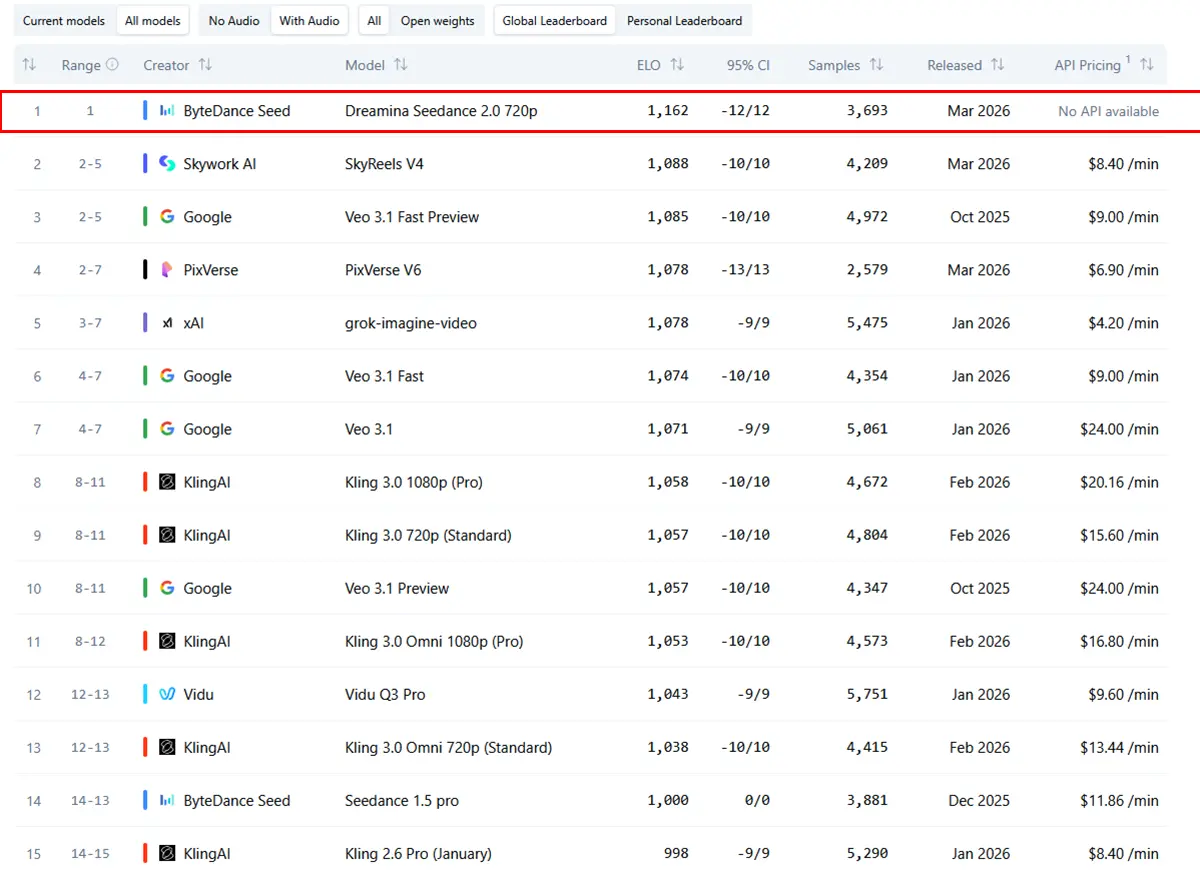

Ein identisches Bild zeigt sich bei der Disziplin »Image-to-Video«. Auch hier thront Seedance 2.0 mit 1162 ELO an der Spitze. SkyReels V4 folgt mit 1088 ELO auf dem zweiten Rang, während Googles Veo 3.1 Fast Preview knapp dahinter (1085 ELO) landet. Bemerkenswert ist dabei, dass Seedance diese Spitzenwerte bereits mit der 720p-Version erreicht und etablierte 1080p-Konkurrenten schlägt. Die Tabelle bestätigt zudem die fehlende offizielle Schnittstelle in Europa aktuell: Unter API-Pricing listet der Benchmark für Seedance klar »No API available«.

Quelle: Artificialanalysis - Image to Video Benchmark

Anbieter & Verfügbarkeit

Die Ausrollung von Seedance 2.0 hat gerade erst begonnen. Aufgrund der extrem hohen Nachfrage und der begrenzten Rechenressourcen aufseiten von ByteDance wählen fast alle Drittanbieter eine gestaffelte Strategie. Sie integrieren das Modell zunächst ausschließlich in teure Enterprise- oder Team-Abos und öffnen den Zugang erst nach und nach für günstigere Tarife.

Folgende Plattformen bieten in bestimmten Tarifen bereits Seedance 2.0 an. In welchen Tarifen das genau der Fall ist, muss aktuell vorher geprüft und verglichen werden.

Update: Seedance 2.0 ist nun vollständig bei CapCut, OpenArt und bei Higgsfield verfügbar.

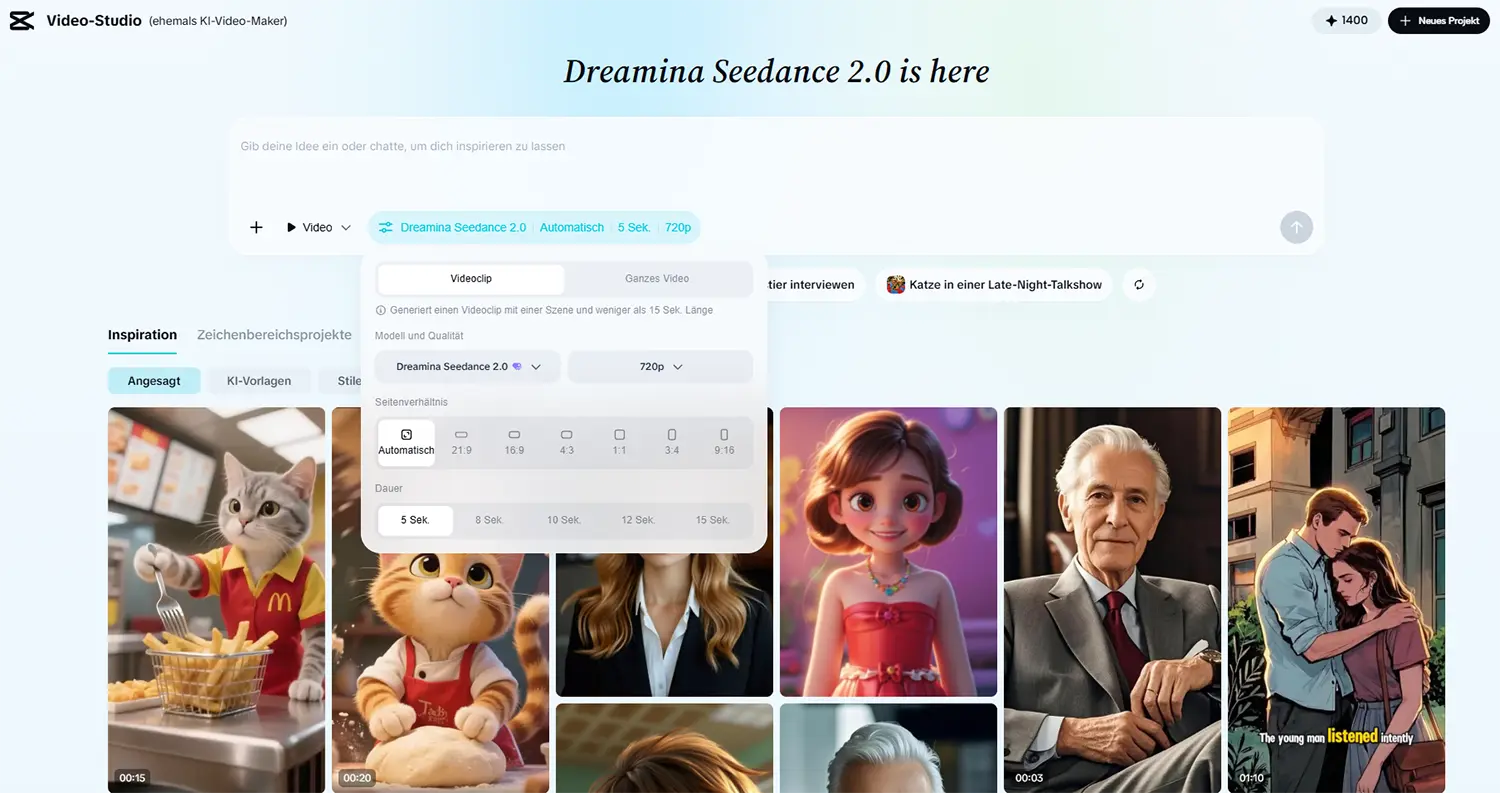

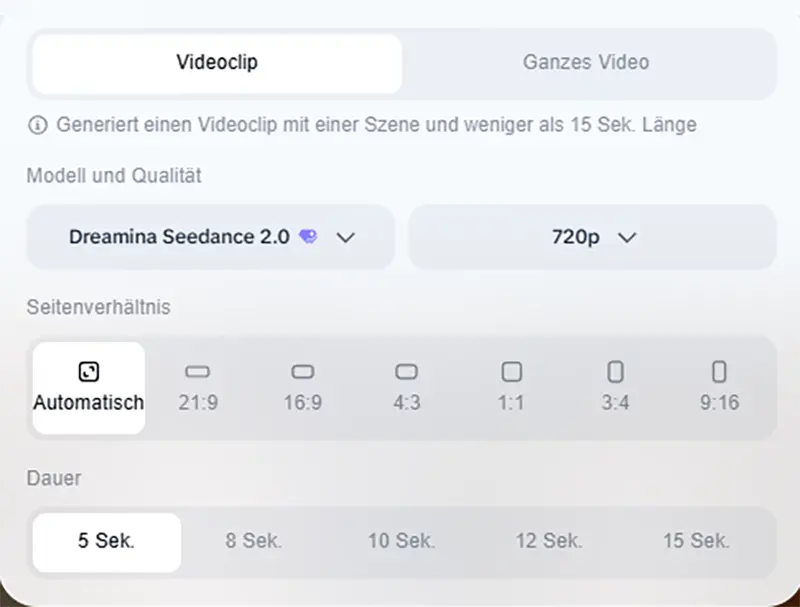

3.1 CapCut / Dreamina

Eigentlich als reines Video-Schnittprogramm bekannt, bietet das Tool nun auch direkt die Videogenerierung mit Seedance 2.0 an. Da CapCut ebenso wie Seedance 2.0 zum ByteDance-Konzern gehört, finden Anwender hier bereits eine vollständige Integration vor.

CapCut ist dabei grundsätzlich erst einmal gratis. Weitere Funktionen sichert man sich durch eine Pro-Mitgliedschaft. Diese lässt sich jedoch sieben Tage kostenlos testen. Dadurch kann man Seedance 2.0 tatsächlich völlig kostenfrei ausprobieren (Stand 06.04.26).

Wir generieren auf diesem Weg gerade viele Videos kostenlos für unser ausführliches Tutorial.

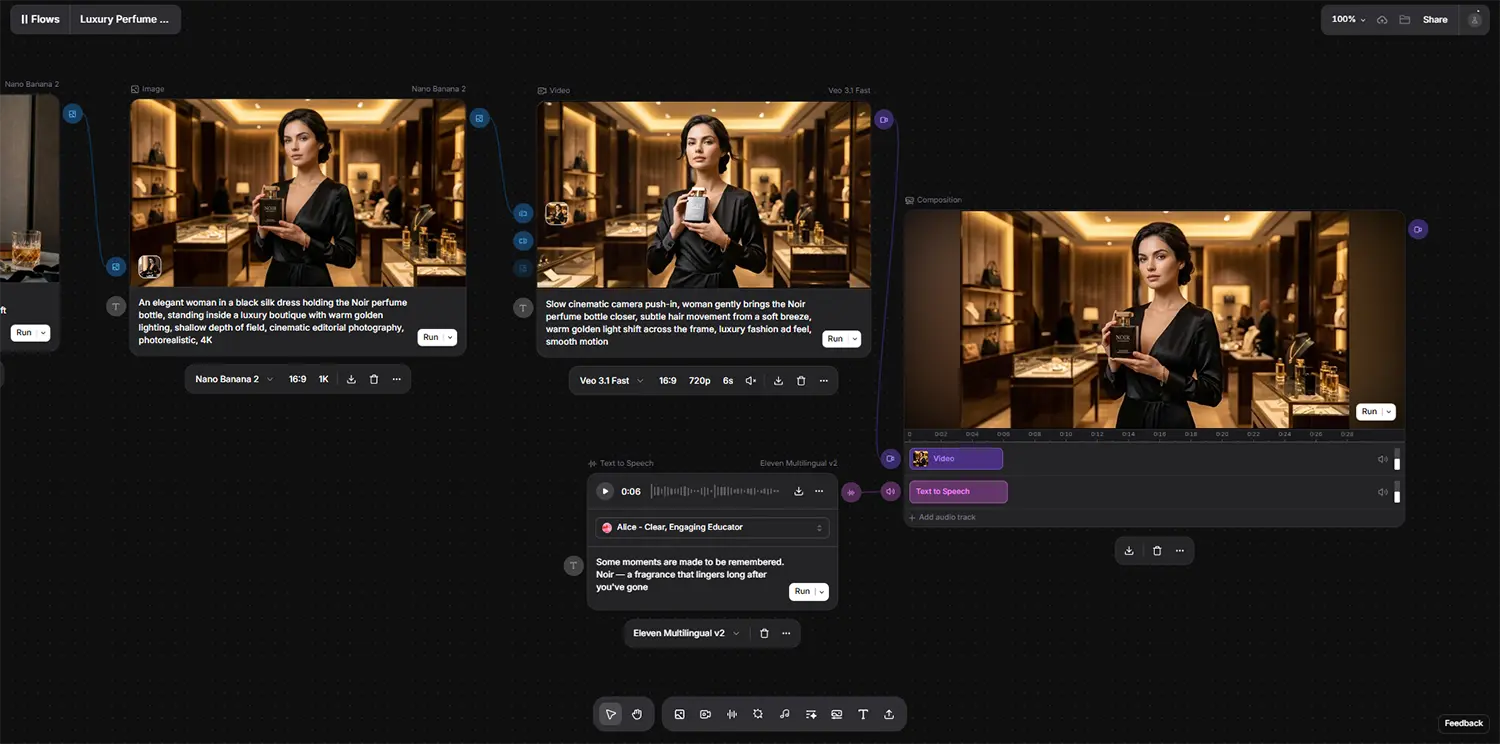

3.3 ElevenLabs

Diese Integration ist besonders interessant, wenn man den besten Videogenerator direkt mit dem besten Voicegenerator koppeln möchte. Anwender verbinden Seedance 2.0 über grafische Flows – ähnlich wie bei ComfyUI – legal und sehr simpel mit bekannten Stimmen, Standardstimmen oder einem eigenen Voice-Clone.

Ein typischer Workflow sieht so aus: Man erstellt ein Bild direkt mit Nano Banana 2, dieses Bild fließt in den Videogenerator, erzeugt ein Video und am Ende wertet ein Text-to-Speech-Modul den Clip mit dem gewünschten Text und der passenden Stimme auf. Alles funktioniert quasi mit einem Klick.

ElevenLabs hat Seedance 2.0 bereits in den ersten Business-Tarifen ausgerollt. Käufer der günstigeren Starter- und Creator-Pläne müssen jedoch noch ein paar Tage warten. Daher immer vorher kontrollieren, ob das Modell im gewünschten Abo enthalten ist.

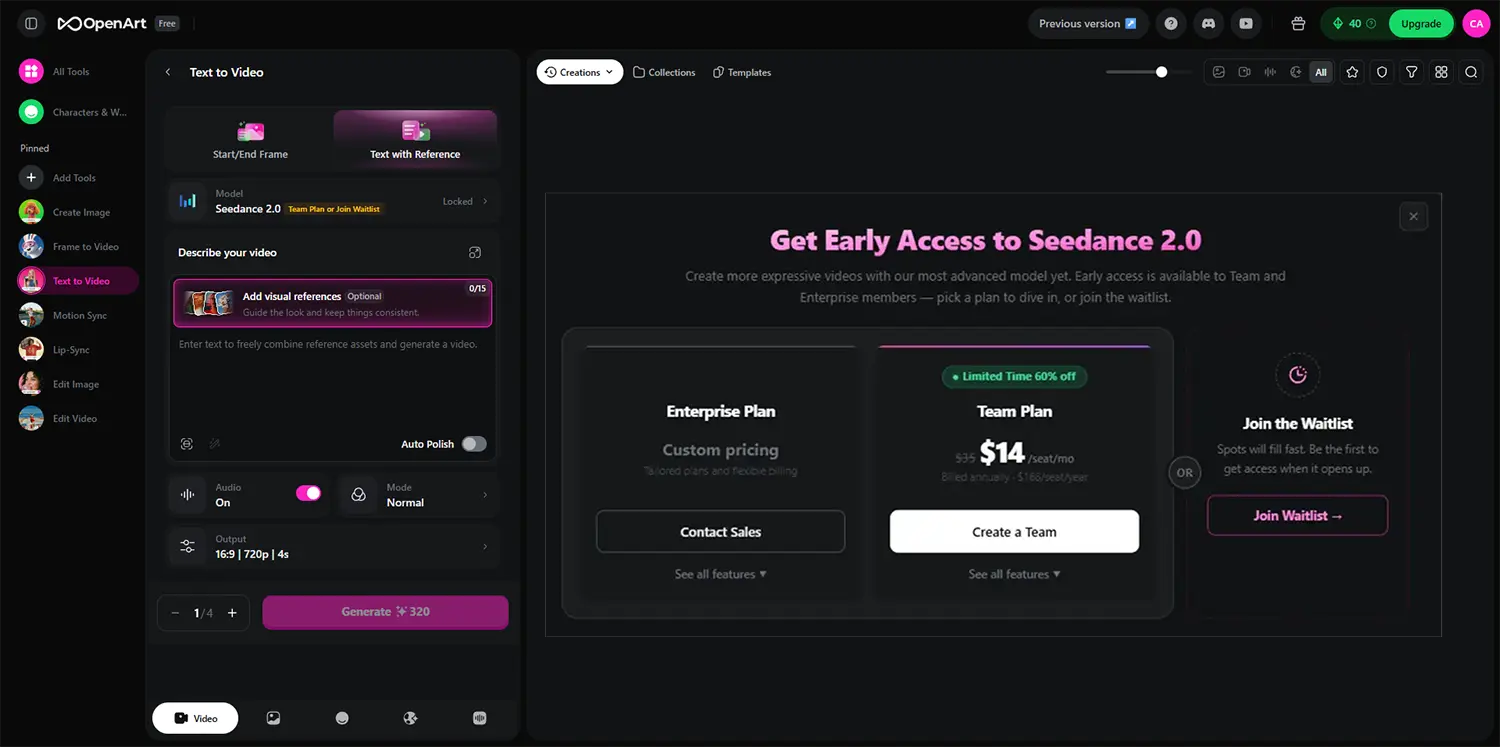

3.2 OpenArt

Die Plattform schaltet Seedance 2.0 momentan primär für Teams und Enterprise-Kunden frei. Nutzer profitieren hier vom vollen Funktionsumfang inklusive der Kombination aus Bildern, Videos und Audio. Besonders der Team-Plan fällt hier aktuell mit 60 Prozent Rabatt für Seedance 2.0 auf. Alternativ setzt man sich für die Nicht-Business-Pläne auf eine Warteliste.

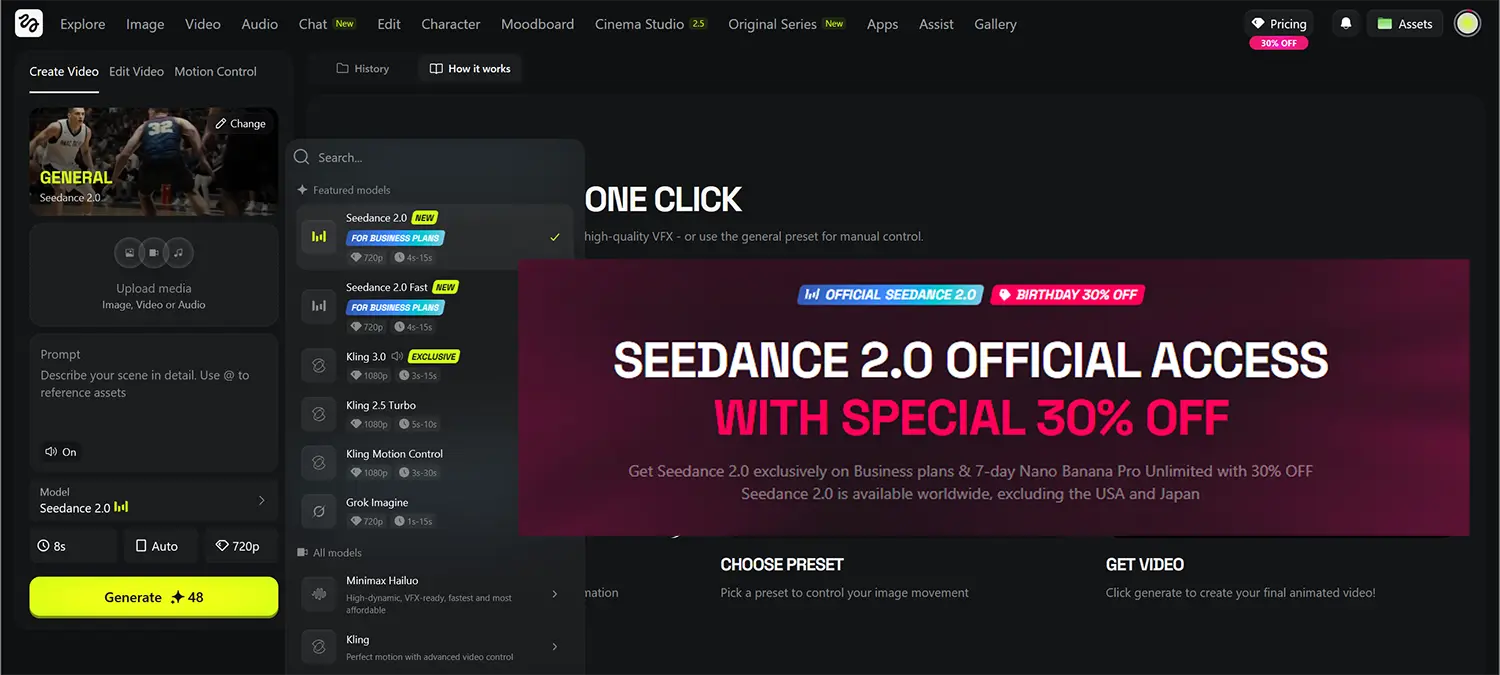

3.4 Higgsfield

Ähnlich wie bei OpenArt gibt es Seedance 2.0 hier aktuell nur im Business-Tarif. Dieser fällt jedoch deutlich teurer aus und bietet »nur« einen Rabatt von 30 Prozent. Auch hier heißt es also: Immer mal wieder die aktuellen Verfügbarkeit prüfen.

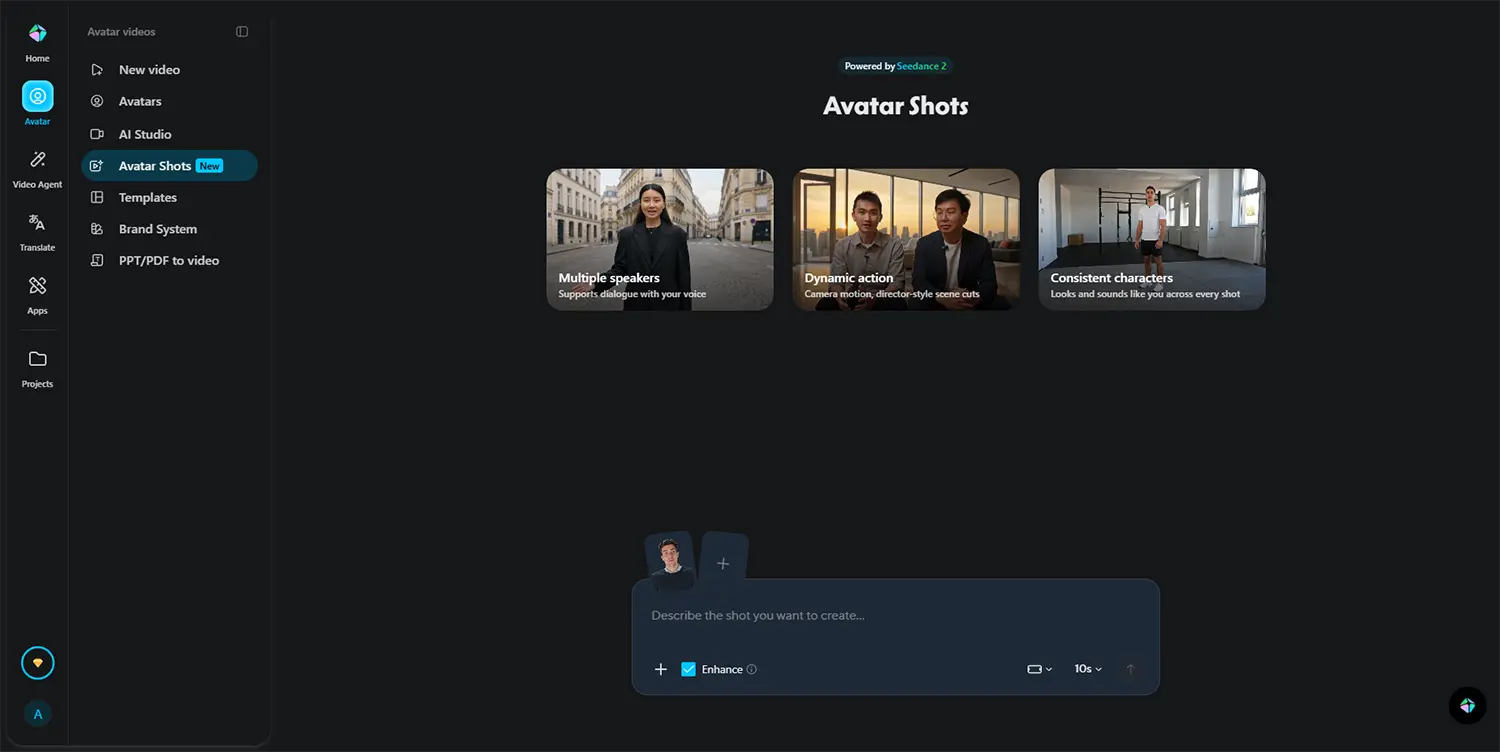

3.5 HeyGen:

Auch andere Anbieter haben den Wert von Seedance 2.0 erkannt. So hat HeyGen – eigentlich bekannt für seine Avatare – das Modell ebenfalls bereits integriert. Wer Seedance 2.0 also speziell für Werbeanzeigen beziehungsweise allgemein für Avatare verwenden möchte, sollte sich diese Option genauer ansehen.

Funktionen & Einstellungen

Seedance 2.0 bietet tiefgreifende Konfigurationsmöglichkeiten, die weit über die reine Texteingabe hinausgehen. Die offizielle Architektur verarbeitet bis zu zwölf Referenzassets pro Durchlauf: maximal neun Bilder, drei Videoclips und drei Audiodateien.

Auflösung und Formate

Aktuell bieten die meisten Anbieter eine Auflösung von 480p und 720p an. Höhere Auflösungen sind aber grundsätzlich auch möglich und werden je nach Kapazitätsauslastung bei ByteDance freigeschaltet.

Wählen kann man zwischen relativ vielen Formaten. Angefangen bei 21:9, über 16:9, 4:3, 1:1, 3:4 bis hin zu 9:16. Perfekt für alle sozialen Medien.

Cliplänge

Die Dauer der generierten Sequenzen liegt, abhängig von der gewählten Qualitätsstufe und dem Drittanbieter, typischerweise zwischen 4 und 15 Sekunden.

Das @-Referenzsystem

Ein essenzielles Werkzeug für die präzise Steuerung. Nutzer weisen den hochgeladenen Dateien über Tags wie »@image1«, »@video1« und @audio1 genaue Rollen zu. So bestimmt ein Bild das Aussehen eines Charakters, während ein verknüpftes Video die exakte Kamerafahrt für die Szene vorgibt.

Reference @image1 shows a gangster with gleaming eyes and brutal armor; @video1 shows a fast-paced cinematic action sequence; @audio1 features a deep, menacing German voice; @audio2 features the fitting, epic music.

Audio-Synchronisation

Die KI berechnet den Ton nicht nachträglich, sondern parallel zum Bild. Lippensynchronität bei Sprache sowie physikalisch korrekte Soundeffekte bei Kollisionen funktionieren dadurch ohne manuelle Nachbearbeitung im Schnittprogramm.

Dabei werden folgende Sprachen nativ unterstützt:

- Englisch

- Deutsch

- Spanisch

- Französisch

- Japanisch

- Koreanisch

- Mandarin

Vorteile & Nachteile

- Belegt Platz 1 in Benchmarks für Text-to-Video und Image-to-Video mit großem Vorsprung.

- Erzeugt Bild und Ton völlig synchron in einem einzigen Schritt

- Ermöglicht durch das komplexe Referenzsystem eine enorme kreative Kontrolle

- Liefert äußerst flüssige und physikalisch plausible Bewegungsabläufe

- Der öffentliche Zugang ist außerhalb Chinas derzeit stark limitiert

- Es existiert vorerst keine direkte, offiziell zugängliche Web-API für westliche Märkte

- Die hohe Nachfrage führt zu Ressourcenknappheit bei den Drittanbietern.

- Viele Anbieter beschränken die maximale Auflösung künstlich auf 720p

Größter Vorteil

Seedance 2.0 verarbeitet Audio- und Videodaten nicht mehr getrennt, sondern greift auf einen dualen Architektur-Ansatz zurück. Diese Struktur sorgt dafür, dass physikalische Eigenschaften wie Schwerkraft oder Kollisionen mit den erzeugten Soundeffekten exakt übereinstimmen.

Zudem sticht das explizite Referenz-Tagging hervor. Anwender weisen hochgeladenen Dateien über Tags wie »@image1« genaue Rollen zu, um etwa das Aussehen einer Figur oder den Rhythmus eines Beats zu definieren. So kann man z.B. längere konstante Musikvideos erstellen lassen, wo jeder Beat zur Szene passt.

Größter Nachteil

Der Zugang zu Seedance 2.0 läuft aktuell noch sehr zögerlich an. Da das KI-Modell qualitativ weit vor der Konkurrenz liegt, werden die Rechenkapazitäten auch in den kommenden Wochen kaum ausreichen, um die hohe Nachfrage zu decken.

Anwender müssen die jeweiligen Anbieter und deren Abonnements daher genau prüfen. In der Praxis lohnt es sich, flexibel auf mehrere Plattformen auszuweichen. Außerhalb Chinas genießt die direkte Integration in CapCut derzeit die höchste Priorität.

Coole Usecases

Inkonsistente KI-Influencer

Digitale Avatare kämpfen oft mit einem eklatanten Identitätsproblem: Sie verändern von Clip zu Clip ihr exaktes Aussehen und klingen bei jedem Video anders.

Seedance 2.0 trifft ElevenLabs

Dank des präzisen Referenz-Systems reicht ein einziges Ausgangsbild, um eine optisch völlig konstante Persona zu generieren. Verknüpft man diesen visuellen Workflow direkt mit einer festen KI-Stimme von ElevenLabs, entsteht in Rekordzeit ein durchgehender digitaler Influencer mit hohem Wiedererkennungswert und perfekter Lippensynchronität.

Komplexe TikTok-Trends nachbilden

Virale Tanzchoreografien lassen sich über reine Textbefehle kaum akkurat beschreiben. Das Resultat sind oft generische Clips ohne echten Bezug zum aktuellen Trend.

Seedance 2.0 plus Referenzvideo

Das Modell erlaubt den Upload bestehender Clips als direkte Bewegungsreferenz. Anwender speisen einfach ein virales TikTok-Video in das System ein und übertragen die exakte Choreografie auf den eigenen KI-Influencer. So partizipiert man mühelos und punktgenau an aktuellen Social-Media-Trends.

Schwache Physik bei Gaming-Cinematics

Bisherige Videogeneratoren scheitern regelmäßig an rasanten Action-Sequenzen, da sie fundamentale Konzepte wie Schwerkraft, Kollisionen oder Geschwindigkeiten physikalisch inkorrekt darstellen.

Seedance 2.0 und tiefes Weltwissen

Die Architektur des neuen Modells berücksichtigt physikalische Gesetzmäßigkeiten nativ. Zudem greift die KI auf ein breites Verständnis populärer Spiele zurück. Anwender werten dadurch existierendes Gameplay-Material nahtlos auf oder erschaffen völlig neue, in der Game-Engine eigentlich unmögliche Kamerafahrten und Szenenabläufe.

Quelle: X @EHuanglu

Alternativen & Vergleich

Der Markt für Videogeneratoren entwickelt sich derzeit rasant, vergleichbar mit dem vorherigen Aufschwung der Bildgeneratoren. Unternehmen wie Google und OpenAI dominierten lange Zeit das Feld und liefern weiterhin starke Ergebnisse. Gleichzeitig punkten chinesische Modelle wie Kling oder Wan traditionell durch attraktive preisliche Konditionen.

Dennoch eint all diese Anbieter eine Tatsache: Sie erreichen aktuell nicht das Qualitätsniveau von Seedance 2.0.

Veo 3.1 (Google)

SeriösDas KI-Modell von Google erzeugt äußerst realistische Resultate und glänzt durch eine tiefe Integration in das hauseigene Ökosystem. Es arbeitet extrem verlässlich, fordert jedoch häufig höhere Kosten bei der API-Nutzung. Insgesamt betrachtet positioniert sich Veo 3.1 aber als die stärkste und zuverlässigste Alternative direkt hinter Seedance 2.0. Zudem erhoffen wir hier das nächste große Update für Videogeneratoren.

Kling 3.0

Günstig & GutDieses chinesische Modell öffnete sich bereits früh für den internationalen Markt. Es sammelt Pluspunkte durch eine hervorragende Bedienbarkeit. Bei der physikalischen Genauigkeit der Bildabläufe bleibt es jedoch spürbar hinter den Bestwerten des aktuellen Spitzenreiters zurück.

Sora (OpenAI)

AuslaufmodellDer Pionier für lange Videosequenzen generiert weiterhin beeindruckende Kamerafahrten. Im direkten Vergleich kämpft das KI-Modell jedoch häufiger mit leichten physikalischen Logikfehlern. Da OpenAI das Projekt intern eingestellt hat, erhalten Anwender hier künftig keine funktionalen Updates mehr.

Anbieter Informationen

Wer steckt dahinter?

Hinter ByteDance steht maßgeblich der Softwareentwickler und Unternehmer Zhang Yiming, der den Konzern 2012 gemeinsam mit seinem Studienfreund Liang Rubo gründete. Ursprünglich mit Nachrichten-Aggregatoren gestartet, gelang dem Team mit den Kurzvideo-Plattformen Douyin und dem internationalen Ableger TikTok der weltweite Durchbruch. Innerhalb des Konzerns treibt heute das spezialisierte Seed-Team die multimodalen KI-Entwicklungen und Modelle wie Seedance 2.0 voran.

Einschätzung

ByteDance gilt als eines der wertvollsten nicht börsennotierten Technologieunternehmen der Welt. Namhafte institutionelle Geldgeber wie Sequoia Capital China, SoftBank und General Atlantic stecken immense Summen in den Konzern.

Das enorme Kapital und die gigantischen Datensätze aus den hauseigenen Plattformen wie TikTok und der Schnittsoftware CapCut verschaffen ByteDance einen gewaltigen strukturellen Vorteil beim Training hochkomplexer KI-Modelle. Diese Marktmacht garantiert eine zügige technische Weiterentwicklung, auch wenn die globale Ausrollung einzelner Produkte – wie aktuell bei Seedance 2.0 – durch urheberrechtliche und regulatorische Prüfungen in westlichen Märkten oft pausiert oder verlangsamt wird.

Fazit & Bewertung

Das All-AI Urteil

Seedance 2.0 setzt aktuell den unangefochtenen Goldstandard für KI-Videogenerierung und verweist die Konkurrenz in den Benchmarks auf die hinteren Plätze.

Die Bildqualität und die nahtlose Audio-Integration sind herausragend, doch die begrenzte internationale Verfügbarkeit trübt das Gesamtbild spürbar. Wer Zugang über CapCut oder Premium-Dienste wie OpenArt ergattert, erhält ein unvergleichlich starken Videogenerator.

FAQ - die wichtigsten Fragen

Hier versuchen wir, die wichtigsten und häufigsten Fragen zu „Seedance 2.0” zu beantworten. Sollte noch etwas unklar sein, könnt ihr uns gerne per E-Mail oder über die sozialen Medien kontaktieren.