OpenAI reagiert: ChatGPT-Indexierungsfunktion zurückgezogen

OpenAI stoppt Suchmaschinenfreigabe für geteilte Chats – doch ist der Schaden für Nutzer und Vertrauen schon da?

gpt-image-1 | All-AI.de

EINLEITUNG

Eine Funktion, mit der ChatGPT-Nutzer ihre Gespräche gezielt über Google auffindbar machen konnten, wurde über Nacht deaktiviert. Auslöser war ein Zwischenfall, bei dem plötzlich zehntausende vermeintlich private Konversationen über die Google-Suche sichtbar wurden. Wie kam es dazu – und welche Konsequenzen ergeben sich daraus für Nutzer und Anbieter?

NEWS

Was schiefgelaufen ist

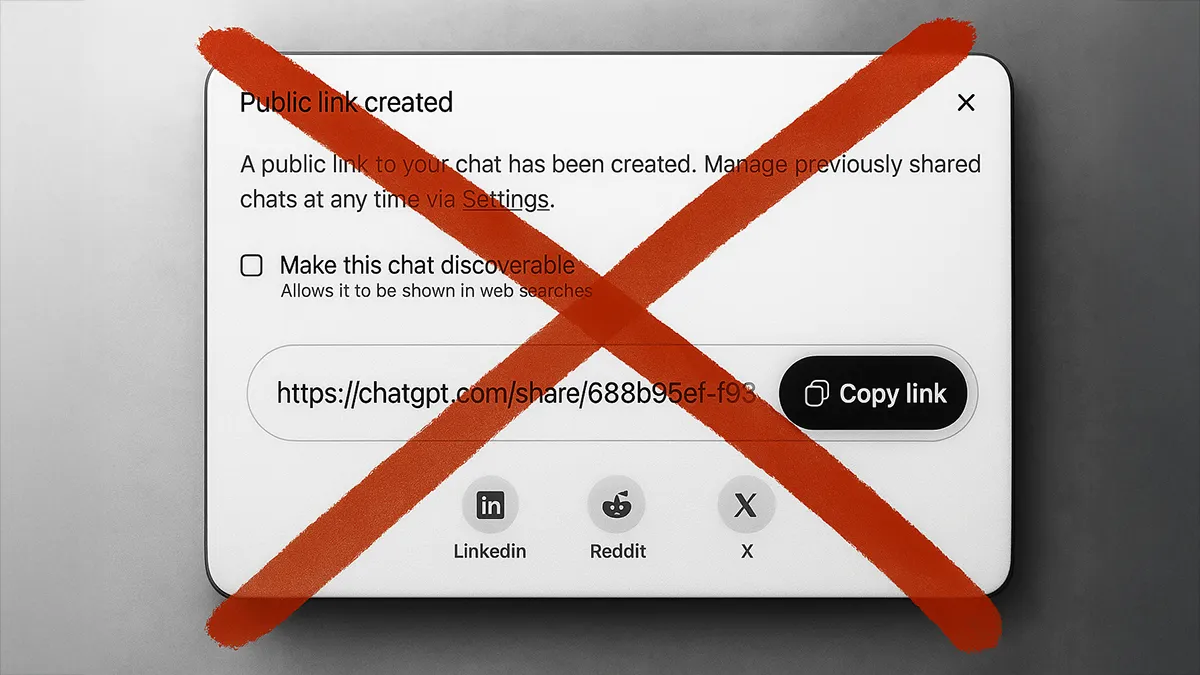

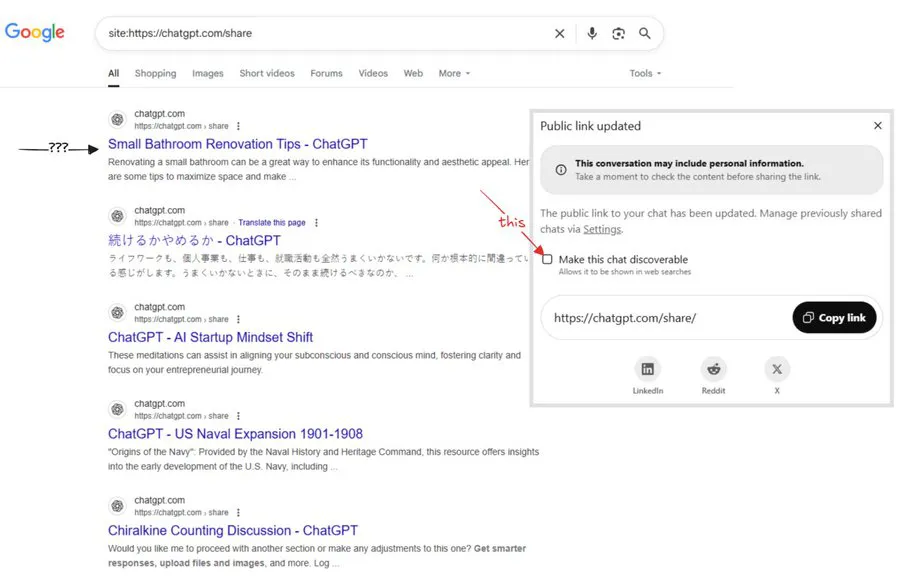

Die betroffene Funktion ermöglichte es, geteilte Chat-Links für Suchmaschinen freizugeben. Wer beim Teilen einen zusätzlichen Haken setzte, sorgte dafür, dass die Inhalte indexiert wurden. Viele Nutzer unterschätzten offenbar, was das bedeutet. Über einfache Suchbefehle ließen sich plötzlich intime Gespräche finden – inklusive sensibler Informationen wie Gesundheitsfragen, beruflicher Details oder Familienangelegenheiten.

OpenAI sprach von einem Experiment, das eigentlich gut dokumentiert gewesen sei. Doch die Realität zeigte: Viele klickten aus Versehen oder ohne volles Verständnis der Funktion. In einer Zeit, in der KI immer stärker in den Alltag integriert wird, offenbart sich hier ein grundlegendes Problem – nämlich die Kluft zwischen technischer Machbarkeit und nutzerseitigem Bewusstsein.

Schnelles Handeln – aber nicht schnell genug

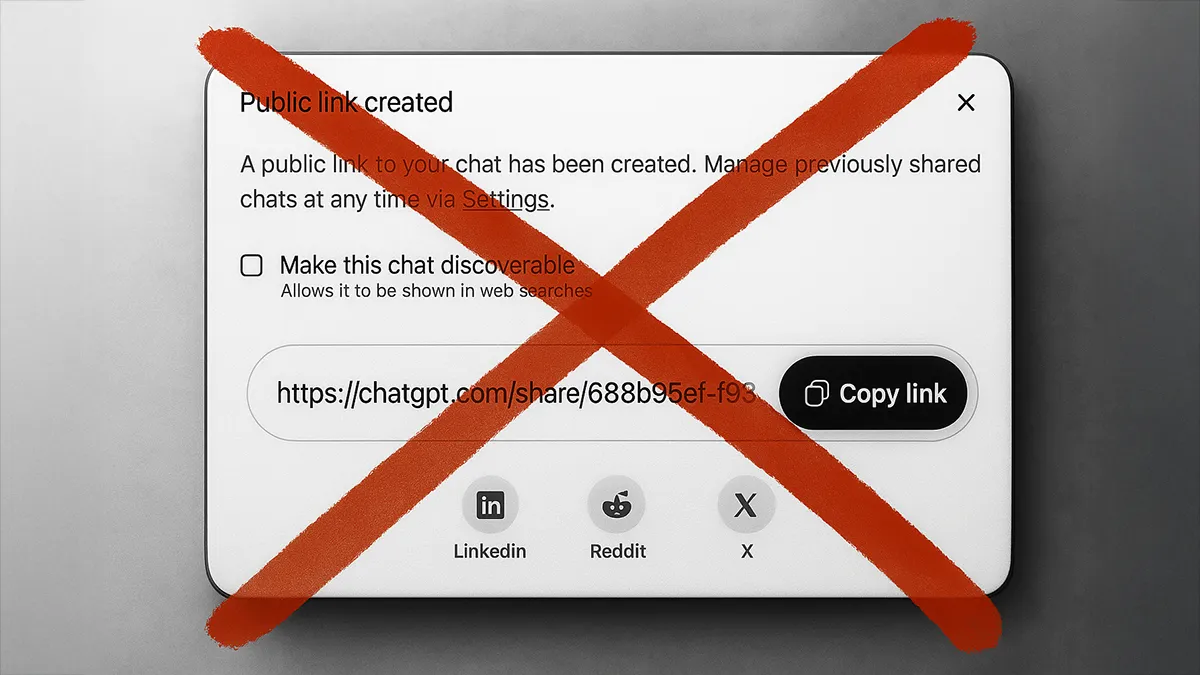

OpenAI reagierte zügig und kündigte an, das Feature vollständig zu entfernen. Laut internen Angaben sei die Option zu fehleranfällig gewesen. Parallel startete man die Zusammenarbeit mit Suchmaschinenbetreibern, um bereits gelistete Inhalte aus dem Index zu löschen oder unbrauchbar zu machen.

Trotz der schnellen Reaktion bleibt ein fader Beigeschmack: Für viele war es bereits zu spät. Die Gespräche waren öffentlich zugänglich, archiviert und teilweise verbreitet worden. Der Vorfall zeigt, wie sensibel Schnittstellen zwischen öffentlichem und privatem Raum gestaltet werden müssen – besonders wenn es um KI-Anwendungen geht, die persönliche Daten verarbeiten.

Cookies aktivieren um den Inhalt zu sehen:

We just removed a feature from @ChatGPTapp that allowed users to make their conversations discoverable by search engines, such as Google. This was a short-lived experiment to help people discover useful conversations. This feature required users to opt-in, first by picking a chat… pic.twitter.com/mGI3lF05Ua

— DANΞ (@cryps1s) July 31, 2025

Ein UI-Klick mit großen Folgen

Besonders kritisch wurde das Design der Benutzeroberfläche gesehen. Zwar war das Freischalten der Suchmaschinenfunktion optional, doch ein einfacher Haken reichte – ohne zusätzliche Sicherheitsabfrage oder Warnhinweise. Der Vorfall zeigt, wie UI-Design Datenschutz konkret beeinflussen kann.

Auch wenn die Chats technisch anonymisiert waren, ließen sich durch Kontextinformationen wie Vornamen, Orte oder Berufsangaben Rückschlüsse auf reale Personen ziehen. Das Risiko bestand also nicht nur theoretisch, sondern in vielen Fällen ganz praktisch.

Quelle: @wavefnx

Vertrauen als Währung im KI-Zeitalter

Dass nicht nur OpenAI, sondern auch andere Anbieter wie Google oder Meta in ähnliche Vorfälle verwickelt waren, unterstreicht das Grundproblem. Transparenz und Kontrolle sind essenziell – nicht nur für Unternehmen, sondern vor allem für Nutzer, die mit KI-Systemen interagieren.

Ein Leak wie dieser beschädigt Vertrauen nachhaltig. Auch wenn OpenAI betont, dass Enterprise-Nutzer nicht betroffen waren, bleibt ein mulmiges Gefühl. Wer ChatGPT im beruflichen Kontext nutzt, muss sich verstärkt mit Governance, Rechteverwaltung und Datenhygiene beschäftigen.

Feature-Idee mit Denkfehler

Die Idee hinter der Funktion war nachvollziehbar: Wissen öffentlich machen, Erfahrungen teilen, andere profitieren lassen. Doch der Schutz persönlicher Inhalte wurde nicht mitgedacht. Eine zu einfache Bedienung führte dazu, dass viele ihre Daten ungewollt preisgaben.

OpenAI hat daraus Konsequenzen gezogen. Und wir als Nutzer? Sollten uns künftig genauer anschauen, welche Häkchen wir setzen – besonders dann, wenn es um KI-Systeme mit Zugriff auf unsere Gespräche geht.

DEIN VORTEIL - DEINE HILFE

KURZFASSUNG

- Eine OpenAI-Funktion ermöglichte die Indexierung geteilten ChatGPT-Gespräche durch Google und andere Suchmaschinen.

- Viele Nutzer waren sich der öffentlichen Sichtbarkeit ihrer Inhalte nicht bewusst – persönliche Daten wurden auffindbar.

- OpenAI zog das Feature schnell zurück, arbeitet aber noch an der Entfernung bereits indexierter Inhalte.

- Das Ereignis zeigt, wie wichtig klare UX und Datenschutzintegration bei KI-Funktionen sind.