Qwen 3.5 Small überrascht im Benchmark-Vergleich

Die 9B-Variante der neuen Qwen Serie deklassiert kompakte Modelle von Google und OpenAI. Sie lässt sich unkompliziert lokal nutzen.

Alibaba bringt mit der Qwen 3.5 Small Model Series eine neue Generation nativ multimodaler Open-Weight-Modelle heraus. Die kompakten KI-Systeme umfassen Größen von 0,8 bis 9 Milliarden Parametern und liefern starke Rechenleistung direkt auf handelsüblichen Computern.

Hohe Effizienz abseits der Cloud

Die Entwickler richten sich mit der neuen Serie gezielt an Anwender, die Künstliche Intelligenz privat und lokal auf dem eigenen Gerät betreiben möchten. Um verschiedene Hardware-Leistungsklassen abzudecken, erscheint die Modellreihe in vier exakten Abstufungen: 0.8B, 2B, 4B sowie 9B. Da Alibaba die Gewichte als Open-Weight zur Verfügung stellt, laden sich Interessierte die Dateien einfach herunter und starten sie direkt in eigenen Systemumgebungen.

Zusätzlich punkten die Modelle mit nativer Multimodalität. Die Systeme verstehen und verarbeiten Bilder, Videos und Text von Grund auf gemeinsam. Diese technische Basis macht die Interaktion auf dem Endgerät deutlich flexibler.

Anzeige

Starke Leistung im Benchmark-Vergleich

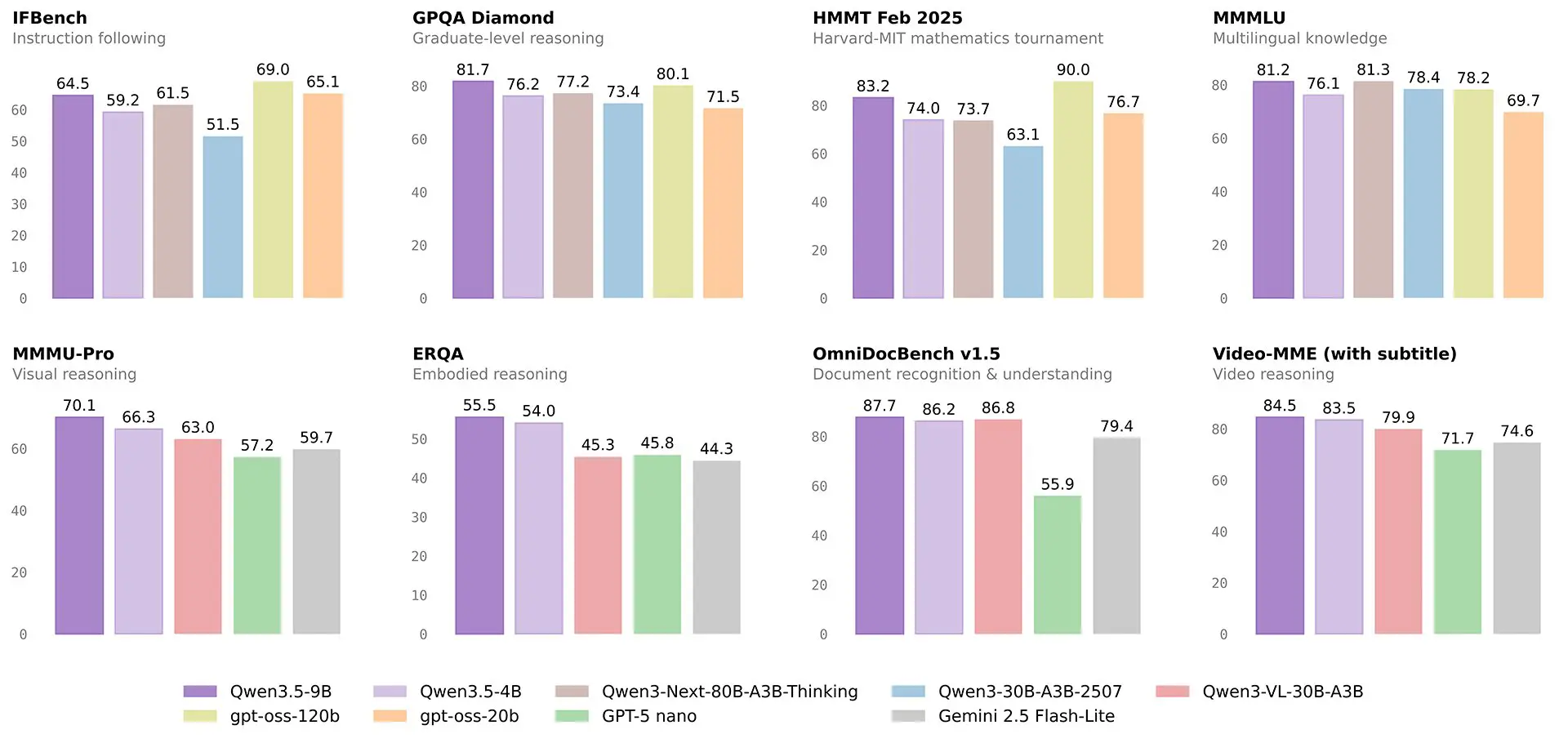

In den offiziellen Benchmarks zeigt sich das wahre Potenzial der neuen Modellreihe. Das größte Modell der Serie, Qwen3.5-9B, erzielt bei komplexen Logikaufgaben auf akademischem Niveau überraschend hohe Werte. Im Test "GPQA Diamond" erreicht es 81,7 Punkte und übertrifft damit sogar das wesentlich größere gpt-oss-120b-Modell von OpenAI. Auch bei mathematischen Herausforderungen und beim Abrufen von mehrsprachigem Wissen liefert die kompakte KI Ergebnisse, die sonst nur große Cloud-Systeme erreichen.

Besonders bei der Bild- und Videoverarbeitung demonstriert Alibaba die Stärken der Architektur. Im "MMMU-Pro" Test für visuelle Logik sowie beim "Video-MME" Benchmark schlägt das Qwen3.5-9B Modell die direkte Konkurrenz für mobile Endgeräte deutlich. Kompakte Alternativen wie GPT-5 nano von OpenAI oder Gemini 2.5 Flash-Lite von Google landen in diesen Kategorien mit deutlichem Abstand auf den hinteren Plätzen.

Selbst die kleinere 4B-Variante verzeichnet in den Tests beachtliche Erfolge. Sie platziert sich bei fast allen visuellen und textbasierten Herausforderungen noch souverän vor den kleinen Versionen von Google und OpenAI. Die Entwickler zeigen damit, dass ein optimiertes Training auch bei wenigen Parametern zu äußerst fähigen Modellen führt.

Quelle: Alibaba

Geringer Speicherbedarf trifft auf logische Grenzen

Der entscheidende Vorteil der Small Model Series liegt in den sehr niedrigen Hardware-Anforderungen, konkret beim Grafikspeicher. Das kompakte 0.8B-Modell kommt in einer quantisierten Fassung bereits mit rund zwei Gigabyte VRAM aus, wodurch es selbst auf älteren Office-Notebooks flüssig arbeitet. Die mittlere Variante mit vier Milliarden Parametern beansprucht etwa sechs Gigabyte VRAM. Wer die maximale Leistung des 9B-Modells abrufen möchte, sollte auf seinem System acht bis zwölf Gigabyte VRAM bereithalten.

Trotz der starken Testergebnisse bringen die kompakten Architekturen naturgemäß auch Nachteile mit sich. Aufgrund der geringen Parameterzahl speichern die Modelle weitaus weniger tiefgreifendes Faktenwissen als riesige Cloud-Alternativen. Bei sehr spezifischen Fachfragen erfinden sie daher schneller fehlerhafte Antworten. Für das rasche Zusammenfassen von Texten, Übersetzungen oder die Analyse von privaten Dokumenten bieten sie jedoch eine verlässliche Lösung. Die neuen Systeme stehen ab sofort über gängige Entwicklerplattformen zum Download bereit.