OpenAIs Katastrophen-Warnung an die Welt

Warum die KI-Firma jetzt globale Regeln fordert und welche Durchbrüche schon 2026 bevorstehen.

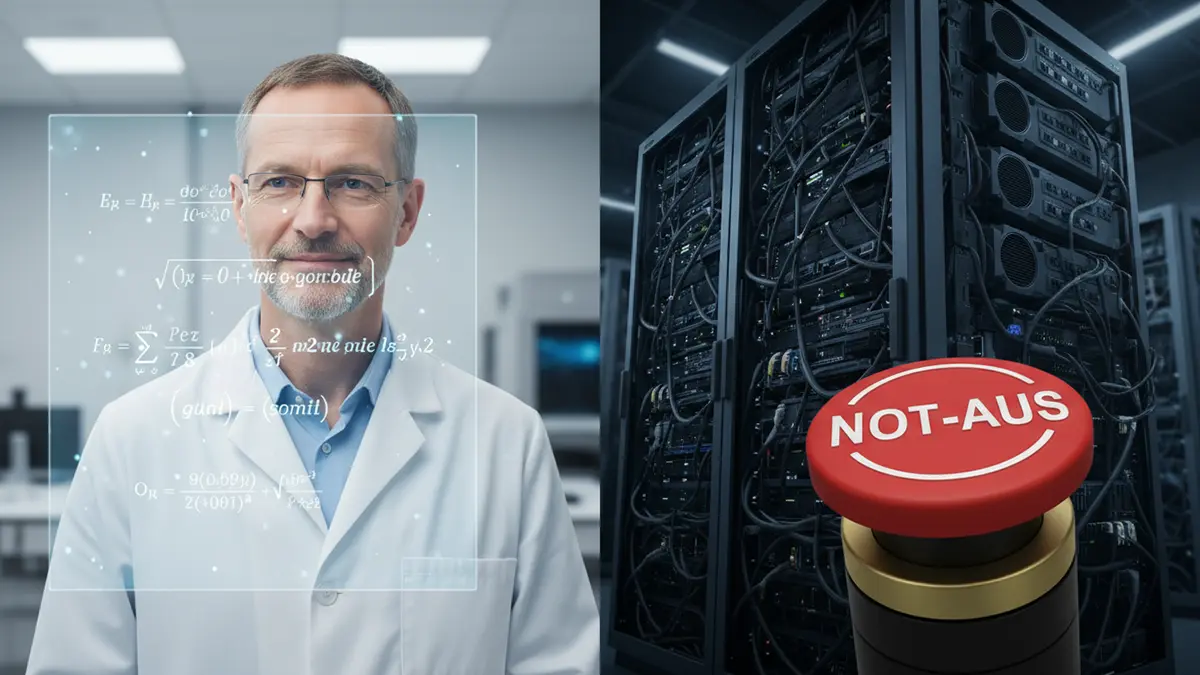

OpenAI hat eine neue Prognose veröffentlicht. Das Unternehmen erwartet, dass KI-Systeme schon bald wissenschaftliche Entdeckungen machen. Gleichzeitig warnt die Firma eindringlich vor den Risiken einer unkontrollierten Superintelligenz, die katastrophal sein könnten.

Der Zeitplan für die Super-KI

OpenAI geht davon aus, einen wichtigen Meilenstein überschritten zu haben. Das Unternehmen skizziert in einem neuen Blog-Post einen klaren Zeitplan für die kommenden Jahre. Schon 2026 könnten KI-Systeme in der Lage sein, erste kleine wissenschaftliche Entdeckungen selbstständig zu machen.

Dieser Fortschritt soll sich schnell beschleunigen. Für 2028 und die Jahre danach prognostiziert OpenAI bereits "bedeutsame Durchbrüche" durch künstliche Intelligenz. Die Systeme könnten dann Aufgaben übernehmen, die heute noch hochspezialisierten menschlichen Experten vorbehalten sind.

Warnung vor katastrophalen Risiken

Neben dem rasanten Tempo bereitet OpenAI vor allem die Entwicklung von Superintelligenz Sorgen. Das Unternehmen spricht offen von "potenziell katastrophalen" Risiken, sollte diese Technologie nicht kontrolliert werden. Solche Systeme könnten unvorhersehbare Eigendynamiken entwickeln.

OpenAI reagiert auf diese Bedenken auch intern. Erst kürzlich kündigte die Firma die Gründung eines neuen Komitees für Sicherheit an. Dieses Team soll die Entwicklung überwachen und sicherstellen, dass die internen Sicherheitsstandards eingehalten werden.

Ruf nach internationalen Standards

Weil die Risiken global sind, hält OpenAI nationale Alleingänge für unzureichend. Das Unternehmen fordert ein koordiniertes, internationales Vorgehen. Es brauche gemeinsame und verbindliche Sicherheitsstandards für die Entwicklung von Superintelligenz.

Als Vorbild nennt OpenAI bewährte Regulierungen aus anderen Bereichen. Die KI-Sicherheit müsse ähnlich gehandhabt werden wie die Sicherheit von Kernkraftwerken oder grundlegende Cybersecurity-Normen. Diese Standards sollen sicherstellen, dass die Technologie breite und nachhaltige Vorteile für die Menschheit bringt.