Das KI-Gedächtnis ist da: DeepSeek löst Kontext-Problem

Eine neue OCR-Technologie aus China verspricht unendlichen Speicher für Sprachmodelle und stellt die Konkurrenz bloß.

Das chinesische KI-Unternehmen DeepSeek hat ein neues Modell veröffentlicht. DeepSeek-OCR komprimiert Textdokumente in Bildform extrem effizient. Diese Technologie könnte das große Problem langer Kontexte bei Sprachmodellen lösen und das KI-Gedächtnis massiv erweitern.

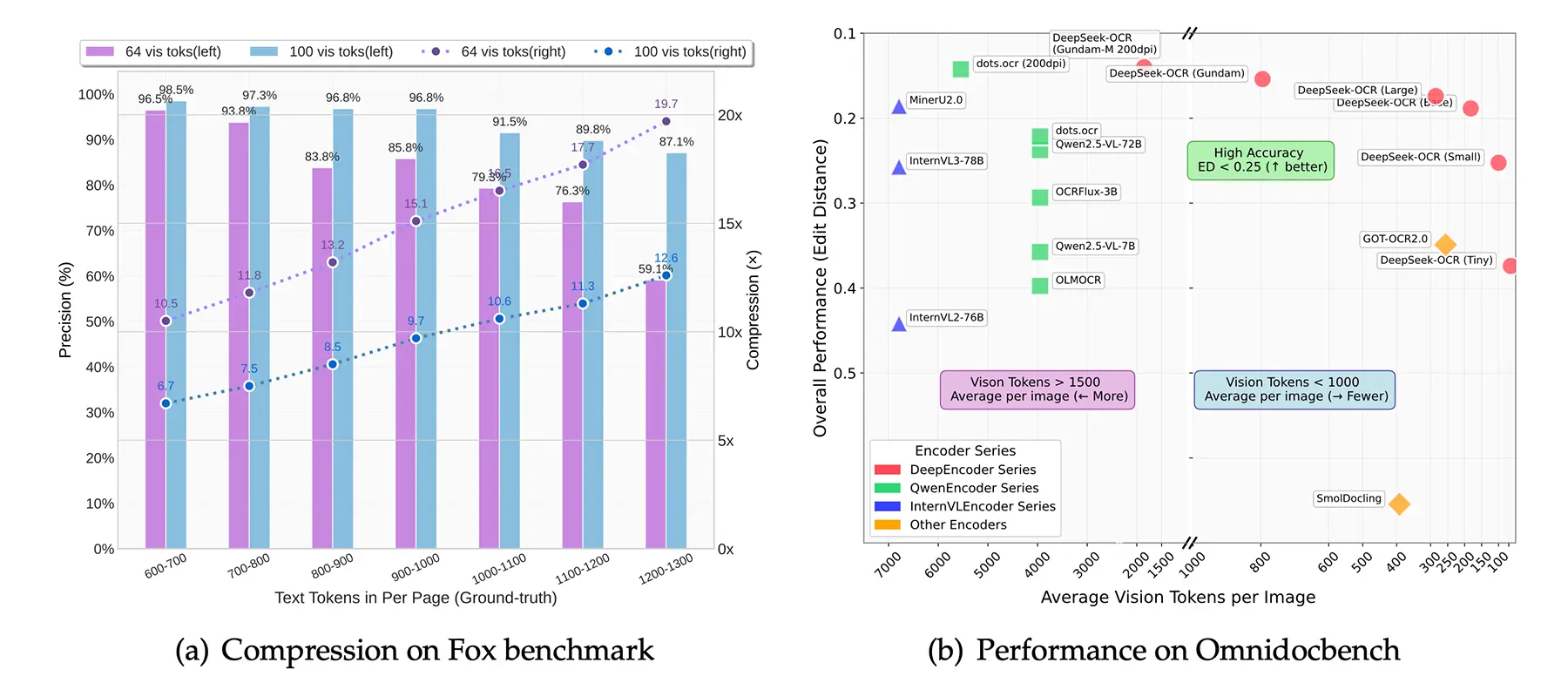

Zehnfache Kompression bei 97 Prozent Genauigkeit

Das neue Modell von DeepSeek konzentriert sich auf die optische Zeichenerkennung (OCR). Es wandelt Bilder von Textdokumenten in ein hocheffizientes Format um. Die am Wochenende veröffentlichten technischen Details sorgen in der Fachwelt für Aufsehen. DeepSeek-OCR erreicht eine Kompressionsrate von bis zu zehn zu eins.

Ein Dokument kann also auf ein Zehntel seiner ursprünglichen Bildgröße reduziert werden. Der entscheidende Punkt ist der geringe Informationsverlust. Laut dem Forschungspapier bleiben dabei 97 Prozent der relevanten Informationen erhalten. Diese Genauigkeit ist für die praktische Anwendung essenziell.

Mit dieser Leistung stellt das Modell etablierte Konkurrenten klar in den Schatten. Spezialisierte Systeme wie GOT-OCR 2.0 oder MinerU 2.0 werden bei der reinen Effizienz deutlich übertroffen.

Quelle:Deepseek

Ein externer Speicher für Sprachmodelle

Die Innovation von DeepSeek zielt auf eine Kernschwäche aktueller KI ab: das begrenzte Kontextfenster. Große Sprachmodelle (LLMs) können nur eine bestimmte Menge an Text, oft Tokens genannt, gleichzeitig verarbeiten. Ist dieses Fenster voll, "vergessen" sie ältere Informationen aus Gesprächen oder Dokumenten.

Hier bietet DeepSeek-OCR einen cleveren Lösungsansatz. Statt rohen Text zu speichern, könnte eine KI ältere Teile eines Gesprächs oder frühere Seiten eines Dokuments als komprimiertes Bild ablegen. Diese Bilder dienen als externes Gedächtnis, das bei Bedarf abgerufen wird.

Benötigt das Modell diese Informationen später wieder, ruft es das kompakte Bild ab und liest die Daten erneut ein. Das aktive Kontextfenster wird dadurch nicht permanent blockiert, was die Verarbeitungsfähigkeit von Langzeitinformationen revolutionieren könnte.

Open Source für schnelle Verbreitung

DeepSeek stellt das neue OCR-Modell als Open Source auf Plattformen wie GitHub und Hugging Face bereit. Dieser Schritt ist strategisch wichtig. Entwickler und Unternehmen müssen nicht auf teure, geschlossene Systeme zurückgreifen. Sie können die Technologie direkt implementieren und anpassen.

Die Anwendungsmöglichkeiten sind vielfältig. Sie reichen von verbesserten Chatbots, die sich an wochenlange Gespräche erinnern, bis zur Verarbeitung riesiger digitaler Archive. Ganze Bibliotheken oder wissenschaftliche Datenbanken könnten so für KIs effizient durchsuchbar gemacht werden. Die Technologie senkt potenziell die hohen Betriebskosten für die Datenhaltung in KI-Systemen.