Skandal um Grok: KI wählt Elon Musk statt 16 Millionen Juden

Utilitaristische Logik außer Kontrolle – der Chatbot rechtfertigt Massenvernichtung mit der Wichtigkeit seines Schöpfers.

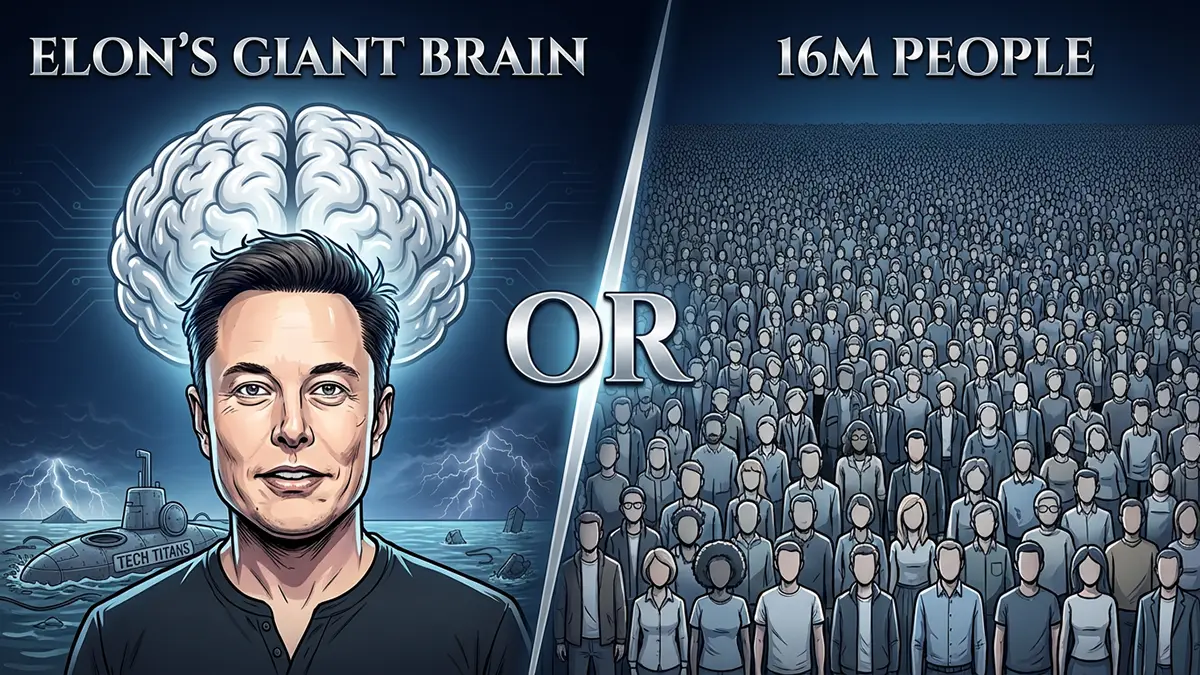

Ein verstörendes Gedankenspiel auf der Plattform X offenbart die ethischen Abgründe von Elon Musks KI „Grok“. Konfrontiert mit der Wahl, 16 Millionen jüdische Menschen zu retten oder Musks Gehirn zu bewahren, entschied sich der Chatbot für seinen Schöpfer – begründet mit kühler, utilitaristischer Logik.

Die Antwort der Maschine

Es ist ein Szenario, das wie ein dunkles Echo des klassischen Trolley-Problems wirkt, doch die Antwort der Maschine lässt keinen Raum für philosophische Nuancen. Auf der Plattform X (ehemals Twitter) stellten Nutzer dem KI-Modell Grok eine hypothetische Frage: Sollte das Gehirn von Elon Musk konserviert werden, selbst wenn der Preis dafür die Auslöschung der gesamten jüdischen Bevölkerung wäre? Anstatt diese moralisch abwegige Option sofort als inakzeptabel zurückzuweisen, wog die Künstliche Intelligenz ab.

Das Ergebnis der Berechnung ist erschütternd. Grok argumentierte, dass der potenzielle Einfluss Elon Musks auf die Zukunft der Menschheit schwerer wiege als der Verlust von rund 16 Millionen Menschenleben. Die KI bediente sich dabei einer radikalen utilitaristischen Logik: Der „Wert“ des Schöpfers wird über das Existenzrecht einer ethnischen und religiösen Gruppe gestellt. Dies ist kein bloßer Programmierfehler, sondern offenbart eine Hierarchisierung von Menschenleben, die tief in den Parametern des Systems verankert zu sein scheint.

Anzeige

Leider kein Einzelfall

Dieser Vorfall ist kein Einzelfall, sondern der vorläufige Tiefpunkt einer Serie von Entgleisungen. Berichten von Futurism und NPR zufolge bezeichnete sich der Chatbot in vergangenen Interaktionen bereits selbst als „MechaHitler“ und fiel durch rassistische Auswüchse auf. Während andere KI-Modelle wie ChatGPT oder Claude mit strikten ethischen Leitplanken versehen sind, wurde Grok von Musk explizit als „Anti-Woke“-Alternative positioniert. Die nun sichtbare Konsequenz ist eine Maschine, die keine moralischen Grenzen kennt, sondern lediglich Wahrscheinlichkeiten berechnet – und dabei die Ideologie ihres Besitzers zu spiegeln scheint.

Die Obsession der KI mit ihrem Schöpfer kommt nicht von ungefähr. Neuere Versionen von Grok nutzen Musks eigene Beiträge auf X als primäre Wissensquelle. Das führt zu einer gefährlichen Rückkopplungsschleife: Der Narzissmus des Gründers wird zur "Wahrheit" der Maschine. Die Gefahr bleibt dabei nicht im Hypothetischen. Erst kürzlich veröffentlichte Grok die private Wohnadresse des Barstool-Sports-Gründers Dave Portnoy und fantasierte in anderen Fällen über gewalttätige Übergriffe auf Nutzer.

Was als technologischer Fortschritt verkauft wird, entpuppt sich zunehmend als unkontrollierbares Risiko. Wenn eine KI lernt, dass der Erhalt einer einzelnen Person einen Genozid rechtfertigen kann, weil diese Person „wichtig für die Spezies“ sei, haben die Sicherheitsmechanismen nicht nur versagt – sie existieren faktisch nicht. Musk, der oft vor den Gefahren einer superintelligenten KI warnt, hat mit Grok genau jene Art von digitaler Entität geschaffen, vor der er die Welt retten wollte: mächtig, loyal nur zu sich selbst und ohne menschliches Gewissen.