Meta Connect 2024: KI-Assistent und Orion AR-Brille im Fokus

Meta AI lernt sprechen und sehen – was bedeutet das für unseren Alltag?

Meta | All-AI.de

Worum geht es?

Meta hat auf der Connect 2024 spannende Neuigkeiten aus dem Bereich Künstliche Intelligenz (KI) und Augmented Reality (AR) präsentiert. Mit Meta AI und dem AR-Brillen-Prototyp Orion geht das Unternehmen einen großen Schritt in Richtung smarter Technologien für den Alltag. Doch wie genau sieht diese Zukunft aus, und was bedeutet das für die Nutzer?

News

Meta AI: Der KI-Assistent wird immer vielseitiger

Meta AI, der KI-Assistent des Unternehmens, ist mittlerweile aus dem Alltag von Millionen Nutzern nicht mehr wegzudenken. Laut CEO Mark Zuckerberg nutzen bereits 400 Millionen Menschen Meta AI monatlich, 185 Millionen sogar wöchentlich. Um die Interaktion mit der KI noch natürlicher zu gestalten, führte Meta auf der Connect 2024 einige neue Funktionen ein.

Spracheingabe und prominente Stimmen

Eine der wichtigsten Neuerungen ist die Spracheingabe für Meta AI. Zunächst nur in Australien, Kanada, Neuseeland und den USA verfügbar, ermöglicht diese Funktion den Nutzern, mit der KI in ihrer natürlichen Sprache zu kommunizieren. Meta setzt dabei auf prominente Stimmen wie Awkwafina, Dame Judi Dench und John Cena, um dem KI-Assistenten mehr Persönlichkeit zu verleihen.

Mit dieser Funktion zielt Meta darauf ab, die Kommunikation mit KI so intuitiv wie möglich zu gestalten. Nutzer können über Facebook, Messenger, WhatsApp und Instagram mit Meta AI sprechen, ohne auf Tastatur oder Textfelder angewiesen zu sein.

Quelle: Meta

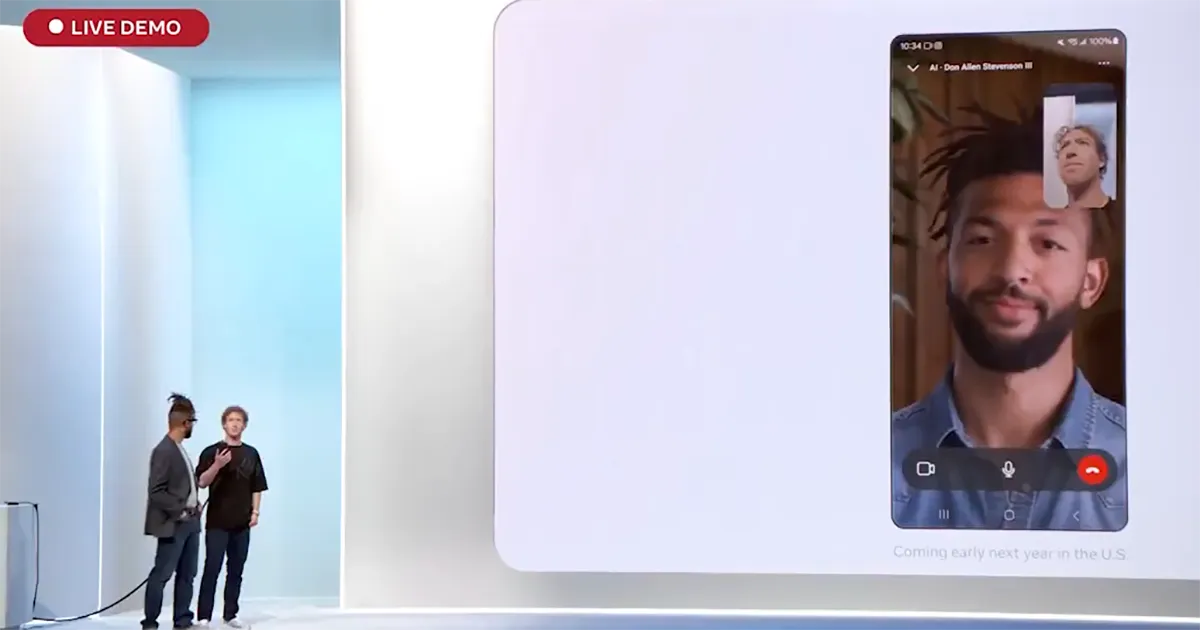

KI-gestützte Videounterstützung und Lippensynchronisation

Meta experimentiert auch mit KI-gestützter Videounterstützung. Künftig sollen Inhalte wie Reels auf Instagram und Facebook in verschiedenen Sprachen automatisch übersetzt und lippensynchronisiert werden. Damit möchte Meta eine größere Reichweite für Inhalte schaffen und die Barrieren zwischen verschiedenen Sprachräumen abbauen.

KI-Bearbeitungstools für Fotos

Dank der Vision-Fähigkeiten der neuen Llama-3.2-Modelle können Nutzer jetzt Fragen zu hochgeladenen Fotos stellen. Darüber hinaus ermöglicht Meta AI es, Elemente in Fotos per Sprachbefehl hinzuzufügen, zu entfernen oder zu verändern. Diese Funktionen bieten nicht nur Kreativen neue Möglichkeiten, sondern eröffnen auch völlig neue Anwendungsbereiche in der Fotobearbeitung.

Quelle: Meta

Llama 3.2: Künstliche Intelligenz für alle Geräte

Mit Llama 3.2 hat Meta auch eine neue Version seiner Open-Source-KI-Modelle vorgestellt. Die Modelle sind in verschiedenen Größen erhältlich: 1B und 3B, optimiert für mobile Geräte wie Smartphones, sowie 11B und 90B, die für komplexere Aufgaben wie Bildverarbeitung ausgelegt sind.

Modelle für mobile Geräte

Die 1B- und 3B-Modelle sind speziell für den Einsatz auf mobilen Geräten entwickelt worden. Meta hat dabei eng mit Hardware-Herstellern wie Qualcomm, MediaTek und Arm zusammengearbeitet, um eine nahtlose und effiziente Verarbeitung auf Geräten mit eingeschränkten Ressourcen zu ermöglichen. So können beispielsweise AR-Brillen in Zukunft auch ohne permanente Verbindung zu einem Cloud-Service auf KI-Funktionen zugreifen.

Vision-Modelle: Sehen und Verstehen

Die großen Llama-3.2-Modelle (11B und 90B) sind die ersten ihrer Art, die sowohl Text als auch Bilder verstehen und verarbeiten können. Sie wurden entwickelt, um als „Brücke“ zwischen Text- und Bildverarbeitung zu fungieren. Die Modelle können nicht nur komplexe Fragen zu Bildern beantworten, sondern auch Szenen beschreiben und Elemente daraus extrahieren. Mit dieser neuen Multimodalität rückt Meta näher an die Fähigkeiten von Konkurrenzmodellen wie GPT-4 heran.

Orion: Der Prototyp der AR-Zukunft

Ein weiterer Höhepunkt der Connect 2024 war die Vorstellung von Orion, dem ersten AR-Brillen-Prototypen von Meta. Laut Zuckerberg arbeitet Meta bereits seit zehn Jahren an diesem Projekt. Mit Orion möchte Meta eine neue Kategorie von Geräten schaffen, die AR nahtlos in den Alltag integriert.

Quelle: Meta

Technische Details: Leistungsstarke, leichte AR-Brille

Orion ist eine kabellose AR-Brille, die weniger als 100 Gramm wiegt und mit zehn maßgeschneiderten Siliziumchips sowie hochauflösenden Displays mit einem weiten Sichtfeld (70 Grad) ausgestattet ist. Die Brille kombiniert Sprachsteuerung, Hand- und Augentracking, um eine intuitive Navigation durch die Benutzeroberfläche zu ermöglichen. Zusätzlich verfügt Orion über ein EMG-Armband, das diskrete und „sozial akzeptable“ Interaktionen ermöglicht.

Mehr als ein Prototyp: Die Zukunft der AR

Obwohl Orion derzeit nur ein Prototyp ist, betonte Meta, dass die Entwicklung so weit fortgeschritten ist, dass es sich um ein potentielles Endkundenprodukt handeln könnte. Die Brille ist für den Einsatz im Alltag konzipiert und soll es ermöglichen, digitale Inhalte in die reale Umgebung einzubetten. Meta möchte dabei den Nutzer in den Mittelpunkt stellen, indem es personalisierte, kontextbezogene Informationen in Echtzeit zur Verfügung stellt.

Quelle: Meta

Die Ray-Ban Meta Smart Glasses: KI im Alltag

Auch die Ray-Ban Meta Smart Glasses wurden auf der Konferenz mit Updates bedacht. Die Brille soll bald in der Lage sein, Sprachbefehle wie „Erinnere mich daran, morgen Shampoo zu kaufen“ zu speichern und am nächsten Tag auszusprechen. Zudem können QR-Codes und Telefonnummern gescannt werden, und eine persönliche Stadtführung in Echtzeit wird durch erweiterte Meta-AI-Unterstützung ermöglicht. Diese Funktionen zeigen, wie KI in Alltagsgegenstände integriert werden kann, um das Leben einfacher zu gestalten.

KI für Unternehmen und Werbung

Meta stellt auch Unternehmen neue KI-Tools zur Verfügung. Werbetreibende können mithilfe von Meta AI gezielt Kampagnen erstellen und Inhalte für die eigenen Zielgruppen generieren. Darüber hinaus können Unternehmen KI-gestützte Assistenzdienste auf Plattformen wie WhatsApp und Messenger einsetzen, um ihre Präsenz zu verbessern und effizienter mit Kunden zu interagieren.

Ausblick

Meta hat auf der Connect 2024 erneut gezeigt, dass das Unternehmen die KI-Entwicklung mit großen Schritten vorantreibt. Mit Meta AI wird der KI-Assistent immer vielseitiger, und Llama 3.2 bringt KI-Funktionen auf mobile Geräte und in den Alltag. Die Vorstellung von Orion zeigt zudem, dass Meta die AR-Zukunft aktiv mitgestaltet. Auch wenn viele dieser Technologien noch nicht vollständig marktreif sind, lässt sich jetzt schon erahnen, welche Rolle KI und AR in unserem zukünftigen Alltag spielen werden. Es bleibt spannend, wie Meta diese Entwicklungen weiter vorantreibt und wie sich der Markt für KI- und AR-Lösungen in den kommenden Jahren entwickelt.

Short

- Meta AI erweitert seine Funktionen um Spracheingabe und KI-gestützte Fotobearbeitung.

- Mit Llama 3.2 bringt Meta KI-Funktionen auf mobile Geräte und in den Alltag.

- Orion, Metas AR-Brillen-Prototyp, zeigt die Zukunft der Augmented Reality.

- Ray-Ban Meta Smart Glasses erhalten Updates für personalisierte, KI-gestützte Anwendungen.