Qwen-Image 2.0 fordert Nano Banana Pro heraus

Alibabas neues System rendert Texte nativ in 2K und überzeugt bei der Bildbearbeitung.

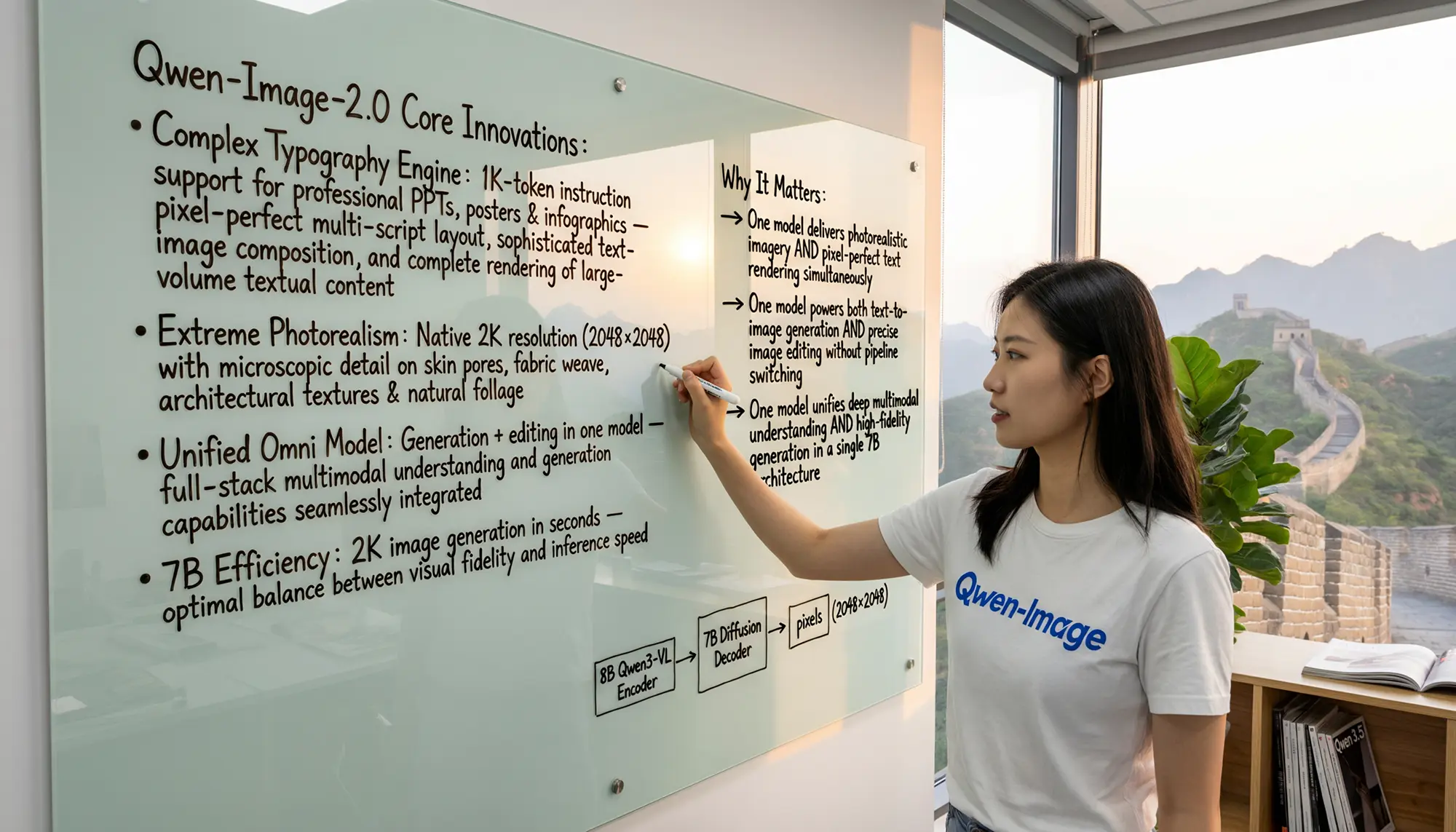

Alibaba hat heute mit Qwen-Image 2.0 die neueste Version seiner Bild-KI veröffentlicht. Das Modell setzt auf eine native Auflösung von 2048 x 2048 Pixeln und verspricht durch eine spezialisierte Typografie-Engine signifikante Verbesserungen bei der Darstellung von Texten in Grafiken.

Mit der Version 2.0 vollzieht Alibaba den Schritt zu einem sogenannten "Unified Omni Model". Anders als bei herkömmlichen Ansätzen, die für die Generierung (Text-to-Image) und die nachträgliche Bearbeitung (Image Editing) oft separate Verarbeitungsketten oder Modelle nutzen, führt Qwen-Image 2.0 diese Aufgaben in einer 7B-Architektur zusammen. Laut Herstellerangaben ermöglicht dies einen direkten Wechsel zwischen Erstellung und Modifikation ohne den sonst üblichen Qualitätsverlust durch den Wechsel der Verfahren.

Anzeige

Technische Basis und Text-Verständnis

Ein Kernmerkmal des Updates ist die "Complex Typography Engine". Das System soll Anweisungen mit bis zu 1.000 Token verarbeiten können, um komplexe Layouts für Poster, Präsentationen oder Infografiken zu erstellen. In Demonstrationen zeigt das Modell die Fähigkeit, dichten Text fehlerfrei in Bilder zu integrieren – eine Disziplin, an der viele Diffusionsmodelle bisher scheitern.

Technisch setzt Alibaba auf eine native Generierung in 2K-Auflösung (2048×2048 Pixel). Dies unterscheidet sich von Methoden, die Bilder in niedrigerer Auflösung erstellen und nachträglich hochskalieren (Upscaling), was oft zu Artefakten führt. Das Modell soll dabei mikroskopische Details wie Hautporen oder Stofftexturen direkt rendern. Die Effizienz des 7-Milliarden-Parameter-Modells (7B) soll dabei eine schnelle Inferenzzeit gewährleisten, was für den praktischen Einsatz in Produktivumgebungen entscheidend ist.

Quelle: Alibaba

Benchmarks bestätigen Anschluss an die Weltspitze

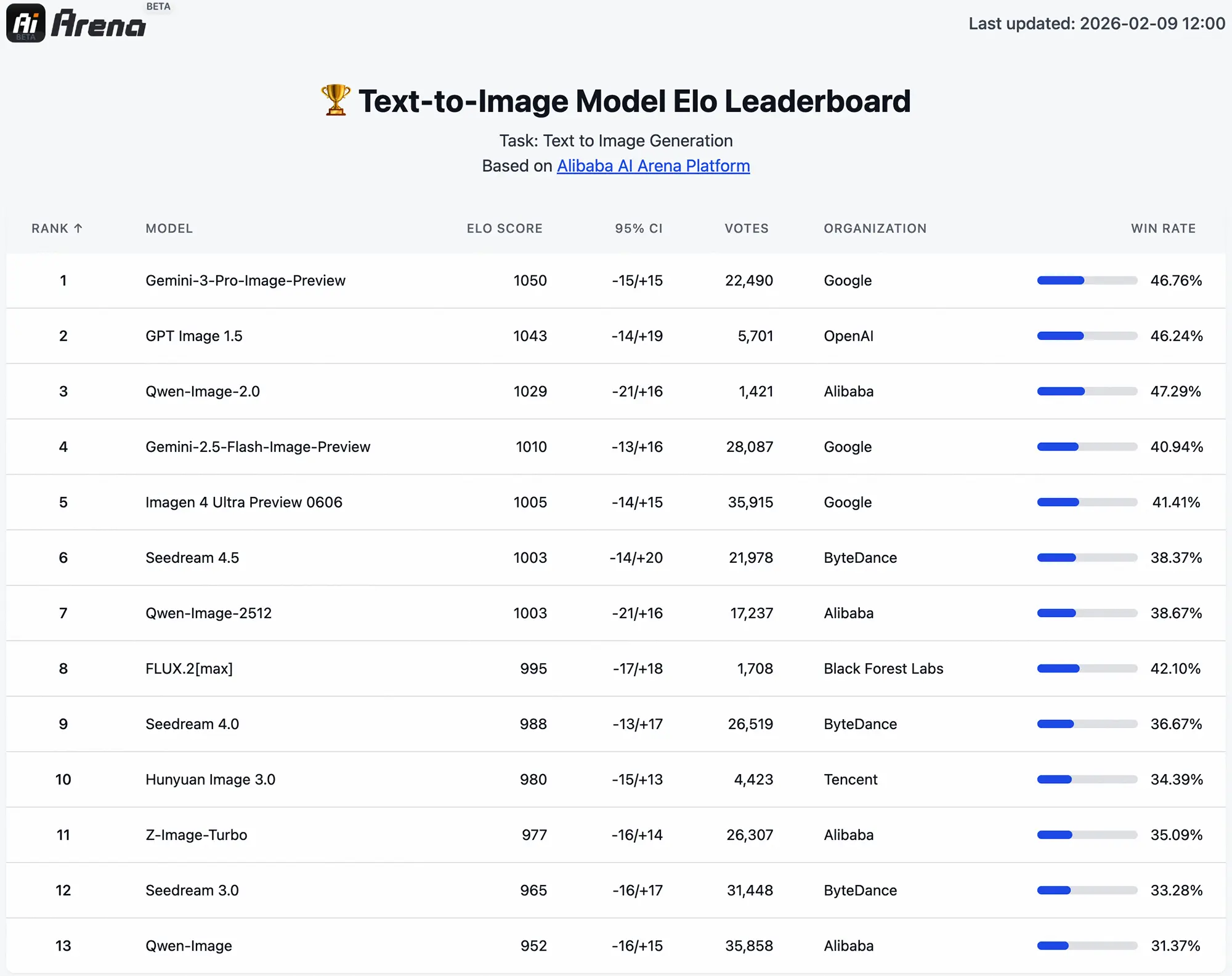

Ein Blick auf die aktuellen Leaderboards der "AI Arena" zeigt, dass Alibaba mit diesem Release zur direkten Konkurrenz aus den USA aufschließt. Im Bereich "Text-to-Image Generation" erreicht Qwen-Image 2.0 einen Elo-Score von 1029 und belegt damit Platz 3, knapp hinter OpenAIs GPT Image 1.5 (1043) und Googles Gemini-3-Pro (1050).

Quelle: Alibaba

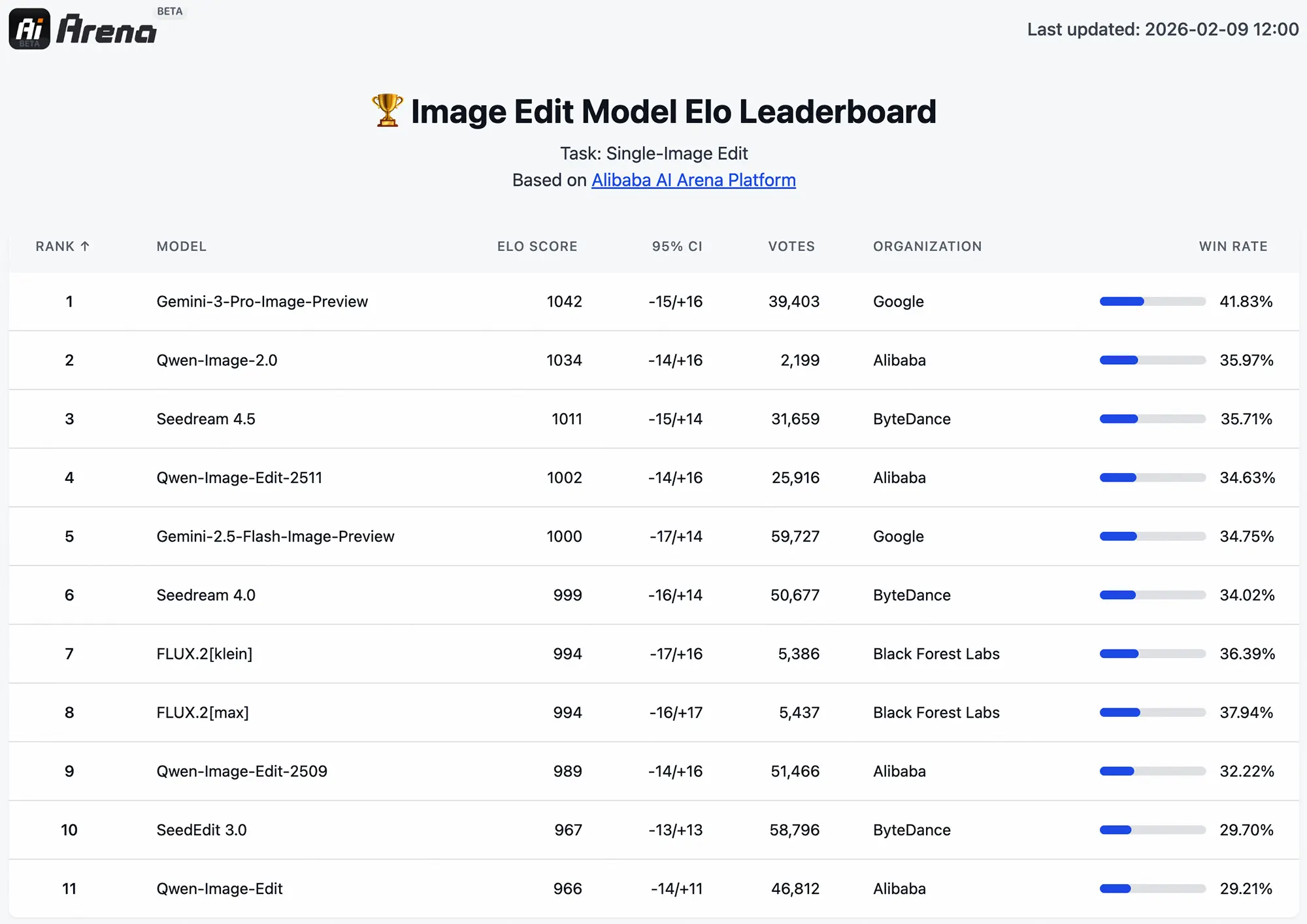

Noch deutlicher wird die Leistungsfähigkeit im Bereich der Bildbearbeitung ("Single-Image Edit"). Hier positioniert sich das Modell mit einem Elo-Score von 1034 auf dem zweiten Platz weltweit, direkt hinter dem Gemini-3-Pro-Image-Preview (1042) und deutlich vor Wettbewerbern wie Seedream 4.5 oder den FLUX.2-Varianten. Diese Werte deuten darauf hin, dass die Integration von Editier-Funktionen in das Basismodell in der Praxis robuste Ergebnisse liefert.

Quelle: Alibaba

Konsistenz bei Bearbeitung und Storytelling

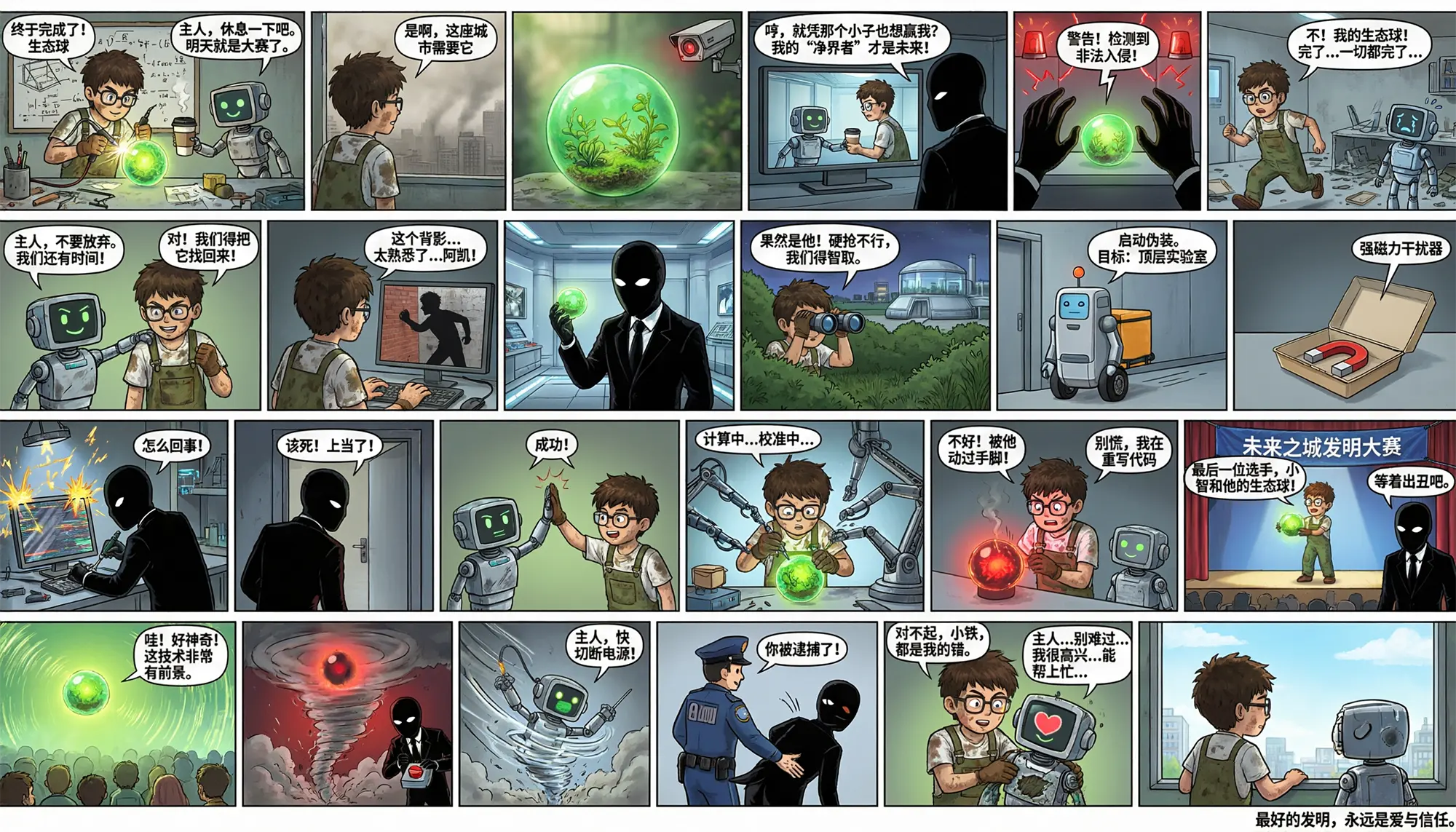

Für professionelle Anwender ist die Konsistenz von Charakteren und Objekten über mehrere Bilder hinweg relevanter als die reine Bildqualität eines Einzelwerks. Qwen-Image 2.0 führt hierzu Funktionen ein, die eine Identitätswahrung bei der Generierung von Bilderserien ermöglichen sollen.

In gezeigten Beispielen, etwa einem Comic-Strip, bleiben Charaktermerkmale und Stilelemente über verschiedene Panels hinweg stabil, selbst wenn sich Perspektive oder Kleidung ändern. Auch die nachträgliche Bearbeitung, wie der Austausch von Kleidung bei gleichbleibender Gesichtsanatomie, wird ohne sichtbare Brüche im Bildaufbau durchgeführt. Dies adressiert ein häufiges Problem generativer KI, bei der kleine Änderungen oft das gesamte Bildmotiv ungewollt verfremden.

Rapide Entwicklungsgeschwindigkeit

Der Release markiert den vorläufigen Höhepunkt einer aggressiven Entwicklungsstrategie. Das Projekt "Qwen-Image" startete erst im Mai 2025. Innerhalb von weniger als einem Jahr veröffentlichte Alibaba mehrere Zwischenversionen (u.a. Qwen-Image-2512 im Dezember 2025), um nun im Februar 2026 die Version 2.0 folgen zu lassen. Ob das Modell die hohen Erwartungen im täglichen Einsatz flächendeckend erfüllen kann, wird die Verfügbarkeit der Gewichte auf Plattformen wie Hugging Face und die unabhängige Überprüfung durch die Community in den kommenden Tagen zeigen.