Google Gemini bedient Deine Android-Apps selbständig

Das neue Gemini-Update bringt Multi-Step-Tasks auf Android-Smartphones. Die KI bedient Apps wie Uber und den Kalender künftig automatisch.

Google integriert eine weitreichende KI-Steuerung tief in das Android-Betriebssystem. Die Gemini-App führt selbstständig komplexe Aufgaben über mehrere Anwendungen hinweg aus, wobei das neue Samsung Galaxy S26 laut dem Magazin The Verge den Anfang macht. Das Pixel 10 und Pixel 10 Pro sollen folgen.

Anzeige

Von der Texteingabe zur aktiven App-Steuerung

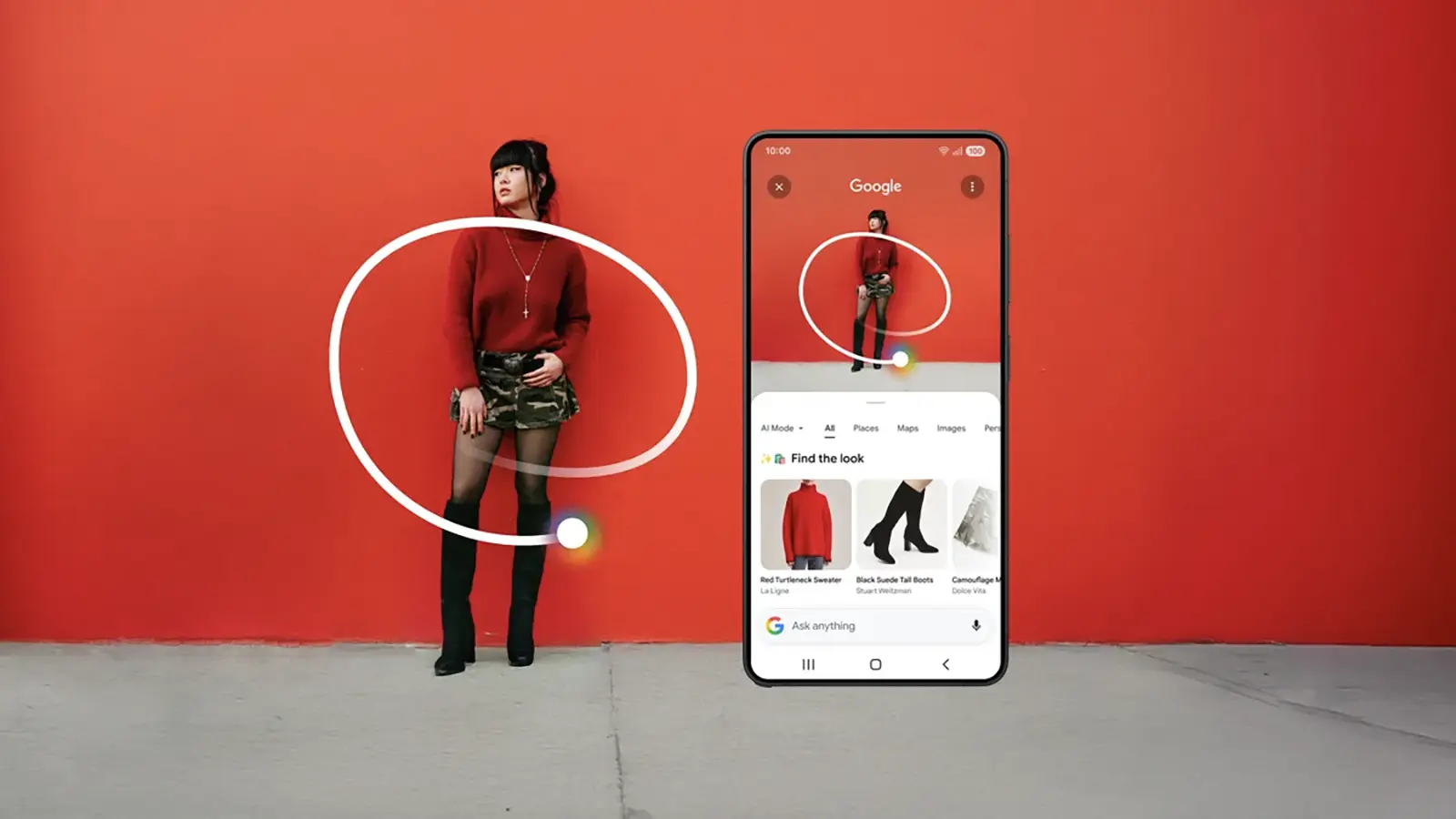

Bisher agierten KI-Modelle auf Smartphones meist als reine Chatbots, die auf einen Prompt lediglich mit Text oder Bildern antworteten. Mit dem aktuellen Update ändert Google diesen Ansatz grundlegend. Gemini erhält die technische Fähigkeit, aktiv mit installierten Anwendungen zu interagieren und sogenannte Multi-Step-Tasks auszuführen.

Das bedeutet, dass die Software eine komplexe Anfrage selbstständig in mehrere logische Einzelschritte unterteilt. Ein konkretes Beispiel verdeutlicht diese neue Funktionsweise. Bittet ein Anwender das Smartphone, eine Fahrt zum nächsten Termin zu organisieren, startet ein mehrstufiger Prozess. Gemini liest zunächst den Ort und die genaue Zeit aus dem digitalen Kalender aus. Anschließend öffnet die KI im Hintergrund die Uber-App, gibt die Zieladresse ein und wählt die passende Abholzeit. Der Nutzer erhält am Ende lediglich eine kurze Zusammenfassung auf dem Bildschirm und bestätigt die Buchung mit einem einfachen Klick.

Ein weiteres Beispiel ist die automatische Bestellung einer Pizza, nachdem man sich mit Freunden im Chat darüber abgestimmt hat:

Quelle: Google

Systemzugriffe und lokale Verarbeitung

Solche Aufgaben erfordern ein hohes Maß an Reasoning, also die Fähigkeit der KI, eigenständige und logische Schlussfolgerungen zu ziehen. Zudem benötigt das Modell tiefe Zugriffe auf das Betriebssystem. Google nutzt dafür spezielle APIs in Android. Diese Schnittstellen erlauben es Gemini, die Benutzeroberfläche und die Menüs der Apps ähnlich wie ein echter Mensch zu bedienen.

Der Startschuss für die Multi-Step-Tasks fällt auf der Galaxy S26-Serie, die Samsung auf dem aktuellen Unpacked-Event 2026 vorgestellt hat. Die Limitierung auf diese Flaggschiff-Geräte liegt in den hohen Anforderungen an die Rechenleistung begründet. Ein großer Teil der Datenverarbeitung findet direkt auf dem lokalen Prozessor des Smartphones statt, was kurze Reaktionszeiten garantiert und private Nutzerdaten schützt. Später im Jahr wird Google die Funktion auch für das Pixel 10 und Pixel 10 Pro freischalten und die Liste der kompatiblen Drittanbieter-Apps schrittweise ausbauen.