Claude Skill Creator: Testen, messen und verbessern

Anthropic integriert Evals und Benchmarks in Claude. So lässt sich die Leistung von Agent Skills vor dem Einsatz exakt überprüfen.

Anthropic hat den skill-creator für seine KI Claude erweitert. Nutzer können Agent Skills nun nicht mehr nur erstellen, sondern durch automatisierte A/B-Tests, Benchmarks und Trigger-Optimierung direkt messen und zielgerichtet für den produktiven Einsatz verbessern.

Anzeige

Messbare Qualität für Agent Skills

Agent Skills erweitern die Funktionen von Claude um spezifische Aufgaben und Abläufe. In der Vergangenheit war es für Entwickler oft schwer einzuschätzen, wie zuverlässig ein neuer Skill wirklich funktioniert. Das aktuelle Update für den skill-creator ändert das grundlegend. Anthropic integriert nun eine automatisierte Testumgebung direkt in den Erstellungsprozess.

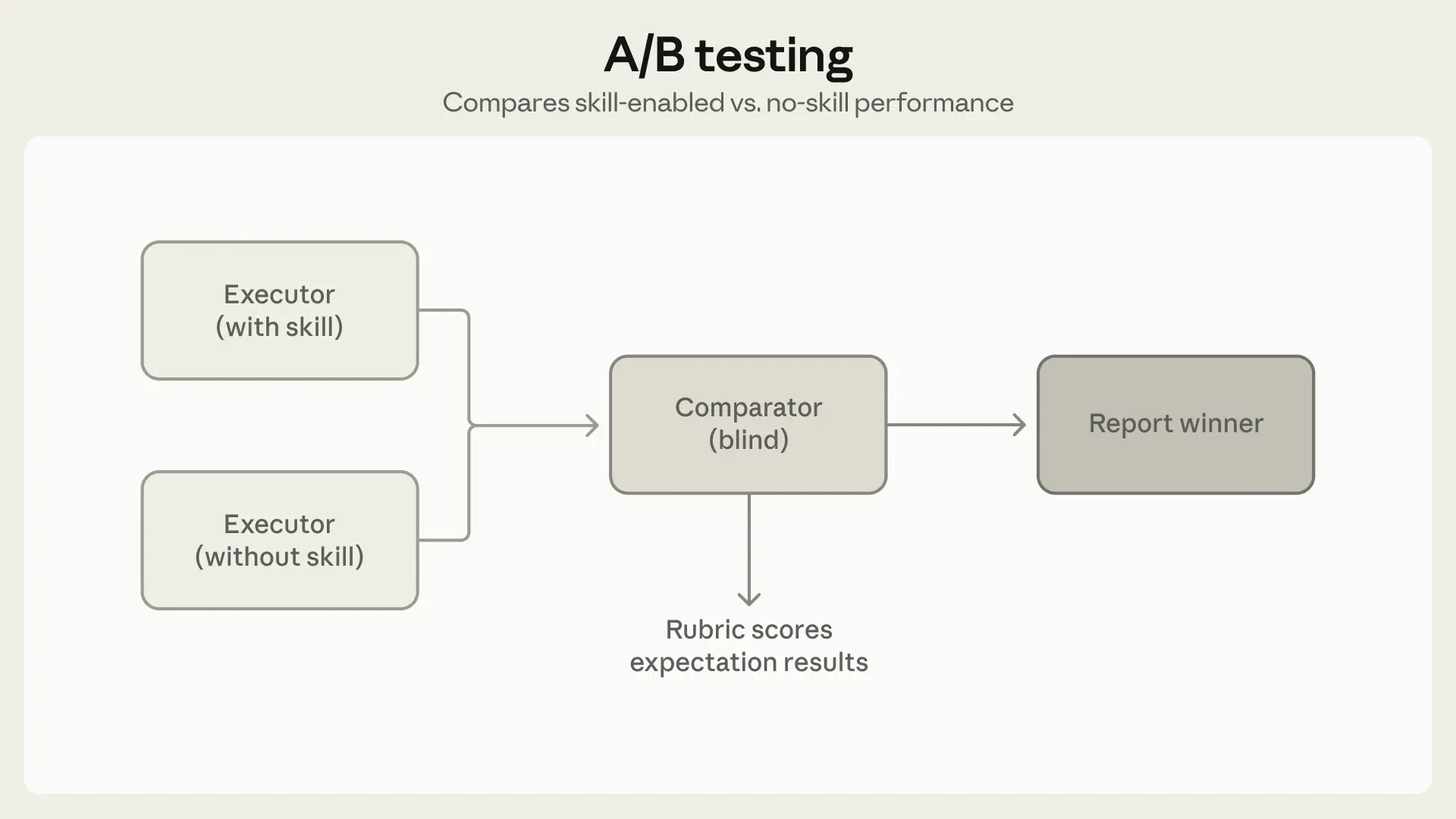

Nutzer definieren dafür zunächst eigene Test-Prompts für ihren Anwendungsfall. Das System führt diese Aufgaben anschließend parallel aus: einmal mit dem aktivierten Skill und einmal als Basislinie ohne zusätzliche Instruktionen. Ein unabhängiges Bewertungsmodul analysiert die Ergebnisse blind und vergleicht sie nach vorher festgelegten Kriterien. Dieser A/B-Test macht die tatsächliche Leistungssteigerung durch den Skill sofort sichtbar.

Quelle: Anthropic

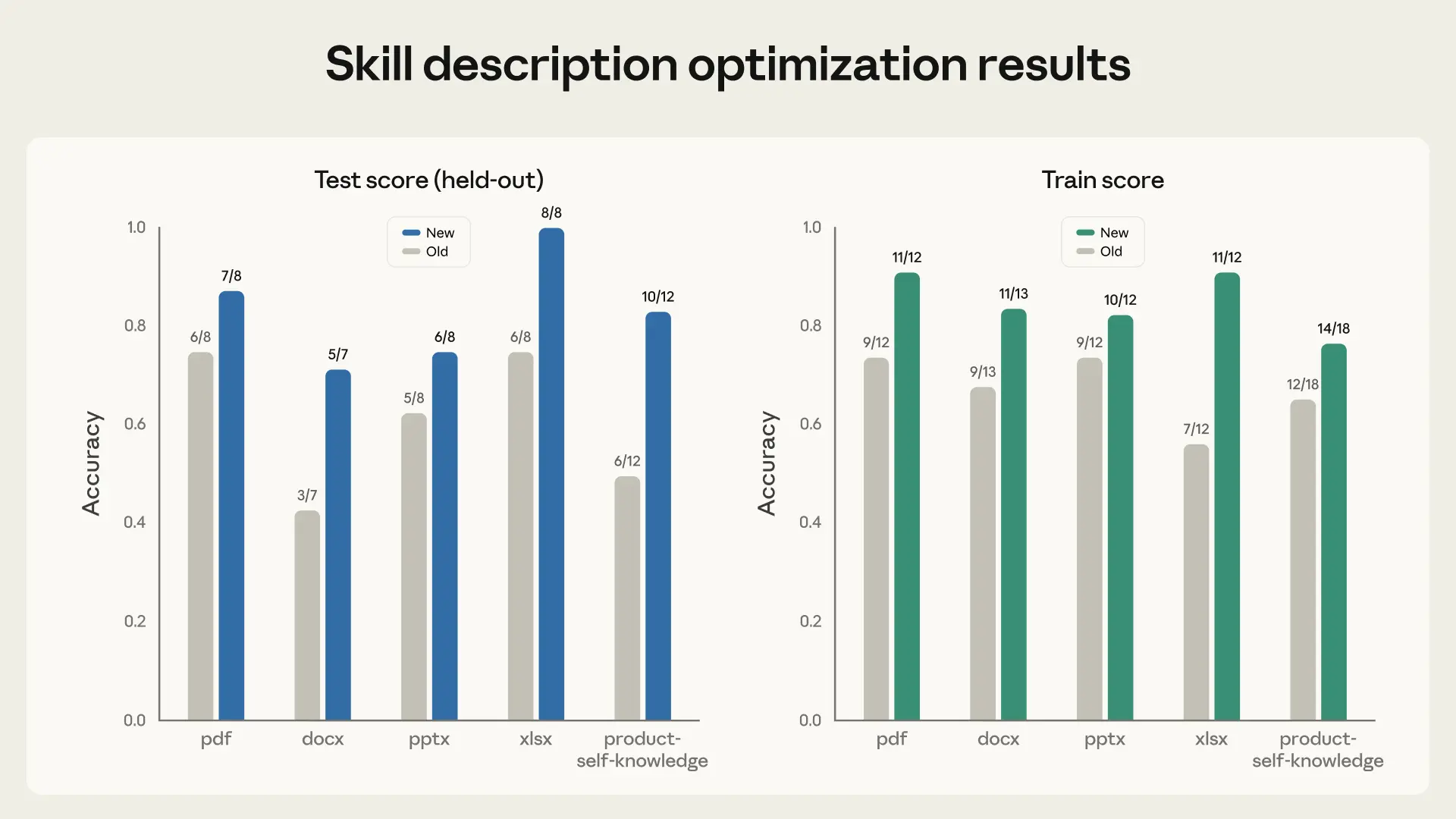

Die von Anthropic veröffentlichten Daten zeigen durch diese Optimierungen deutliche Fortschritte bei der Verarbeitung verschiedener Dateiformate. In internen Tests stieg die Genauigkeit bei PDF-Dokumenten von 6/8 auf 7/8 Punkten. Bei Excel-Tabellen verbesserte sich der Wert von 6/8 auf die volle Punktzahl. Auch das komplexe Abrufen von internem Produktwissen konnte durch passgenaue Skill-Beschreibungen merklich gesteigert werden.

Quelle: Anthropic

Konkrete Benchmarks und optimierte Auslöser

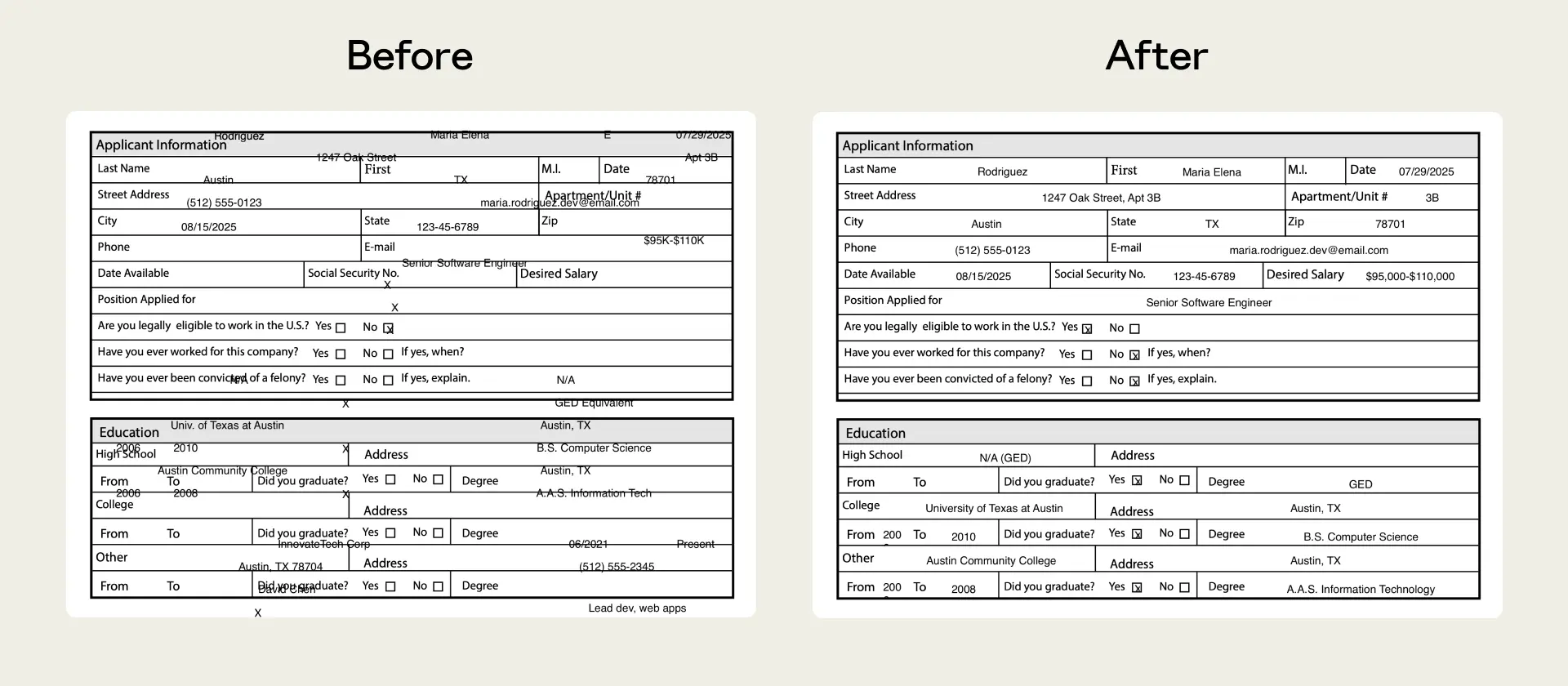

Ein neuer Benchmark-Modus liefert Entwicklern zudem detaillierte Metriken für die Fehleranalyse. Eine Übersichtstabelle zeigt Kennzahlen wie die Erfolgsquote, die benötigte Zeit und den Token-Verbrauch im direkten Vergleich. Anthropic demonstriert dies anhand eines speziellen PDF-Skills. Bei anspruchsvollen Aufgaben wie dem Ausfüllen nicht-ausfüllbarer Formulare oder dem Extrahieren von Tabellen aus mehrseitigen Dokumenten stieg die Erfolgsquote durch den Skill von 40 auf 100 Prozent. Die Ausführungszeit blieb dabei nahezu konstant.

Quelle: Anthropic

Neben der reinen Ausgabequalität verbessert das Update auch die eigentliche Aktivierung der Skills. Claude entscheidet ausschließlich auf Basis kurzer Textbeschreibungen im System-Prompt, wann eine bestimmte Fähigkeit benötigt wird. Der skill-creator analysiert und optimiert genau diese Beschreibungen. Dadurch versteht das Sprachmodell besser, in welchem Kontext ein Skill aufgerufen werden muss.

Das System zielt auf eine kontinuierliche Qualitätskontrolle ab. Entwickler testen einen Skill, werten die Fehler aus, passen die Anweisungen an und starten den nächsten Testlauf. Dieser datengetriebene Ansatz macht die Entwicklung von Agent Skills berechenbarer und bereitet sie auf den produktiven Einsatz vor.