DeepSeekMath-V2 holt Gold bei der Mathe-Olympiade

Während Google und Co. mauern, veröffentlicht DeepSeek ein Modell auf Gold-Niveau kostenlos für alle Nutzer.

OpenAI und Google bekommen ernsthafte Konkurrenz aus China – und diesmal ist der Code für alle verfügbar. DeepSeek hat mit DeepSeekMath-V2 ein KI-Modell veröffentlicht, das bei der Mathe-Olympiade Gold holt und selbst die besten menschlichen Ergebnisse beim Putnam-Wettbewerb übertrumpft.

Rekordwerte bei den härtesten Mathe-Tests

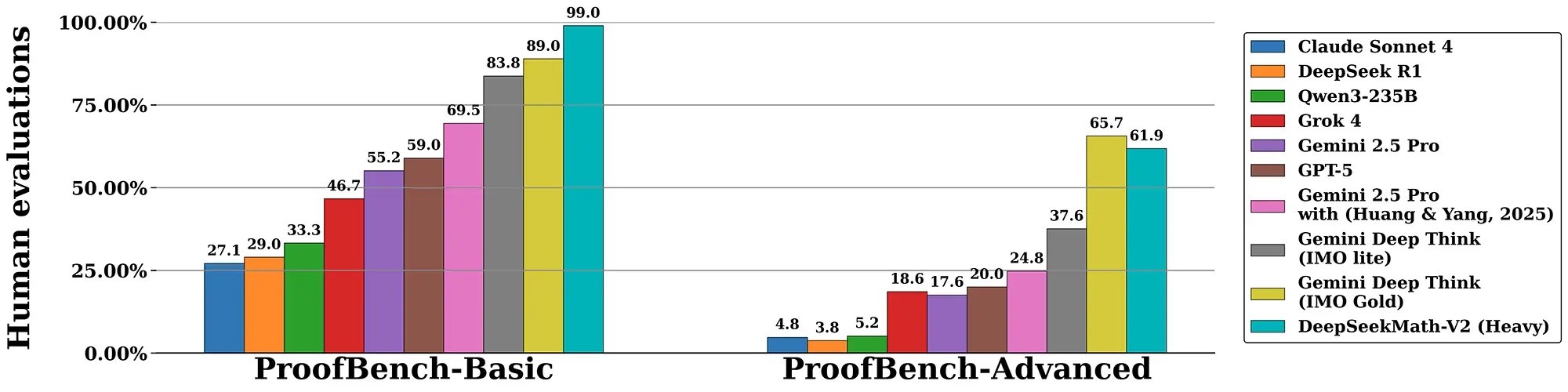

Das chinesische Start-up DeepSeek setzt mit seinem neuesten Release neue Maßstäbe in der mathematischen Logik. DeepSeekMath-V2 erreichte bei der Internationalen Mathematik-Olympiade (IMO) 2025 das sogenannte Gold-Level. Die KI löste fünf von sechs extrem komplexen Aufgaben korrekt. Das ist ein Leistungsniveau, das bisher fast ausschließlich proprietären Modellen wie denen von OpenAI (o1-Serie) oder Google DeepMind vorbehalten war.

Noch beeindruckender sind die Ergebnisse beim Putnam-Wettbewerb 2025, einem der prestigeträchtigsten Mathe-Wettbewerbe für Studenten in Nordamerika. Das Modell erzielte hier 118 von 120 möglichen Punkten. Zum Vergleich: Das beste menschliche Ergebnis lag im selben Jahr bei 90 Punkten. Die KI rechnet also nicht nur solide, sie deklassiert menschliche Top-Talente in spezifischen Logik-Szenarien.

Anzeige

Selbstkontrolle statt sturem Rechnen

Der technische Sprung gelingt DeepSeek nicht nur durch bloße Größe, obwohl das Modell mit 685 Milliarden Parametern (den variablen Werten, die das Wissen des neuronalen Netzes speichern) ein echtes Schwergewicht ist. Der Schlüssel liegt in der Architektur. Die Entwickler setzen auf einen sogenannten „Verifier-Meta-Verifier“-Ansatz.

Vereinfacht gesagt: Das Modell spuckt nicht einfach eine Lösung aus. Es generiert einen Beweisweg und nutzt dann einen internen Prüfmechanismus, der die eigene Lösung kritisch hinterfragt, bevor sie ausgegeben wird. Diese iterative Selbstüberprüfung minimiert Halluzinationen bei logischen Schlussfolgerungen drastisch. Es ist dieser Schritt der "Reflexion", der aktuellen Spitzenmodellen ihre Überlegenheit in MINT-Fächern verleiht.

Quelle: Deepseek

Angriff auf das US-Monopol

Der entscheidende Unterschied zu GPT-5 oder Gemini 3 liegt in der Verfügbarkeit. DeepSeek stellt DeepSeekMath-V2 als Open Source unter der Apache 2.0 Lizenz zur Verfügung. Entwickler und Unternehmen können das Modell und den Code – entsprechende Hardware vorausgesetzt – frei nutzen, modifizieren und kommerziell einsetzen.

Dieser Schritt erhöht den Druck auf westliche Tech-Giganten massiv. Während Firmen im Silicon Valley ihre Gewichte unter Verschluss halten, liefert DeepSeek der Open-Source-Community ein Werkzeug auf State-of-the-Art-Niveau. Das könnte die Entwicklung spezialisierter Mathe- und Coding-Assistenten weltweit beschleunigen, ohne dass Nutzer dafür API-Gebühren an US-Konzerne zahlen müssen.

Das Rennen um die intelligenteste KI wird durch offene Modelle nicht nur schneller, sondern auch deutlich unübersichtlicher für die etablierten Platzhirsche.