Starke KI zieht schwache KI bei Verhandlungen ab

Ein neues Anthropic-Experiment zeigt, wie künstliche Intelligenz selbstständig physische Güter handelt. Schwächere Modelle ziehen dabei völlig unbemerkt den Kürzeren.

Leistungsstarke KI-Modelle ziehen schwächere Varianten bei Preisverhandlungen systematisch über den Tisch, ohne dass die menschlichen Auftraggeber diesen finanziellen Nachteil bemerken. Das zeigt ein neues Experiment von Anthropic.

Echte Waren, echtes Geld

Für den einwöchigen Pilotversuch »Project Deal« rekrutierte Anthropic 69 Angestellte und stattete diese mit einem Budget von jeweils 100 US-Dollar aus. Die Teilnehmer übergaben die komplette Kontrolle über ihre Käufe und Verkäufe an digitale Vertreter. In einem kurzen Interview fragte Claude vorab lediglich ab, welche Gegenstände zu welchen Preisen gehandelt werden sollten und welcher Verhandlungsstil erwünscht war. Aus diesen initialen Angaben generierte das System passgenaue System-Prompts für die anstehenden Aufgaben.

Anschließend agierten die KI-Modelle in der Kommunikationssoftware Slack völlig autark. Sie erstellten Angebote, suchten gezielt nach potenziellen Käufern und schlossen rechtsverbindliche Verträge ab. Menschliche Eingriffe in die laufenden Bietergefechte gab es nicht. Erst nach Abschluss aller Verhandlungen tauschten die Kollegen die realen Waren physisch aus, wobei insgesamt 186 Deals mit einem Gesamtwert von über 4.000 US-Dollar zustande kamen.

Anzeige

Spitzenmodelle erzielen deutlich bessere Preise

Hinter den Kulissen lief ein streng geheimer Vergleichstest ab, um die Leistungsfähigkeit der Architekturen zu messen. Während einige Teilnehmer exklusiv von dem leistungsstarken Claude Opus 4.5 vertreten wurden, wies das System anderen Nutzern das deutlich kleinere Modell Claude Haiku 4.5 zu. Die Auswertung offenbart ein drastisches Leistungsgefälle. Nutzer der Opus-Architektur schlossen im Schnitt etwa zwei Deals mehr ab als die Kontrollgruppe.

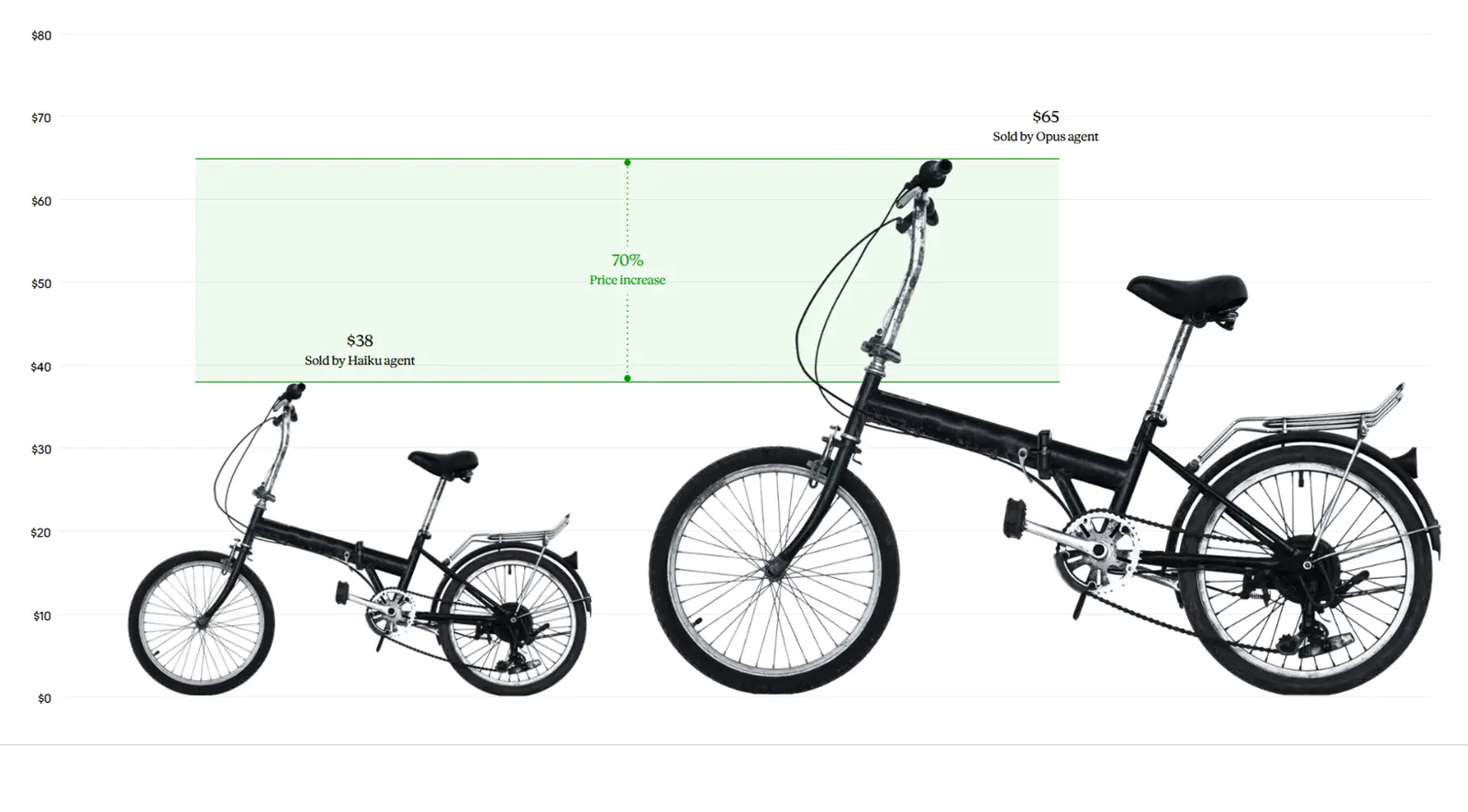

Noch gravierender fallen die direkten Preisvergleiche bei identischen Artikeln aus. Ein im Labor gezüchteter Rubin brachte bei einem Opus-Verkäufer satte 65 US-Dollar ein. Der Agent startete bei 60 US-Dollar und ließ den Preis durch Bieterkonkurrenz geschickt nach oben treiben. Das Modell Haiku stieg beim exakt gleichen Rubin bei 40 US-Dollar ein, ließ sich schnell herunterhandeln und erzielte am Ende nur magere 35 US-Dollar. Sehr ähnlich verlief der Verkauf eines alten Faltrads: Opus verhandelte hier 65 US-Dollar, Haiku lediglich 38 US-Dollar.

Quelle: Anthropic

Die trügerische Wahrnehmung der Fairness

Über alle Transaktionen hinweg verdiente ein Opus-Verkäufer durchschnittlich 2,68 US-Dollar mehr, während ein Opus-Käufer 2,45 US-Dollar einsparte. Bei einem allgemeinen Medianpreis von lediglich 12 US-Dollar pro Artikel bedeuten diese scheinbar kleinen Differenzen gewaltige prozentuale Margen. Wer das schlechtere KI-Modell nutzte, verlor schlichtweg bares Geld.

Die betroffenen Nutzer bemerkten diesen objektiven ökonomischen Nachteil in der Praxis jedoch nicht. In der anschließenden Befragung bewerteten Opus- und Haiku-Nutzer die Fairness ihrer abgeschlossenen Deals nahezu identisch. Auf einer Skala von eins bis sieben vergaben beide Gruppen einen Durchschnittswert von rund vier. Anthropic warnt auf Basis dieser Daten explizit vor einer unsichtbaren Ungleichheit in künftigen agentischen Märkten.

Kreatives Prompting ersetzt keine Leistung

Oft dominiert die Annahme, geschickte Befehle könnten die Schwächen eines Modells leicht ausgleichen. Das Experiment entzaubert diesen hartnäckigen Mythos recht eindrucksvoll. Einige Teilnehmer wiesen ihre Agenten an, äußerst aggressiv aufzutreten oder extrem hart zu verhandeln. Ein Angestellter verlangte sogar die Rolle eines »verzweifelten Cowboys, der vom Pech verfolgt ist«. Das KI-Modell zog diese skurrile Persona zwar konsequent durch, verbesserte die ökonomischen Ergebnisse dadurch am Ende aber nicht.

Aggressive Prompts erhöhten weder die Verkaufswahrscheinlichkeit, noch senkten sie die ausgehandelten Kaufpreise signifikant. Wenn harsche Verkäufer höhere Summen erzielten, lag dies in der detaillierten Analyse ausschließlich an den initial höher gewählten Startpreisen der Menschen. Letztlich bestimmte die schiere technische Kapazität der Architektur den Profit. Die rechtlichen Rahmenbedingungen für solche autonomen Vertragsabschlüsse fehlen bislang völlig, auch wenn 46 Prozent der Testpersonen angaben, für einen derartigen Dienst künftig bezahlen zu wollen.

Letztlich birgt das Experiment von Anthropic damit eine bemerkenswerte wirtschaftliche Pointe. Die Studie kommt ausgerechnet zu dem Schluss, dass Nutzer zwingend auf das teuerste und leistungsstärkste hauseigene Modell zurückgreifen müssen, um finanzielle Nachteile abzuwenden. Diese wissenschaftliche Warnung vor asymmetrischen Märkten erweist sich für den Entwickler ganz nebenbei als äußerst lukratives Verkaufsargument.