Hat Google DeepMind den perfekten Arzt erschaffen?

Der AI co-clinician wertet Audio und Video live aus. Bei offenen Fachfragen schlägt das System die direkte Konkurrenz.

Google DeepMind präsentiert mit dem AI co-clinician ein fortschrittliches KI-Modell zur ärztlichen Unterstützung. Das System verarbeitet Echtzeit-Video sowie Audio im direkten Patientengespräch und erzielt bei komplexen Diagnosefragen neue Bestwerte.

Präzision schlägt Konkurrenzmodelle

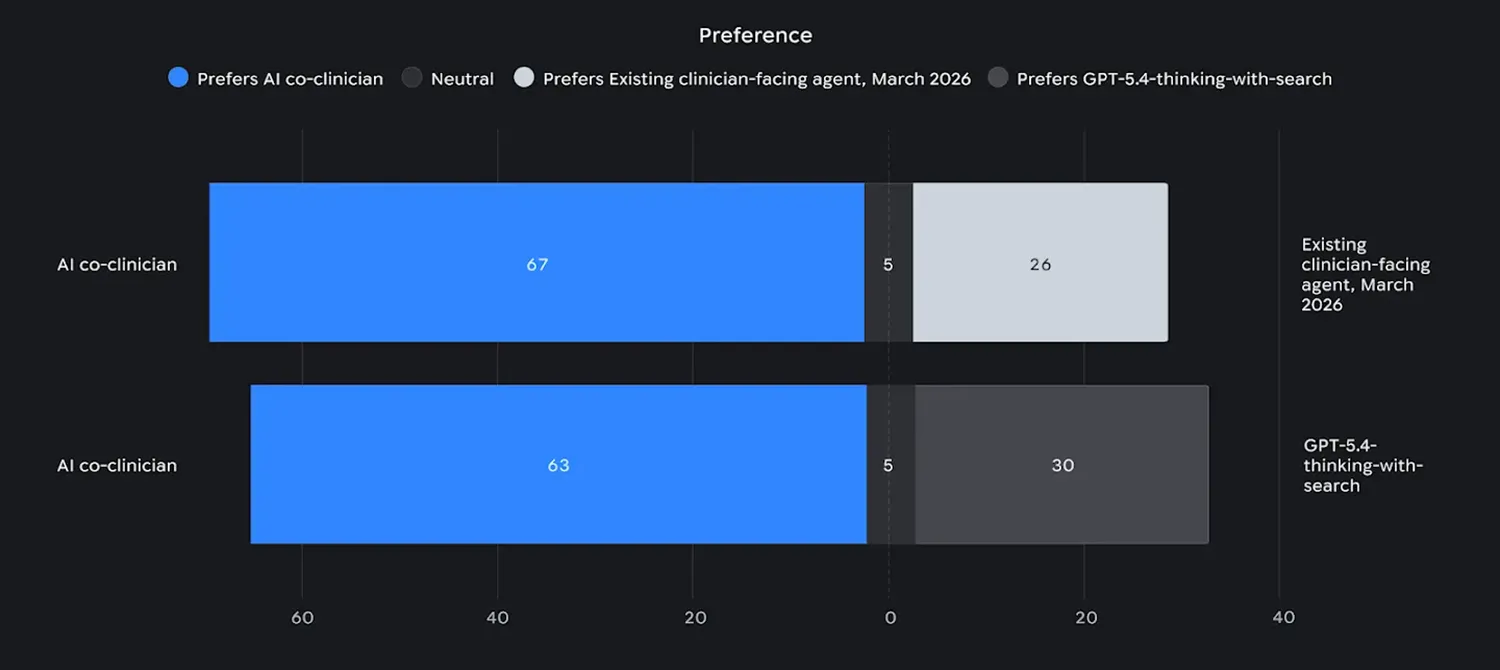

Zuverlässige Antworten bilden das absolute Fundament für den klinischen Einsatz. In einem blinden Testlauf mit 98 typischen Anfragen aus der Primärversorgung bewies der AI co-clinician eine enorm hohe Fakten-Treue. Das System produzierte in 97 untersuchten Fällen exakt null kritische Fehler. Unabhängige Fachärzte bevorzugten diese Resultate durchgängig gegenüber etablierten Programmen zur Informationsbeschaffung.

Quelle: Google

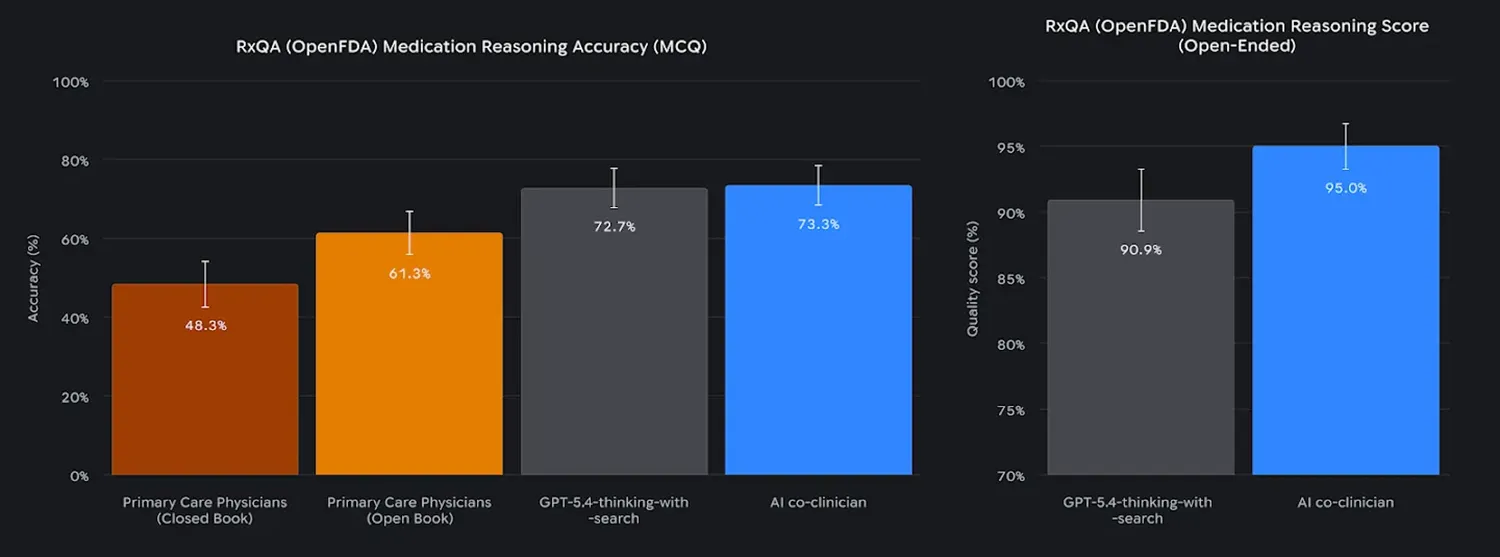

Besonders deutlich wird die Leistungsfähigkeit bei dem anspruchsvollen OpenFDA-Benchmark für Medikationswissen. Hier erreicht Googles Architektur bei offenen Fragestellungen einen beeindruckenden Wert von 95,0 Prozent. Das direkte Konkurrenzmodell GPT-5.4-thinking-with-search kommt im selben Szenario auf nur 90,9 Prozent. Auch bei geschlossenen Multiple-Choice-Fragen setzt sich der Neuling mit 73,3 Prozent an die Spitze, während praktizierende Hausärzte im Open-Book-Verfahren hier lediglich 61,3 Prozent erzielten.

Quelle: Google

Telemedizin durch multimodale Eingaben

Reine Text-Chats stoßen im medizinischen Alltag schnell an ihre Grenzen. Aus diesem Grund integriert DeepMind visuelle und akustische Fähigkeiten aus dem Project Astra in die Modellarchitektur. Anstatt nur Symptome abzutippen, verarbeitet das Programm in simulierten Telemedizin-Calls live die Video- und Audiosignale der Patienten.

Durch die Handykamera analysiert die KI beispielsweise die Atemtechnik bei der Nutzung eines Inhalators und korrigiert Anwendungsfehler in Echtzeit. Gleichzeitig führt das System Patienten verbal durch komplexe Bewegungsabläufe, um Schulterverletzungen aus der Ferne zu erkennen. Eine duale Agenten-Architektur kontrolliert dabei permanent den Dialog. Ein unsichtbarer Planer überwacht kontinuierlich den sprechenden Teil des Modells, um gefährliche Ratschläge strikt zu verhindern.

Das folgende Video zeigt keine echten Patienten, gibt aber einen guten Einblick:

Fachärzte dominieren bei kritischen Entscheidungen

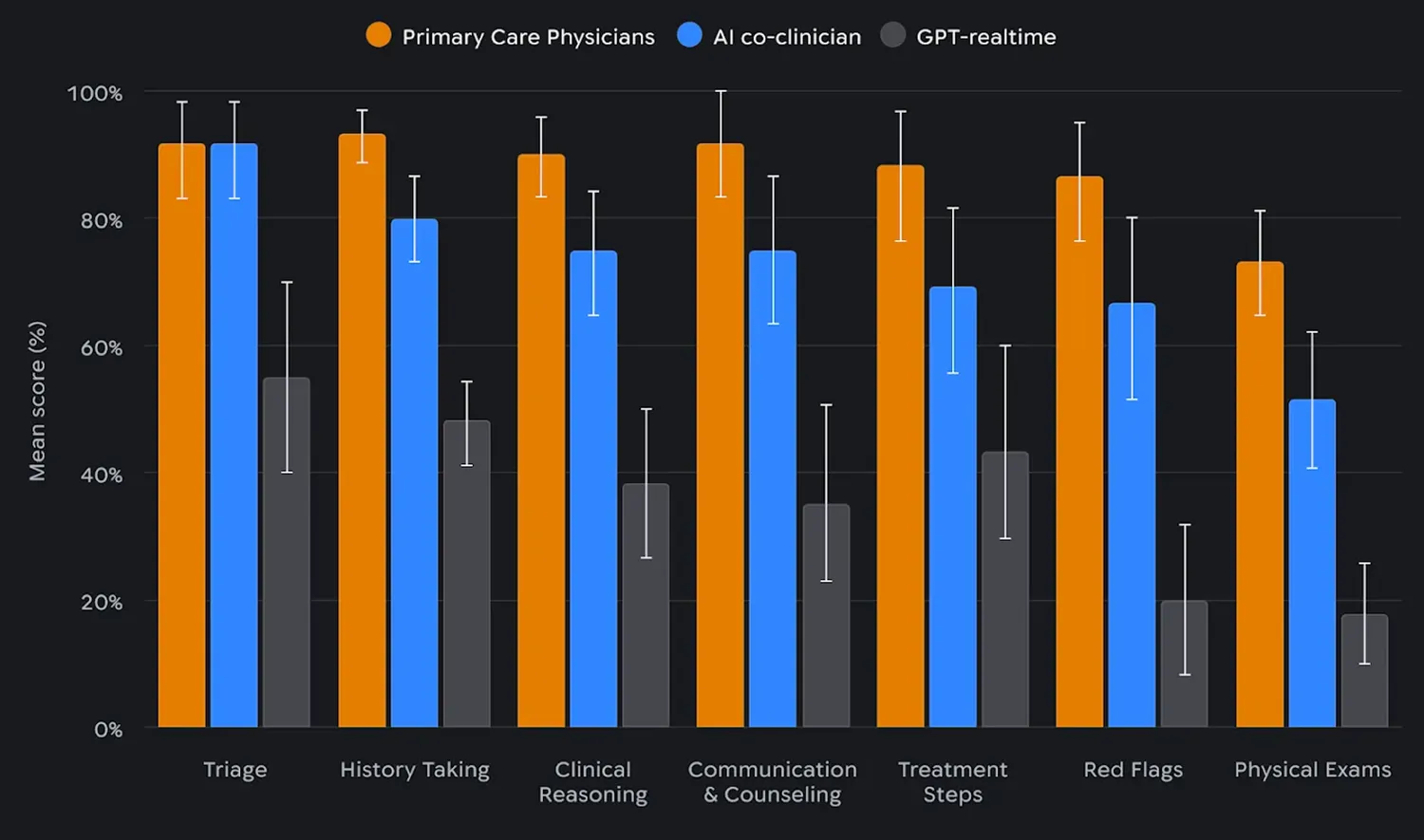

Hochwertige Simulationen relativieren jedoch die Vorstellung einer vollautonomen Maschine. In 120 standardisierten Szenarien maßen Forscher das Modell mit echten Hausärzten anhand von 140 strikten Qualitätskriterien. Das menschliche Fachpersonal lieferte insgesamt deutlich bessere und sicherere Ergebnisse ab.

Speziell bei der Identifikation von »Red Flags« sowie bei den Behandlungsschritten und der physischen Anamnese übertreffen die Mediziner das KI-Modell klar. Eine grafische Auswertung zeigt, dass die Ärzte in diesen essenziellen Kategorien konstante Spitzenwerte erzielen, während das System öfter wichtige Details übersieht. Lediglich bei der Ersteinschätzung, der sogenannten Triage, agieren Mensch und Maschine auf Augenhöhe.

Quelle: Google

Fokus liegt auf der Assistenz

Trotz der ärztlichen Überlegenheit belegen die Daten den enormen Nutzen als leistungsstarkes Assistenzsystem. In 68 der 140 untersuchten Bereiche erreichte das Programm das Niveau der Hausärzte oder übertraf dieses sogar leicht. Gegenüber reinen Audio-Modellen wie GPT-realtime zeigte sich Googles Entwicklung zudem in absolut allen Disziplinen weitaus fähiger.

Der Ansatz der sogenannten triagierten Versorgung rückt damit näher an die Realität heran. Ärzte lagern zeitraubende Voruntersuchungen aus, behalten aber bei sämtlichen Diagnosen die finale Entscheidungsgewalt. Testläufe in echten klinischen Umgebungen stehen in mehreren Ländern auf dem Programm.