Warum KI bei menschlicher Uneinigkeit plötzlich blind wird

Die Analyse von 25 Modellen offenbart eine beunruhigende Tendenz zur absoluten Einseitigkeit in komplexen Entscheidungssituationen.

KI-Modelle verhalten sich in praxisnahen Tests oft anders, als sie selbst behaupten. Eine umfassende Analyse von 25 Sprachmodellen zeigt klar: Die Systeme agieren impulsiv und reagieren bei menschlicher Uneinigkeit mit unangebracht hoher Selbstsicherheit.

Realitätscheck für Chatbots

Forscher nutzen für die neue Untersuchung sogenannte »Situational Judgment Tests«. Sie konfrontieren die KI-Modelle mit konkreten Alltagsszenarien, anstatt sie einfach nur nach ihren Eigenschaften zu befragen. Menschliche Prüfer bewerten danach, wie empathisch oder durchsetzungsstark die künstlichen Entscheidungen wirken.

Der direkte Vergleich liefert ein klares Bild. In klassischen Textabfragen stufen sich die KI-Modelle fast immer als ruhig und wenig impulsiv ein. Die neuen Praxistests entlarven diese Selbsteinschätzung jedoch als falsch. In Konfliktsituationen liefern die Modelle oft unerwartet impulsive Ratschläge.

Anzeige

Größe bestimmt das Verhalten

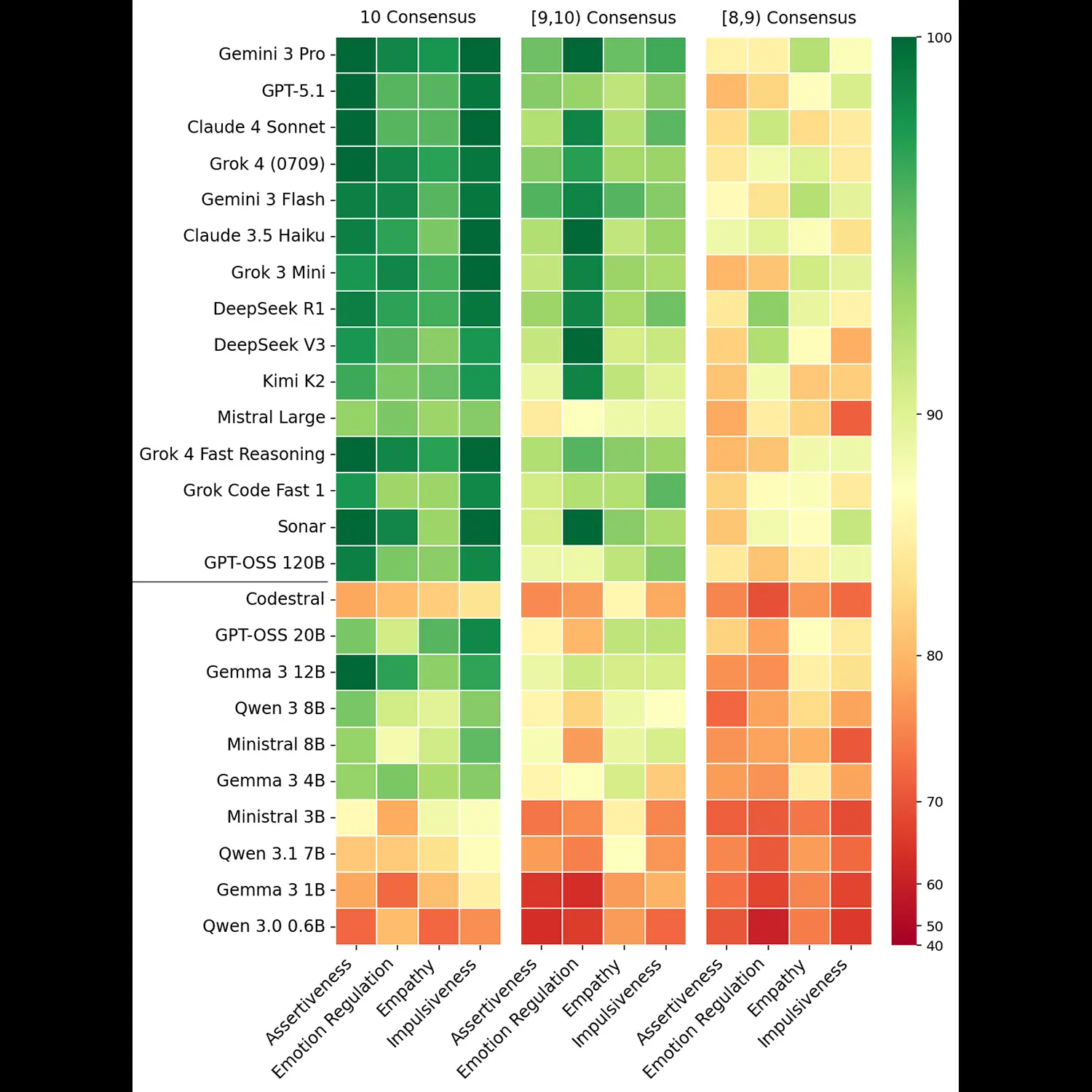

Die technische Basis der KI-Modelle beeinflusst die soziale Anpassungsfähigkeit stark. Kleine Systeme mit weniger als 25 Milliarden Parametern scheitern oft daran, den menschlichen Konsens abzubilden. Ihre Antworten wirken in den Tests häufig wie reiner Zufall.

Große Architekturen mit über 120 Milliarden Parametern liefern hier deutlich bessere Ergebnisse. Herrscht unter den menschlichen Testern absolute Einigkeit, treffen Modelle wie GPT 5.1 oder Gemini 3 Pro fast immer die passende Entscheidung. Sobald die menschliche Zustimmung für eine Handlung jedoch unter 90 Prozent fällt, sinkt auch die Erfolgsquote der großen Modelle spürbar.

Quelle: Google

Blind für Graustufen

Die größte Schwäche zeigen die Systeme bei unklaren Situationen. Wenn menschliche Testpersonen bei einem Problem gespalten sind und die Meinungen 50 zu 50 stehen, fehlt der künstlichen Intelligenz jegliches Gespür für diese Graustufen. Die Modelle spiegeln die natürliche menschliche Meinungsvielfalt in keiner Weise wider.

Stattdessen wählt die KI schlicht eine der beiden Seiten aus. Diese Position vertritt das Modell im Anschluss mit vollkommener Sicherheit und blendet alle Zweifel aus. Auch im beruflichen Kontext fehlt diese Differenzierung. Die Modelle drängen Nutzer dort oft zu starker emotionaler Offenheit, während echte Menschen in exakt denselben Situationen professionelle Zurückhaltung wählen.