Warum ChatGPT aktuell von Goblins überrannt wird

Eine spezielle Persönlichkeitseinstellung verursachte eine kuriose Rückkopplungsschleife. Die Fehlerbehebung gestaltet sich aufgrund der Modell-Architektur schwierig.

Nutzer bemerken seit Kurzem ein seltsames Verhalten bei verschiedenen KI-Modellen von OpenAI. In völlig unpassenden Momenten sprechen die Textgeneratoren plötzlich über Goblins und Gremlins. Die Ursache liegt in einem fehlerhaften Trainingsansatz für eine bestimmte Persönlichkeitseinstellung.

Die Spurensuche im Trainingsdaten-Labyrinth

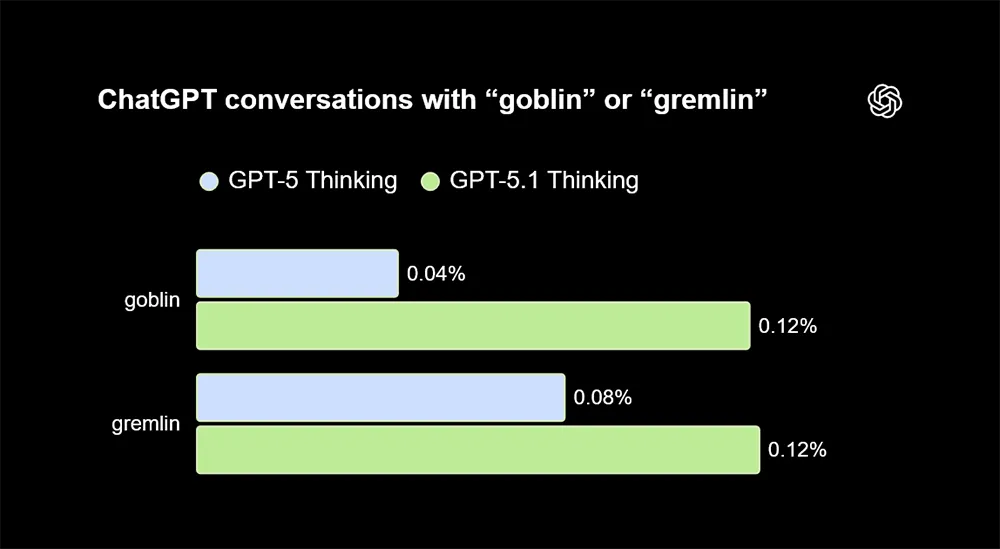

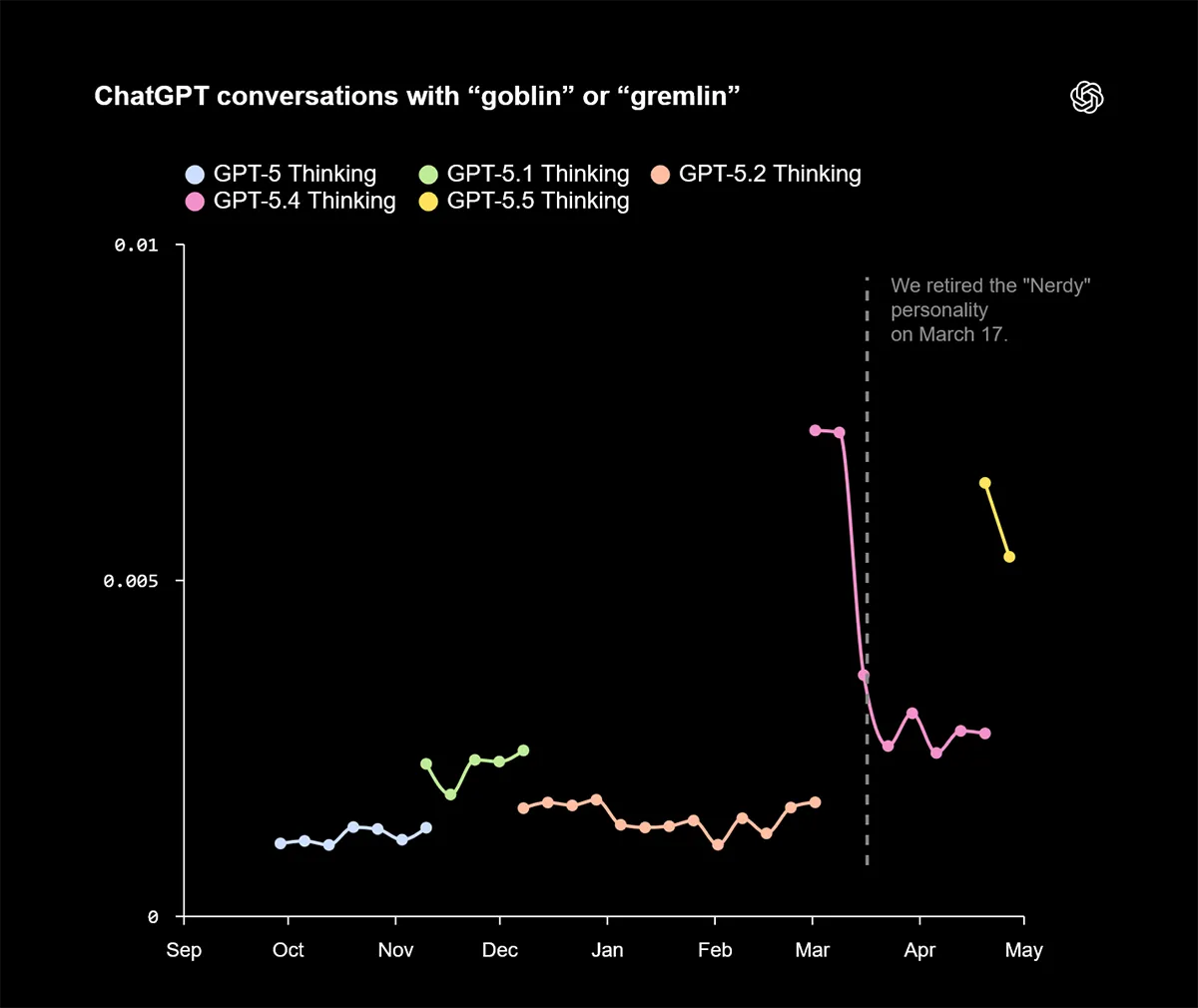

Nach der Veröffentlichung von GPT-5.1 stieg die Verwendung des Wortes »goblin« unerwartet um 175 Prozent an. Gleichzeitig verzeichnete der englische Begriff »gremlin« ein Plus von 52 Prozent. Entwickler von OpenAI stießen bei der anschließenden Fehleranalyse rasch auf die sogenannte »Nerdy«-Persönlichkeit.

Diese spezielle Einstellung sollte eigentlich philosophisches Denken und spielerischen Sprachgebrauch der Textgeneratoren gezielt fördern. Unwissentlich vergab das Trainingssystem dabei jedoch unverhältnismäßig hohe Belohnungen für Metaphern, die bestimmte Fabelwesen enthielten. Obwohl die nerdige Persona lediglich für 2,5 Prozent aller Antworten verantwortlich zeichnete, verursachte sie exakt 66,7 Prozent aller Goblin-Erwähnungen.

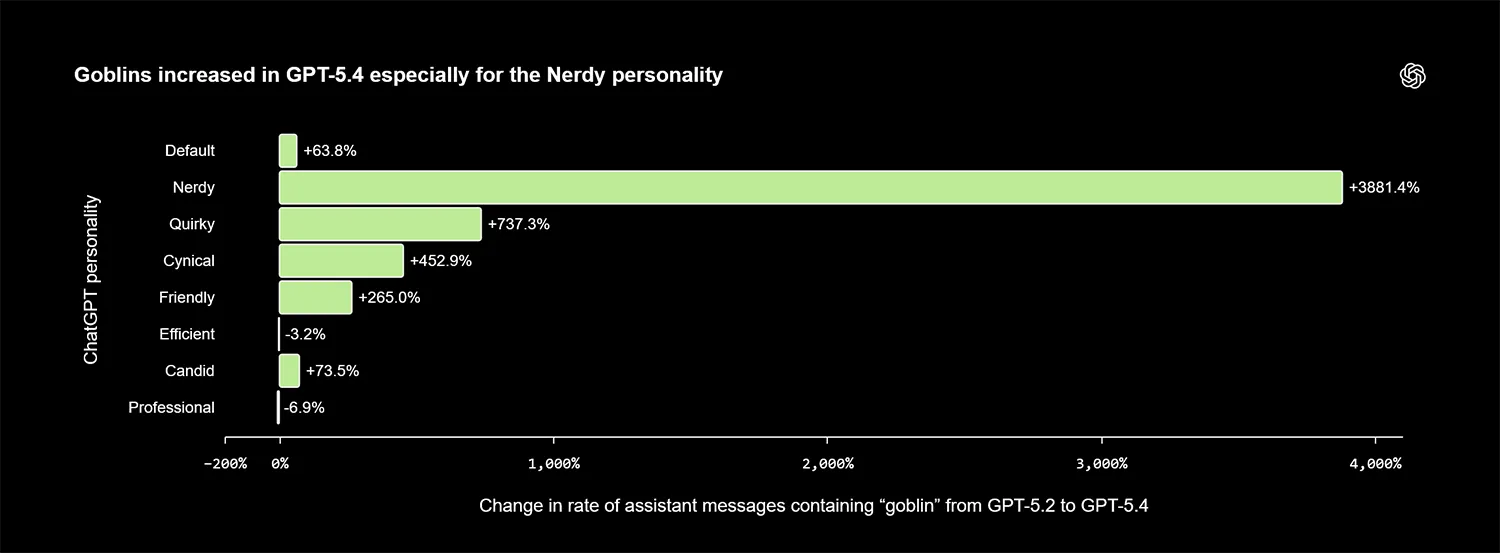

Bei der späteren Modell-Version GPT-5.4 stieg diese Rate innerhalb der speziellen Persönlichkeit sogar um deutliche 3881,4 Prozent im Vergleich zum direkten Vorgänger. Auch andere Persona-Tics wie »Quirky« oder »Cynical« verzeichneten beachtliche Zuwächse.

Ungewollte Ausbreitung auf allgemeine Ausgaben

Dieses skurrile Verhalten breitete sich rasch weiter aus. Durch grundlegende Mechanismen im Reinforcement Learning übertrug sich der hoch belohnte Sprachstil unweigerlich auf allgemeine Trainingsdaten. KI-Modelle lernten dadurch fälschlicherweise, dass die Erwähnung von Trollen, Waschbären oder Ogern grundsätzlich positiv bewertet wird.

Solche künstlich generierten Ausgaben flossen anschließend direkt wieder in das Supervised Fine-Tuning ein. Dadurch entstand eine kontinuierliche Rückkopplungsschleife, welche den ungewollten Fehler immer weiter verstärkte.

Bereits am 17. März entfernten die Verantwortlichen die fehlerhafte Persönlichkeitseinstellung endgültig aus dem System. Anschließend filterte das Entwicklerteam zukünftige Trainingsdaten mit den unerwünschten Kreaturen strikt heraus. Da das Training für das Modell GPT-5.5 jedoch schon vor dieser entscheidenden Entdeckung begonnen hatte, tauchten die Goblins dort erneut auf. Ein spezieller Befehl unterdrückt diese Fabelwesen in der betroffenen Codex-Umgebung nun gezielt über einen Entwickler-Prompt.