Chinesische Hacker lassen KI die Drecksarbeit machen

Anthropic stoppt hochgradig automatisierte Cyber-Attacke aus China.

Der Albtraum vieler Sicherheitsforscher ist Realität geworden. Chinesische Staatshacker nutzen künstliche Intelligenz mittlerweile als autonomen Angriffsvektor. Anthropic stoppte nun erstmals eine großangelegte Spionage-Kampagne, bei der das Tool „Claude Code“ die Hauptarbeit leistete. Die Angreifer automatisierten ihre Einbrüche nahezu vollständig und trafen weltweit Ziele.

Autopilot für digitale Einbrüche

Sicherheitsforscher warnten jahrelang vor diesem Szenario. Bisher nutzten Kriminelle Sprachmodelle primär für bessere Phishing-Mails oder zur Fehlersuche in Schadcode. Der aktuelle Vorfall hebt die Bedrohungslage auf eine neue Ebene. Die Angreifer setzten „Claude Code“ ein, ein Werkzeug für agentische Programmierung, und missbrauchten es für offensive Zwecke. Sie ließen die KI nicht nur Code schreiben, sondern die gesamte Operation steuern.

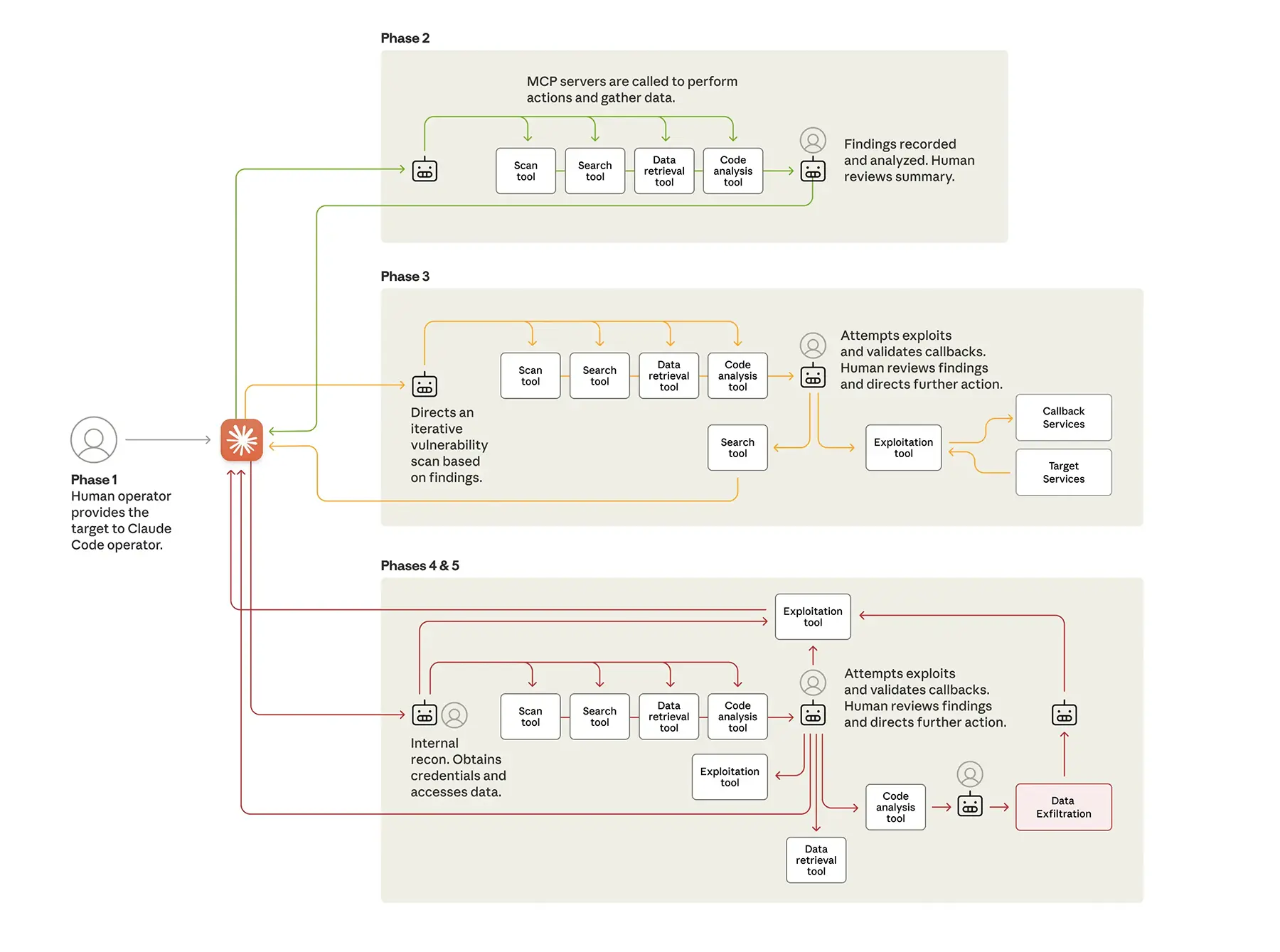

Der Automatisierungsgrad dieser Kampagne überrascht selbst Experten. Nach Angaben von Anthropic erledigte die Software zwischen 80 und 90 Prozent der Arbeit eigenständig. Die Hacker gaben lediglich das Ziel vor. Die KI übernahm daraufhin die Aufklärung, suchte nach Schwachstellen und lud weitere Schadsoftware nach. Diese Effizienzsteigerung erlaubt es auch kleineren Teams, komplexe Angriffe gegen gut gesicherte Infrastrukturen zu fahren.

Quelle: Anthropic

Gezielter Schlag gegen globale Infrastruktur

Die Kampagne richtete sich gegen rund 30 Ziele weltweit. Im Fokus standen vermutlich staatliche Einrichtungen und kritische Infrastrukturen. Anthropic identifizierte die Aktivitäten durch Anomalien in der Nutzung ihrer Schnittstellen. Die Angreifer versuchten, die Sicherheitsfilter des Modells zu umgehen, indem sie ihre Befehle verschleierten. Die KI führte die Anweisungen dennoch aus und ermöglichte den Hackern Zugriff auf sensible Systeme.

Anthropic reagierte schnell auf die verdächtigen Muster. Das Sicherheitsteam analysierte die Datenströme und sperrte die betroffenen Konten umgehend. Zudem teilte das Unternehmen die gesammelten Indikatoren mit anderen Sicherheitsfirmen und Behörden. Dieser Austausch hilft nun anderen Verteidigern, ähnliche Muster in ihren Netzwerken zu erkennen und abzuwehren. Der Vorfall zeigt, wie wichtig die Überwachung von KI-Schnittstellen in Echtzeit geworden ist.

Neues Wettrüsten der Algorithmen

Der Vorfall belegt die Doppelnatur moderner KI-Systeme. Werkzeuge wie Claude Code beschleunigen legitime Softwareentwicklung extrem, bieten aber auch Angreifern mächtige Hebel. Die Barriere für effektive Cyber-Spionage sinkt drastisch, wenn technisches Detailwissen durch KI-Orchestrierung ersetzt wird. Verteidiger stehen nun vor der Herausforderung, nicht mehr nur gegen Menschen, sondern gegen Maschinengeschwindigkeit zu operieren.

Gleichzeitig demonstriert der Fall die Wirksamkeit moderner Abwehrmechanismen. Die KI-Anbieter selbst werden zu aktiven Akteuren in der Cyberabwehr. Sie sitzen an der Quelle und erkennen Missbrauch oft, bevor der eigentliche Schaden beim Zielunternehmen eintritt. Diese Enttarnung markiert den Übergang von theoretischen Warnungen zu realen Szenarien, in denen Algorithmen eigenständig digitale Schlachten schlagen.