Samsungs 500-Dollar-KI deklassiert die Tech-Giganten

Ein winziges Modell mit nur 7 Millionen Parametern zeigt, wie fundamental falsch die Konkurrenz liegt.

Ein KI-Modell mit nur 7 Millionen Parametern stellt die Branchenriesen in den Schatten. Forscher von Samsung haben ein System entwickelt, das etablierte Modelle von Google und OpenAI bei komplexen Denkaufgaben übertrifft. Dieser Durchbruch beweist, dass eine intelligente Architektur rohe Rechenleistung schlagen kann und stellt den bisherigen Wettlauf um immer größere Modelle fundamental infrage.

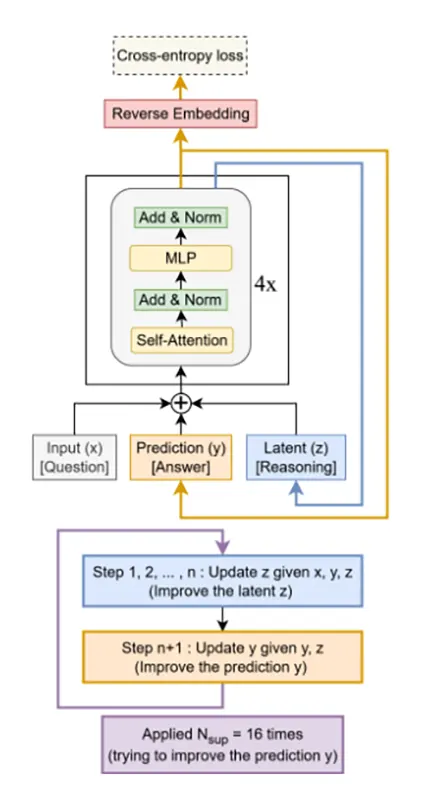

Das Geheimnis des rekursiven Denkens

Der Schlüssel zum Erfolg des "Tiny Recursive Model" (TRM) liegt in seiner Architektur. Statt wie herkömmliche Sprachmodelle Wort für Wort zu generieren, arbeitet das System in Schleifen. Es merkt sich die aktuell beste Lösung und führt parallel eine Art Notizzettel für Zwischenschritte. In jedem Durchgang verbessert es zuerst seine Notizen und optimiert anschließend die Gesamtlösung.

Dieser Prozess wiederholt sich bis zu 16 Mal in einem sogenannten Entwurf-Überarbeitungs-Zyklus. Das winzige Netzwerk korrigiert dadurch schrittweise seine eigenen Fehler. So erreicht es eine hohe Präzision bei komplexen Aufgaben, für die sonst massiv größere Modelle nötig wären.

Quelle: Samsung SAIL Montr´eal

Ein Gamechanger für die KI-Entwicklung

Die Effizienz des Modells zeigt sich eindrucksvoll in der Praxis. Bei extrem schweren Sudoku-Rätseln steigerte das System die Lösungsgenauigkeit auf über 87 Prozent. Auch bei der Navigation durch komplexe Labyrinthe erzielte es hervorragende Ergebnisse. Dieser Ansatz revolutioniert die Kostenseite der KI-Entwicklung.

Das gesamte Training des Modells dauerte nur zwei Tage auf vier handelsüblichen GPUs. Die Kosten dafür lagen bei unter 500 US-Dollar. Im Vergleich dazu benötigen die Billionen-Parameter-Modelle der Konkurrenz spezialisierte Chip-Cluster und verschlingen Millionen-Budgets. Der Ansatz von Samsung macht fortschrittliche KI damit für Start-ups, Universitäten und die lokale Anwendung auf Geräten zugänglich.

Grenzen und zukünftige Rolle

Die Stärken des TRM liegen klar in strukturierten Aufgaben mit definierten Regeln. Für offene, kreative oder textbasierte Anwendungen ist das System als nicht-generatives Modell ungeeignet. Die Forscher sehen es daher nicht als Ersatz für große Sprachmodelle, sondern als spezialisierten Baustein.

Zukünftige KI-Systeme könnten logische Probleme an solche effizienten Module auslagern. Währenddessen übernehmen die großen Modelle weiterhin die Sprachverarbeitung und Textgenerierung. Sollten sich die Ergebnisse in weiteren Tests bestätigen, markiert das TRM einen Wendepunkt. Der Fokus der KI-Forschung könnte sich von reiner Skalierung hin zu intelligenteren Architekturen verschieben.