DeepMind’s Gemma 3: Das kleine KI-Wunder, das Giganten besiegt

Kann eine schlanke KI-Architektur mit Giganten wie GPT-4 mithalten? DeepMind beweist, dass weniger manchmal mehr ist!

Flux Schnell | All-AI.de

EINLEITUNG

Die Entwicklung künstlicher Intelligenz schreitet rasend schnell voran, doch bislang benötigten Spitzenmodelle oft enorme Ressourcen. Mit Gemma 3 schlägt Google DeepMind nun einen anderen Weg ein: Kleine Modelle mit beeindruckender Leistung, die sogar auf einzelnen GPUs oder TPUs laufen können. Aber wie schafft es Google, mit vergleichsweise kompakten Modellen die mächtige Konkurrenz hinter sich zu lassen?

NEWS

Effiziente Modelle, große Wirkung

Die neuen Gemma-3-Modelle variieren in ihrer Größe zwischen 1 und 27 Milliarden Parametern, dennoch zeigen sie beeindruckende Ergebnisse. Schon das kleinste Modell übertrifft laut Google DeepMind in ersten Tests sogar deutlich umfangreichere Wettbewerber wie Llama-405B und DeepSeek-V3. Der Schlüssel liegt in einer durchdachten Architektur und effizienten Trainingsmethoden, die es ermöglichen, diese Modelle selbst auf Hardware mit eingeschränkter Leistung einzusetzen.

Ein Modell für die ganze Welt

Gemma 3 zeichnet sich besonders durch seine beeindruckende Vielseitigkeit aus. Die Modelle unterstützen mehr als 140 Sprachen, von denen 35 sogar ohne zusätzliches Training fließend beherrscht werden. Zudem sind sie multimodal, können also neben Text auch Bilder (ab 4B-Modell) und kurze Videos verarbeiten, und dies mit einem außergewöhnlich großen Kontextfenster von 128.000 Token. Damit öffnen sich zahlreiche Anwendungsmöglichkeiten – von der Echtzeit-Übersetzung über intelligente Bildanalyse bis hin zur komplexen Videoauswertung.

Clevere Optimierung durch Destillation und KI-Training

Google DeepMind setzte bei der Entwicklung von Gemma 3 auf intelligente Optimierungsstrategien wie Destillation und gezieltes Reinforcement Learning. Durch diese Verfahren verbesserten sich insbesondere die Leistungen der Modelle bei mathematischen Aufgaben, im Chatbetrieb, bei der präzisen Befolgung von Anweisungen und in der Mehrsprachigkeit erheblich. So konnte trotz reduzierter Größe eine Qualität erreicht werden, die selbst große Konkurrenzmodelle in den Schatten stellt.

Quantisierung macht Modelle zugänglicher

Eine Premiere bei Gemma 3 ist Googles offizielles Angebot quantisierter Modellvarianten. Diese speziellen Versionen reduzieren den Speicher- und Rechenbedarf deutlich, ohne die Genauigkeit spürbar einzuschränken. Dadurch sind diese leistungsfähigen Modelle erstmals breitflächig auf Geräten einsetzbar, die bislang von derartigen KI-Anwendungen ausgeschlossen waren – eine klare Ansage in Richtung Demokratisierung der künstlichen Intelligenz.

Leistungsstark im direkten Vergleich

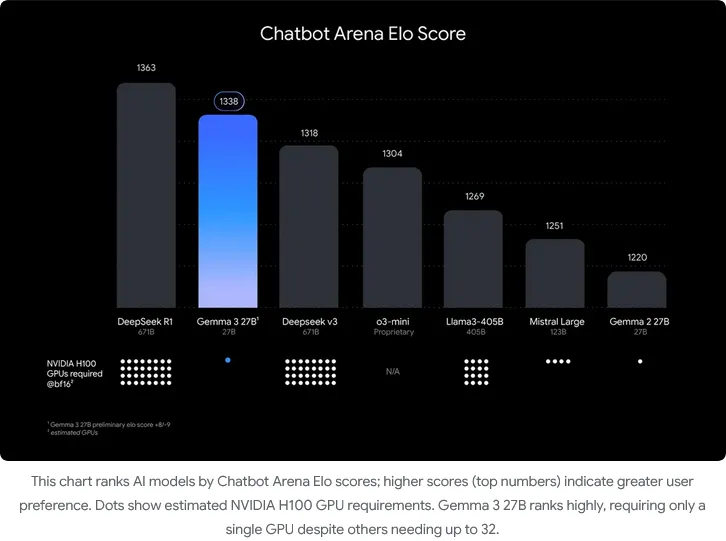

In unabhängigen menschlichen Tests der Chatbot-Arena glänzt insbesondere das Gemma 3-27B-IT-Modell, das einen Elo-Score von 1338 erreicht und somit direkt unter den Top 10 der aktuell stärksten KI-Modelle landet. Beeindruckend ist, dass bereits das 4-Milliarden-Modell auf Augenhöhe mit dem deutlich größeren Gemma 2-27B-IT-Modell konkurriert. Das größte Modell der Reihe wiederum misst sich souverän mit Googles Spitzenmodell Gemini-1.5-Pro und bestätigt damit eindrucksvoll, dass klein nicht schwach bedeuten muss.

Quelle: Google

Breite Unterstützung und Verfügbarkeit

Entwickler können die Gemma-3-Modelle über populäre Plattformen wie Hugging Face, Kaggle oder Google AI Studio nutzen. Unterstützt werden gängige Frameworks wie PyTorch, JAX und Keras. Für die akademische Forschung stellt Google zudem Cloud-Credits im Wert von 10.000 US-Dollar im Rahmen des Gemma 3 Academic Program bereit – ein klares Zeichen der Unterstützung für Innovation und Forschung im KI-Bereich.

AUSBLICK

KI für alle – jetzt greifbarer denn je

Gemma 3 zeigt eindrucksvoll, wie leistungsstarke künstliche Intelligenz auch ohne riesige Ressourcen funktionieren kann. Mit der Möglichkeit, diese Modelle selbst auf begrenzter Hardware zu betreiben, könnte KI-Technologie endlich deutlich zugänglicher werden. Besonders spannend sind die vielfältigen Anwendungsmöglichkeiten in unterschiedlichen Sprachen und Medienformaten, die zukünftig noch mehr innovative und global einsetzbare KI-Anwendungen hervorbringen dürften.

UNTERSTÜTZUNG

Hat dir ein Artikel gefallen oder ein Tutorial geholfen? Du kannst uns weiterhelfen, indem du diese Seite weiterempfiehlst, uns auf Youtube abonnierst oder dich per Paypal an den Serverkosten beteiligst. Wir sind für jede Unterstützung dankbar. Danke.

KURZFASSUNG

- Google DeepMind stellt mit Gemma 3 ein kompaktes, aber extrem leistungsfähiges KI-Modell vor, das auf kleineren GPUs läuft.

- Dank innovativer Optimierungsstrategien übertrifft das Modell in Benchmarks sogar größere Konkurrenten wie Llama 405B.

- Die Vielseitigkeit ist beeindruckend: Unterstützung für 140 Sprachen, Multimodalität und ein riesiges Kontextfenster.

- Durch Quantisierung wird Gemma 3 für mehr Geräte zugänglich, was KI-Technologie weiter demokratisiert.

- Mit ShieldGemma 2 bringt Google zudem ein Sicherheitsmodell zur Analyse von Bildinhalten auf den Markt.