Warum Programmierer Claude mehr Freiraum geben müssen

Anthropic veröffentlicht neue Richtlinien für die performante Integration seiner aktuellen Modelle.

Künstliche Intelligenz entwickelt sich schneller, als Programmierer ihre Anwendungen anpassen. Anthropic-Mitgründer Chris Olah betont, dass KI-Modelle der Claude-Reihe »eher wachsen als gebaut werden«. Starre Code-Gerüste blockieren daher zunehmend die Leistungsfähigkeit der Systeme.

Weniger Steuerung, mehr Autonomie

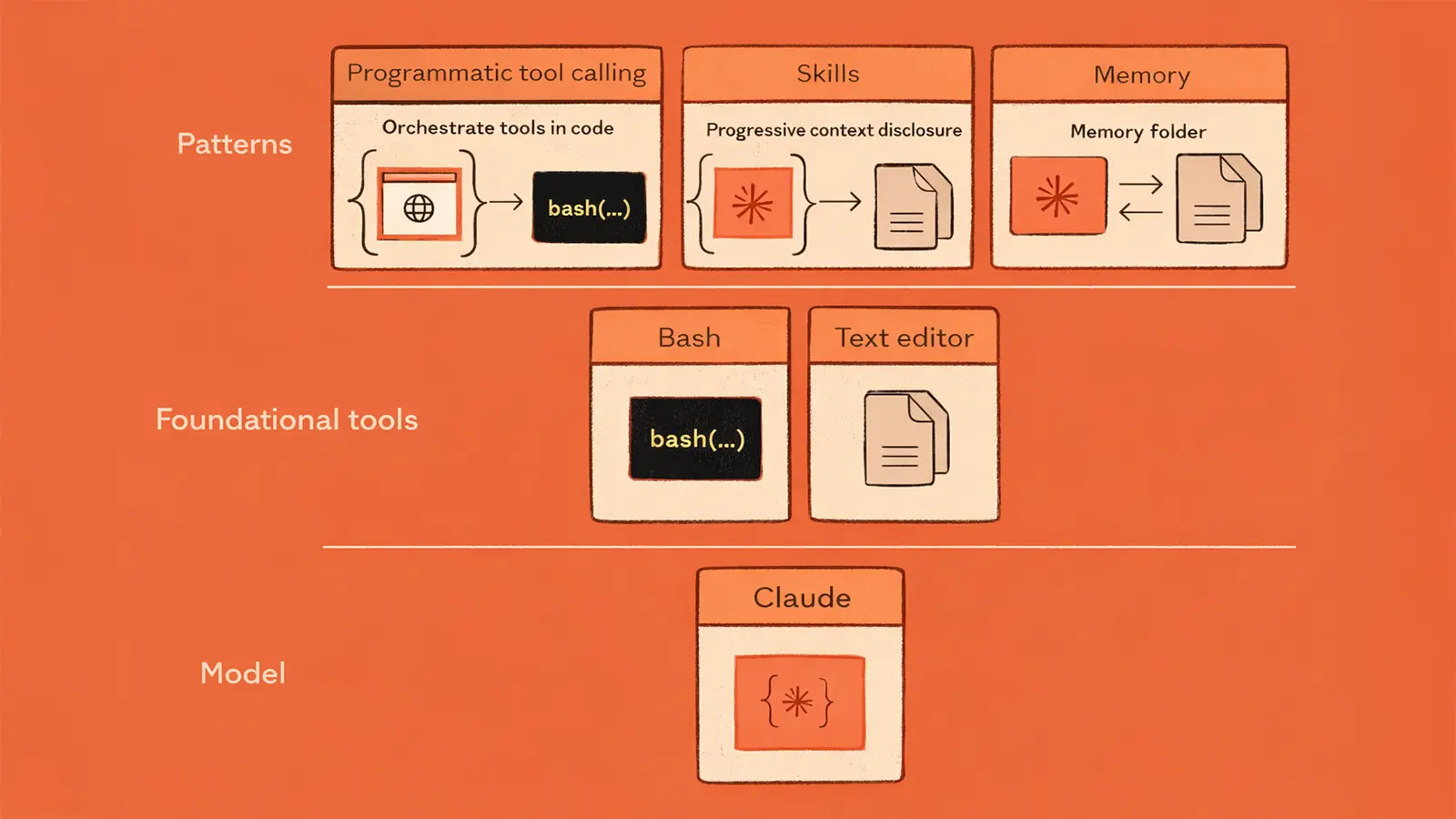

Entwickler neigen dazu, KI-Modelle strikt zu reglementieren. Das provoziert oft langsame und teure Prozesse, da die Anwendung jedes Ergebnis direkt durch das Kontextfenster des Modells zwingt. Anthropic empfiehlt stattdessen, Claude die Orchestrierung komplett selbst zu überlassen.

Geben Programmierer dem Modell direkte Ausführungsumgebungen wie Bash, entscheidet die KI eigenständig, welche Daten sie filtert oder für den nächsten Schritt nutzt. Diese Autonomie steigerte die Genauigkeit des Modells Opus 4.6 in einem Web-Browsing-Benchmark von 45,3 Prozent auf 61,6 Prozent.

Anzeige

Intelligentes Gedächtnis statt starrer Prompts

Klassische Prompts stoßen bei komplexen Anforderungen schnell an ein Limit. Das ständige Laden von spezifischen Instruktionen frisst das Token-Budget auf und reduziert die Aufmerksamkeit der KI-Modelle. Moderne Systeme umgehen dies durch modulare Fähigkeiten, die Claude bei Bedarf selbstständig abruft.

Gleichzeitig strukturiert die KI ihr Langzeitgedächtnis mittlerweile verblüffend analytisch. Während das Modell Sonnet 3.5 in einem Testlauf des Spiels Pokémon lediglich Dialoge protokollierte, agiert Opus 4.6 streng strategisch. Das aktuelle Modell legte im gleichen Test nach 14.000 Schritten zehn Dateien in geordneten Verzeichnissen an und dokumentierte taktische Erkenntnisse aus eigenen Fehlern.

Feste Vorgaben für Sicherheit und Kosten

Trotz dieser Unabhängigkeit bleiben feste Grenzen unverzichtbar. Anthropic rät dazu, riskante Aktionen wie externe API-Aufrufe an strikte Bestätigungsmechanismen durch den Nutzer zu koppeln. Spezifische Tools garantieren hier die Sicherheit der Anwendung.

Eine clevere Strukturierung der Anfragen senkt zudem die Betriebskosten drastisch. Zwischengespeicherte Token kosten nur ein Zehntel der regulären Eingabe-Token. Entwickler maximieren diese Ersparnis, indem sie statische Systemanweisungen konsequent zuerst laden und den Wechsel zwischen verschiedenen Modellen während einer Sitzung strikt vermeiden.