Nvidia NemoClaw sichert OpenClaw-Agenten ab

Autonome KI-Agenten erledigen Aufgaben künftig komplett eigenständig. Nvidias neues System sorgt für die nötige Sicherheit im Netzwerk.

Autonome KI-Systeme planen und handeln künftig völlig selbstständig. Nvidia bringt mit dem neuen Software-Stack NemoClaw nun eine sichere Basis für das OpenClaw-Ökosystem und flankiert diese Architektur mit zwei extrem leistungsstarken Desktop-Rechnern für lokale KI-Entwickler.

Kontrolle für eigenständige Code-Arbeiter

KI-Anwendungen verändern sich aktuell grundlegend. Moderne Systeme warten nicht mehr nur auf einen simplen Prompt, sondern agieren als autonome Agenten. Sie schreiben Software-Code, rufen externe APIs ab, werten Daten aus und optimieren ihre eigenen Ergebnisse kontinuierlich.

Um diese dauerhaft aktiven OpenClaw-Assistenten technisch abzusichern, veröffentlicht Nvidia den neuen Open-Source-Stack NemoClaw. Dieser bündelt verschiedene Anwendungen und installiert eine sichere Laufzeitumgebung namens OpenShell.

Hier bestimmen Programmierer exakt, welche Rechte die Agenten im System besitzen. Die Software legt klare und strikte Grenzen fest, auf welche sensiblen Unternehmensdaten die Künstliche Intelligenz zugreift. Dadurch verhindern Firmen effektiv, dass ein autonomer Agent unkontrollierte Aktionen in einem proprietären Firmennetzwerk ausführt.

Anzeige

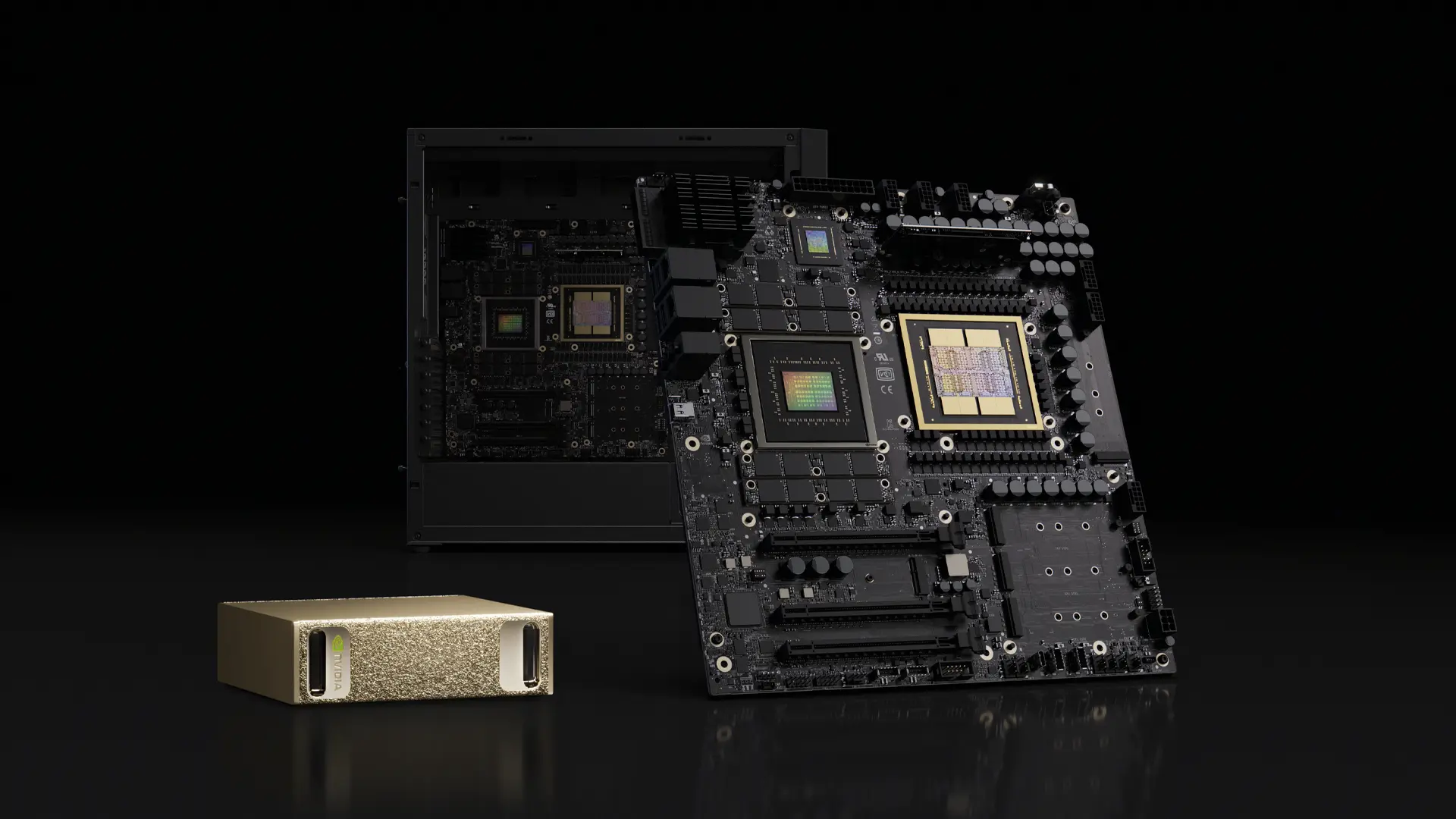

Lokale Rechenpower am Schreibtisch

Solche selbstlernenden Agenten beanspruchen beim Training enorm viel Rechenleistung. Genau für diesen Zweck liefert Nvidia nun die neue DGX Station aus. Der Hersteller platziert das System als Hochleistungsrechner direkt am physischen Arbeitsplatz der Programmierer.

Das Herzstück bildet der neue GB300 Grace Blackwell Ultra Desktop Superchip. Über die schnelle NVLink-C2C-Verbindung koppelt Nvidia eine Recheneinheit mit 72 Kernen direkt an den Grafikchip. Entwickler greifen so auf 748 Gigabyte zusammenhängenden Arbeitsspeicher und eine Rechenleistung von bis zu 20 Petaflops zu.

Mit dieser Hardware-Basis führen Ingenieure riesige Open-Source-Modelle mit bis zu einer Billion Parametern lokal aus. Das System unterstützt zudem vollständig isolierte Umgebungen ohne jegliche Internetanbindung. Firmen aus stark regulierten Branchen wie dem Finanzsektor oder dem Gesundheitswesen schützen auf diese Weise ihre vertraulichen Daten während der Programmierung. Hardware-Partner wie Asus, Dell und Gigabyte nehmen bereits die ersten Bestellungen für die Geräte entgegen.

Quelle: Nvidia

Nahtloser Wechsel auf die großen Server

Für kleinere Entwicklerteams bietet der Konzern zusätzlich das Modell DGX Spark an. Dieses kompakte System integriert sich flexibel in normale Büroumgebungen und liefert ausreichend Leistung für das Prototyping.

Bei stark steigendem Leistungsbedarf schalten Techniker bis zu vier Spark-Rechner direkt zusammen. Sie erstellen dadurch ein kleines Rechenzentrum im Großraumbüro. Nvidia stattet die Rechner ab Werk mit der kompletten KI-Softwareumgebung aus. Nutzer starten etablierte Open-Source-Modelle wie Google Gemma 3, Mistral Large oder Nvidias eigenes Nemotron direkt nach der Inbetriebnahme.

Wenn ein lokaler Agent schließlich fehlerfrei funktioniert, verschieben die Programmierer den fertigen Code einfach auf die großen Serverfarmen im Rechenzentrum. Eine aufwendige Umschreibung der Software entfällt komplett, da die zugrundeliegende Architektur vom Schreibtisch bis zum Großrechner absolut identisch bleibt. Entwickler bringen ihre Anwendungen dadurch deutlich schneller in den produktiven Betrieb.