Claude Code: 5 Strategien für große Kontextfenster

Millionen Token bieten enormen Platz, bringen aber technische Hürden. Spezielle Befehle ordnen den Speicher des Modells neu.

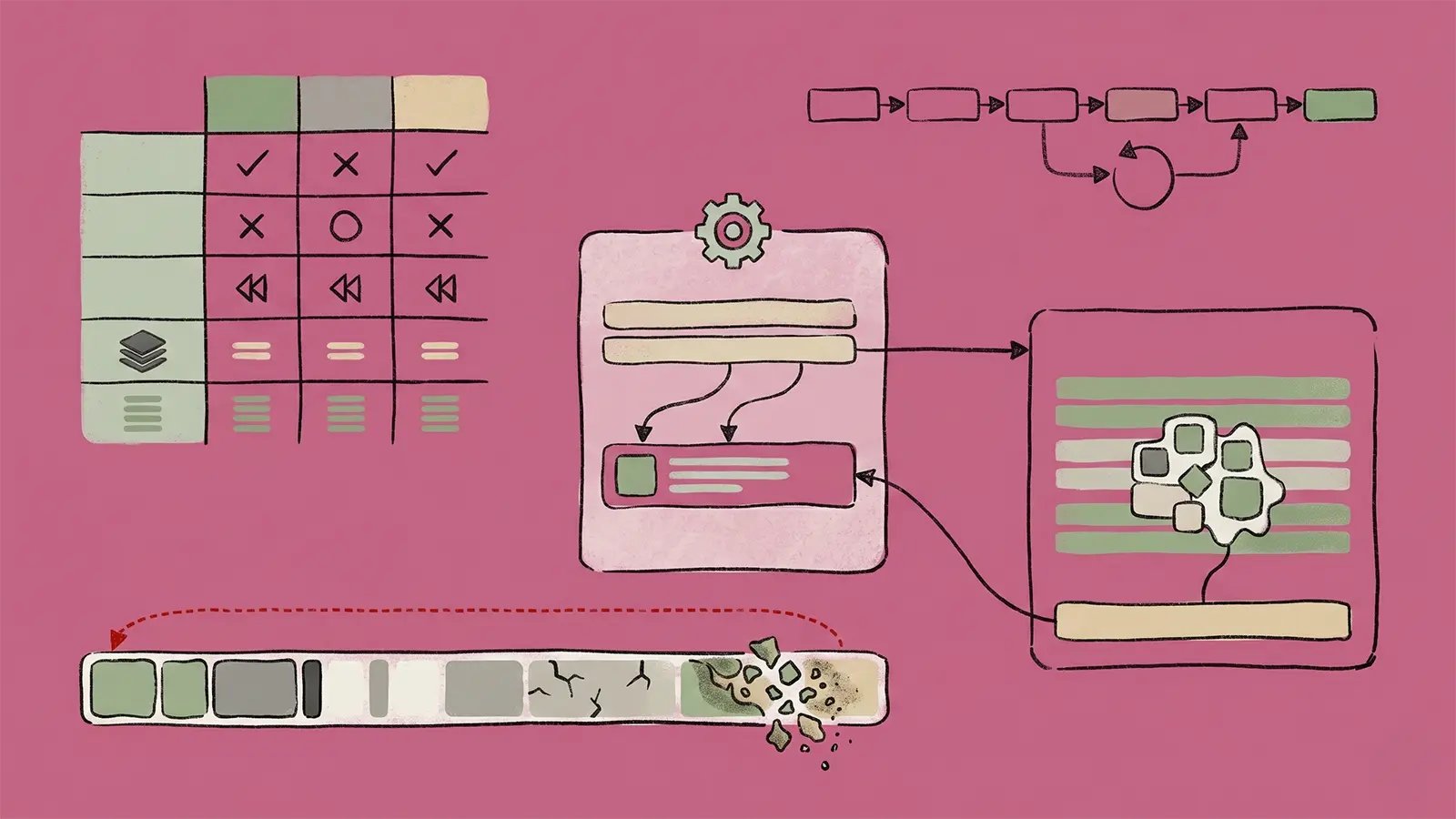

Ein neues Update für Claude Code bringt den Befehl »/usage« für eine präzise Nutzungsübersicht. Gleichzeitig erfordert das erweiterte Kontextfenster von einer Million Token klare Strategien, um Leistungsabfälle der KI-Modelle bei komplexen Aufgaben zu verhindern. Diese 5 Möglichkeiten werden vorgestellt:

Quelle: Anthropic

Das Kontextfenster und sein Leistungsabfall

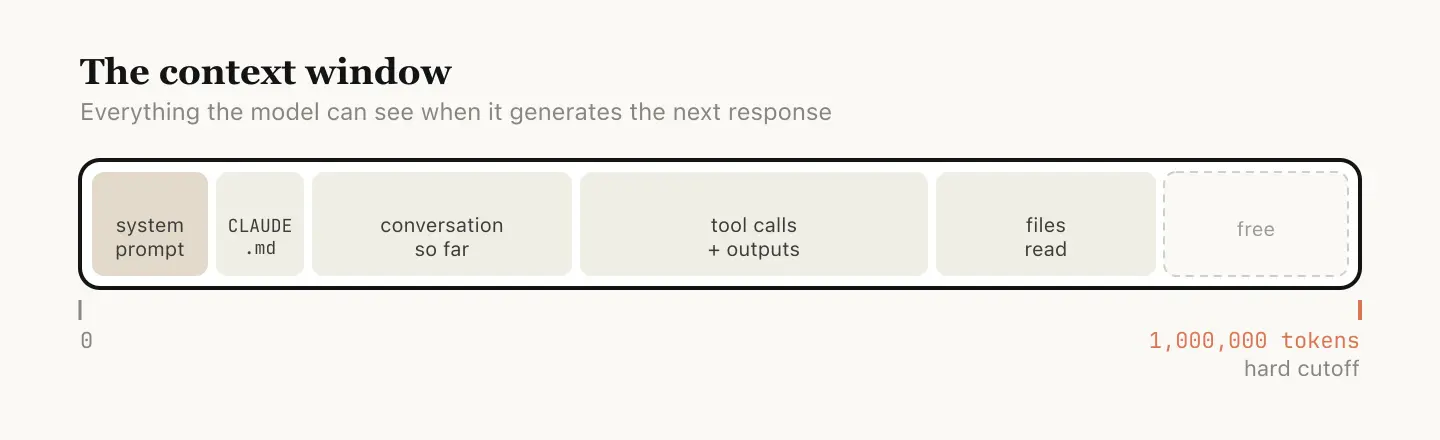

Das Kontextfenster definiert, welche Informationen ein KI-Modell gleichzeitig verarbeitet. Claude Code erfasst hierbei bis zu eine Million Token. Diese gewaltige Datenmenge setzt sich aus System-Prompts, bisherigen Unterhaltungen sowie allen eingelesenen Dateien zusammen.

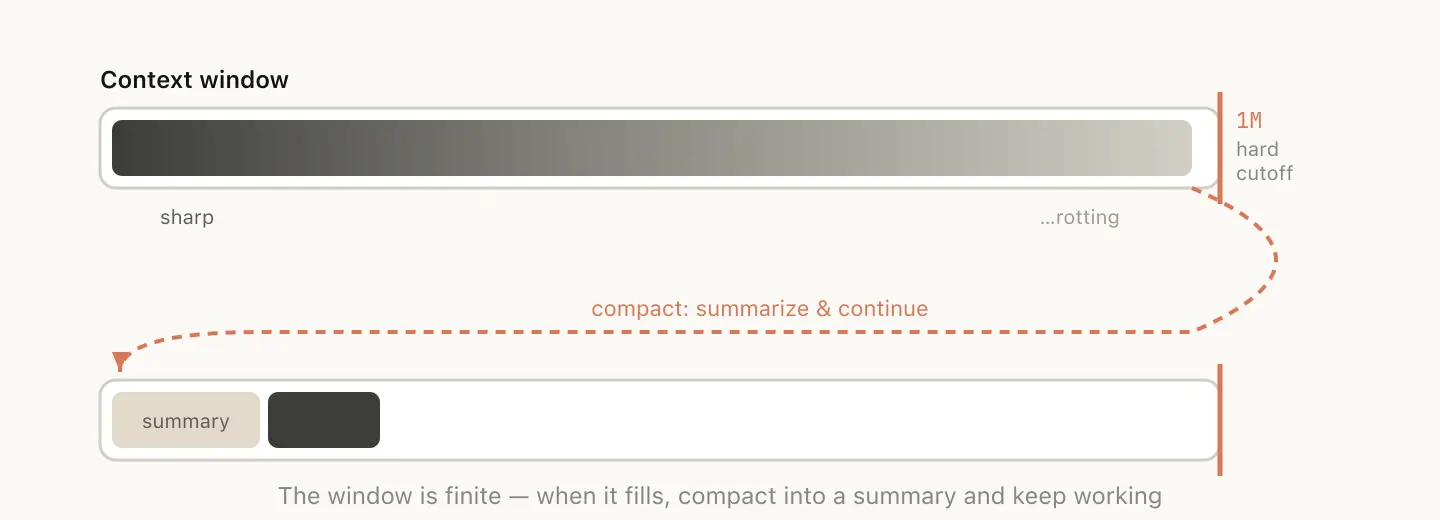

Eine extrem hohe Auslastung verursacht jedoch ein Phänomen, welches Fachleute »Context Rot« nennen. Die Leistung sinkt spürbar, da das System seine Aufmerksamkeit auf zu viele Token verteilt. Ältere Inhalte lenken das Modell zunehmend von der eigentlich aktuellen Aufgabe ab.

Um diesem Effekt entgegenzuwirken, greift ein Automatisierungsmechanismus. Sobald das harte Speicherlimit naht, fasst das System den bisherigen Verlauf selbstständig zusammen. Alternativ stoßen Nutzer diesen Vorgang manuell an, um den Speicher aktiv freizuräumen.

Quelle: Anthropic

Navigationstools nach jeder Antwort

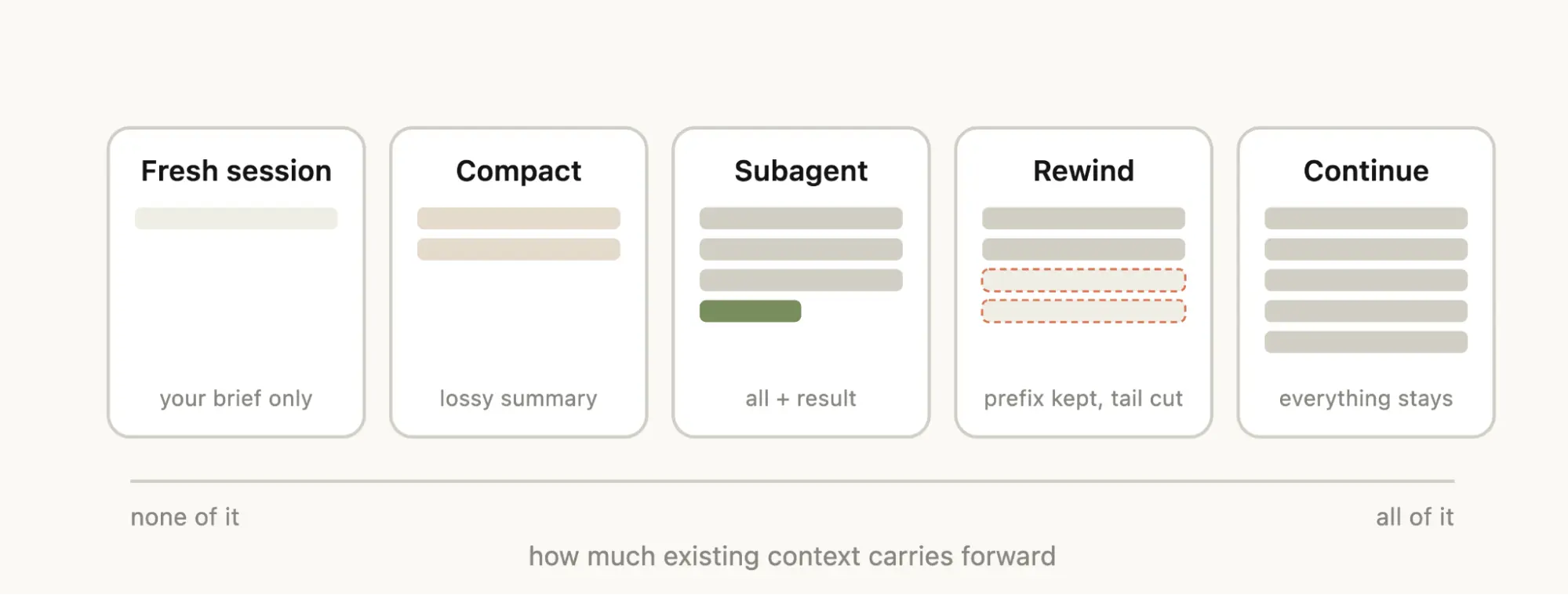

Nach jeder generierten Antwort des Systems stehen verschiedene Wege offen. Neben der reinen Fortsetzung der Unterhaltung existieren spezifische Optionen zur Speicherverwaltung. Dazu zählen das Zurückspulen, das Starten einer frischen Session, das manuelle Zusammenfassen oder das Auslagern an Sub-Agenten.

Grundsätzlich gilt eine einfache Regel. Für jede völlig neue Aufgabe empfiehlt sich der Start einer gänzlich neuen Session. Zwar bewältigen die KI-Modelle durch die Million Token auch umfangreiche Projekte wie die Entwicklung kompletter Anwendungen, dennoch droht bei zu langen Verläufen der Context Rot.

Lediglich bei sehr eng verwandten Aufgaben lohnt sich das Behalten des alten Kontexts. Das Modell greift direkt auf bereits bekannte Daten zurück und muss Quellcode nicht erneut einlesen. Das spart wertvolle Zeit und reduziert die Berechnungskosten.

Quelle: Anthropic

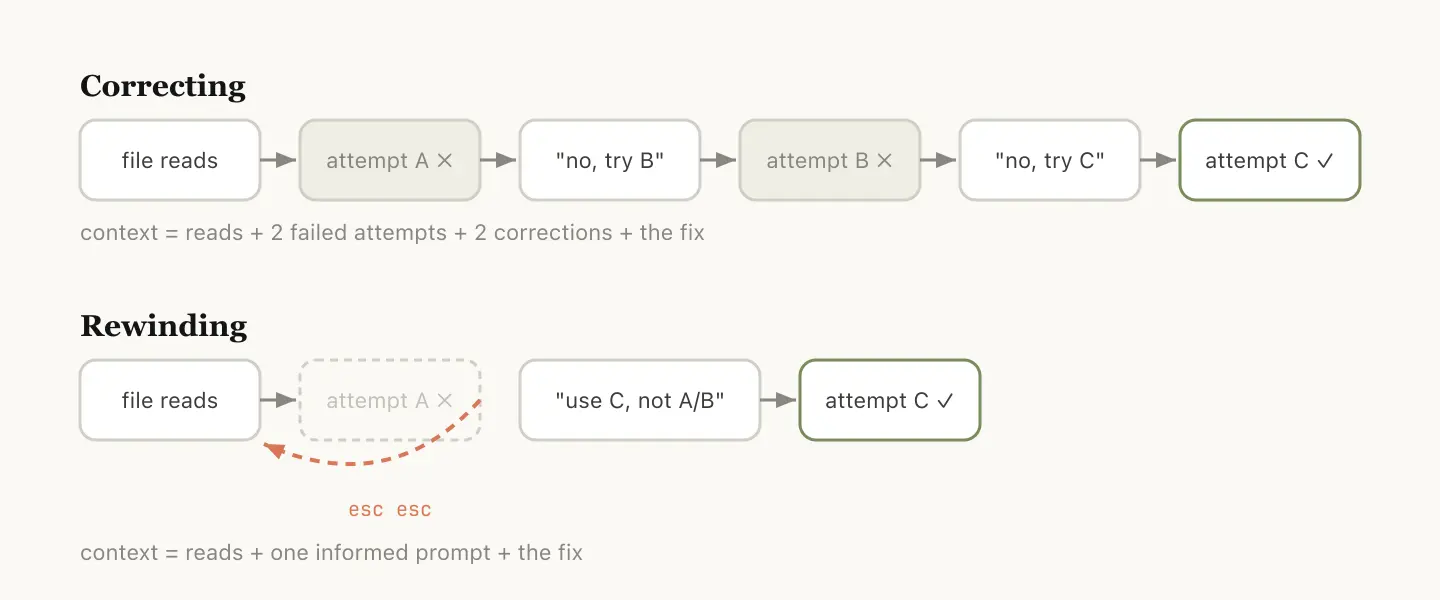

Zurückspulen statt Korrigieren

Anstatt Fehlversuche durch lange textliche Korrekturanweisungen zu beheben, erweist sich das gezielte Zurückspulen oft als deutlich effektiver. Der Befehl »/rewind« ermöglicht den präzisen Sprung zu einer bestimmten vorherigen Nachricht im Verlauf.

Alle darauffolgenden Eingaben und Fehler verschwinden restlos aus dem Kontext. Das Modell erhält so die Chance, mit einer leicht angepassten Anweisung direkt einen völlig anderen Lösungsweg einzuschlagen.

Nutzer umgehen durch diesen Schritt die Gefahr, dass der gescheiterte Versuch den zukünftigen Fokus der KI stört. Eine kurze Zusammenfassung der wichtigsten Erkenntnisse vor dem eigentlichen Zurückspulen optimiert den Neustart zusätzlich.

Quelle: Anthropic

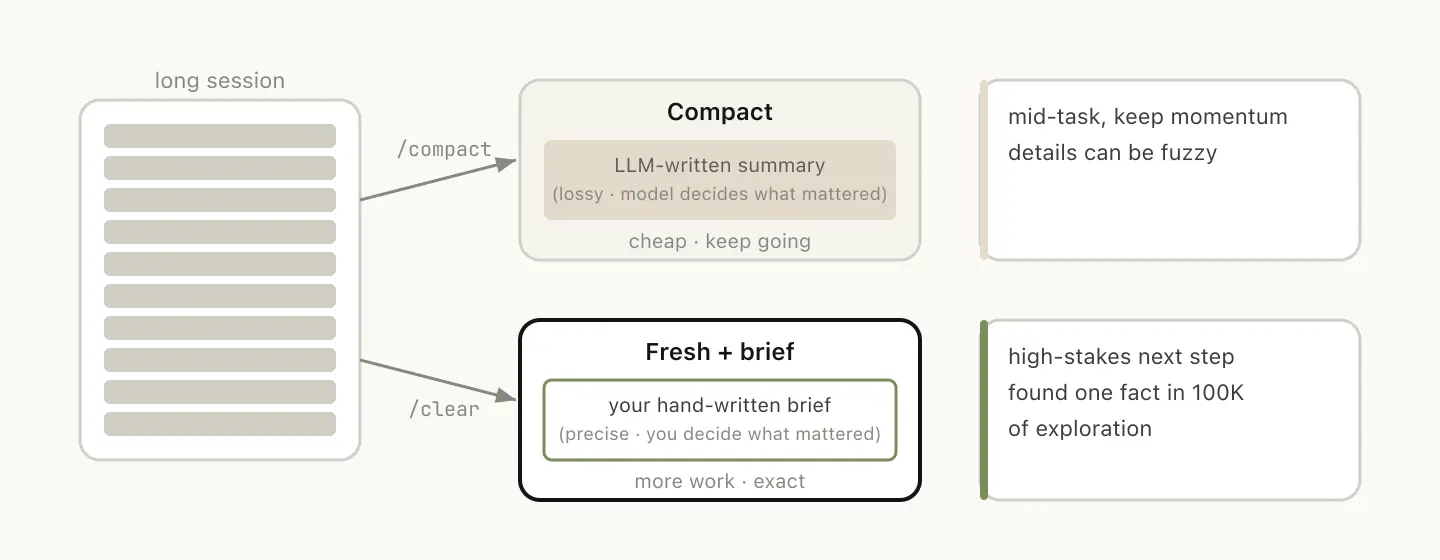

Verlauf zusammenfassen oder komplett bereinigen

Bei sehr langen und unübersichtlichen Unterhaltungen reduzieren bestimmte Befehle die Datenlast. Die Funktion »/compact« bittet das Modell um eine Zusammenfassung und ersetzt den bisherigen Chat-Verlauf damit. Dies funktioniert schnell, führt naturgemäß aber zu einem leichten Informationsverlust.

Fehlgeleitete automatische Zusammenfassungen entstehen meist an harten inhaltlichen Übergängen. Wechselt der Fokus plötzlich von einer langen Fehlersuche zu einer völlig neuen Code-Anpassung, übersieht das Modell oft das neue Ziel. Genau vor einer solchen Zusammenfassung agiert das System aufgrund des extrem vollen Speichers am unzuverlässigsten.

Der Befehl »/clear« startet stattdessen eine komplett saubere Oberfläche. Dies erfordert zwar eine manuell geschriebene Übergabenachricht durch den Anwender, bietet dafür aber die absolute Kontrolle über den übernommenen Kontext.

Quelle: Anthropic

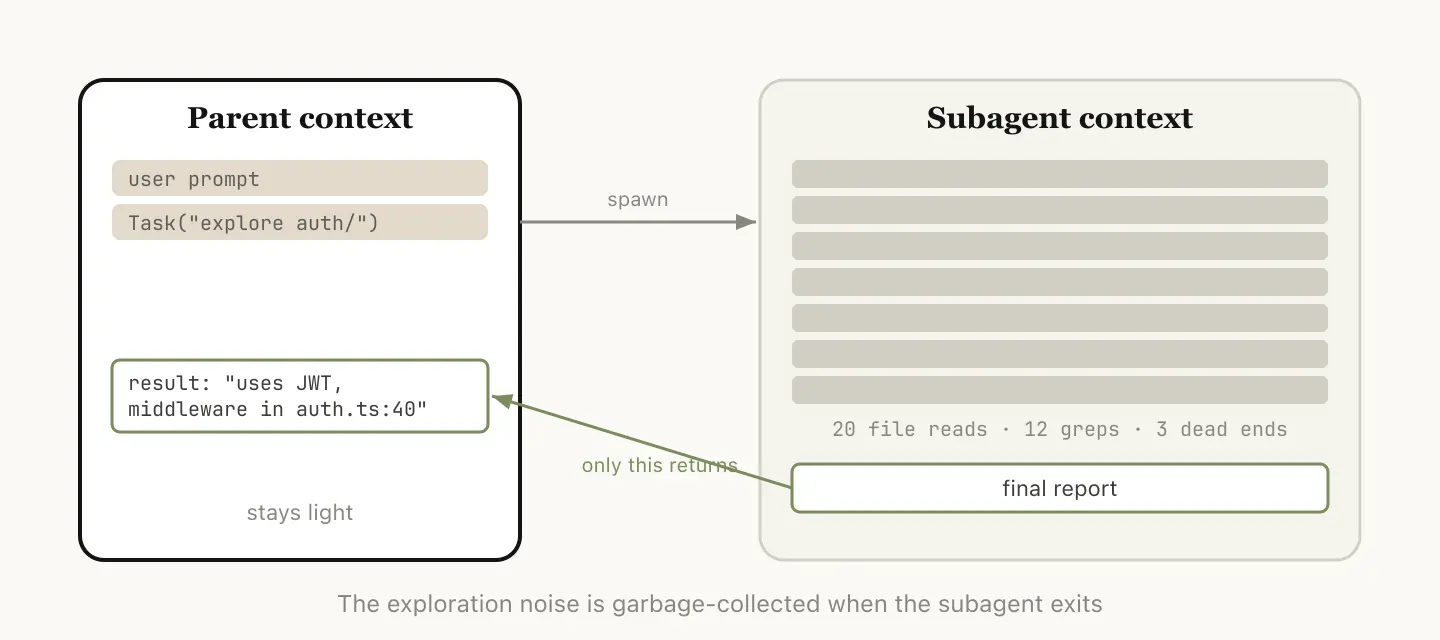

Der effiziente Einsatz von Sub-Agenten

Bestimmte Arbeitsschritte erzeugen viele Zwischenergebnisse, die im Anschluss nicht mehr benötigt werden. Für exakt solche Fälle initiieren Anwender Sub-Agenten mit einem komplett leeren Kontextfenster.

Diese Agenten führen die isolierte Aufgabe aus und übermitteln nach Abschluss lediglich das finale Resultat an den Hauptprozess zurück. Typische Anwendungsfälle umfassen die Verifizierung von Code oder das Schreiben einer neuen Dokumentation.

Anwender lagern ressourcenintensive Zwischenschritte so gezielt aus und halten den Hauptspeicher frei. Alle genannten Befehle zur detaillierten Session-Steuerung stehen in Claude Code ab sofort zur Verfügung.