Black Forest Labs: Neues Self-Flow-Verfahren halbiert KI-Trainingszeit

Eine neue Trainingsmethode beschleunigt die Entwicklung generativer KI-Modelle für Bild, Video und Audio deutlich und spart Rechenressourcen.

Das KI-Unternehmen Black Forest Labs hat mit "Self-Flow" eine neue Trainingsmethode für generative KI-Modelle vorgestellt. Das Verfahren beschleunigt das Training für Bild-, Video- und Audiogenerierung deutlich und macht externe Hilfsmodelle komplett überflüssig.

Anzeige

Effizientes Training ohne externe Lehrer

Flow Matching hat sich als technisches Fundament für moderne KI-Modelle etabliert. Der Algorithmus formt dabei aus scheinbar zufälligem Rauschen schrittweise klare Bilder oder Töne. Das Training solcher Systeme verschlingt in der Praxis jedoch immense Rechenleistung.

Bisherige Ansätze zur Beschleunigung, wie das sogenannte Representation-Aligned Flow Matching (REPA), setzen daher auf externe, bereits fertig trainierte Modelle. Diese "Teacher" geben dem trainierenden "Student"-Modell eine feste Orientierung, um schneller korrekte Ergebnisse zu erzielen. Für visuelle Aufgaben kam hier oft DINOv2 zum Einsatz, für Audio das Modell MERT. Dieser Ansatz bindet jedoch zusätzliche Ressourcen. Gleichzeitig erfordert er für jeden Medientyp ein exakt passendes Hilfsmodell, was die Entwicklung verkompliziert.

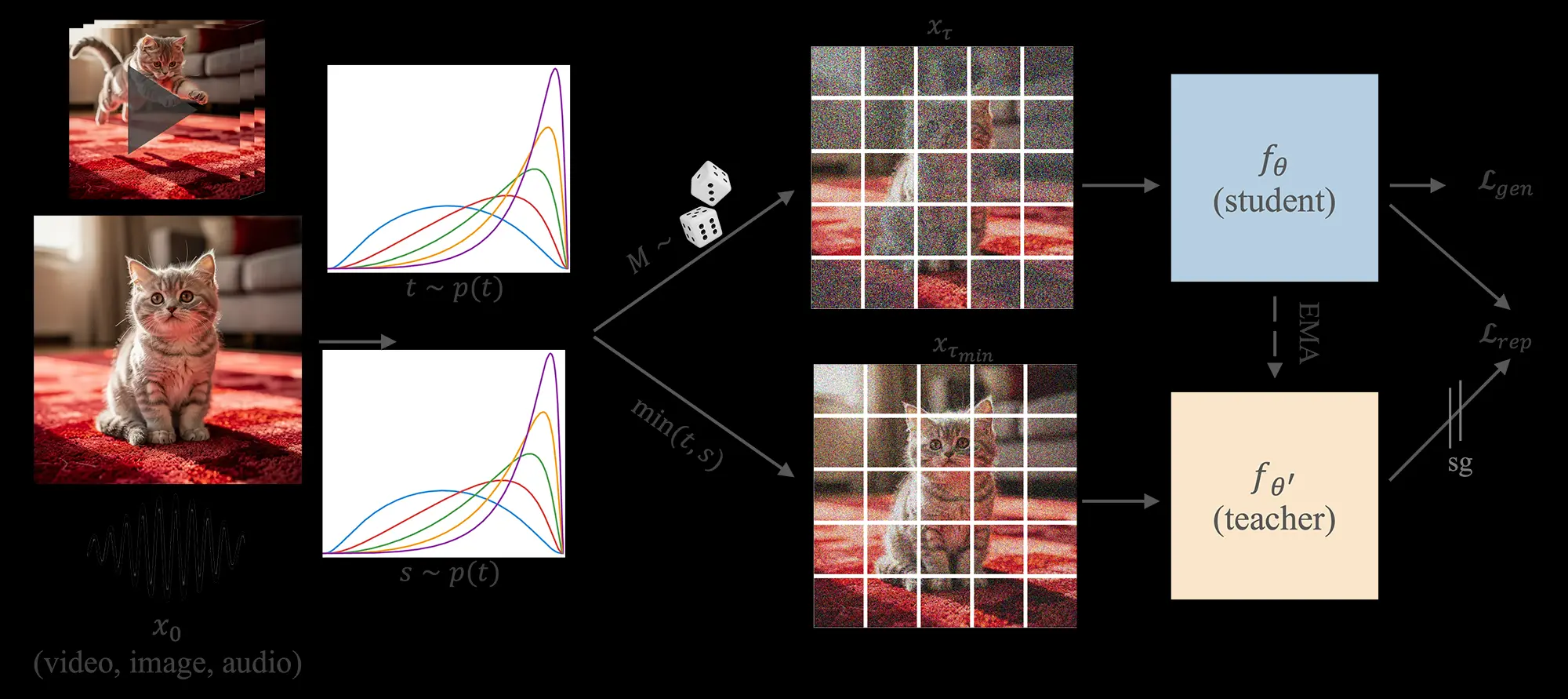

Self-Flow löst dieses Problem nun durch einen intelligenten internen Lernprozess. Das System erstellt während des Trainings kontinuierlich eine zeitlich verzögerte Kopie des eigenen Modells, die sogenannte Exponential Moving Average (EMA). Diese minimal ältere, aber stabilere Kopie übernimmt kurzerhand die Rolle des Lehrers. Das Modell berechnet einen Fehlerwert zwischen seinen aktuellen Vorhersagen und den Repräsentationen der EMA-Kopie. Dadurch bringt sich das Modell die optimalen Strukturen der Daten effektiv selbst bei, ohne auf externe Parameter angewiesen zu sein.

Quelle: Black Forrest

Messbare Leistungssprünge über alle Medien

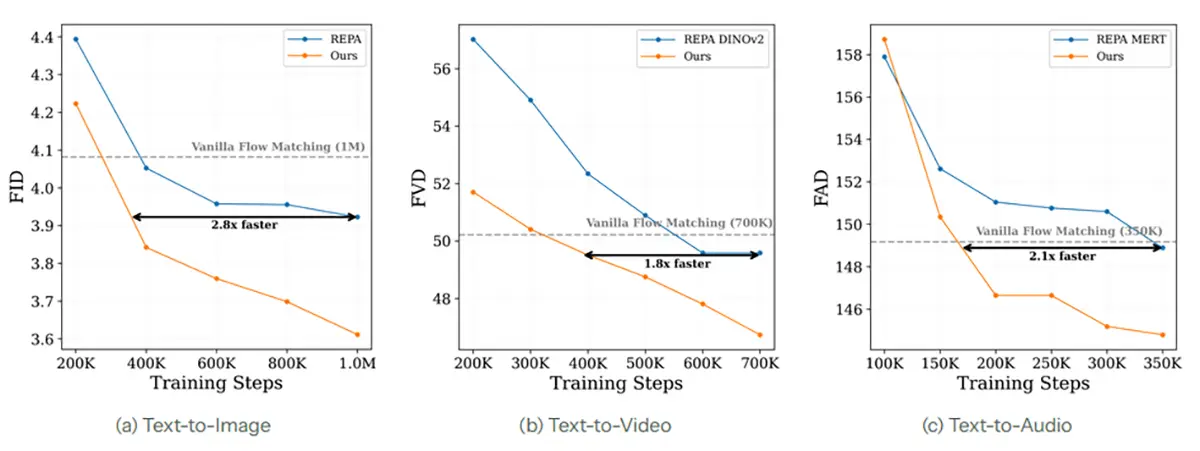

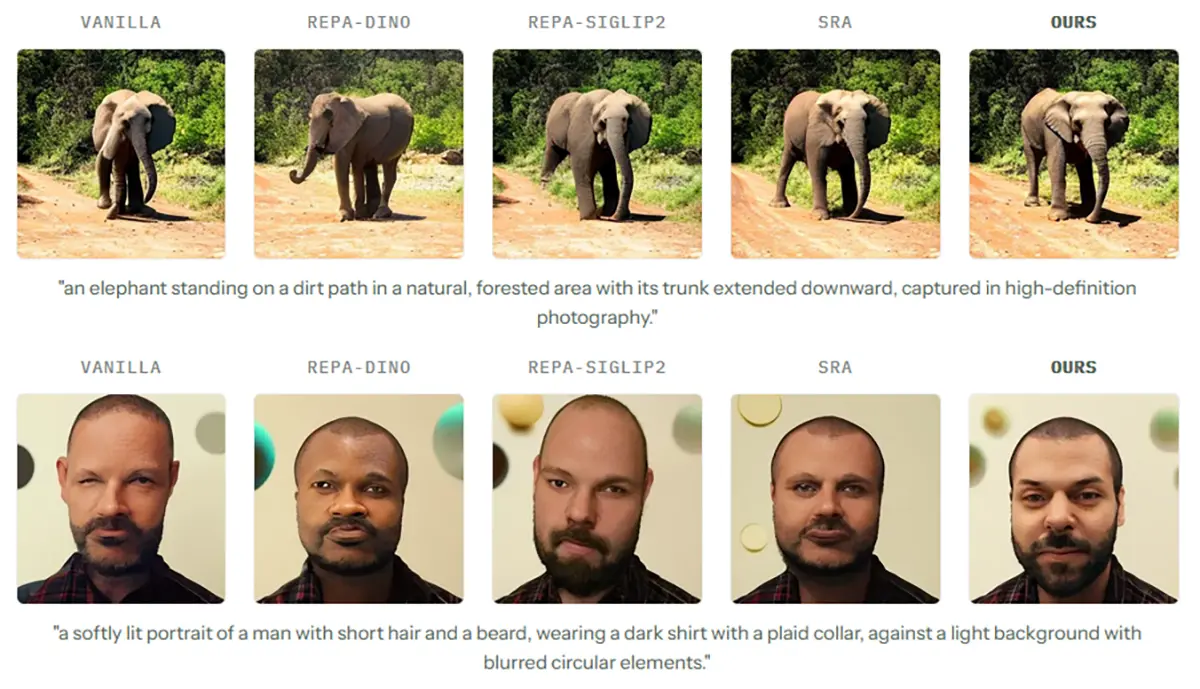

Die Entwickler belegen die Effizienz von Self-Flow anhand verschiedener Benchmarks für unterschiedliche Datentypen. Bei der Text-to-Image-Generierung erreicht das neue Verfahren das Qualitätsniveau von klassischem Flow Matching 2,8-mal schneller.

Auch bei Bewegtbild und Ton zeigt sich der architektonische Vorteil. Bei Text-to-Video-Aufgaben verzeichnet Black Forest Labs eine 1,8-fache Beschleunigung gegenüber dem Standardverfahren. Im Bereich Audio arbeitet die Methode 2,1-mal schneller.

Zudem übertrifft Self-Flow die bisherige REPA-Methode bei gleicher Anzahl an Trainingsschritten in allen drei Kategorien sichtbar. Die Qualität der generierten Inhalte steigt, was sich an etablierten Metriken wie dem Frechet Inception Distance (FID) Wert für Bilder klar ablesen lässt. Die neue Methode vereinfacht die Entwicklung zukünftiger KI-Architekturen spürbar. Forscher benötigen deutlich weniger Rechenzeit und eine weit weniger komplexe Software-Infrastruktur, um leistungsstarke multimodale Modelle aufzubauen.