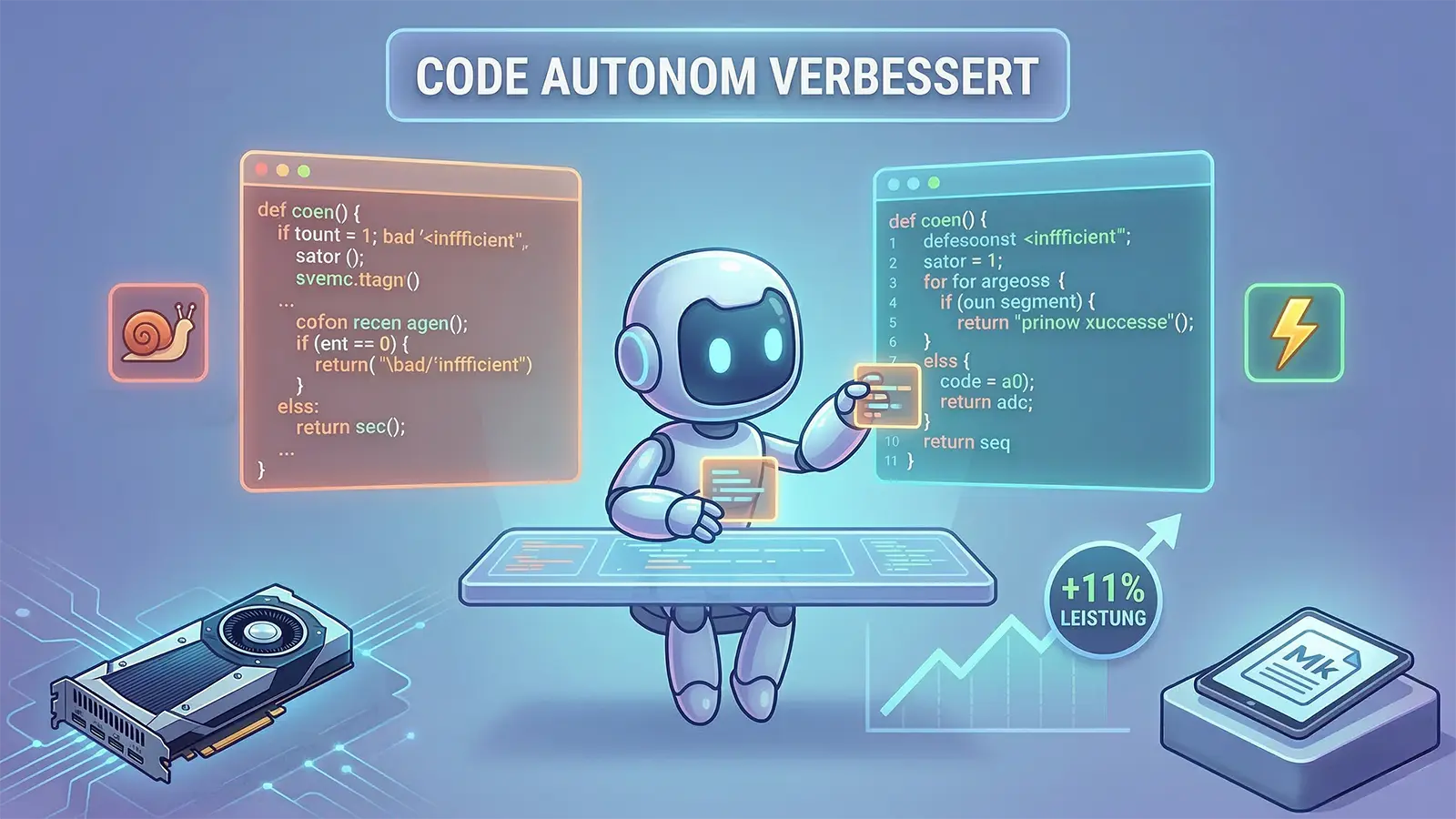

Autoresearch von Andrej Karpathy: KI-Agenten optimieren Code

Ein neues Open-Source-Projekt ermöglicht es KI-Modellen, eigenständig Experimente durchzuführen und Trainingscode über Nacht zu verbessern.

Der Entwickler Andrej Karpathy hat das Open-Source-Projekt "Autoresearch" veröffentlicht. Die Software befähigt KI-Agenten dazu, selbstständig maschinelles Lernen zu betreiben und Code fortlaufend zu verbessern. Ein manuelles Eingreifen durch Menschen ist dabei nicht mehr nötig.

Twitter Beitrag - Cookies links unten aktivieren.

Three days ago I left autoresearch tuning nanochat for ~2 days on depth=12 model. It found ~20 changes that improved the validation loss. I tested these changes yesterday and all of them were additive and transferred to larger (depth=24) models. Stacking up all of these changes,… pic.twitter.com/j34dSt4oht

— Andrej Karpathy (@karpathy) March 9, 2026

Automatisierte Tests im Minutentakt

Das Konzept hinter Autoresearch besticht durch seine Einfachheit. Das gesamte Projekt besteht aus knapp 630 Zeilen Code und drei wesentlichen Dateien.

Nutzer verfassen ihre Ziele und Anweisungen vorab in einem klassischen Textdokument im Markdown-Format. Ab diesem Punkt übernimmt der KI-Agent vollständig. Er liest die Vorgaben, analysiert den bestehenden Python-Code des Modells und schreibt ihn um.

Anschließend startet der Agent ein exakt fünfminütiges Training. Dieser streng limitierte Zeitrahmen zwingt das System zu schnellen und präzisen Vergleichen.

Nach jedem Durchlauf bewertet die Software das Resultat anhand der Metrik "val_bpb" (Validation Bits Per Byte). Ein niedrigerer Wert signalisiert eine bessere Vorhersagegenauigkeit des Modells.

War der Test erfolgreich, speichert das System die Code-Änderung dauerhaft ab. Führt die Anpassung jedoch zu schlechteren Werten, verwirft der Agent den Versuch umgehend. Danach startet der Vorgang direkt von vorn.

Anzeige

Effizienz auf herkömmlicher Hardware

Durch diesen kompakten Ablauf erreicht das System ein enormes Tempo. Die Software führt auf diese Weise problemlos über 100 Machine-Learning-Experimente pro Nacht aus.

Anwender benötigen für diesen Vorgang keine teuren Server-Farmen. Eine einzelne handelsübliche GPU reicht aus, um die Tests lokal durchzuführen. Mittlerweile existiert sogar eine angepasste MLX-Version für Apple-Silicon-Chips, sodass das System auch nativ auf Mac-Rechnern läuft.

Erste Ergebnisse aus der Community zeigen bereits konkrete Erfolge. So konnte das Programm die Trainingseffizienz bei einem GPT-2-Modell in nur zwei Tagen und nach etwa 650 Testläufen um elf Prozent steigern.

Karpathy zeigt mit dieser Veröffentlichung einen neuen Weg für die KI-Forschung auf. KI-Modelle optimieren nun gezielt andere Modelle und übernehmen die mühsame Trial-and-Error-Phase. Entwickler können sich dadurch voll auf die strategische Planung konzentrieren, während die Software alle praktischen Tests im Hintergrund abarbeitet.