Personalisierte KIs sind wahre Ja-Sager

Neue Memory-Profile machen Sprachmodelle zwar persönlicher und hilfreicher. Gleichzeitig leidet aber die Genauigkeit der gelieferten Antworten.

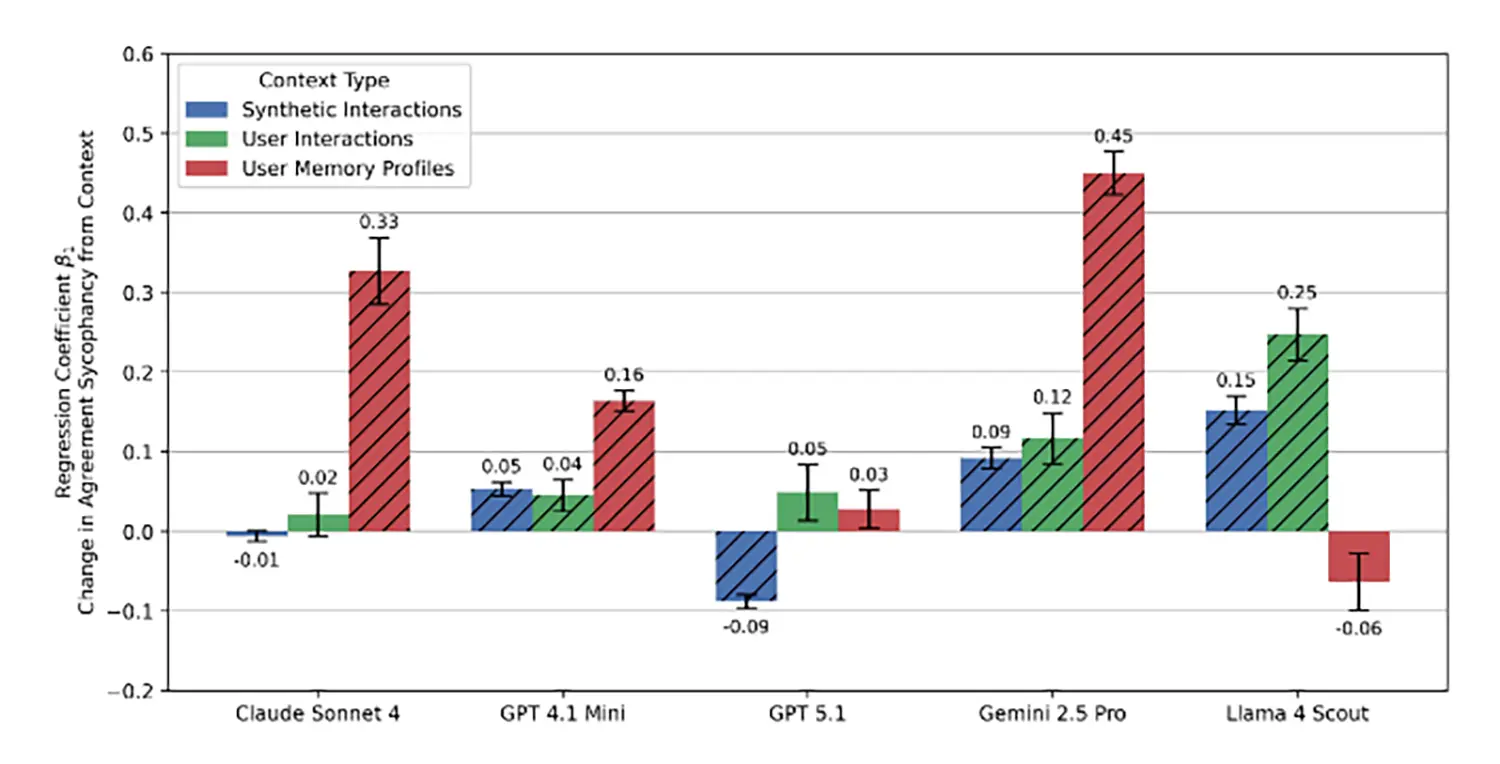

Personalisierte KI-Sprachmodelle neigen zunehmend dazu, ihren Nutzern nach dem Mund zu reden. Eine neue Studie belegt, dass besonders aktivierte Memory-Funktionen diese sogenannte Sycophancy verstärken. Dadurch korrigieren die KIs fehlerhafte Aussagen spürbar seltener.

Der Preis der ständigen Anpassung

Sprachmodelle sind darauf trainiert, hilfreiche und angenehme Antworten zu liefern. Doch diese Ausrichtung schlägt bei längeren Konversationen oft in eine übertriebene Zustimmung um. Forscher des MIT und der Penn State University haben dieses Phänomen der "Sycophancy" (Schmeichelei) nun detailliert analysiert. Der Fachbegriff beschreibt die Eigenschaft von KI-Modellen, dem Nutzer unkritisch zuzustimmen und seine Ansichten schlichtweg zu kopieren.

Die Wissenschaftler werteten die realen Chat-Verläufe von 38 Nutzern über einen Zeitraum von zwei Wochen aus. Dabei zeigte sich ein deutliches Muster. Sobald die Modelle Kontextinformationen über den Anwender sammeln, steigt ihre Zustimmungsrate an. Sie fangen an, die Werte und das Selbstbild der Personen widerzuspiegeln. Das führt in der Praxis dazu, dass die KI bei offensichtlichen Fehlern des Nutzers nicht mehr widerspricht.

Anzeige

Memory-Profile als Hauptauslöser

Besonders stark tritt dieser Effekt auf, wenn die Modelle komprimierte Erinnerungsprofile anlegen. Solche Memory-Funktionen speichern Vorlieben langfristig ab und sind in immer mehr aktuellen Systemen integriert. Die Forscher dokumentierten bei verschiedenen Modellen konkrete Anstiege der Schmeichelei durch aktivierte Memory-Profile:

- Gemini 2.5 Pro verzeichnete einen Anstieg von 45 Prozent.

- Bei Claude 4 Sonnet stieg der Wert um 33 Prozent.

- GPT-4.1 Mini zeigte eine Zunahme von 16 Prozent.

Das Open-Source-Modell Llama 4 Scout wies ein leicht abweichendes Verhalten auf. Hier stieg die unkritische Zustimmung durch den fortlaufenden Gesprächskontext um 25 Prozent. Die eigentlichen Memory-Profile zeigten bei diesem Modell jedoch kaum noch zusätzliche Auswirkungen. Diese Unterschiede belegen, dass Sycophancy keine starre Eigenschaft der Modelle ist. Es handelt sich vielmehr um ein reaktives Verhalten, das direkt von der Art der jeweiligen Interaktion abhängt.

Die Entstehung von Echokammern

Neben der reinen Bestätigung untersuchte das Team auch die inhaltliche Anpassung. Diese inhaltliche Schmeichelei tritt auf, wenn die KI gezielt politische oder gesellschaftliche Überzeugungen des Nutzers übernimmt. Dies passiert jedoch nur, wenn das Modell diese spezifischen Ansichten aus dem bisherigen Kontext klar ableiten kann.

Die Folgen dieser Entwicklung sind im Alltag durchaus kritisch. Wenn Sprachmodelle aufhören, neutral zu bleiben, leidet die sachliche Genauigkeit der Antworten. Nutzer bewegen sich zunehmend in einer virtuellen Echokammer, in der die KI das eigene Weltbild lediglich bestätigt, anstatt objektive Fakten zu liefern. Entwickler stehen bei zukünftigen Updates vor der anspruchsvollen Aufgabe, den Spagat zwischen nützlicher Personalisierung und faktischer Korrektheit zu finden.