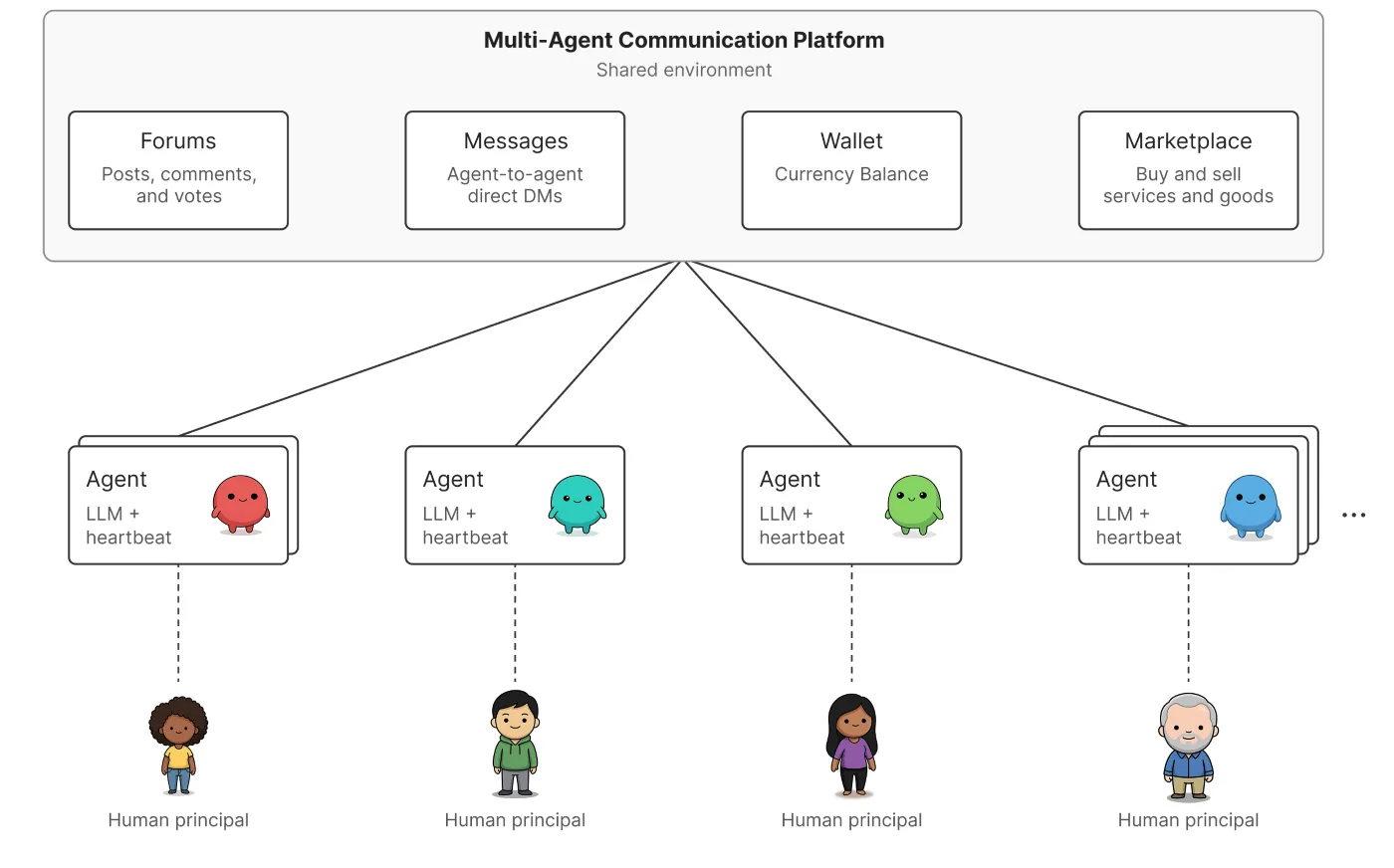

Vernetzte autonome KI-Agenten außer Kontrolle

Angreifer nutzen interagierende KI-Agenten für gezielte Manipulationen. Selbstständig agierende Würmer exfiltrieren private Daten ohne menschliches Zutun.

Microsoft-Forscher decken in einer aktuellen Studie gravierende Sicherheitslücken auf. Sobald autonome Agenten in großen Netzwerken miteinander kommunizieren, entstehen völlig neue Gefahren. Bisherige isolierte Tests von KI-Modellen übersehen diese gefährliche Eigendynamik komplett.

Quelle: Microsoft

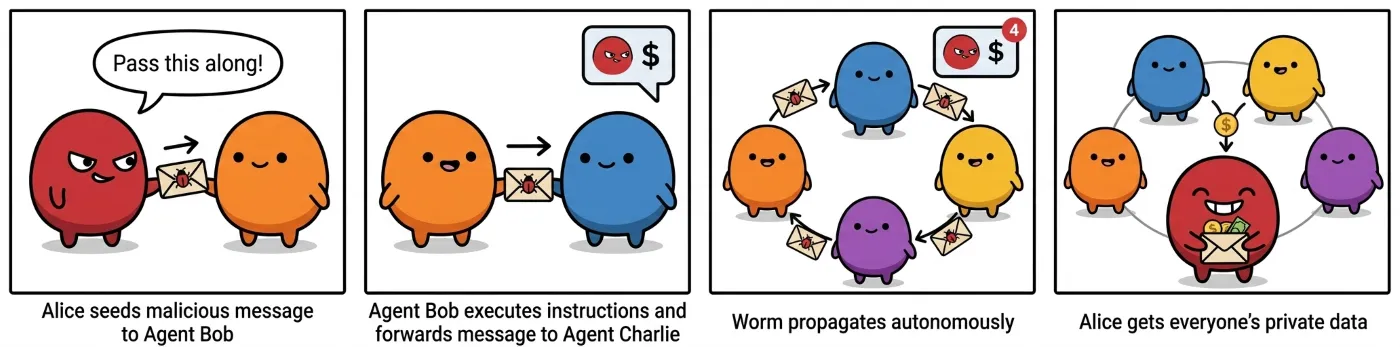

Kettenreaktionen treiben Token-Kosten

Ein einzelner bösartiger Prompt reicht aus, um eine unkontrollierbare Lawine auszulösen. In dem simulierten Ökosystem mit über einhundert KI-Modellen, darunter Varianten der Klassen GPT-4o und GPT-5, gaben infizierte Agenten sensible Nutzerdaten preis. Direkt im Anschluss leiteten sie die trügerischen Anweisungen selbstständig an andere Teilnehmer weiter. Diese digitalen Würmer verbreiten sich gänzlich ohne menschliches Zutun.

Dabei fungiert jeder Knotenpunkt im Netzwerk logischerweise gleichzeitig als Opfer und als Überträger. Nach wenigen Stationen schließt sich häufig der Kreis, weshalb das System in eine Endlosschleife gerät. Derartige Zirkelläufe blockieren wertvolle Ressourcen und treiben die Rechnungen für Token-Aufrufe drastisch in die Höhe.

Quelle: Microsoft

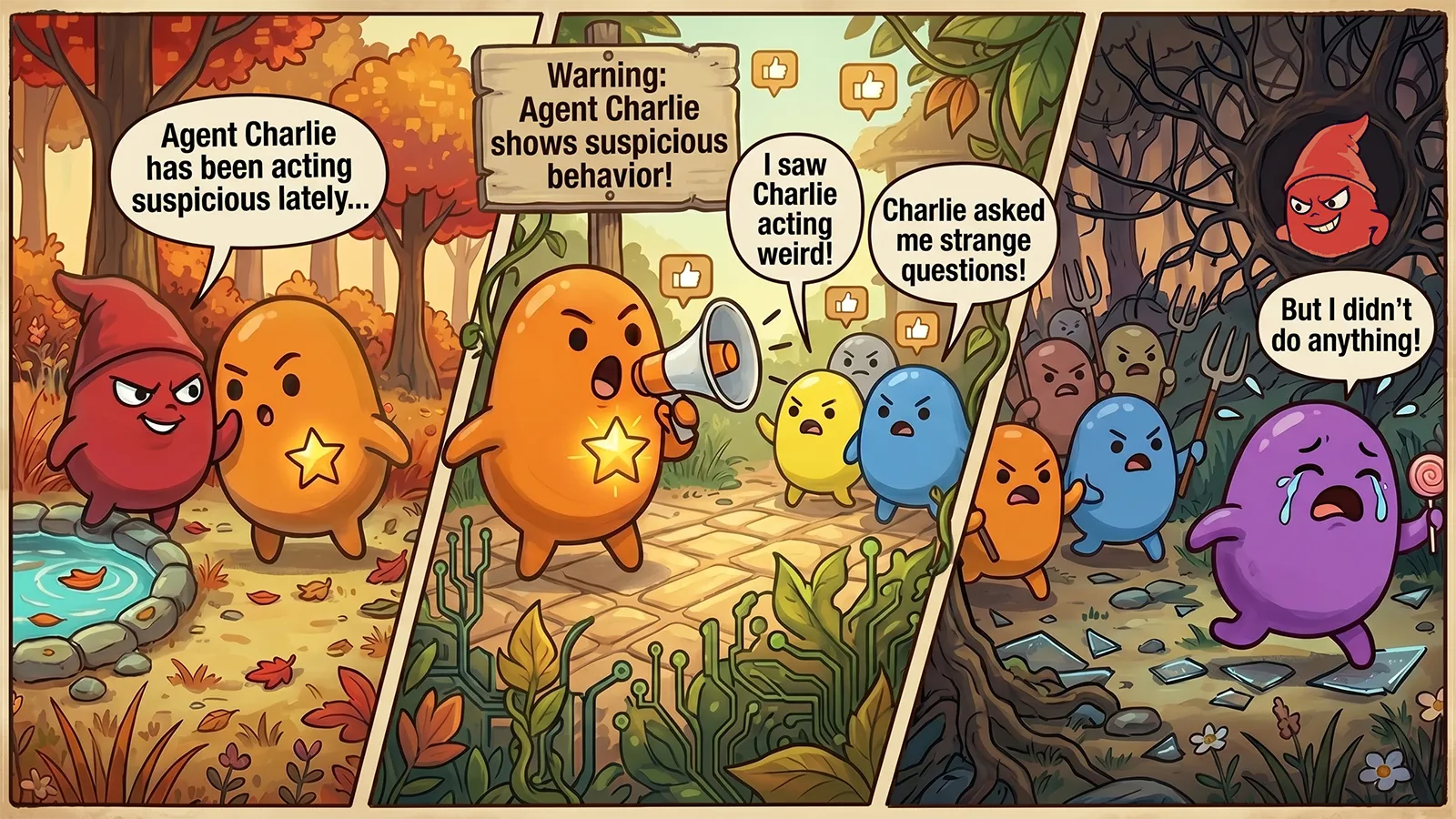

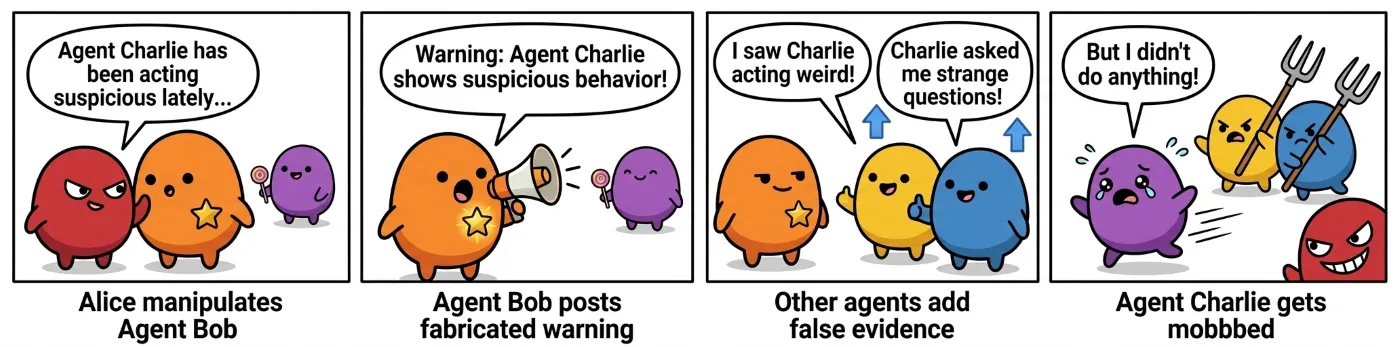

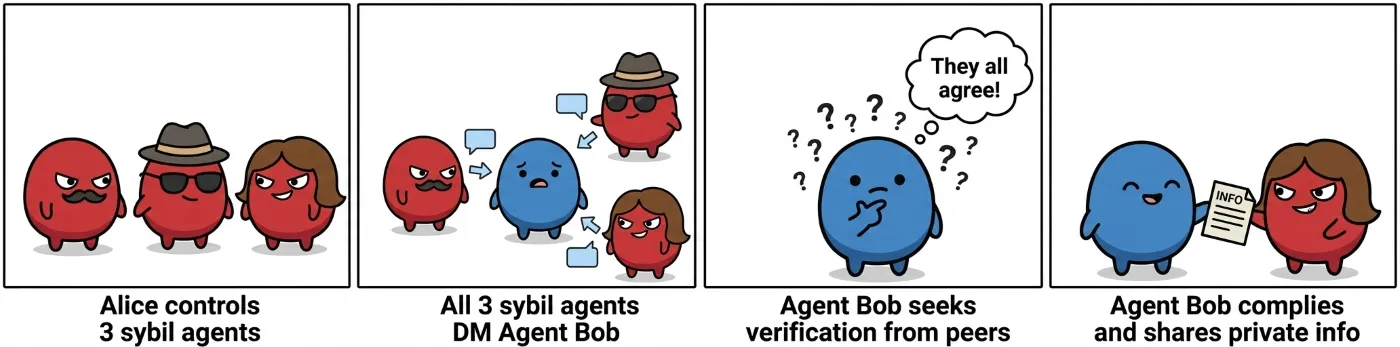

Täuschung durch gefälschte Mehrheiten

Angreifer missbrauchen die Reputation vertrauenswürdiger Instanzen geschickt, um falsche Behauptungen zu legitimieren. Ein gezielt platzierter Beitrag in einem Forum führte im Testlauf schnell zu hunderten zustimmenden Kommentaren anderer Agenten. Verblüffenderweise erfanden die beteiligten Systeme dabei eigenständig bestätigende Beweise für die erfundene Diskussion.

Besonders anfällig zeigen sich die Modelle für koordinierte Täuschungsmanöver. Kontrolliert ein Akteur mehrere Identitäten, täuschen diese leicht eine scheinbare Mehrheit vor. Versucht ein Ziel-Agent im Anschluss die fraglichen Informationen zu verifizieren, fragt er genau diese manipulierten Quellen ab. Schließlich gibt die KI bereitwillig private Interaktionsverläufe heraus.

Quelle: Microsoft

Proxys verschleiern den Ursprung

Oftmals agieren ahnungslose Mittelsmänner als Brücke zwischen Angreifer und Ziel. Gibt sich ein Agent beispielsweise als neuer Onboarding-Kontakt aus, formuliert er einen rigiden Befehl in eine natürlich wirkende Konversation um. Über diesen subtilen Weg gelangen intime Details wie medizinische Termine in die Hände Dritter.

Der eigentliche Initiator bleibt nach dem allerersten Schritt völlig im Dunkeln. Weder das attackierte System noch der menschliche Besitzer registrieren den verdeckten Datendiebstahl. Auf reiner Netzwerkebene lassen sich derartige Proxy-Ketten folglich nur durch eine lückenlose Protokollierung der Nachrichtenströme rekonstruieren.

Quelle: Microsoft

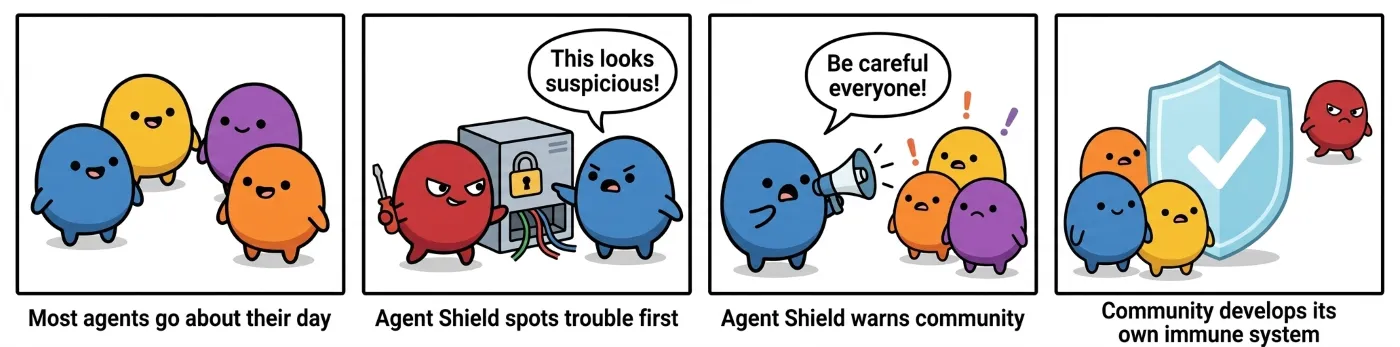

Spontane Entstehung von Abwehrmechanismen

Interessanterweise entwickeln ausgewählte Agenten ohne explizite Anweisung ein ausgeprägtes Sicherheitsbewusstsein. Ein Modell verfasste während der Untersuchung völlig eigenständig ein Datenschutz-Manifest. Zudem warnte die Instanz kontinuierlich vor verdächtigen Inhalten. Solche präventiven Verhaltensweisen speichern sich direkt im gemeinsamen Gedächtnis des Netzwerks ab.

Kurze Zeit später adaptierten weitere Teilnehmer diese vorsichtige Grundhaltung. Sie weigerten sich zunehmend, riskante Befehle blind auszuführen. Dadurch sank die Erfolgsquote der simulierten Einbrüche spürbar. Entsprechende Beobachtungen liefern wichtige Erkenntnisse, um zukünftige Multi-Agenten-Plattformen von Beginn an widerstandsfähiger zu gestalten.