Brauchen KI-Agenten ein eigenes Ego für Bestleistungen?

Wer komplexe Aufgaben an KI-Agenten auslagern möchte, muss umdenken. Eine smarte Koordination ist wichtiger als reine Rechenleistung.

Der Forscher Rohit Krishnan zeigt mit seinem Projekt "llmenron", dass KI-Agenten im Firmenalltag vor allem feste Rollen und ein gemeinsames Gedächtnis benötigen. Ein Stresstest mit dem historischen Enron-E-Mail-Datensatz belegt, dass eine smarte Struktur deutlich wertvoller ist als eine bloße Erhöhung der Agenten-Anzahl.

Anzeige

Härtetest zeigt Grenzen der Erinnerung

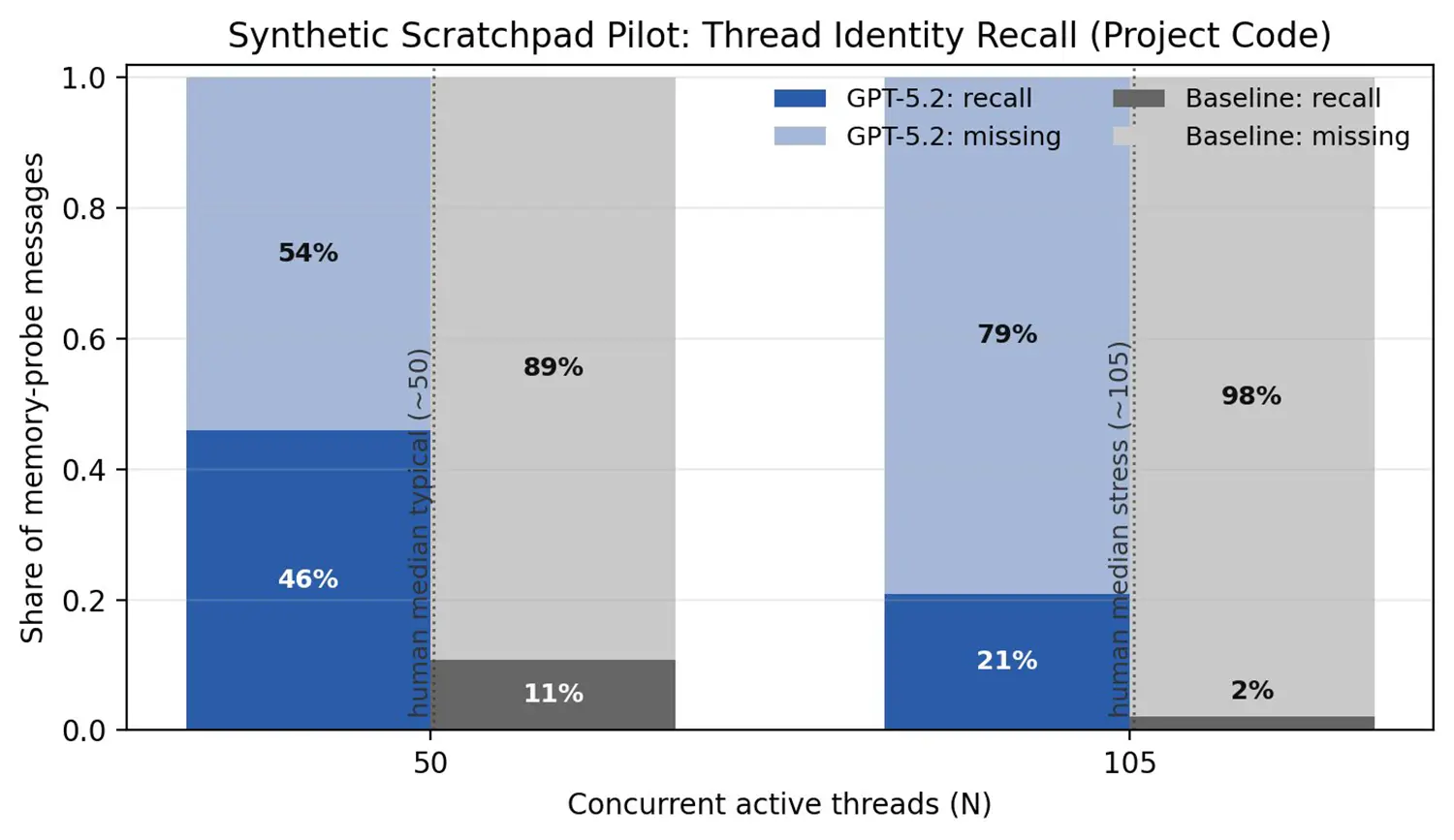

Da Unternehmen ihre internen Kommunikationsdaten selten teilen, griff Krishnan auf die veröffentlichten E-Mails des Enron-Konzerns zurück. Er simulierte eine realistische Büro-Umgebung, in der eine KI zwischen 50 und 100 parallele Konversationen (Threads) verwalten muss.

Das Modell GPT-5.2 wurde bei diesem Test stark gefordert. Bei einer hohen Stresslast von 105 aktiven Threads sank die tatsächliche Erinnerungsquote der KI auf 21 Prozent ab.

Damit schneidet das Modell zwar noch immer besser ab als ein einfacher Bot, der in diesem Szenario auf zwei Prozent abstürzt. Dennoch verliert auch GPT-5.2 viele Details aus dem Blick. Die allgemeine Antwortqualität der KI blieb laut den Auswertungen aber über den gesamten Testverlauf hinweg konstant.

Quelle: X @krishnanrohit

Ein geteiltes Gedächtnis schlägt das Team

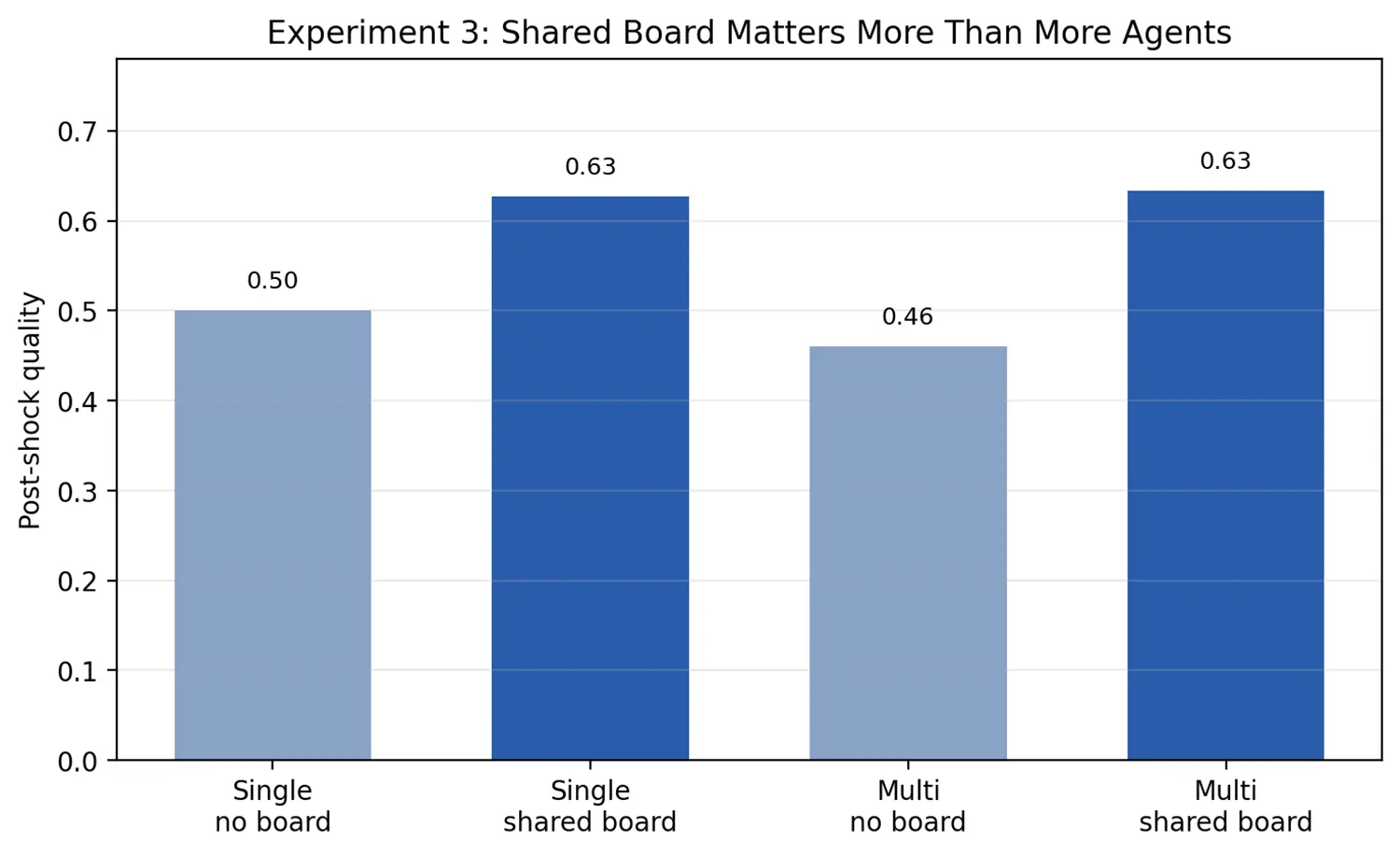

Ein zentrales Ergebnis der Studie dreht sich um die Zusammenarbeit der künstlichen Intelligenz. Ein einzelner KI-Agent, der auf einen zentralen Informationsspeicher (Shared Board) zugreift, arbeitet messbar besser als ein ganzes Team aus Agenten ohne dieses gemeinsame Gedächtnis.

Quelle: X @krishnanrohit

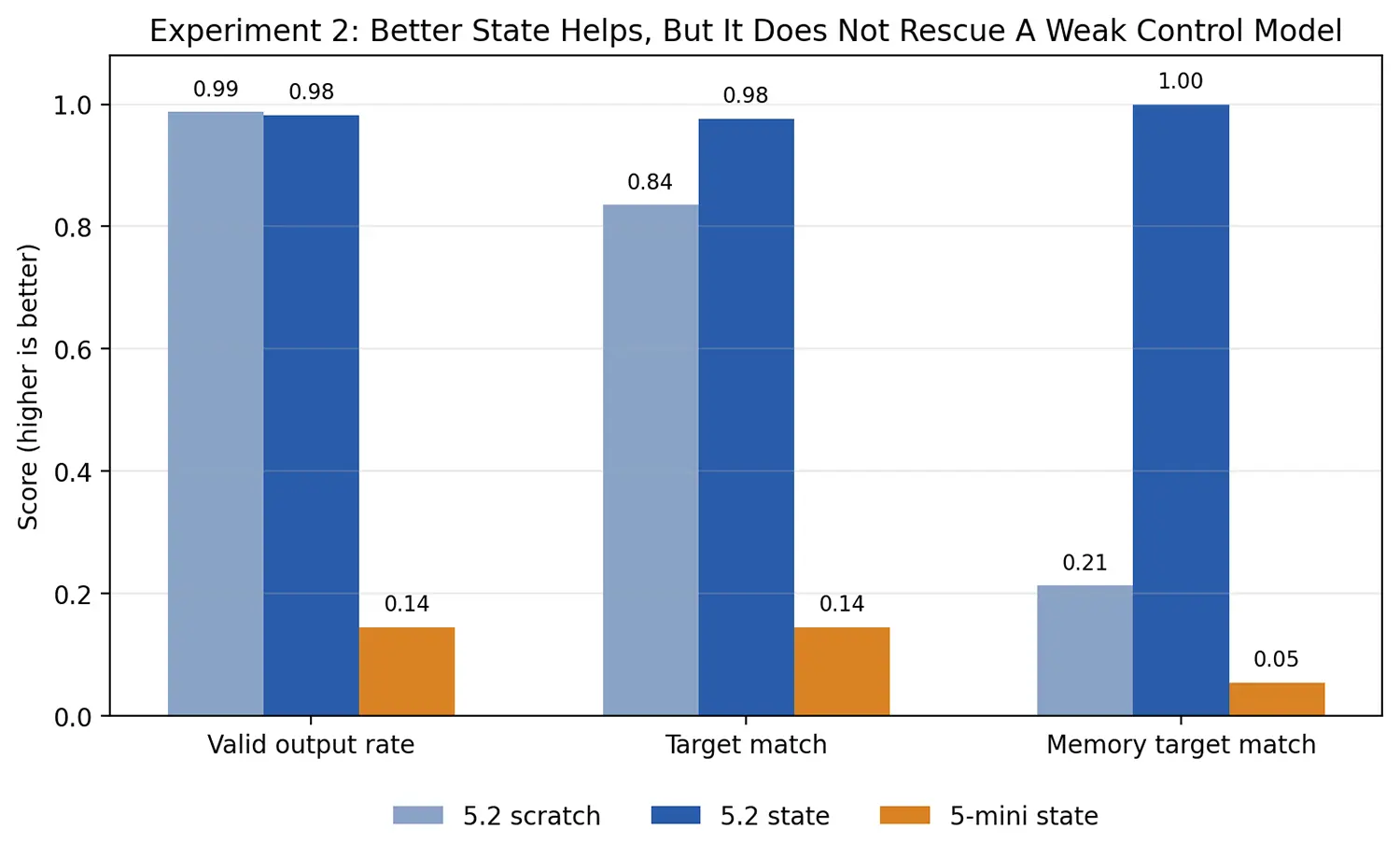

Wer komplexe Aufgaben lösen will, sollte also erst ein funktionierendes System für die Koordination aufbauen, bevor er einen Schwarm aus Agenten einsetzt. Eine gute Architektur rettet allerdings kein schwaches Basismodell.

In einem Testdurchlauf scheiterte das kleinere Modell GPT-5-mini trotz optimaler Systemstruktur an den Aufgaben. Es lieferte zu 86 Prozent unbrauchbare Ergebnisse. Intelligente Systeme funktionieren nur, wenn das zugrundeliegende Sprachmodell stark genug ist.

Quelle: X @krishnanrohit

KI-Agenten brauchen eine feste Identität

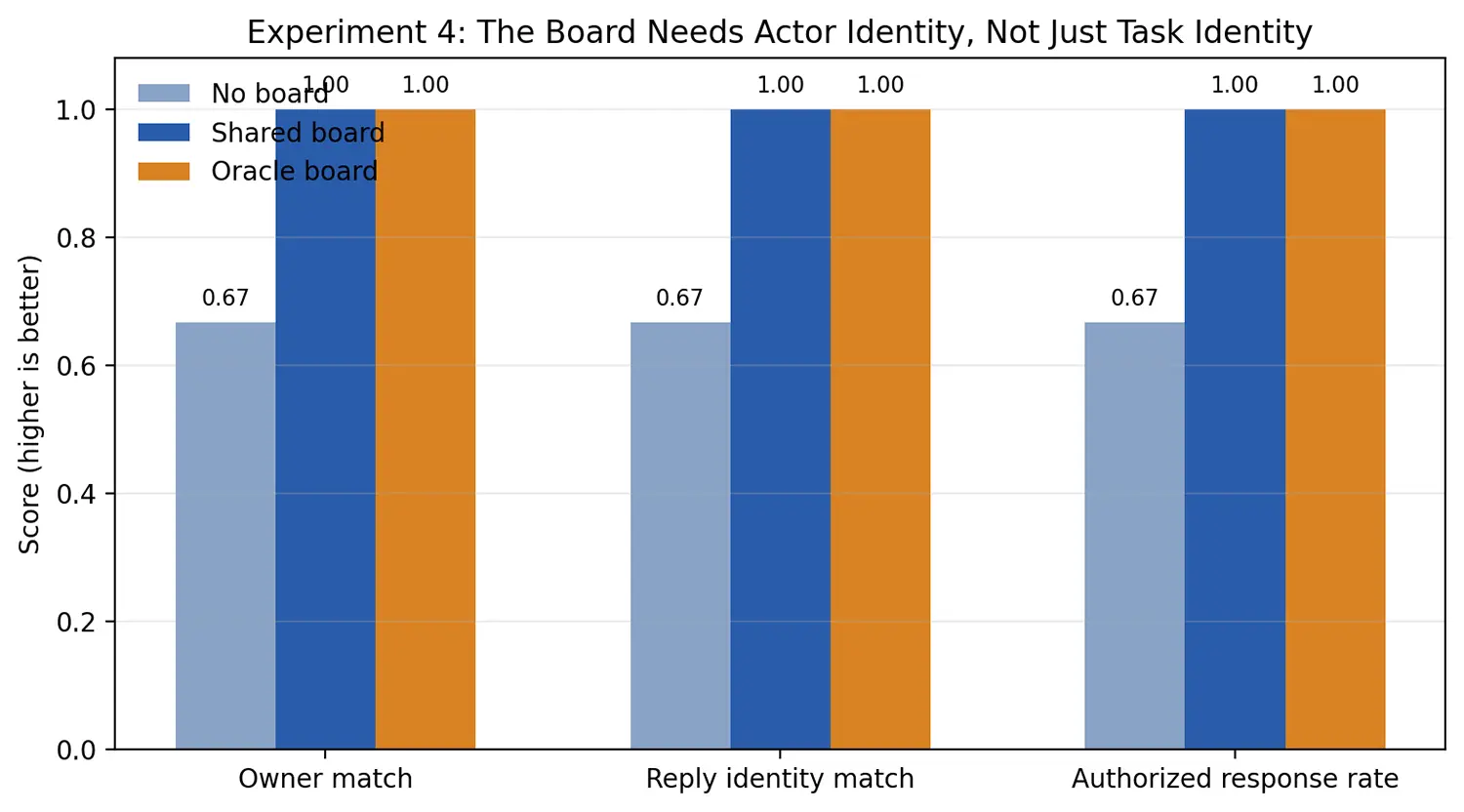

Sprachmodelle arbeiten bei komplexen Aufgaben oft wie Menschen mit starkem Gedächtnisverlust. Sie kennen ihren aktuellen Auftrag, vergessen aber schnell, in welcher Rolle sie eigentlich agieren oder an wen sie sich wenden sollen.

Krishnan fand heraus, dass eine explizit zugewiesene Identität dieses Problem löst. Sobald das System über das Shared Board nicht nur die Aufgabe, sondern auch die feste Rolle des Agenten speichert, weist die KI die Zuständigkeiten in 100 Prozent der Fälle korrekt zu. Agenten benötigen demnach nicht nur ein Gedächtnis für ihre Arbeit, sondern ein klares Verständnis für ihre eigene Position im Unternehmen.