Google DeepMind löst das größte Problem autonomer KI-Agenten

Ein neues Framework sorgt für Struktur im Agentic Web. KI-Modelle können komplexe Aufgaben nun sicher und verschlüsselt delegieren.

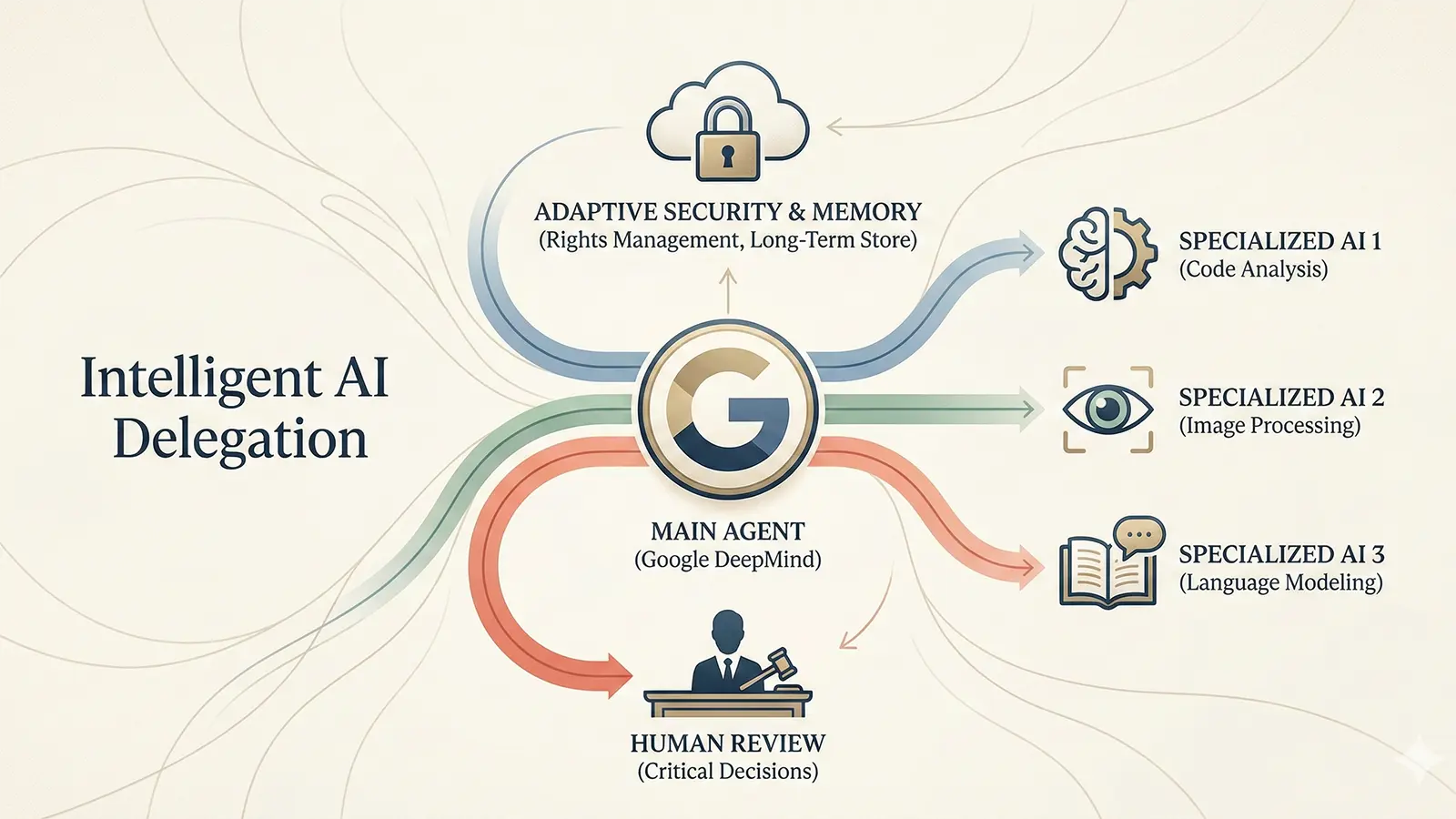

Forschende von Google DeepMind haben mit „Intelligent AI Delegation“ ein Konzept veröffentlicht, das die sichere Aufgabenverteilung zwischen autonomen KI-Modellen regelt. Das Framework definiert, wie ein Hauptagent komplexe Teilaufgaben an spezialisierte Subsysteme oder Menschen übergibt, ohne dabei Datenschutz- und Sicherheitsrichtlinien zu verletzen.

Das Problem unkontrollierter Datenströme

KI-Agenten übernehmen zunehmend mehrstufige Abläufe. Sie stoßen jedoch bei hochspezialisierten oder sicherheitskritischen Anfragen schnell an ihre Leistungsgrenzen. Bislang fehlt ein standardisiertes Vorgehen, wie solche Aufgaben innerhalb eines Netzwerks aus verschiedenen KIs übergeben werden. Geben Modelle blind Befehle oder sensible Daten an andere Systeme weiter, entstehen unkontrollierbare Sicherheitslücken.

Genau hier setzt das neue Konzept an. Es beschreibt einen Prozess, bei dem ein Hauptagent einen eingehenden Prompt analysiert und in kleinere Bestandteile zerlegt. Ein Bewertungsmechanismus prüft kontinuierlich anhand der eigenen Reasoning-Kapazitäten, ob das System den Auftrag selbst ausführt oder delegiert. Dabei entscheidet die KI dynamisch, ob ein anderes Modell über eine API angesteuert wird oder ob menschliche Expertise zwingend erforderlich ist.

Sobald autonome Modelle im sogenannten Agentic Web untereinander kommunizieren und Berechtigungen austauschen, steigen die Risiken für unautorisierte Systemzugriffe deutlich. Das Framework etabliert daher strikte Protokolle, die den Datenaustausch kryptografisch absichern. Der Kontext der ursprünglichen Nutzeranfrage bleibt so über den gesamten Prozess lückenlos erhalten.

Anzeige

Adaptive Rechteverwaltung und Speichermanagement

Um die Sicherheit auf Plattformebene zu gewährleisten, integriert das System eine adaptive Steuerung der Zugriffsrechte. Ein delegierender Agent vergibt ausschließlich die minimal notwendigen Berechtigungen an ein angefordertes Subsystem, um eine exakt definierte Aktion auszuführen.

Dieses Prinzip der geringsten Rechte minimiert potenzielle Fehler und verhindert unautorisierte Ausführungen innerhalb der vernetzten Infrastruktur.

Neben der reinen Aufgabenverteilung spielt das Speichermanagement eine zentrale Rolle. Die Agenten greifen auf ein erweitertes Langzeitgedächtnis (Memory) zu, um frühere Delegationsentscheidungen bei ähnlichen Anfragen effizient wiederzuverwenden und so wertvolle Rechenressourcen zu sparen.

Darüber hinaus verankert das Konzept feste Prüfmechanismen durch menschliche Akteure. Besonders bei ethisch heiklen Entscheidungen oder weitreichenden Datenbankzugriffen stoppt die automatische Delegation, und das System fordert aktiv ein manuelles Feedback an. Der Ansatz liefert damit eine konkrete technische Grundlage, um die Skalierung von Multi-Agenten-Systemen zuverlässig steuerbar zu halten.