Anthropic enthüllt die größten Fehler bei der KI-Nutzung

Der neue AI Fluency Index analysiert das Verhalten von Nutzern. Das erschreckende Ergebnis: Fast niemand überprüft die Fakten der KI.

Anthropic stellt mit dem „AI Fluency Index“ ein neues Messinstrument zur Bewertung der Mensch-KI-Zusammenarbeit vor. Die Auswertung zeigt detailliert, wie Anwender mit Sprachmodellen interagieren, und deckt eklatante Defizite bei der Überprüfung generierter Inhalte auf.

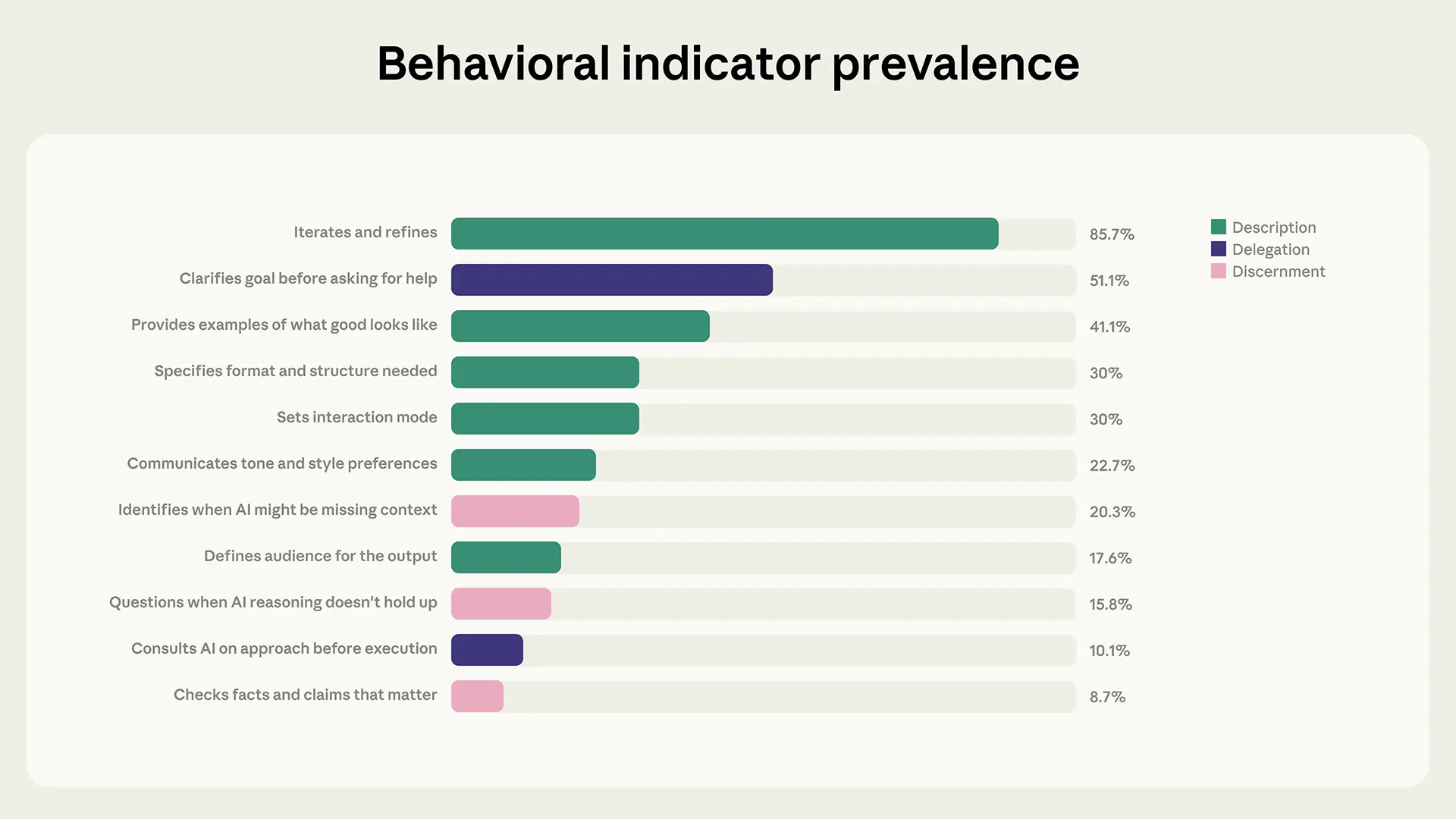

Drei Kategorien der Interaktion

Der Index unterteilt die Nutzung von künstlicher Intelligenz systematisch in drei Hauptbereiche: Beschreibung, Delegation und Urteilsvermögen. Die erfassten Messwerte verdeutlichen, dass die meisten Nutzer die grundlegende Steuerung der Sprachmodelle mittlerweile gut beherrschen.

Quelle: Anthropic

Gut 85 Prozent der Anwender passen ihre Prompts im Verlauf eines Dialogs mehrfach an und verfeinern die Ergebnisse schrittweise. Mehr als die Hälfte klärt das exakte Ziel der Aufgabe, bevor die KI komplexe Vorgänge ausführt. Konkrete Beispiele für das gewünschte Resultat liefern immerhin noch 41 Prozent der Personen.

Quelle: Anthropic

Schwachstelle beim Urteilsvermögen

Sobald es um die kritische Bewertung der KI-Ausgaben geht, fallen die Zahlen jedoch drastisch ab. Der Bereich des Urteilsvermögens bildet das eindeutige Schlusslicht der Analyse.

Lediglich 8,7 Prozent der Nutzer überprüfen die generierten Fakten oder Behauptungen aktiv. Auch die zugrundeliegende Logik (Reasoning) der Modelle wird nur in knapp 16 Prozent der Fälle hinterfragt. Die Daten deuten stark darauf hin, dass viele Anwender den Texten ein zu hohes Grundvertrauen entgegenbringen.

Diese fehlende Distanz stellt ein erhebliches Risiko für die produktive Nutzung dar.

Anzeige

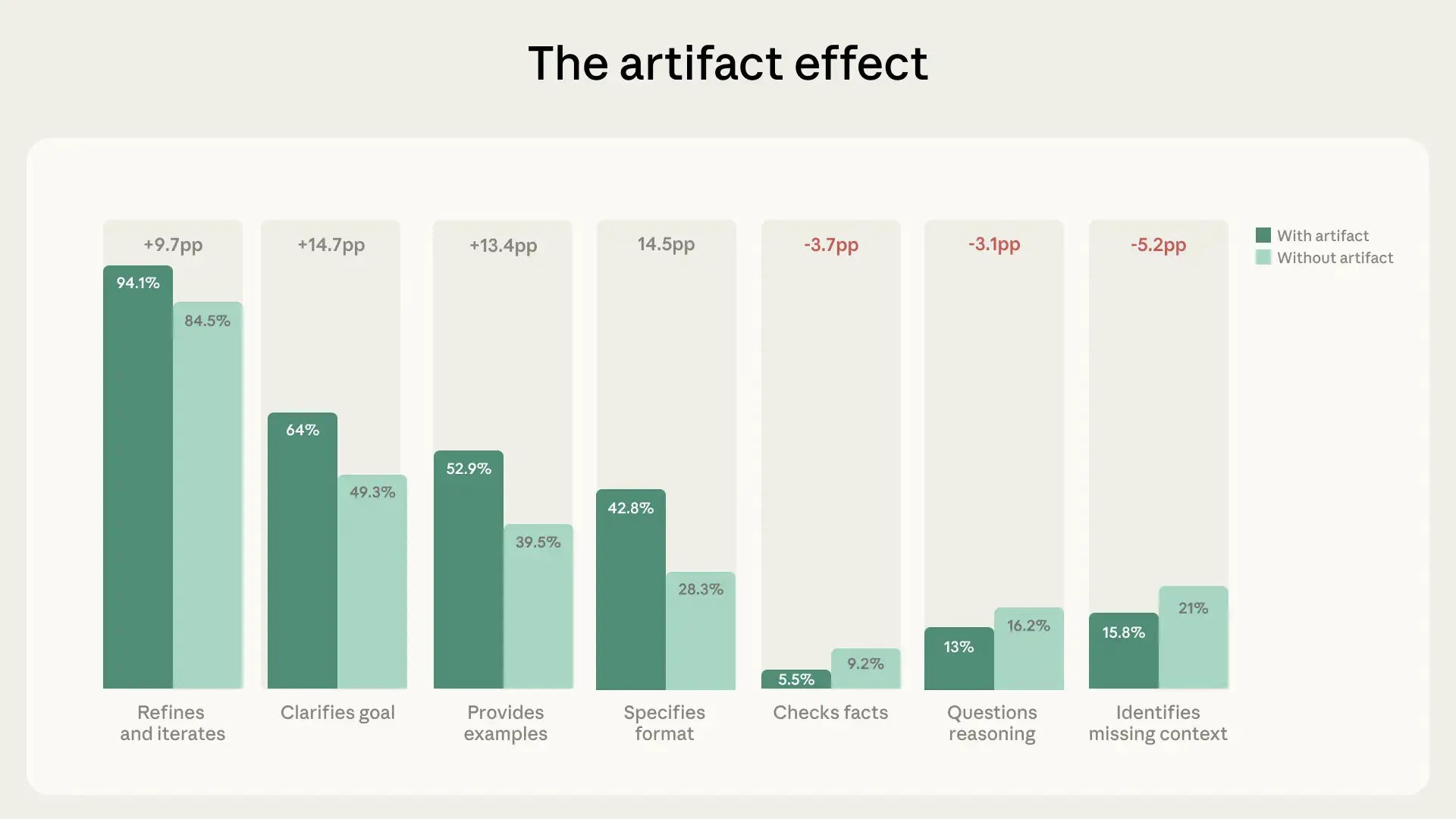

Der Einfluss des User Interfaces

Spezifische Funktionen des User Interfaces verändern das Nutzerverhalten erheblich. Der sogenannte Artifact-Effekt demonstriert, wie ein separates Fenster für Code oder längere Dokumente die Eingaben der Nutzer strukturiert.

Quelle: Anthropic

Verwenden Anwender ein solches Element, definieren sie das Ziel um knapp 15 Prozentpunkte häufiger. Die explizite Vorgabe von Formaten steigt ebenfalls um 14,5 Prozentpunkte. Gleichzeitig sinkt durch diese visuelle Trennung die ohnehin geringe Bereitschaft zum Faktencheck um weitere 3,7 Prozentpunkte ab. Eine professionell wirkende Darstellung suggeriert offensichtlich eine höhere Präzision der Ausgaben.

Kostenlose Schulungen als Reaktion

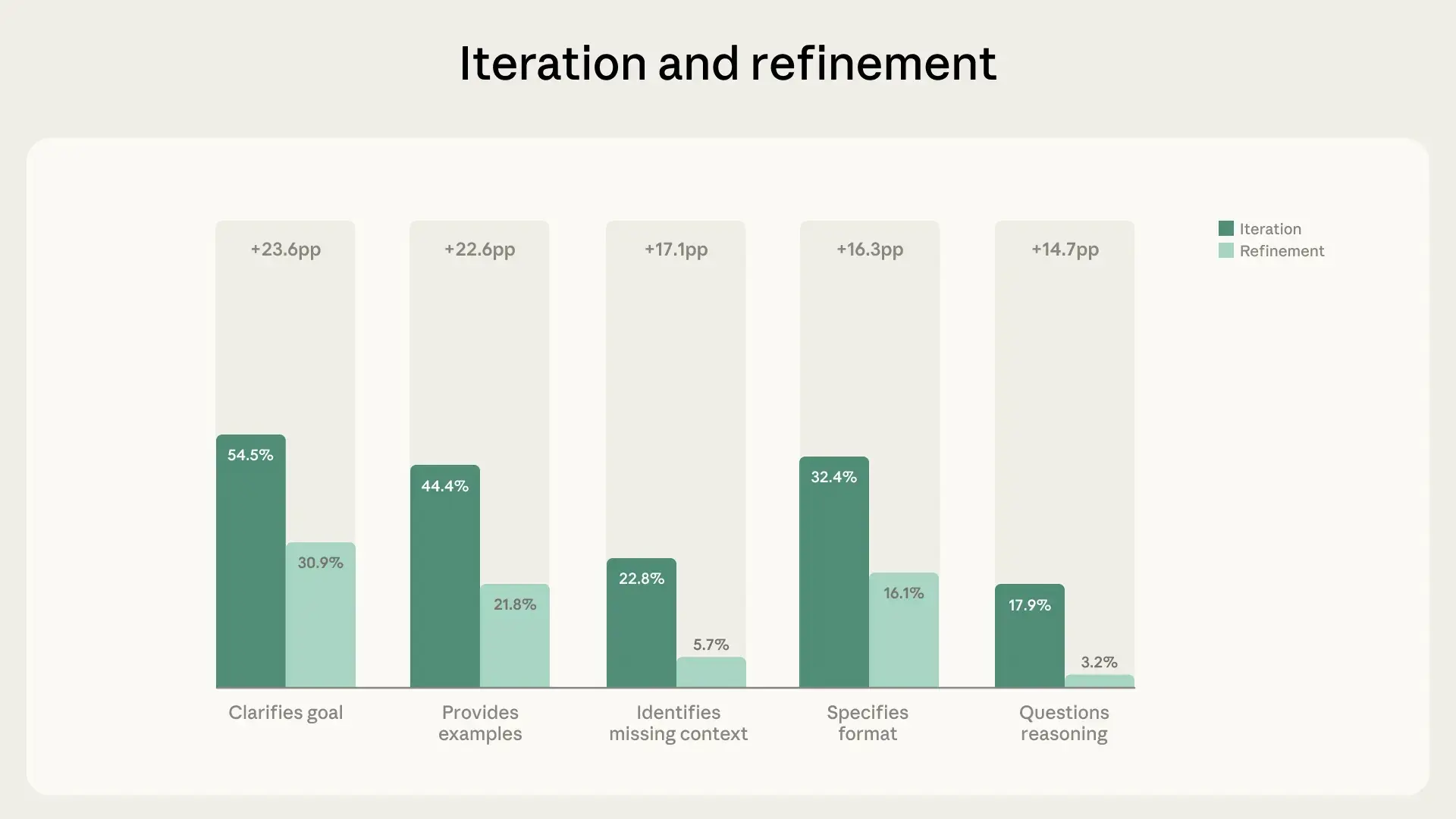

Nutzer, die ihre Anfragen kontinuierlich anpassen, agieren deutlich effektiver. Sie erkennen laut der Studie viermal häufiger, wenn dem System relevanter Kontext fehlt, und fordern diesen proaktiv ein. Auch die Nutzung von Beispielen verdoppelt sich bei dieser Nutzergruppe nahezu.

Um diese fortgeschrittenen Techniken flächendeckend zu etablieren, flankiert Anthropic den Index mit neuen Bildungsangeboten. Über die Plattform Skilljar stehen ab sofort kostenfreie Module wie der Kurs „AI Fluency: Framework & Foundations“ zur Verfügung. Diese Einheiten sollen exakt die schwach ausgeprägten analytischen Fähigkeiten trainieren. Nutzer lernen dort, Prompts systematisch aufzubauen und Ergebnisse kritisch zu evaluieren.

Die bei der Nutzung von Anthropics Diensten anfallenden Daten fließen standardmäßig in das zukünftige Training der Modelle ein, sofern Anwender dem nicht per Opt-out widersprechen. Das Unternehmen nutzt diese Telemetriedaten, um die Metriken des Index fortlaufend anzupassen und die Steuerung der KI weiter zu verfeinern.