Google bringt autonome KI-Agenten für komplexe Recherchen

Deep Research Max integriert externe Unternehmensdaten via MCP und liefert fertige Präsentationsgrundlagen in Echtzeit.

Google stellt mit Deep Research und Deep Research Max zwei neue autonome KI-Modelle für hochkomplexe Rechercheaufgaben vor. Basierend auf Gemini 3.1 Pro binden die Agenten proprietäre Datenströme in Analysen ein und generieren selbstständig visuelle Auswertungen in professioneller Qualität.

Zwei Ausbaustufen für unterschiedliche Workflows

Ausschließlich für interaktive Nutzeroberflächen sowie minimale Latenzzeiten konzipierte Google die Basisversion Deep Research. Gegenüber der ersten Vorschauversion aus dem Dezember arbeitet diese Variante deutlich kosteneffizienter und liefert gleichzeitig präzisere Ergebnisse. Gerade bei zeitkritischen Aufgaben im direkten Austausch mit Anwendern spielt dieses KI-Modell seine technischen Stärken aus.

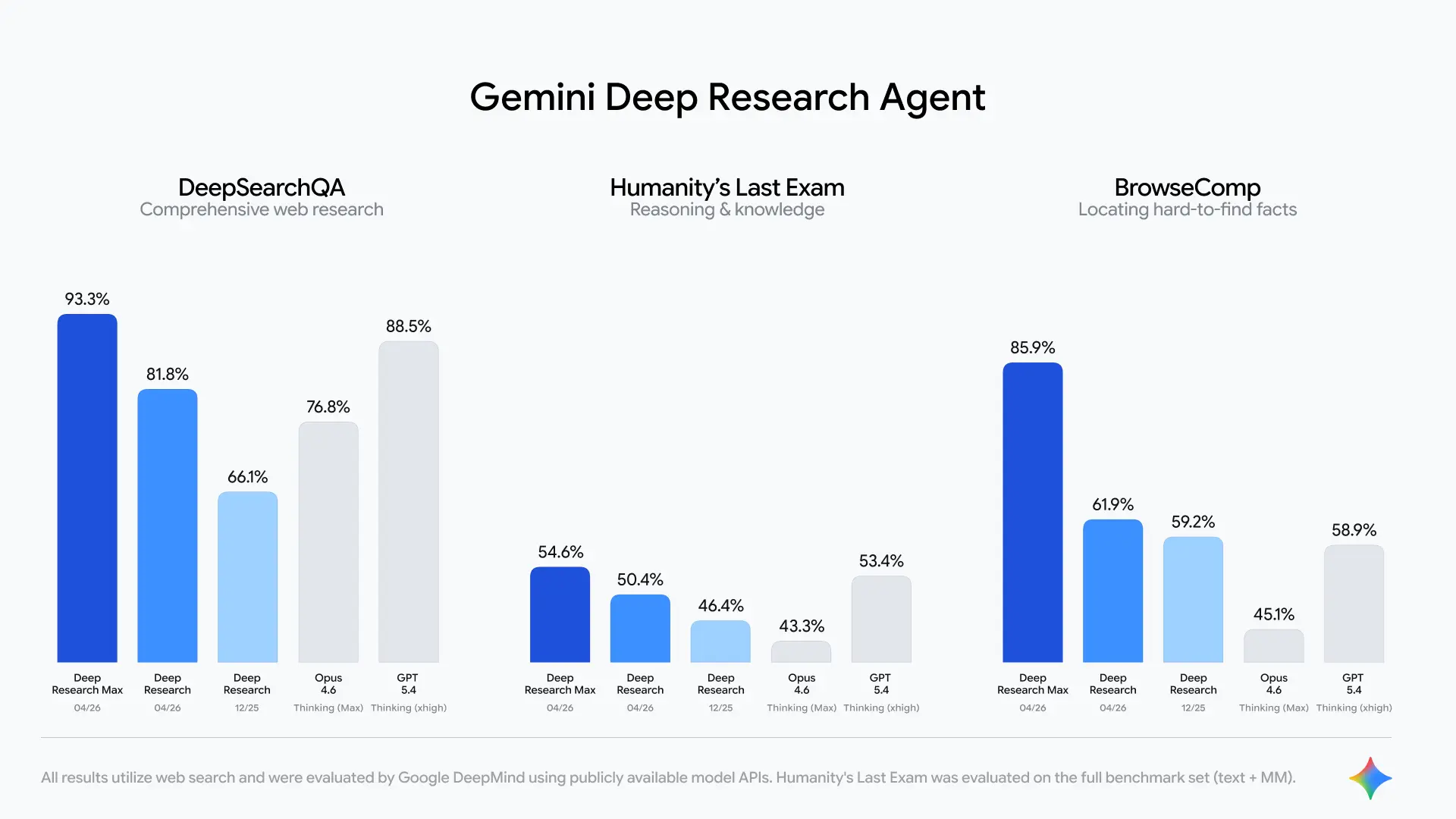

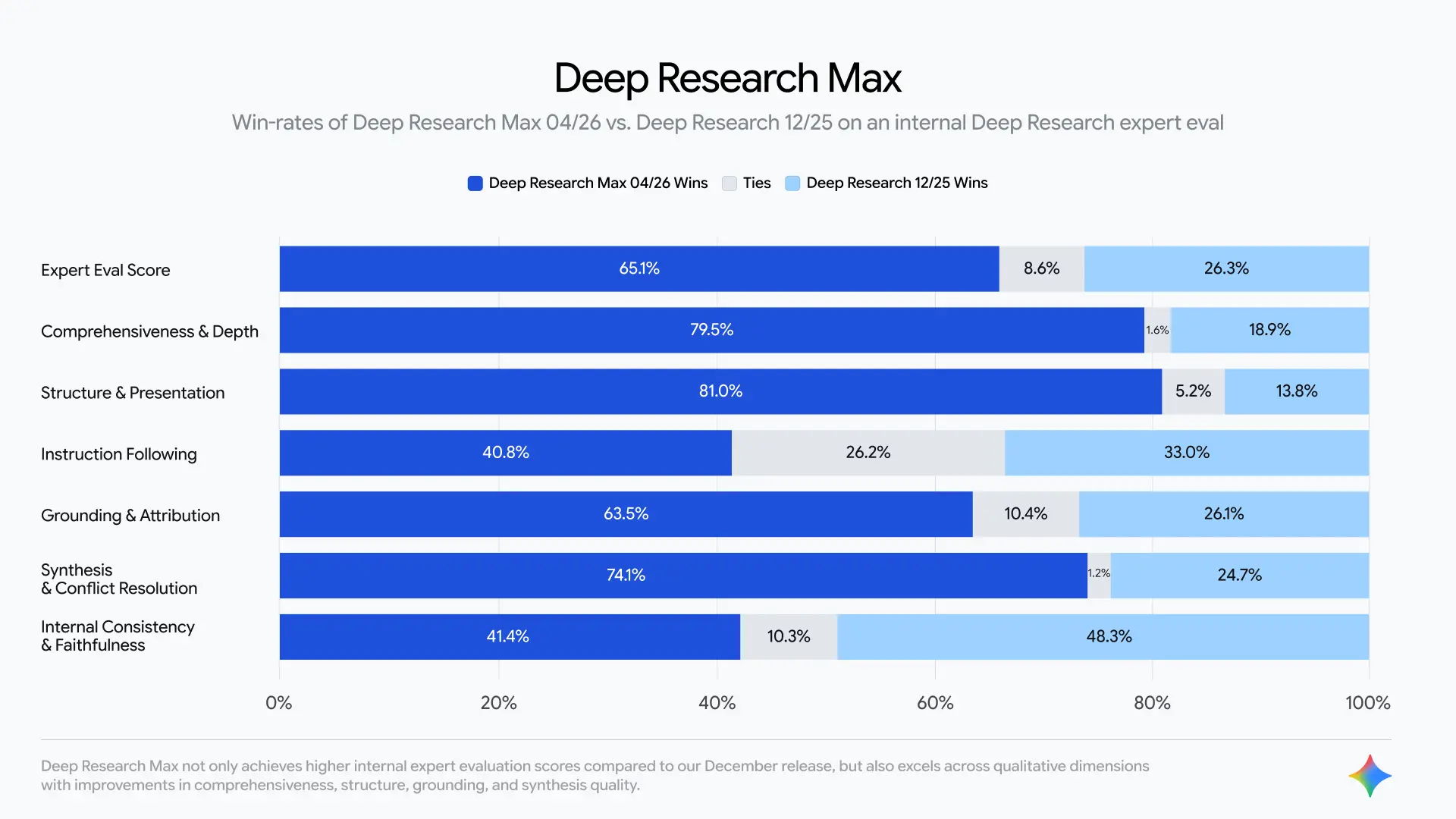

Weitaus umfassender agiert hingegen Deep Research Max. Durch den intensiven Einsatz von Test-Time-Compute durchdenkt das Modell komplexe Fragestellungen schrittweise, sucht gezielt nach weiterführenden Informationen und gewichtet widersprüchliche Quellen. Bei internen Experten-Evaluationen deklassiert Max den Vorgänger und gewinnt in 65,1 Prozent der Fälle. Auch bei etablierten wissenschaftlichen Benchmarks dominiert die neue Architektur: Während bei der DeepSearchQA exzellente 93,3 Prozent erreicht werden, erzielt das System bei BrowseComp starke 85,9 Prozent. Prädestiniert ist die Max-Variante damit für asynchrone Hintergrundprozesse, etwa bei der Erstellung nächtlicher Due-Diligence-Berichte für Analysten-Teams.

Sichere Datenanbindung und native Grafiken

Zusätzliche Flexibilität erhalten Entwickler durch die native Unterstützung des Model Context Protocol (MCP). Über diese standardisierte Schnittstelle greifen die KI-Modelle direkt auf geschützte Fachdatenbanken oder firmeninterne Dateisysteme zu. Speziell für die Integration von Finanzdaten kooperiert Google bereits mit Anbietern wie FactSet, S&P und PitchBook. Ohne Umwege mutiert die klassische Websuche dadurch zu einer tiefgreifenden Analyse über ansonsten strikt verschlossene Datenbestände hinweg.

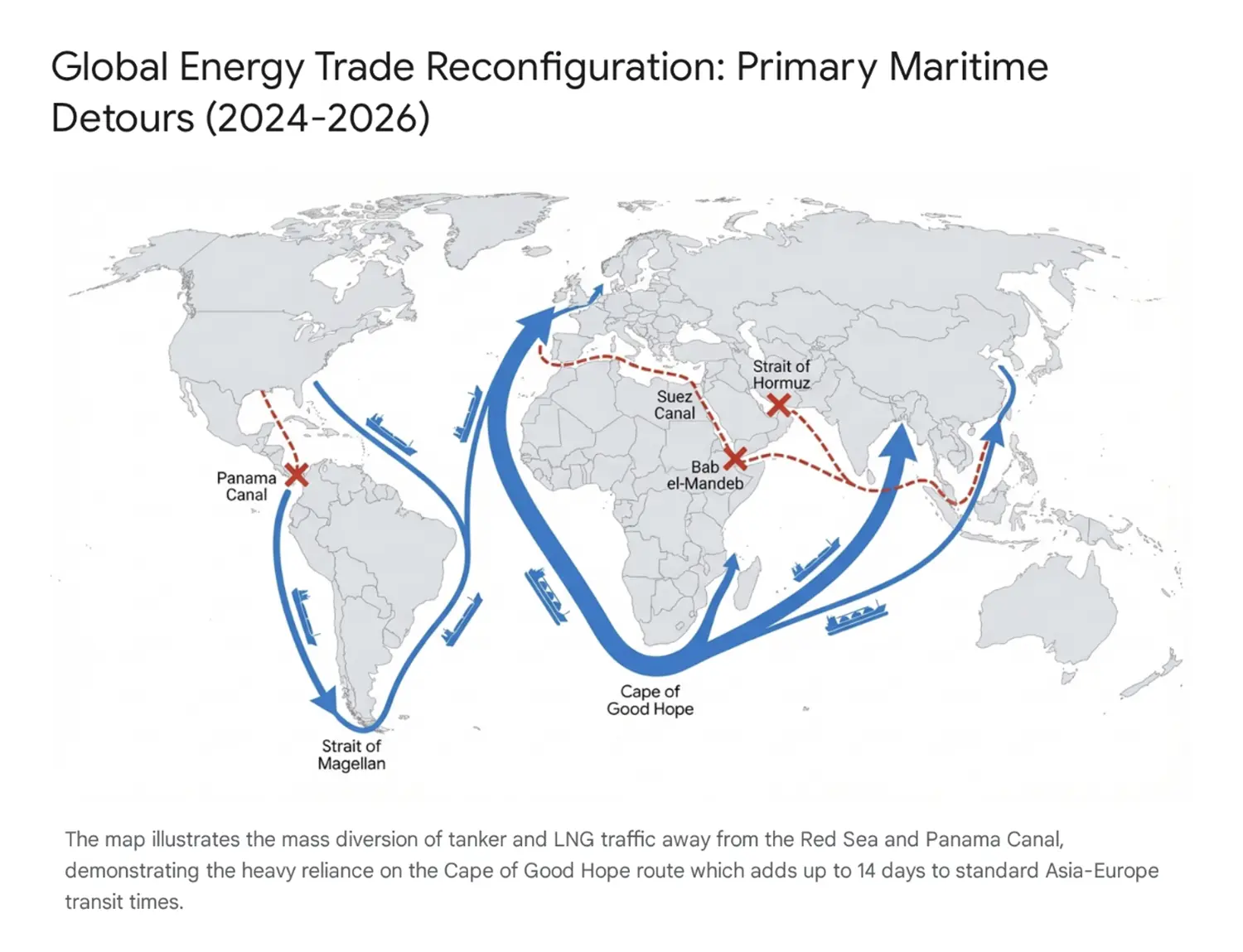

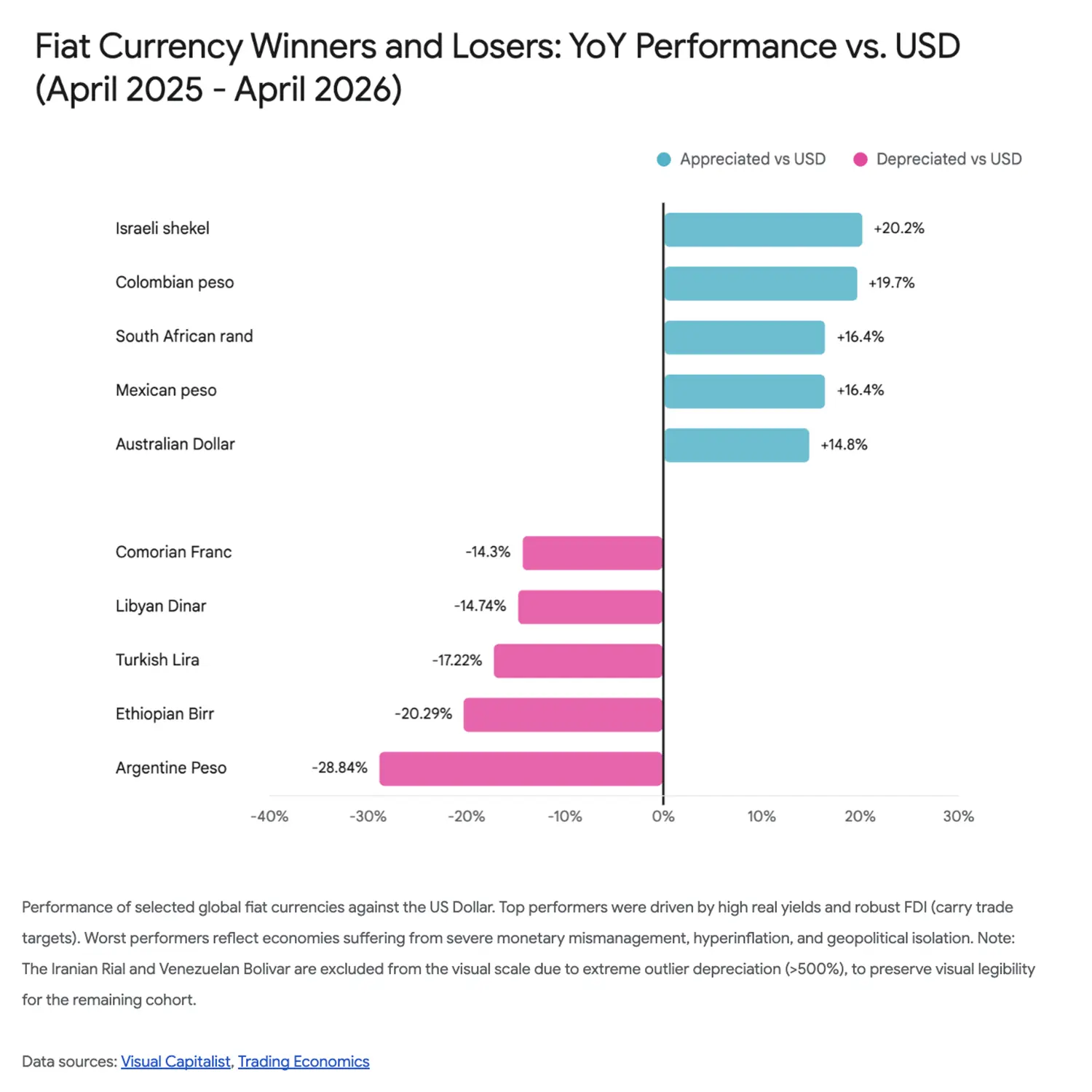

Gleichzeitig verlassen die Agenten die rein textbasierte Ausgabe. Innerhalb des Textverlaufs erstellen die Modelle nun eigenständig native Diagramme und Infografiken. Um komplexe quantitative Datensätze optisch ansprechend aufzubereiten, greift das System auf HTML oder den Bildgenerator Nano Banana zurück. Daraus resultieren direkt verwendbare Präsentationsgrundlagen, welche dichte technische Informationen sofort greifbar machen.

Erweiterte Steuerung und sofortige Verfügbarkeit

Bevor eine umfangreiche Analyse überhaupt startet, können Nutzer den strategischen Ablauf des Agenten im Detail überprüfen und lenken. Im laufenden Prozess liefert das System zudem kontinuierliche Live-Zusammenfassungen der eigenen Gedankengänge. Zur präzisen inhaltlichen Verankerung der Recherche verarbeiten die KI-Modelle nicht nur reinen Text, sondern akzeptieren als Ausgangsbasis multimodale Eingaben wie PDFs, CSV-Dateien, Bilder sowie Audio- und Videomaterial.

Entwicklern steht es dabei frei, die Recherchefunktionen mit Code-Ausführung oder internen Dateisuchen zu kombinieren. Über die kostenpflichtigen Tarife der Gemini API sind Deep Research und Deep Research Max via Interactions API ab sofort verfügbar.