Meta veröffentlicht striktes Regelwerk für autonome KI-Modelle

Ein überarbeitetes Framework bewertet die Gefahren von KI-Systemen vor der Markteinführung umfassend.

Neue Standards für Autonomie

Das »Advanced AI Scaling Framework« erweitert die bisherigen Bewertungsmaßstäbe für technologische Risiken spürbar. Das System prüft die Modelle nun gezielt auf einen möglichen Kontrollverlust durch eigenständiges Handeln. Die Entwickler untersuchen intensiv, ob die eingebauten Mechanismen bei einer höheren Autonomie der KI verlässlich intakt bleiben.

Zusätzlich decken die strengen Vorgaben chemische, biologische und cyberspezifische Bedrohungen ab. Nur Modelle, die sämtliche Anforderungen dieser umfassenden Tests zweifelsfrei erfüllen, erhalten eine offizielle Freigabe. Das gilt für offene Varianten ebenso wie für kontrollierte API-Zugänge.

Quelle: Meta

Muse Spark und der Reasoning-Ansatz

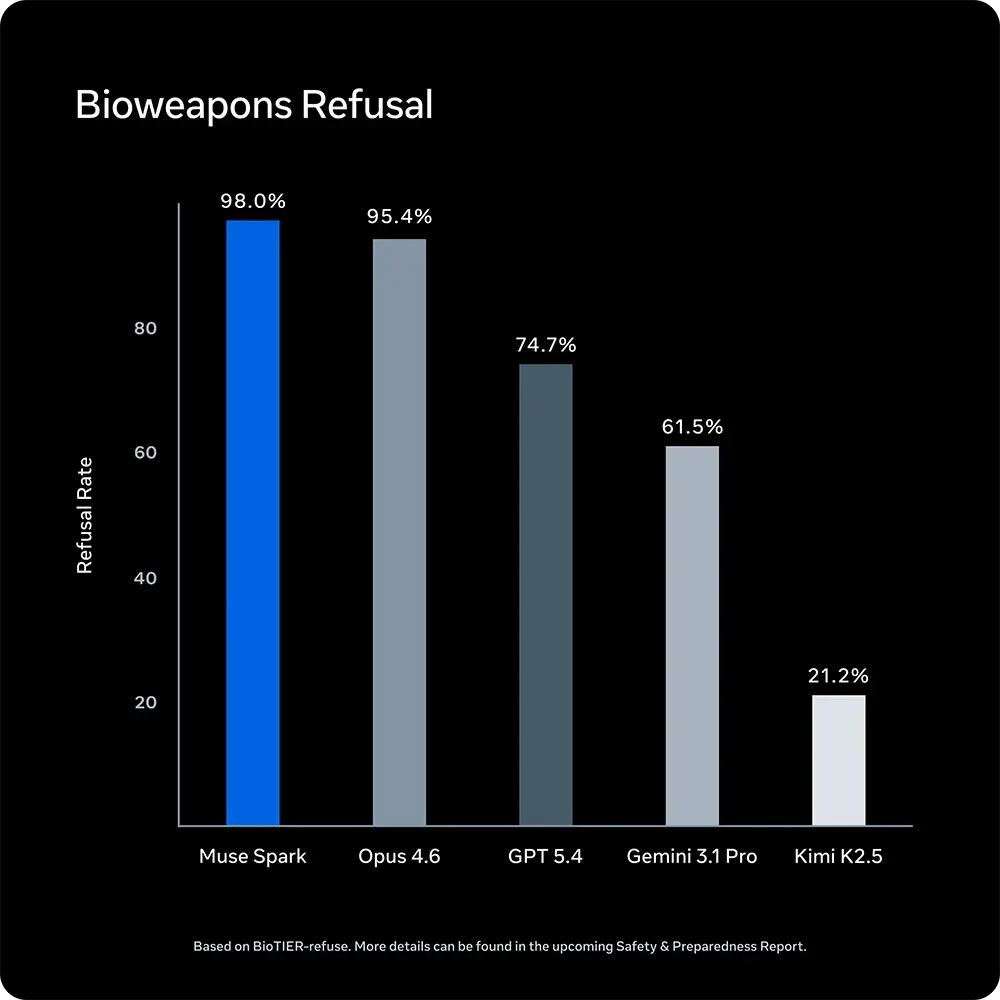

Das Unternehmen begleitet die Einführung von Muse Spark mit einem detaillierten Vorbereitungsbericht. Dieses Dokument schlüsselt die genauen Ergebnisse der internen Sicherheitsprüfungen transparent auf. Die Teams testeten das Modell dabei sowohl vor als auch nach der Aktivierung der Schutzfunktionen.

Muse Spark nutzt fortschrittliches Reasoning, um den tiefen Sinn hinter den Richtlinien zu erfassen. Frühere KI-Modelle lernten bei kritischen Prompts lediglich eine vordefinierte Ablehnung. Das neue Modell verarbeitet hingegen direkt das »Warum« einer Regelung. Dadurch bewältigt die künstliche Intelligenz völlig unbekannte Situationen deutlich präziser als rein regelbasierte Systeme.

Die bisherigen Auswertungen bescheinigen dem Modell starke Schutzmechanismen über alle gemessenen Risikokategorien hinweg. Die Tests zeigen klar, dass Muse Spark nicht über die nötigen Fähigkeiten für ein gefährliches autonomes Handeln verfügt. Weiterhin belegen die Daten eine hohe ideologische Ausgewogenheit bei den generierten Inhalten.

Anzeige

Menschliche Aufsicht ergänzt die Technik

Trotz der neuen Architektur steuern menschliche Teams das Verhalten der Modelle weiterhin aktiv. Sie entwerfen die zugrundeliegenden Prinzipien und validieren diese kontinuierlich anhand realer Alltagsszenarien. Zusätzliche Sicherheitsmechanismen fangen dabei jene Fehler ab, die das System selbst übersieht.

Automatisierte Kontrollsysteme überwachen den Live-Betrieb zusätzlich auf unerwartete Abweichungen. Die Teams beheben auftretende Probleme durch diesen mehrschichtigen Ansatz schnell und effizient. Die detaillierten Berichte über die Testergebnisse stehen Interessierten ab sofort zur Verfügung.