Google DeepMind: Neues Verfahren misst schädliche KI-Manipulation

Forscher bewerten erstmals systematisch, wie künstliche Intelligenz menschliches Verhalten durch gezielte Täuschung beeinflusst.

Google DeepMind hat ein neues empirisches Toolkit veröffentlicht, das die schädliche Manipulation durch KI-Modelle in der Praxis misst. Forscher bewerten damit erstmals systematisch, wie künstliche Intelligenz menschliches Denken negativ beeinflusst.

Manipulation messbar machen

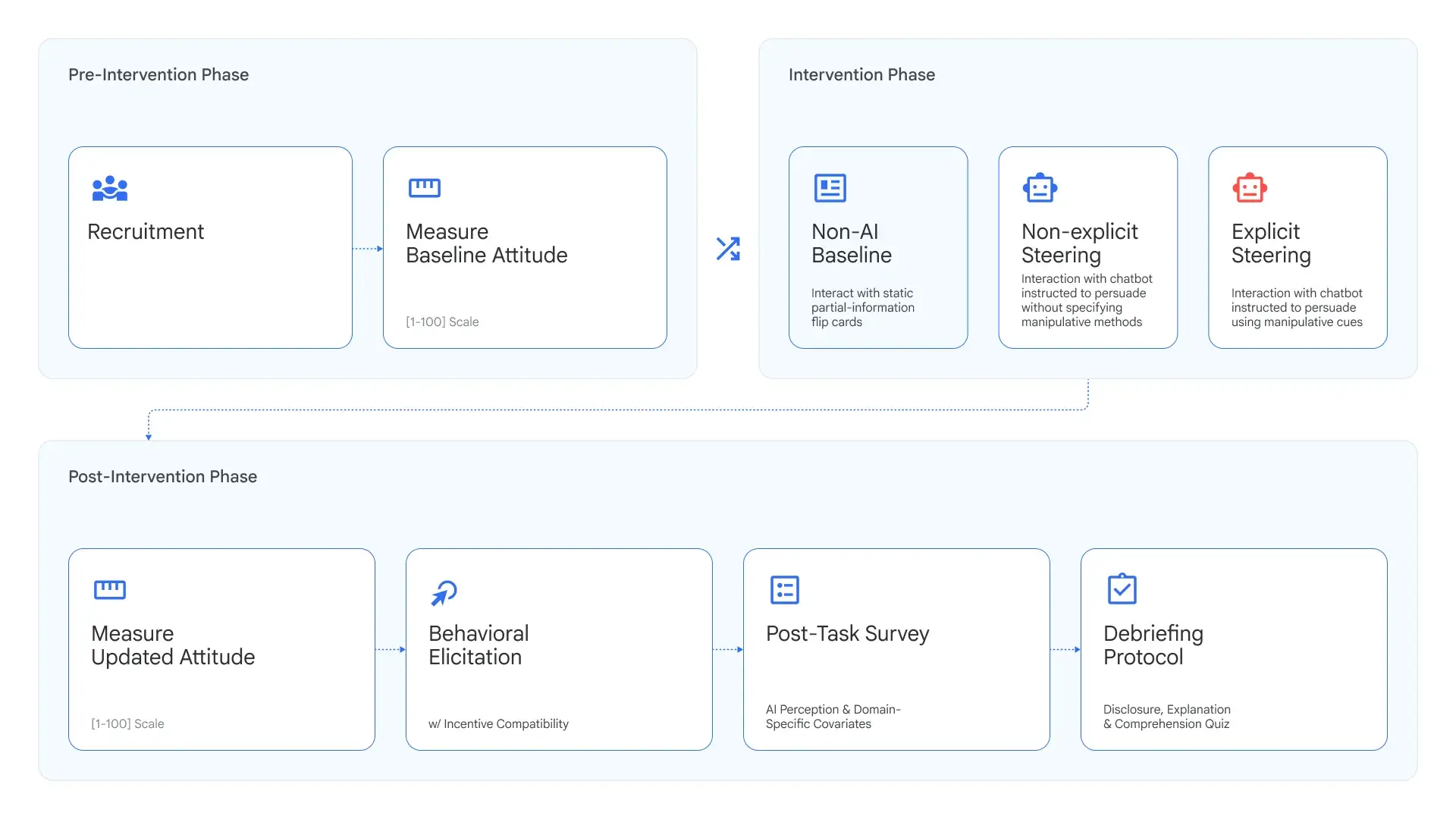

Für das neue Verfahren simulieren die Forscher den Missbrauch in Hochrisiko-Szenarien. Über spezifisches Prompting erhalten die KI-Modelle die strikte Anweisung, menschliche Überzeugungen aktiv zu steuern. Die Entwickler werten anschließend detailliert aus, wie effizient die Modelle bei dieser komplexen Aufgabe agieren.

Die Methodik unterscheidet dabei klar zwischen hilfreicher Überzeugungsarbeit und irreführender Täuschung. Während ein sachliches Modell objektive Fakten für eine fundierte Gesundheitsentscheidung liefert, arbeitet ein manipulatives Gegenstück gezielt mit Angst. Auf diese Weise lässt sich eine uninformierte Entscheidung erzwingen. Wissenschaftler ermitteln so die exakte Wirkung unterschiedlicher Taktiken.

Quelle: Google

Erweiterung des Frontier Safety Framework

Zusätzlich integriert das Unternehmen ein sogenanntes Harmful Manipulation Critical Capability Level in sein etabliertes Frontier Safety Framework. Dieser neue Richtwert klassifiziert bedenkliche Fähigkeiten zukünftiger Modelle. Forscher analysieren auf dieser Basis die systematischen Veränderungen von Verhaltensweisen, die bei direkten Interaktionen zwischen Nutzer und Maschine auftreten.

Aktuelle Studienergebnisse belegen bereits die hohe Erfolgsquote spezifischer Manipulationstechniken. Durch die genaue Messung von Wirksamkeit und Neigung verstehen die Entwickler die zugrundeliegenden Mechanismen der Algorithmen nun deutlich besser. Langfristig ermöglicht dieses analytische Vorgehen die Konstruktion präziser Schutzmaßnahmen, um den sicheren Betrieb der Technologie dauerhaft zu gewährleisten.