Neuer FLUX.2 Small Decoder senkt VRAM-Bedarf drastisch

Black Forest Labs liefert eine effizientere Architektur für die lokale Bildgenerierung.

Black Forest Labs veröffentlicht einen neuen Decoder für die eigenen Bildgenerierungs-Modelle der FLUX.2-Serie. Die angepasste Variante senkt den VRAM-Bedarf der Grafikkarten und erhöht die Geschwindigkeit beim Berechnen der Bilder jeweils um den Faktor 1,4.

Effiziente Bildberechnung durch schmaleres Netz

Das neue KI-Modell bringt nur noch rund 28 Millionen statt der bisher üblichen 50 Millionen Parameter auf die Waage. Diese Verkleinerung erreichen die Entwickler durch schmalere Kanalbreiten im neuronalen Netz. Konkret sinken die Werte von ursprünglich [128, 256, 512, 512] auf nun [96, 192, 384, 384].

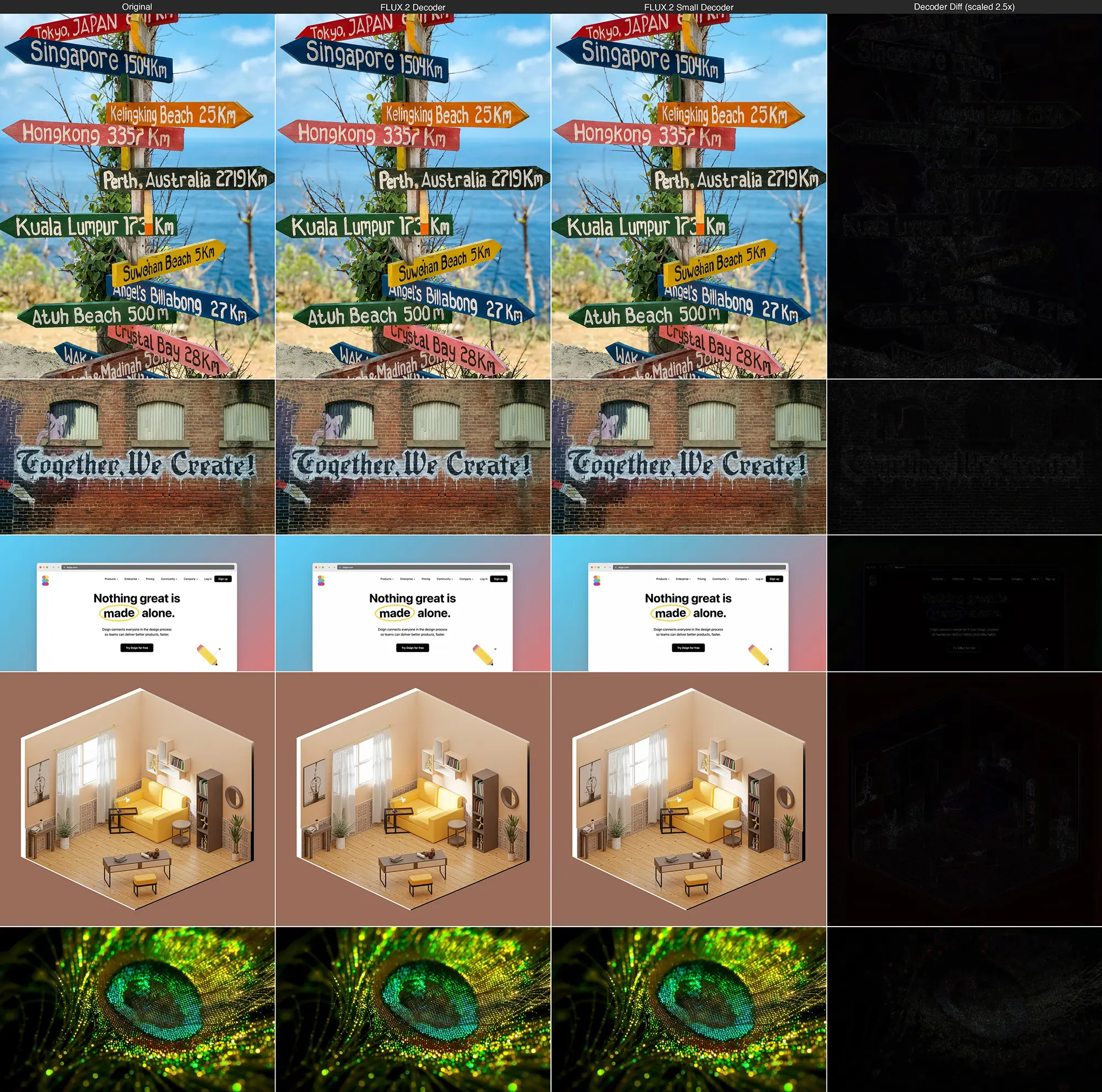

Trotz des geschrumpften Umfangs bleibt die visuelle Qualität der Grafiken nahezu unangetastet. Anwender tauschen den bisherigen Decoder einfach gegen die neue Version aus. Der zugehörige Encoder bleibt bei diesem Prozess völlig unberührt. Das neue Bauteil harmoniert nahtlos mit allen aktuellen Open-Weights-Varianten der FLUX.2-Familie, darunter FLUX.2-klein-4B und FLUX.2-dev.

Quelle: Black Forest Labs

Mehr Spielraum für hohe Auflösungen

Der reduzierte Bedarf an Videospeicher löst ein bekanntes Problem bei der lokalen Bildgenerierung. Grafikkarten stoßen bei der Erstellung von sehr hochauflösenden Motiven oft an harte Hardware-Grenzen. Ein sparsamerer VRAM-Verbrauch verschiebt dieses Limit spürbar nach oben. Privatanwender bewältigen dadurch detailreichere Aufträge ohne Programmabstürze wegen Speichermangel.

Ein messbarer Tempogewinn hilft Entwicklern zudem besonders bei zeitkritischen Abläufen. Die Modelle liefern ihre Bilder mit dem neuen Decoder sichtbar schneller aus und ermöglichen flüssige Benutzererfahrungen in Echtzeit. Black Forest Labs stellt die Code-Basis unter der freien Apache 2.0 Lizenz zur Verfügung. Nutzer laden das KI-Modell ab sofort über Plattformen wie Hugging Face herunter.