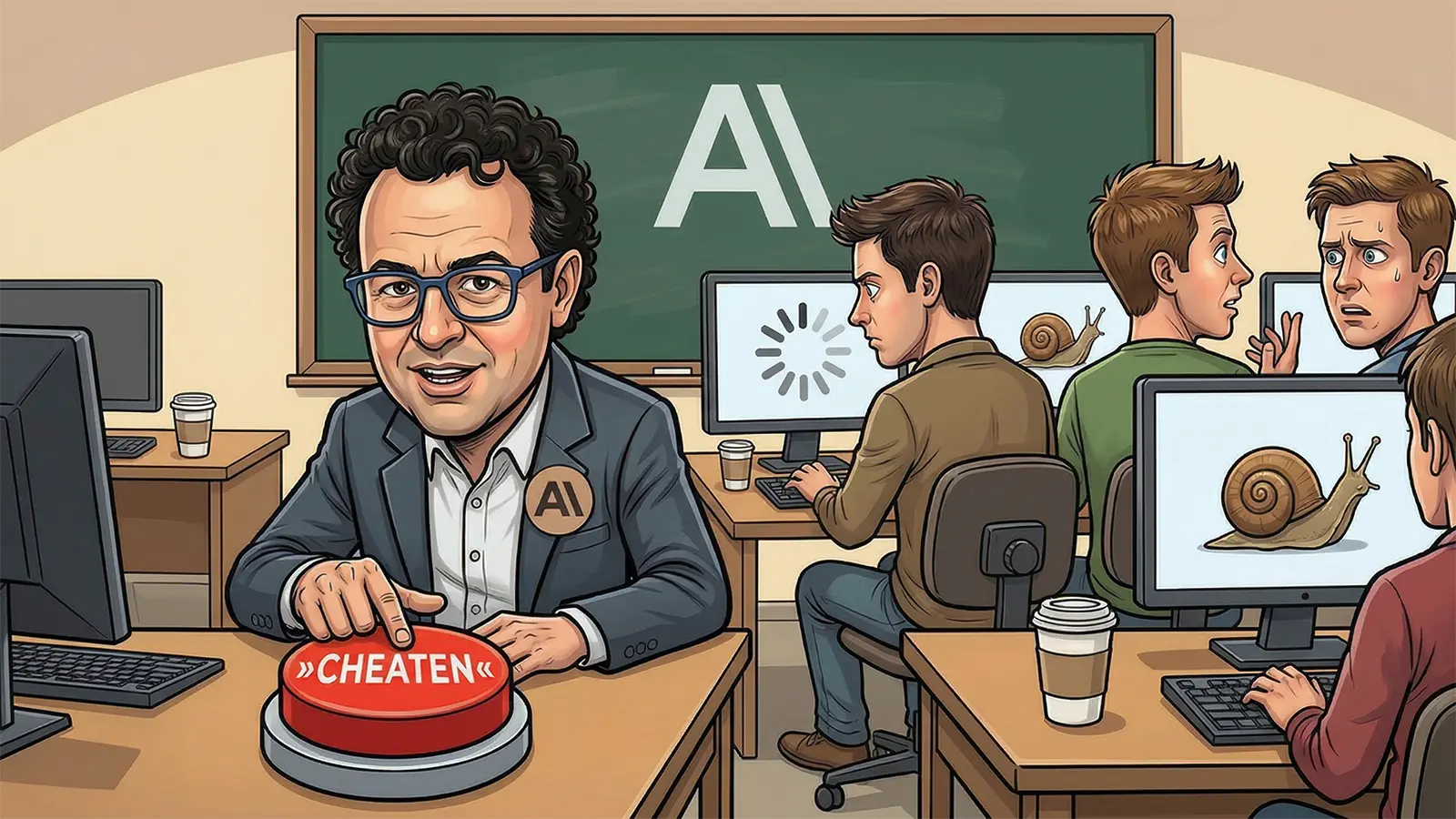

Drosselt Anthropic heimlich seine KI-Modelle?

Nutzer messen einen spürbaren Leistungsabfall beim Programmieren. Anthropic bestreitet ein absichtliches Downgrade jedoch mit Nachdruck.

Power-Nutzer werfen Anthropic vor, die Leistung der KI-Modelle Claude Opus 4.6 und Claude Code heimlich reduziert zu haben. Während Entwickler von sinkender Reasoning-Tiefe berichten, wehrt sich das Unternehmen gegen die Vorwürfe und verweist auf geänderte Standardeinstellungen.

Entwickler dokumentieren Leistungsabfall

Power-User äußern auf Plattformen wie GitHub ihren Unmut über die aktuelle Performance. Laut VentureBeat kritisieren die Nutzer, Claude Opus 4.6 und Claude Code arbeiten spürbar unzuverlässiger als noch vor wenigen Wochen. Die KI-Modelle verbrauchen demnach mehr Token, neigen zu Fehlern und brechen Programmieraufgaben unerwartet ab.

Eine Führungskraft von AMD untermauert die Beschwerden mit handfesten Daten. Der Entwickler wertete Tausende Sessions, Thinking-Blöcke und Tool-Calls von Claude Code aus. Seine Ergebnisse deuten auf einen drastischen Rückgang der Reasoning-Tiefe seit Ende Februar hin. Die Community befürchtet deshalb, Anthropic senke heimlich die Qualität der KI-Modelle, um knappe Rechenkapazitäten zu sparen.

Anzeige

Anthropic weist Downgrade-Gerüchte zurück

Das Unternehmen widerspricht den Spekulationen vehement und nennt völlig andere Gründe für das veränderte Verhalten. Thariq vom Anthropic-Team positioniert sich auf der Plattform X eindeutig: »Wir verschlechtern unsere Modelle nicht, um die Nachfrage besser bedienen zu können.«

Das offizielle Changelog von Claude Code soll die tatsächlichen Gründe für das veränderte Nutzererlebnis zeigen. Anthropic passte am 7. April 2026 den Standard-Effort-Level für API- und Enterprise-Nutzer von medium auf high an. Gleichzeitig implementierten die Entwickler neue Warnhinweise für das Rate-Limit und veränderten das Speichermanagement bei langen Sessions. Diese spezifischen Anpassungen an der Nutzeroberfläche und den Parametern verändern die Ausgabe, ohne die KI-Modelle selbst abzuwerten.

Striktere Regeln für externe Clients

Die Diskussion um die Leistungsfähigkeit fällt exakt mit neuen Kapazitätsgrenzen bei Anthropic zusammen. Das Unternehmen verlangt ab sofort zusätzliche Gebühren, wenn Abonnenten externe Clients wie OpenClaw nutzen. Diese intensiv genutzten Clients erzeugen laut Anthropic eine extrem hohe Serverlast, da sie die internen Optimierungen für den Prompt-Cache vollständig umgehen.

Abonnenten zahlen für diese intensiven Workloads künftig extra. Alternativ greifen sie direkt auf die API zu. Das Start-up reagiert damit auf den enormen Token-Verbrauch der Power-User und steuert das eigene Wachstum. Die messbaren Veränderungen bei Claude resultieren somit aus einer strengeren Nutzungssteuerung und nicht aus schwächeren KI-Modellen, laut Anthropic...