Princeton University: Kleine KI-Modelle sind die Zukunft

Forscher warnen vor den gigantischen Kosten aktueller KI-Modelle. Sie schlagen ein Netzwerk aus spezialisierten Experten vor.

Forscher der Princeton University stellen den aktuellen Kurs der KI-Entwicklung infrage. In einem neuen Forschungsbericht argumentieren sie, dass immer größere, generalistische KI-Modelle an physikalische und wirtschaftliche Grenzen stoßen. Stattdessen fordern die Wissenschaftler ein Netzwerk aus hochspezialisierten Experten.

Der Irrweg der großen Monolithen

Bisher setzen Entwickler auf das Prinzip »Bigger is better«. Sie trainieren gigantische KI-Modelle mit sämtlichen verfügbaren Daten des Internets. Das Ziel bleibt eine künstliche allgemeine Intelligenz (AGI). Dieser Ansatz verursacht jedoch enorme Probleme. Rechenzentren verbrauchen extrem viel Strom und Wasser.

Besonders die neuen Reasoning-Fähigkeiten vervielfachen die Kosten bei jeder einzelnen Anfrage. Zudem zeigen große KI-Modelle »echtes« logisches Denken fast nur bei Mathematik oder Programmierung. Dort existieren bereits feste Regeln und Strukturen. In offenen Themenbereichen scheitern die Generalisten häufig an komplexen Zusammenhängen.

Anzeige

Gesellschaft der Spezialisten

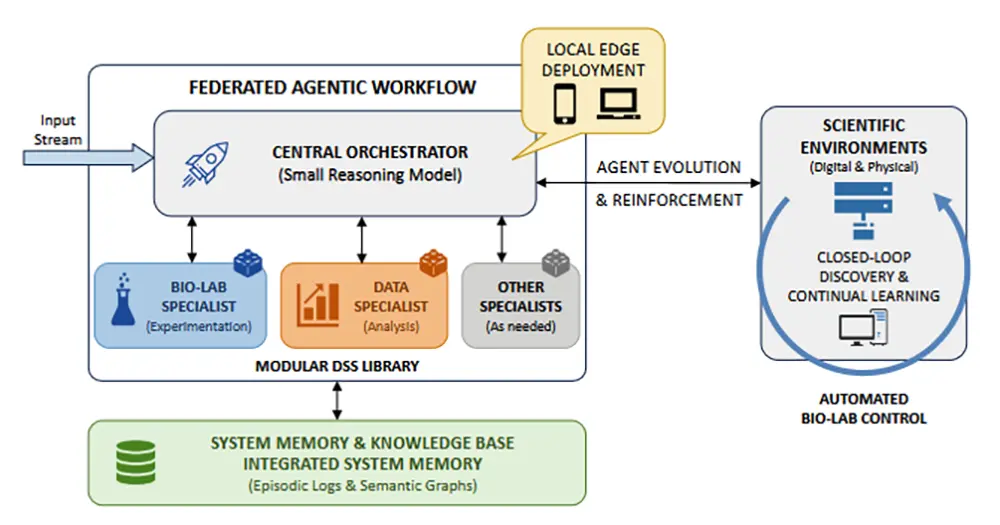

Die Princeton-Forscher schlagen das Konzept der Domain-Specific Superintelligence (DSS) vor. Anstelle eines einzigen riesigen Alleskönners arbeitet hier eine Gesellschaft aus vielen kleinen KI-Modellen zusammen. Ein übergeordneter Agent analysiert die Anfragen der Nutzer. Er leitet die Aufgaben direkt an das passende Experten-KI-Modell weiter.

Dieser Aufbau orientiert sich an menschlichen Gesellschaften. Auch dort lösen Fachleute gemeinsam komplexe Probleme. Die Arbeitsteilung reduziert die Abhängigkeit von einem einzelnen fehleranfälligen Knotenpunkt.

Quelle: https://arxiv.org/pdf/2603.14147 - Agentischer Workflow mit DSS

Logik durch strukturierte Daten

Um diese Spezialisten zu erschaffen, ordnen die Entwickler die Trainingsdaten völlig neu. Das Forschungsteam fordert den Aufbau von expliziten symbolischen Abstraktionen. Das bedeutet konkret den Einsatz von Wissensgraphen, Ontologien und formaler Logik.

Diese Strukturen bilden die Grundlage für synthetische Lehrpläne. Kleine KI-Modelle lernen dadurch spezifische Zusammenhänge sehr präzise. Sie verinnerlichen die zugrunde liegenden Regeln ihres Fachgebiets. Die Forscher erhoffen sich daraus verlässliche und überprüfbare Ergebnisse ohne typische Halluzinationen.

Effizienz und Datenschutz auf dem Endgerät

Diese Aufgabentrennung löst gleich mehrere Probleme der aktuellen Industrie. Kleine KI-Modelle benötigen deutlich weniger Rechenleistung. Sie senken den Energieverbrauch drastisch und entlasten die lokalen Stromnetze.

Zudem passen diese kompakten KI-Modelle direkt auf die Smartphones der Nutzer. Die Datenverarbeitung findet lokal statt, was die Privatsphäre der Anwender schützt.

Die Vision der Wissenschaftler zeigt einen ressourcenschonenden Weg für die künftige Entwicklung auf. Der Fokus rückt dabei von reiner Größe hin zu strukturierter Effizienz.