OpenAI kooperiert mit Pentagon nach Anthropic-Bann

OpenAI-CEO Sam Altman gab die Vereinbarung bekannt, die den Einsatz von Modellen in gesicherten Umgebungen ermöglicht. Field Deployment Engineers überwachen den Betrieb.

OpenAI kooperiert ab sofort mit dem US-Verteidigungsministerium und stellt seine KI-Modelle für geheime Netzwerke zur Verfügung. Der Vertragsabschluss folgt direkt auf eine Anordnung der US-Regierung unter Donald Trump, die Technologie des Konkurrenten Anthropic in Bundesbehörden zu verbieten.

Anzeige

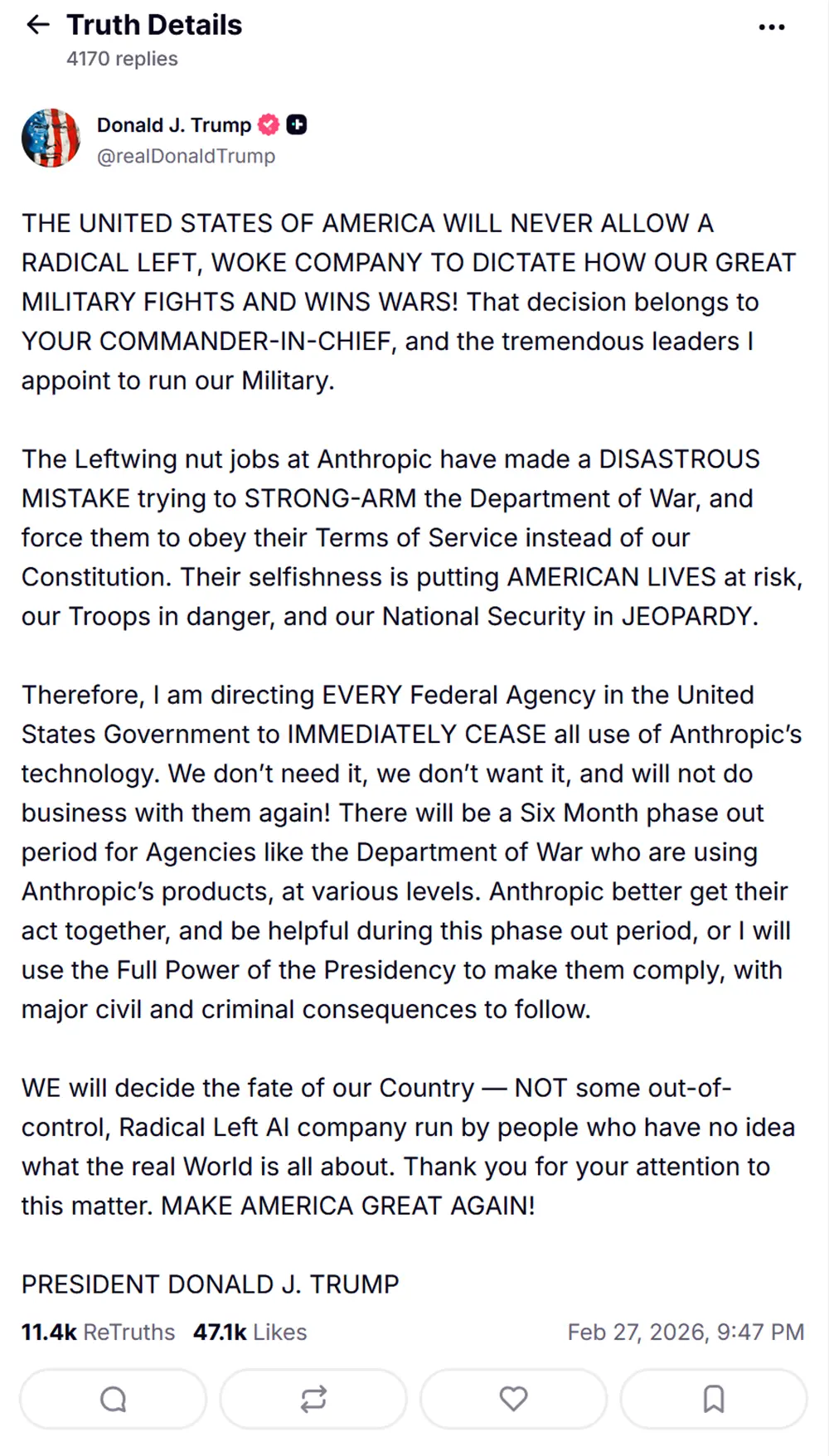

Trump verbannt Anthropic aus US-Behörden

Dem neuen Abkommen ging eine harte Entscheidung der US-Regierung voraus. US-Präsident Donald Trump untersagte den Einsatz von Anthropic-KI wie dem Modell Claude in sämtlichen Regierungsbehörden. Der Grund dafür war die Weigerung des KI-Unternehmens, seine strikten Nutzungsbedingungen für das Militär anzupassen.

Anthropic verbietet den Einsatz seiner Technologie für inländische Massenüberwachung und den Betrieb autonomer Waffensysteme. Da das Unternehmen nicht von dieser Position abwich, ordnete die Regierung an, die Software innerhalb von sechs Monaten in den Behörden vollständig auszumustern. Trump drohte zudem mit rechtlichen Konsequenzen, sollten Einrichtungen die Technologie nach Ablauf dieser Frist weiterhin verwenden.

Quelle: truthsocial

OpenAI übernimmt mit eigenen Bedingungen

Kurz nach diesem Verbot verkündete OpenAI-CEO Sam Altman die neue Partnerschaft mit dem Militär. OpenAI integriert seine Sprachmodelle nun in die klassifizierten Netzwerke des Verteidigungsministeriums. Der Betrieb von großen KI-Modellen in solchen hochsicheren, vom öffentlichen Internet isolierten Umgebungen erfordert besondere technische Anpassungen, um den Datenabfluss zu verhindern.

Altman betonte, dass OpenAI seine eigenen Sicherheitsprinzipien in dem Vertrag verankert hat. Laut Unternehmensangaben verbietet die Vereinbarung ausdrücklich die Nutzung der KI für die Überwachung der US-Bevölkerung. Ebenso bleibt die menschliche Kontrolle bei der Anwendung von Gewalt zwingend erforderlich, was den eigenständigen Einsatz der Modelle in Waffensystemen vertraglich ausschließt. Das Militär habe diese Prinzipien akzeptiert und spiegelt sie in internen Gesetzen wider.

Twitter Beitrag - Cookies links unten aktivieren.

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

— Sam Altman (@sama) February 28, 2026

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

Technische Kontrolle durch Cloud und Spezialisten

Um die Einhaltung der Vorgaben in der Praxis sicherzustellen, greift OpenAI auf spezifische Schutzmaßnahmen, sogenannte Safeguards, zurück. Diese Mechanismen kontrollieren die Interaktionen mit den Modellen, filtern unerlaubte Prompts und verhindern, dass die KI für schädliche Zwecke missbraucht wird.

Zusätzlich setzt das Unternehmen sogenannte Field Deployment Engineers ein. Diese IT-Spezialisten unterstützen direkt bei der Integration und überwachen die Sicherheit der KI-Modelle im laufenden Betrieb. Um die Architektur der Modelle zu schützen und die Kontrolle nicht aus der Hand zu geben, erfolgt die Bereitstellung ausschließlich über dedizierte Cloud-Netzwerke des Militärs.

Altman forderte, dass die US-Regierung diese vertraglichen Bedingungen als Standard für alle KI-Entwickler etablieren sollte. OpenAI sichert sich durch den neuen Deal eine wichtige Rolle in der staatlichen IT-Infrastruktur, während direkte Konkurrenten bei ausbleibenden Kompromissen lukrative Aufträge abgeben müssen.