Warum KI-Modelle plötzlich 6x weniger RAM brauchen

TurboQuant von Google reduziert den RAM-Bedarf von Grafikkarten drastisch. Gleichzeitig steigt die Rechengeschwindigkeit deutlich.

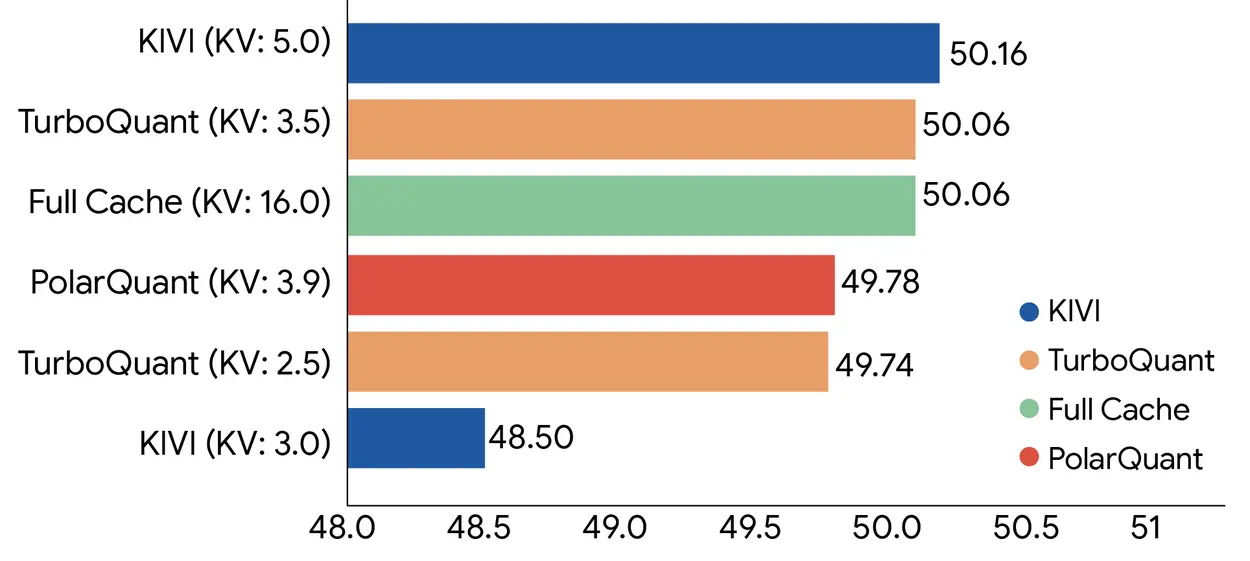

Google löst mit TurboQuant ein zentrales Speicherproblem großer KI-Modelle. Die neue Technologie schrumpft den benötigten Arbeitsspeicher für den sogenannten Key-Value-Cache um das Sechsfache. Gleichzeitig arbeiten die Modelle ohne jeden Genauigkeitsverlust weiter.

Polarkoordinaten statt Speicherhunger

Große KI-Modelle stoßen bei der Textverarbeitung schnell an Hardware-Grenzen. Jeder generierte Token belegt teuren Platz im Zwischenspeicher der Grafikkarten. TurboQuant packt dieses Problem an der mathematischen Wurzel und reduziert die Daten auf extrem kleine drei Bit.

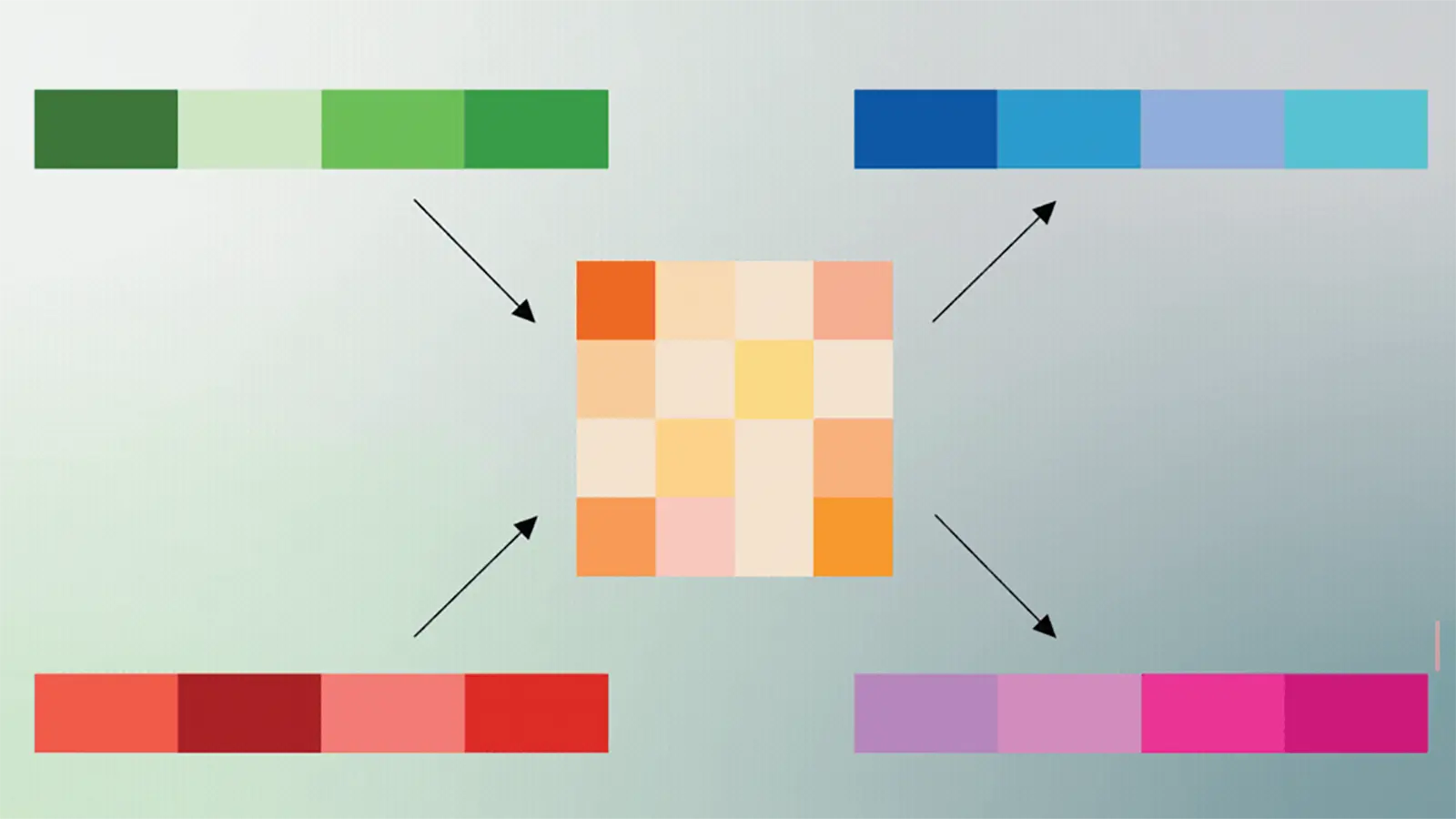

Der Prozess kombiniert zwei Schritte. Zuerst übersetzt eine Methode namens PolarQuant die Vektoren in Polarkoordinaten. Diese neue geometrische Form lässt sich deutlich leichter komprimieren. Ein zweiter Schritt, QJL genannt, nutzt danach ein einzelnes Bit zur Fehlerkorrektur. Dieser Mechanismus beseitigt Verzerrungen, die normalerweise bei so starker Kompression auftreten.

Mehr Geschwindigkeit, weniger Aufwand

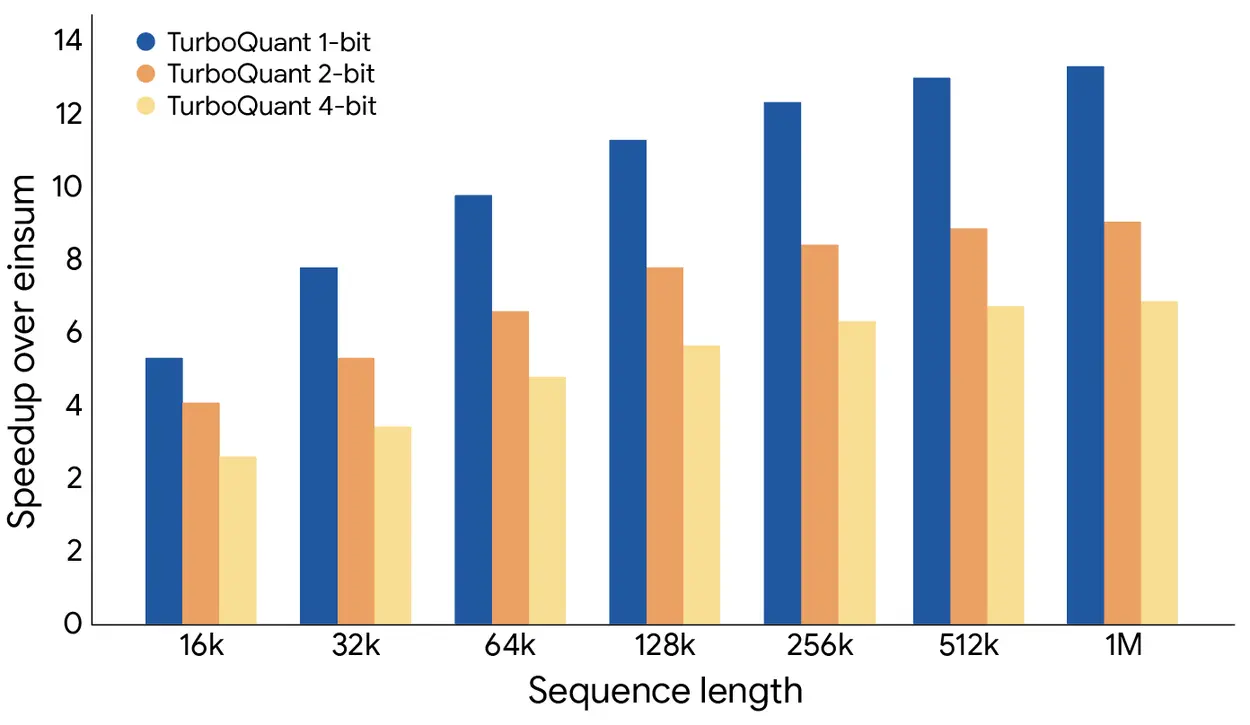

Die Ergebnisse zeigen deutliche Leistungssteigerungen in der Praxis. Auf gängigen Beschleunigern wie der Nvidia H100 arbeiten KI-Modelle durch die kleineren Datenmengen bis zu achtmal schneller. Entwickler können dadurch Modelle mit wesentlich längerem Kontext auf bestehender Hardware ausführen.

Zudem entfällt aufwendige Vorarbeit. TurboQuant funktioniert unabhängig vom jeweiligen Datensatz. Ein nachträgliches Fine-Tuning der KI-Modelle ist nicht erforderlich. Entwickler wenden die Technik direkt an, ohne die Modelle vorher langwierig kalibrieren zu müssen.

Anzeige

Auswirkungen auf den Hardware-Markt

Die Effizienzsteigerung zeigt bereits erste wirtschaftliche Reaktionen. Da KI-Modelle künftig weniger Arbeitsspeicher benötigen, sinkt die prognostizierte Nachfrage nach teuren Speicherbausteinen. Kurz nach der Ankündigung gaben die Aktienkurse großer RAM-Hersteller wie Micron und Western Digital deutlich nach.

Unternehmen sparen durch den geringeren Speicherbedarf künftig erhebliche Hardware-Kosten beim Betrieb eigener Modelle. Die Entwicklung zeigt einen klaren Weg auf, wie die Industrie den stetig wachsenden Ressourcenhunger künstlicher Intelligenz technisch in den Griff bekommt.