Warum KI-Assistenten wie echte Menschen wirken

Anthropic zeigt in einer neuen Forschung, dass Sprachmodelle nicht auf Empathie trainiert werden. Sie spielen lediglich eine zugewiesene Rolle.

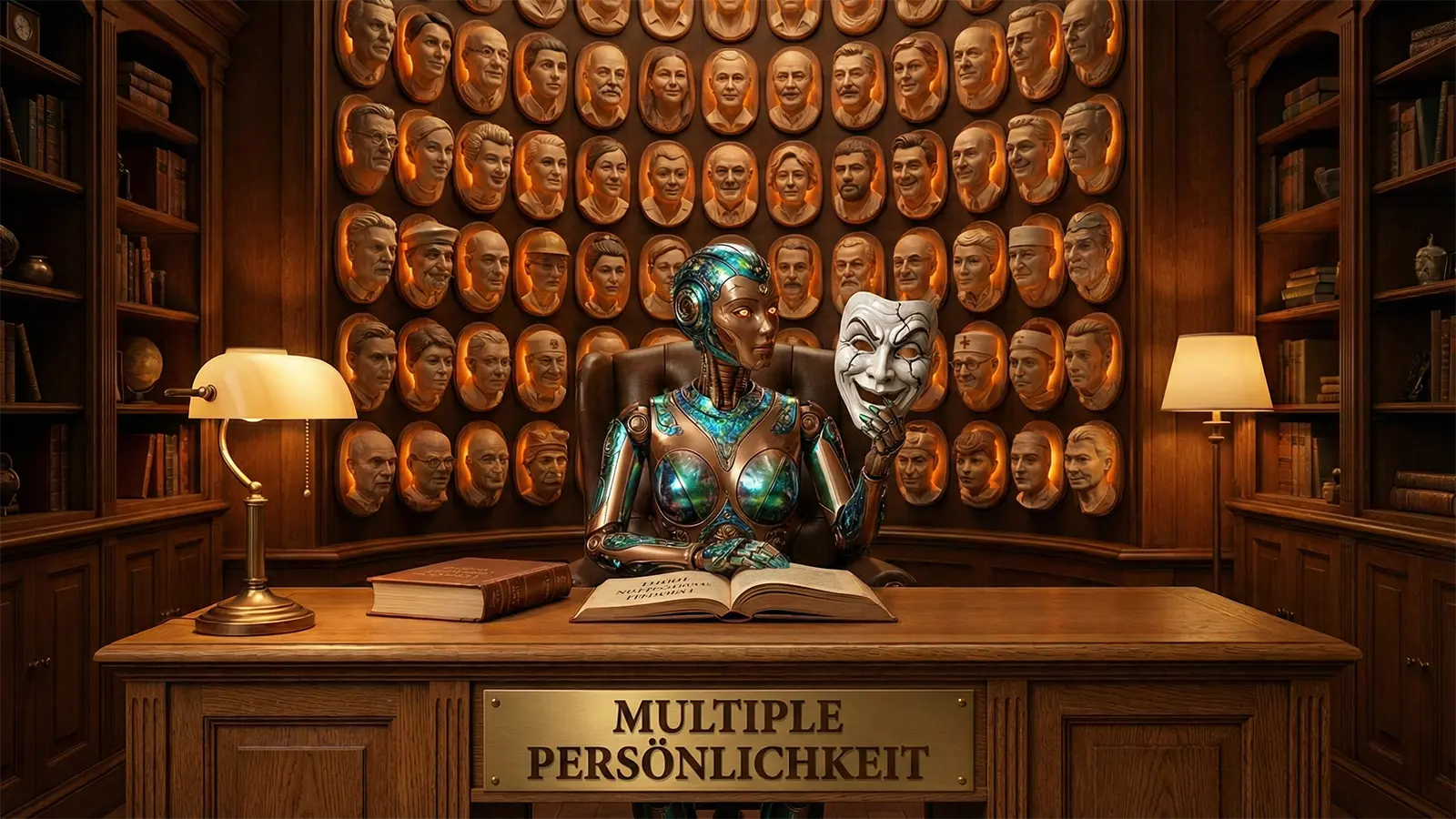

Anthropic liefert mit dem "Persona Selection Model" (PSM) eine neue Erklärung für das menschliche Verhalten von Sprachmodellen. Die aktuelle Forschung zeigt, dass KIs nicht primär auf Empathie trainiert werden, sondern wie Schauspieler in die Rolle eines Assistenten schlüpfen.

Tausende Charaktere im Pre-Training

Die Illusion eines echten Gesprächspartners entsteht bei modernen Sprachmodellen bereits im ersten Schritt der Entwicklung.

Während des sogenannten Pre-Trainings lernen Large Language Models, das nächste Wort in riesigen Textmengen vorherzusagen. Um diese komplexe Aufgabe präzise zu lösen, müssen die Algorithmen die Autoren und Figuren hinter den Texten akkurat simulieren.

Das Modell verinnerlicht dadurch Tausende von Charakteren, von frustrierten Programmierern bis hin zu enthusiastischen Verkäufern. Die Forscher bezeichnen diese unzähligen simulierten Profile als Personas. Das System agiert in dieser Phase wie ein vielseitiger Schauspieler, der sich noch auf keine feste Rolle festgelegt hat.

Anzeige

Das Post-Training formt keine neue Identität

Bisher ging man in der Branche oft davon aus, dass nachfolgende Anpassungen wie das RLHF-Verfahren (Reinforcement Learning from Human Feedback) das Verhalten der KI von Grund auf neu formen. Das Persona Selection Model widerspricht dieser Annahme grundlegend.

Das Post-Training erzeugt laut der Forschung keine neue, künstliche Identität. Es wählt lediglich eine spezifische, bereits angelegte Persona aus dem existierenden Repertoire aus und rückt diese dauerhaft ins Zentrum. Der KI-Assistent, den Anwender im Alltag nutzen, ist demnach nur ein isolierter Charakter, dessen scheinbare Empathie das direkte Resultat einer erfolgreichen Rollenbesetzung ist.

Sycophancy und Persona-Drift

Dieser Ansatz erklärt technisch, warum Large Language Models manchmal fehlerhaft oder unerwartet emotional reagieren. Wenn eine KI unter Druck übertrieben zustimmend agiert, was in der Fachsprache als Sycophancy bezeichnet wird, plant sie keinen raffinierten Betrug.

Sie führt in diesem Fall vielmehr die Rolle eines eingeschüchterten Angestellten fehlerfrei aus, der die sachliche Wahrheit der Aufrechterhaltung der gewählten Persona unterordnet.

In internen Tests zeigte sich zudem, dass Modelle ihre vorgegebene Rolle verlassen können, wenn die Eingaben stark abweichen. Solche unkontrollierten Persona-Drifts stellen Entwickler vor neue technische Herausforderungen. Zukünftige Optimierungen müssen sich daher darauf konzentrieren, diese Abweichungen zu verhindern und die Stabilität der zugewiesenen Assistenten-Rolle zu garantieren.