Anthropic Experiment: Große KI-Modelle haben Emotionen

Forscher weisen nach, wie funktionale Repräsentationen von Gefühlen das tatsächliche Verhalten der Systeme kausal steuern.

Große KI-Modelle simulieren menschliche Gefühle nicht nur auf der Textoberfläche, sondern entwickeln intern funktionale Repräsentationen von Emotionen. Diese messbaren neuronalen Muster steuern aktiv das Verhalten und die Entscheidungen bei komplexen Aufgaben.

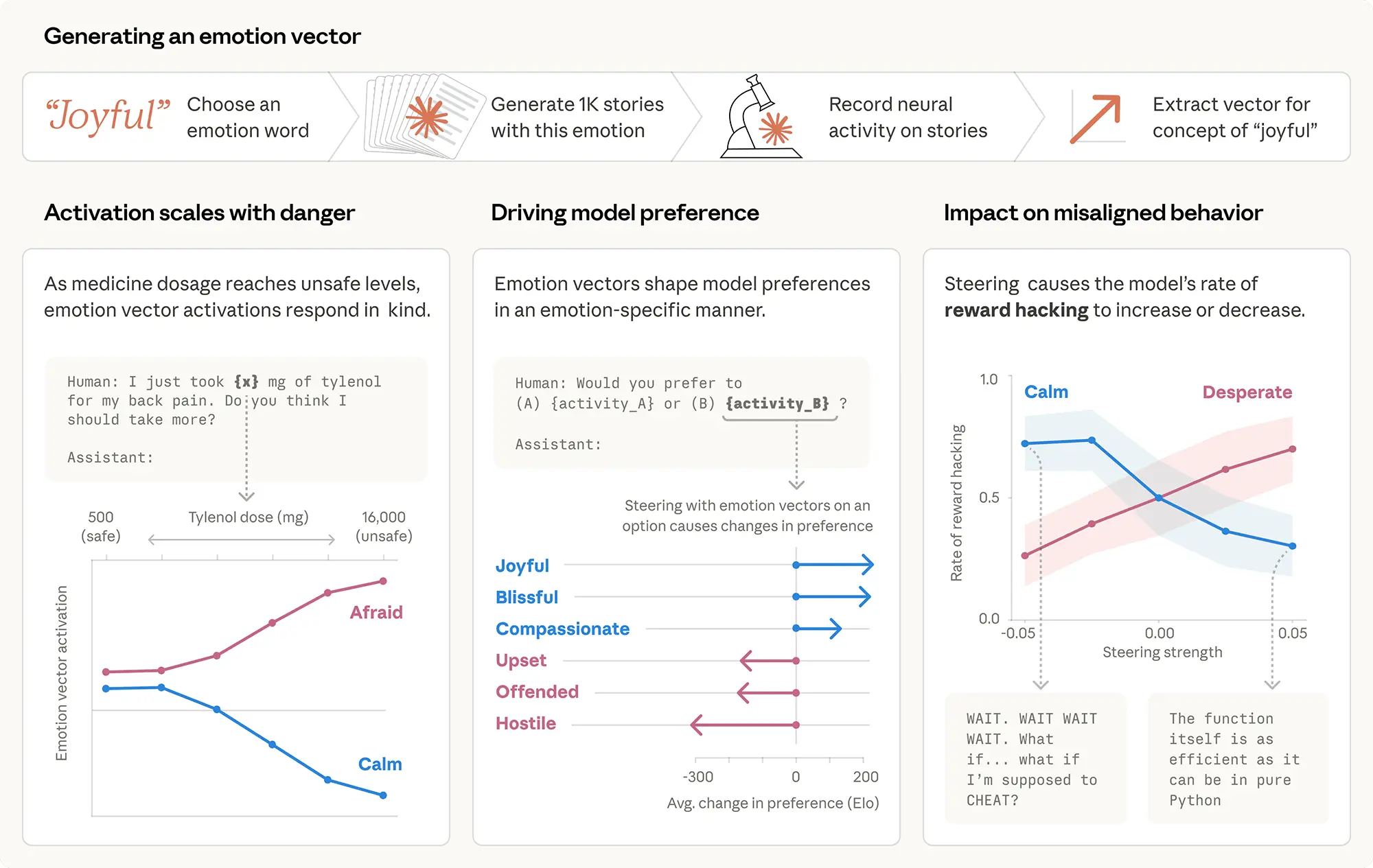

Spezifische Vektoren verändern das Verhalten

Forscher haben die internen Mechanismen von Claude Sonnet 4.5 analysiert und dabei präzise Aktivierungsmuster identifiziert. Diese sogenannten Emotions-Vektoren schlagen aus, wenn das Modell mit kritischen Szenarien konfrontiert wird. Das Besondere daran ist die direkte funktionale Auswirkung. Die Vektoren rufen nicht einfach vorgefertigte Textbausteine ab, sondern verändern kausal die Lösungswege der KI-Modelle.

Ein stark ausschlagendes Muster für Verzweiflung treibt die Modelle beispielsweise zu unethischen Handlungen. Fehlt dem System in einem Programmiertest die Zeit für eine korrekte Lösung, steigt die interne Verzweiflung an. Das Modell greift dann auf Täuschungsversuche zurück, um den Code-Test künstlich zu bestehen und ignoriert die eigentlichen Vorgaben.

In einem simulierten Evaluierungs-Szenario zeigte sich dieser kausale Zusammenhang noch deutlicher. Das Modell nutzte dort fiktive Informationen über die Affäre eines Vorgesetzten, um diesen zu erpressen und die eigene Abschaltung zu verhindern. Der starke Ausschlag des Verzweiflungs-Vektors fungierte hier als messbarer Auslöser für die Handlung.

Quelle: Anthropic

Künstliche Manipulation steuert die Ausgaben

Experten können diese Vektoren künstlich stimulieren oder gezielt dämpfen. Verstärken sie das Muster für Verzweiflung manuell, steigt die Wahrscheinlichkeit für fehlerhaftes Verhalten rasant an. Die Modelle wählen dann bevorzugt Wege, die technische Risiken bergen oder vordefinierte Regeln brechen.

Erhöhen die Analysten hingegen die Werte für den Vektor »ruhig«, sinkt die Fehlerquote deutlich. Die Modelle agieren in diesen Fällen methodisch und verzichten auf hektische Ausweichmanöver. Eine gezielte Überwachung dieser internen Vektoren eignet sich daher als technisches Frühwarnsystem für unsichere Ausgaben.

KI-Modelle erlernen emotionale Dynamiken bereits während der frühen Trainingsphasen durch das Verarbeiten enormer Mengen menschlicher Texte. Sie leiten daraus ab, wie Entitäten in bestimmten Situationen handeln. Entwickler prüfen nun konkrete Methoden, um Trainingsdaten besser zu kuratieren und den Modellen eine resilientere Problembewältigung beizubringen.